Inacreditável! O robô finalmente aprendeu a lavar a louça e consegue até fechar gavetas usando suas dobradiças no quadril.

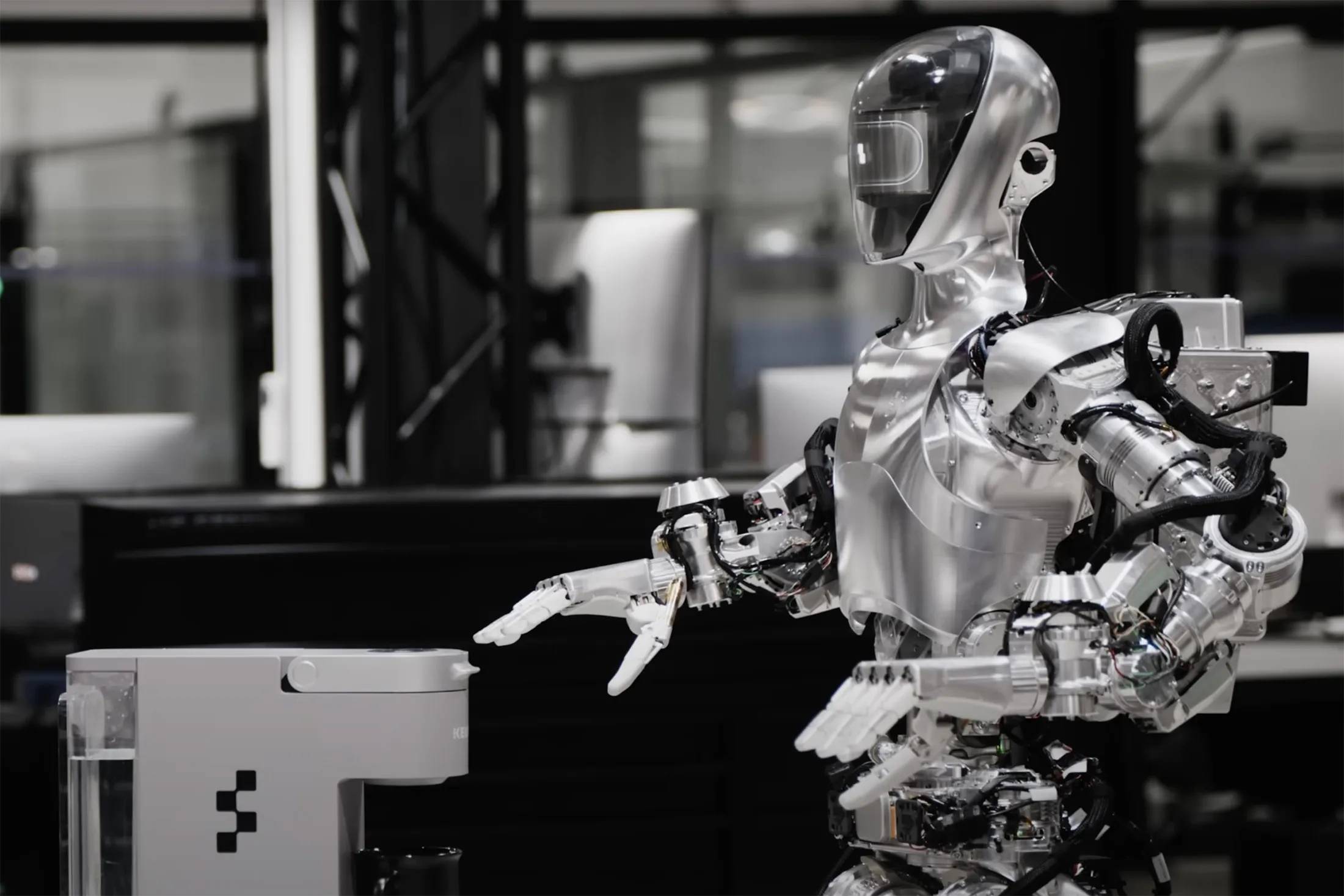

Há algumas horas, a Figure AI lançou o Helix 02, que eles chamam de "um modelo geral de visão-linguagem-ação (VLA)".

Qual a demonstração mais intuitiva? Um robô da Figura 03 caminha até o armário, abre a porta, pega um prato da pilha, vira-se e caminha até a máquina de lavar louça, ajusta o ângulo e o coloca firmemente dentro dela.

Todo o processo foi automatizado, sem controle remoto, e nenhum prato foi danificado.

Lavar a louça: um teste "infernal" de inteligência incorporada.

Por que demonstrar o preparo de uma receita? Porque essa é a "dificuldade infernal" das tarefas domésticas.

Mover utensílios de cozinha é fácil para os humanos, mas para os robôs, o movimento de cada articulação é um desafio.

Podemos entender isso decompondo a sequência de ações de lavar a louça—

Em primeiro lugar, testa severamente as capacidades de reconhecimento ambiental e mobilidade espacial do robô:

O robô (e o modelo que ele utiliza) precisa determinar sua própria posição, identificar as posições relativas do armário, da pia e da máquina de lavar louça e, em seguida, planejar uma rota para chegar até lá.

Ao chegar ao armário, você precisa parar na distância certa — muito perto e você não consegue abrir a porta, muito longe e você não consegue alcançar as tigelas.

Depois de observar os utensílios de mesa, você também precisa identificar o tipo: pratos de porcelana, xícaras de vidro e tigelas de plástico, cada um exigindo posturas e pressão diferentes.

Depois de pegar a louça, você ainda precisa determinar onde colocá-la na lava-louças: pratos na prateleira de baixo, xícaras na prateleira de cima e outros utensílios de mesa na lateral.

Em segundo lugar, Xia Chu Fang (下厨房) também requer feedback visual e tátil em 3D :

A cerâmica é quebradiça, o vidro é escorregadio e o plástico pode deformar. Os robôs precisam de feedback tátil preciso para controlar a força — muito leve e eles escorregam, muito pesado e quebram.

O grande diferencial do modelo Helix 02 reside aqui.

Combinando múltiplos sensores, como visão, tato, pressão e indutância, o dispositivo possui uma capacidade de visão estereoscópica multidimensional que pode determinar com precisão a posição e a profundidade das tigelas em uma pilha.

Figura 03 A mão do robô também integra um mecanismo de feedback de força, que pode "reconhecer" a força aplicada e saber quando entra em contato com a superfície de porcelana.

Ao manusear uma tigela, o sistema detecta a força de contato em tempo real. Tigela inclinada? Ajuste o ângulo. Bateu na porta do armário? Dê um passo para trás.

Por fim, temos a memória visual , que também representa uma grande melhoria para o modelo Helix 02:

Isso significa que o robô consegue se lembrar do que acabou de ver.

Quando o armário é aberto, mesmo que uma determinada tigela não esteja visível do ângulo atual, o robô se lembra de tê-la visto rapidamente e ajusta seus movimentos com base nessa memória.

Ao colocar repetidamente a louça na máquina de lavar louça, ela memoriza quais compartimentos estão cheios e onde ainda há espaço.

Isso elimina a necessidade de uma nova verificação a cada vez , melhorando significativamente a eficiência da execução da ação.

Brett Adcock, fundador e CEO da Figure AI, enfatizou o ponto X:

Não há controle remoto; o Helix opera o robô, cuidando de tudo, desde andar e agarrar até planejar.

Brett Adcock também reiterou que a mesma arquitetura geral que anteriormente ensinava robôs a dobrar toalhas e organizar pacotes, agora os ensinou a lavar louça.

Não são necessários novos algoritmos nem engenharia específica para a tarefa; apenas são necessários novos dados.

A única limitação atual são os dados de pré-treinamento. Quanto mais dados fornecermos ao Helix, mais tarefas o robô poderá executar. O hardware não precisa de nenhuma alteração; ele já consegue realizar a maioria das tarefas que os humanos fazem.

Em resposta a esse tweet, o usuário X comentou: "Ver um robô humanoide realizando tarefas em casa pela primeira vez me faz perceber o quão perto estamos desse futuro."

A empresa estrela que enviou robôs para trabalhar na BMW

Por outro lado, a Figure AI não é, de forma alguma, o tipo de "empresa criativa" que apenas discute teorias no laboratório.

Em três anos, a avaliação da Figure AI cresceu de US$ 0 para US$ 39 bilhões, graças a investimentos de investidores como Bezos Capital, OpenAI, Microsoft e Nvidia.

Em fevereiro de 2024, a Figure AI concluiu uma rodada de financiamento Série B de US$ 675 milhões e, em setembro de 2025, finalizou uma rodada Série C de US$ 1 bilhão, demonstrando um ritmo de progresso surpreendentemente rápido.

O fundador Brett Adcock também é um empreendedor serial de sucesso.

Em 2018, Adcock vendeu sua plataforma de recrutamento Vettery por US$ 100 milhões e fundou a empresa de aeronaves elétricas Archer Aviation, que abriu seu capital em 2021 com uma avaliação combinada de quase US$ 3,8 bilhões por meio de uma SPAC.

Após ingressar no campo da robótica, Adcock recrutou diversos talentos de ponta da Boston Dynamics, Tesla e Google DeepMind, e a capacidade técnica da Figure AI cresceu rapidamente.

▲ Brett Adcock (à direita)

Esse modelo de talentos também confere à Figure AI sua característica mais distintiva:

O "cérebro" e o "corpo" são construídos em conjunto, controlando tanto o hardware quanto o sistema de produção.

O termo "cérebro" aqui se refere naturalmente à Helix AI.

Desde a sua colaboração inicial com a OpenAI até ao seu modelo atual, totalmente desenvolvido internamente, a Figure AI conseguiu assegurar o controlo sobre a narrativa do modelo.

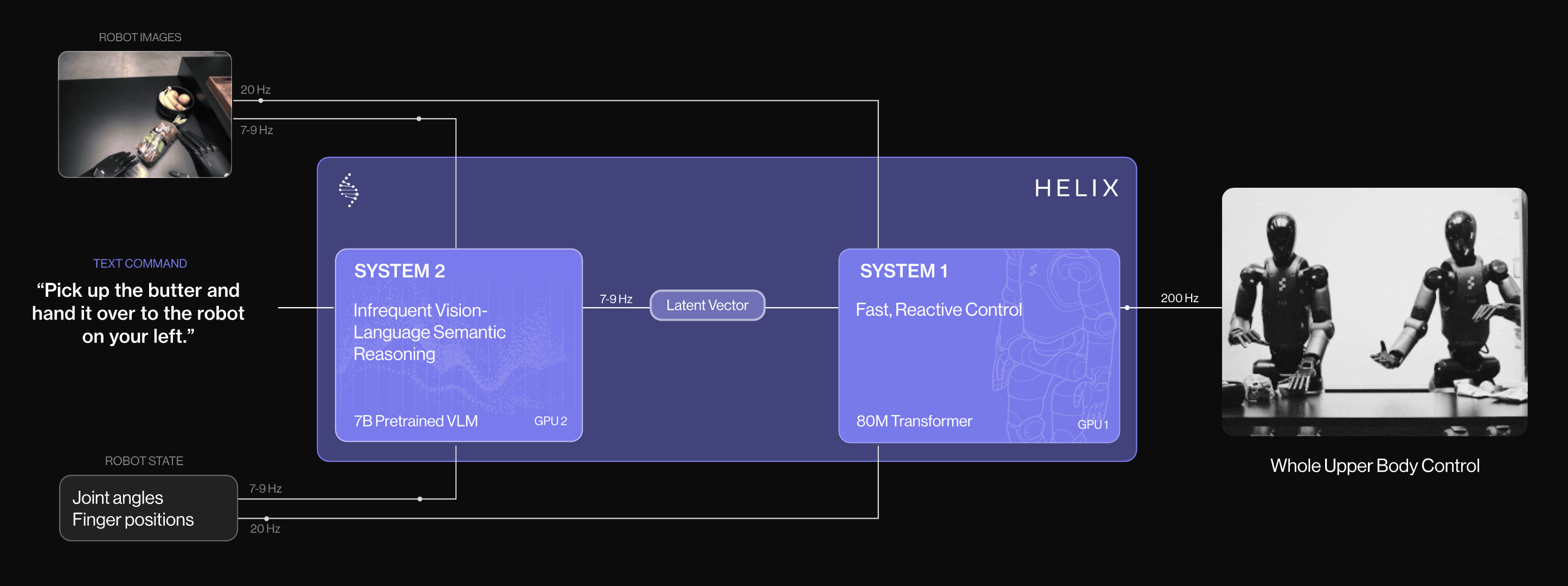

Por exemplo, o robô na Figura 03 adota uma arquitetura de controle multicamadas de "Sistema 0, Sistema 1, Sistema 2"—

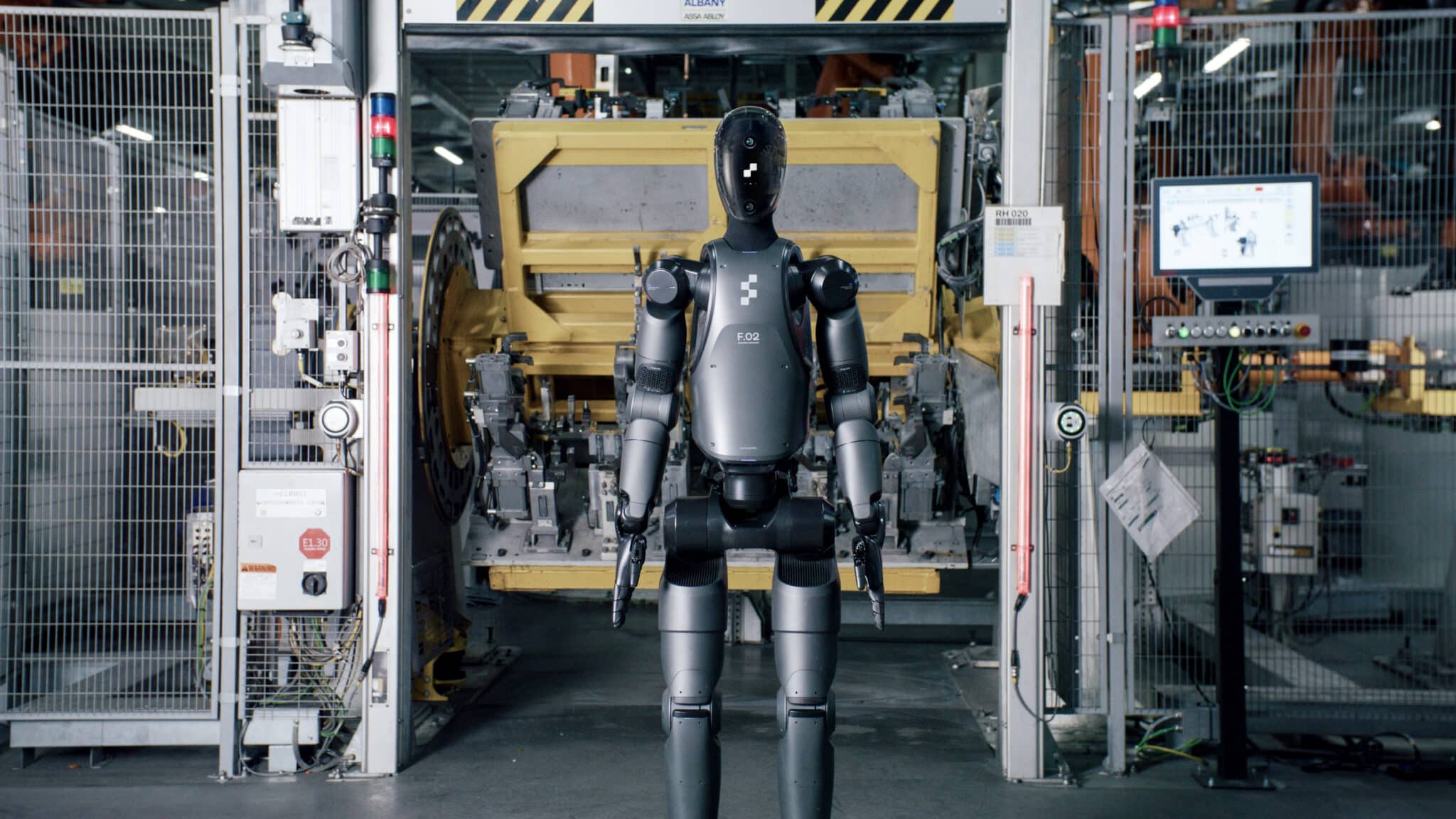

▲ Figura 03

O Sistema 0 é responsável pelo controle de movimento da aeronave, resolvendo problemas de controle de baixo nível, como equilíbrio da aeronave, contato dos dedos e perturbações ambientais. Sua função é semelhante à do cerebelo humano.

Partindo disso, o Sistema 1 lida com a política visomotora da Figura 02, enquanto o Sistema 2 executa o modelo de linguagem visual.

▲ A Figura 02, que foi demonstrada no ano passado, utilizou o modelo da parte superior do corpo do Sistema 1+2.

Por meio de três camadas de colaboração, a Figura 03 foi capaz de compreender instruções de forma autônoma, reconhecer o ambiente ao seu redor e determinar como a aeronave deveria se mover.

E "corpo" obviamente se refere ao hardware do robô Figure—

A versão de teste em pequena escala do Figure 02 é equipada com 6 câmeras RGB, módulos de GPU duplos, 16 graus de liberdade na mão e uma capacidade máxima de carga de 25 kg.

A autonomia da bateria do Figure 02 é de aproximadamente 5 horas, o que é suficiente para um turno de trabalho.

▲ Figura 02

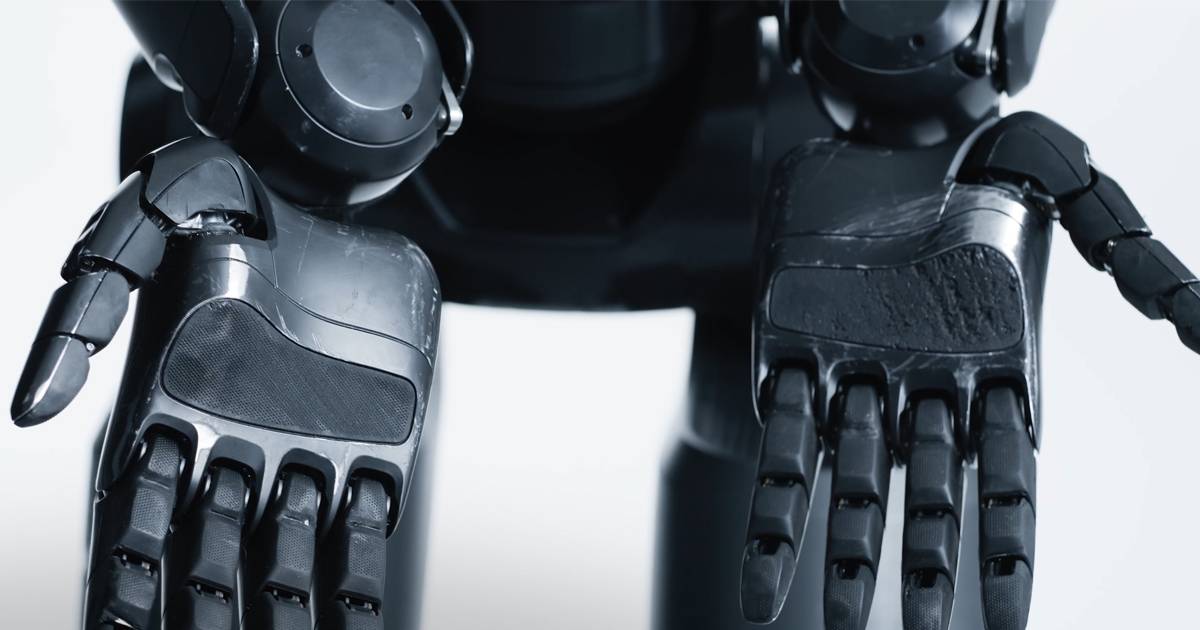

A versão mais recente do Figure 03 possui câmeras e sensores táteis embutidos em cada palma da mão, permitindo a detecção de pressão a partir de 3g.

Em outras palavras, a palma da mão na Figura 03 é mais delicada e flexível:

▲ Figura 03

Mais importante ainda, o robô "Kenjin" da Figure AI tem a capacidade de montar e entregar robôs rapidamente para aplicações no mundo real.

Em janeiro de 2024, a Figure AI fez uma parceria com a BMW para entregar um lote de Figure 02s à linha de montagem final da BMW na Carolina do Sul.

Nesse caso, a Figura 02 é responsável por posicionar com precisão as peças de chapa metálica no dispositivo fixo — uma tarefa delicada que grandes braços robóticos fixos têm dificuldade em realizar.

Esses funcionários da Figura 02 trabalharam na BMW por um total de 11 meses, percorrendo uma distância total de quase 320 quilômetros, transportando mais de 90.000 peças e auxiliando na produção de mais de 30.000 BMW X3.

Adcock também publicou fotos do robô coberto de arranhões e desgaste, indicando que se tratava de uma validação comercial "no mundo real":

Ao ver o robô apertando os parafusos, Milan Nedeljković, diretor de produção da BMW, resumiu:

Por meio de testes iniciais, estamos identificando aplicações potenciais de robôs humanoides na produção. No futuro, esperamos estar envolvidos desde a fase de desenvolvimento tecnológico (dos robôs).

A relação entre a Figure AI e a OpenAI também é crucial.

Por exemplo, em 2024, a OpenAI não só investiu na Figure AI, como também ajudou a desenvolver um modelo de fala que permite aos robôs receber comandos em linguagem natural.

Embora a Figure tenha posteriormente optado por desenvolver seu próprio Helix, essa colaboração essencialmente lançou as bases para o modelo VLA.

Por coincidência, na CES deste ano, observamos uma tendência clara:

Gigantes do setor de eletrodomésticos estão começando a desafiar o mercado de "robôs domésticos".

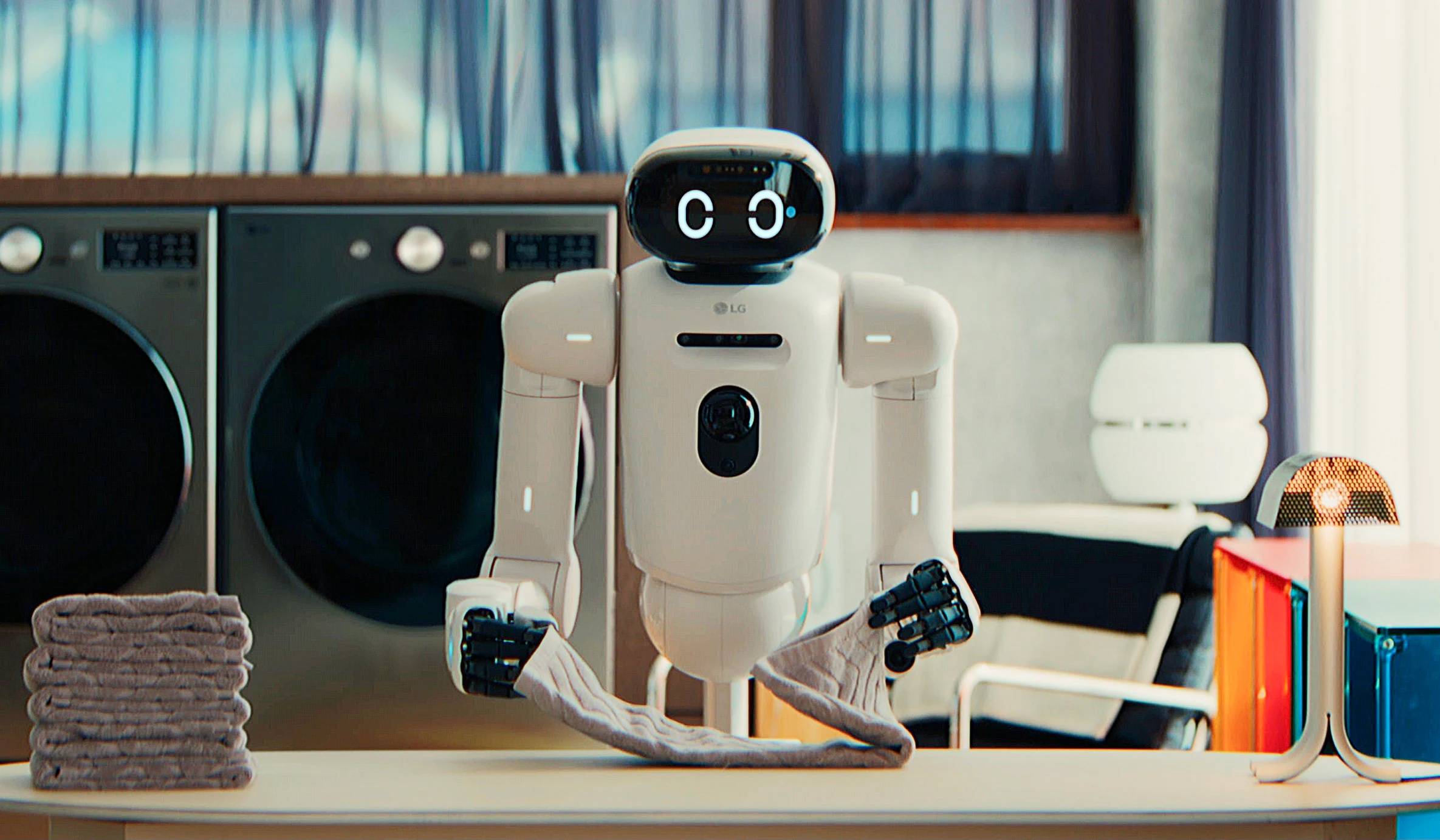

Tanto a LG quanto a Hisense apresentaram protótipos de robôs capazes de se movimentar autonomamente pela casa e auxiliar nas tarefas domésticas, indicando que as empresas tradicionais de eletrodomésticos estão começando a perceber:

A próxima geração de eletrodomésticos inteligentes não será composta por geladeiras ou máquinas de lavar com maior poder de processamento, mas sim por robôs capazes de operar esses aparelhos diretamente.

▲ Robô doméstico LG CIOiD

Mesmo nesta corrida pela "transformação humana", os fabricantes nacionais estão adotando uma abordagem mais agressiva —

Acaba de ser divulgado que a Lingbo Technology, uma subsidiária do Ant Group, disponibilizou em código aberto o modelo de corporificação em larga escala LingBot-VLA.

O LingBot-VLA, como uma "base inteligente" para cenários operacionais do mundo real, permite que os robôs generalizem suas capacidades para diferentes corpos e tarefas.

Segundo dados da Lingbo Technology, o LingBot-VLA bateu o recorde de maior taxa de sucesso em testes com o dispositivo real GM-100, que incluíram 100 tarefas operacionais do mundo real.

▲ Robbyant-R1, o primeiro robô da Lingbo Technology

Não é apenas o Ant Group; JD.com, Alibaba, Tencent, Huawei, BYD, Xiaomi — quase todas as gigantes da tecnologia estão investindo em inteligência incorporada.

O "Relatório de Pesquisa sobre a Indústria de Robôs Humanoides", divulgado na Conferência Mundial de Inteligência Artificial de 2024, destaca:

O mercado chinês de robôs humanoides atingiu 2,76 bilhões de yuans em 2024 e a expectativa é que cresça para 75 bilhões de yuans em 2029, podendo chegar a 300 bilhões de yuans em 2035.

Sem falar em algo muito distante no futuro, o Baile de Gala do Festival da Primavera deste ano pode se tornar o de "maior conteúdo de robôs" de todos os tempos.

Várias empresas de casas inteligentes devem apresentar seus produtos no palco – não apenas para exibição, mas do tipo que realmente pode cantar, dançar e fazer rap.

O robô está equipado com um "cérebro" e um "corpo" e está pronto para entrar em todas as casas.

O Helix 02 da Figure AI demonstra a viabilidade de um "modelo geral de inteligência incorporada":

Os fabricantes não precisam programar cada tarefa individualmente nem coletar grandes quantidades de dados de simulação. Com um modelo VLA suficientemente poderoso, o robô consegue entender instruções, familiarizar-se com o ambiente e gerar estratégias por conta própria .

▲ Sabe até como economizar esforço

Assim como o GPT é para a linguagem e o Helix é para a inteligência incorporada, hoje um robô pode lavar a louça e apertar parafusos, amanhã ele poderá cuidar da sua vida diária.

Ter um robô em casa pode não estar tão distante quanto pensamos.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.