Testes práticos do Seedance 2.0: Estrangeiros estão ansiosos para se cadastrar – este é o momento do “mito negro” dos vídeos de IA chineses.

"A tecnologia Seedance 2.0, originária da China, se tornará a mais avançada."

"Isto é inteligência artificial, estamos condenados."

▲Na plataforma X, diversos criadores de vídeo com IA afirmaram que o Seedance 2.0 teve um desempenho excepcional.

Nos últimos dias, vídeos com inteligência artificial gerados pelo Seedance 2.0 têm se espalhado rapidamente em plataformas como Douyin, canais de vídeo do WeChat e redes sociais internacionais como o X.

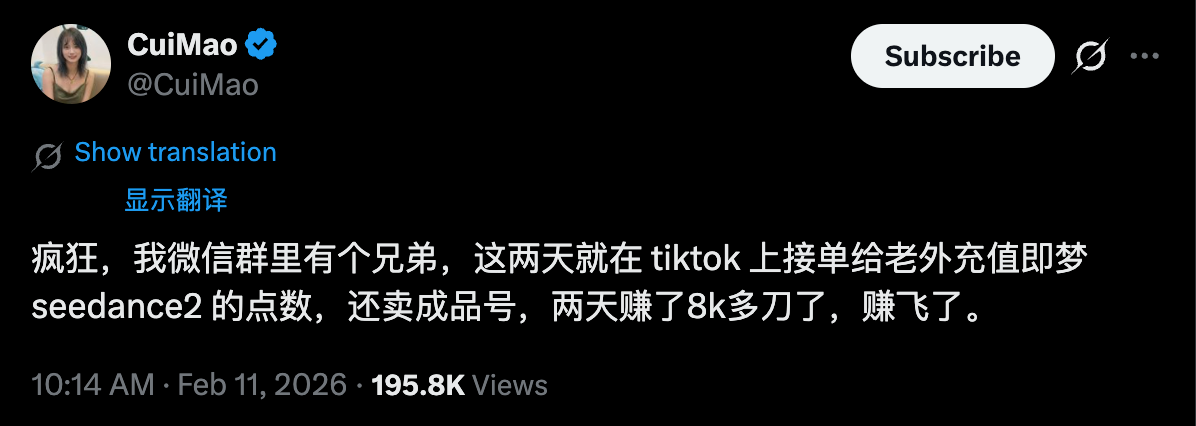

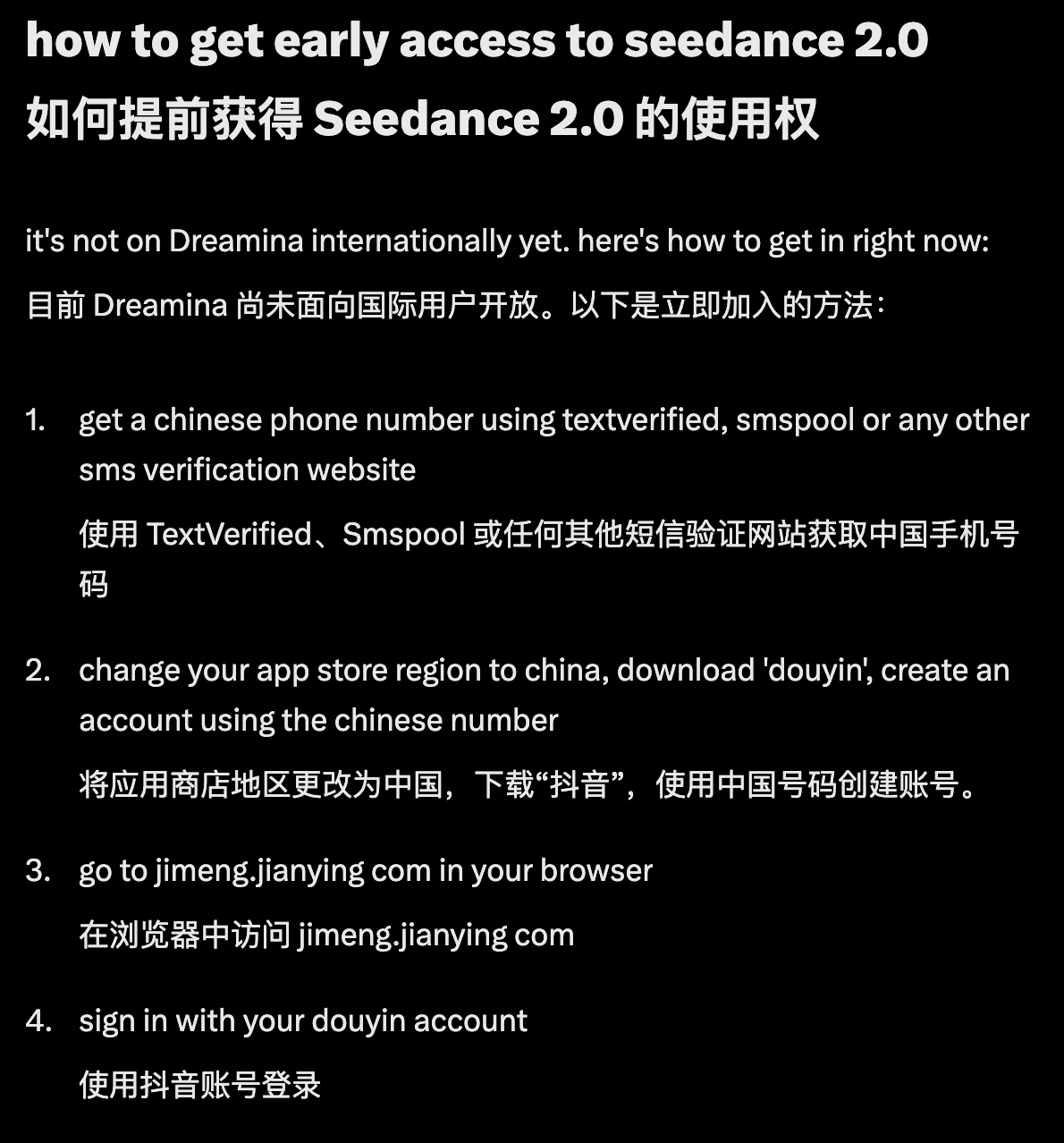

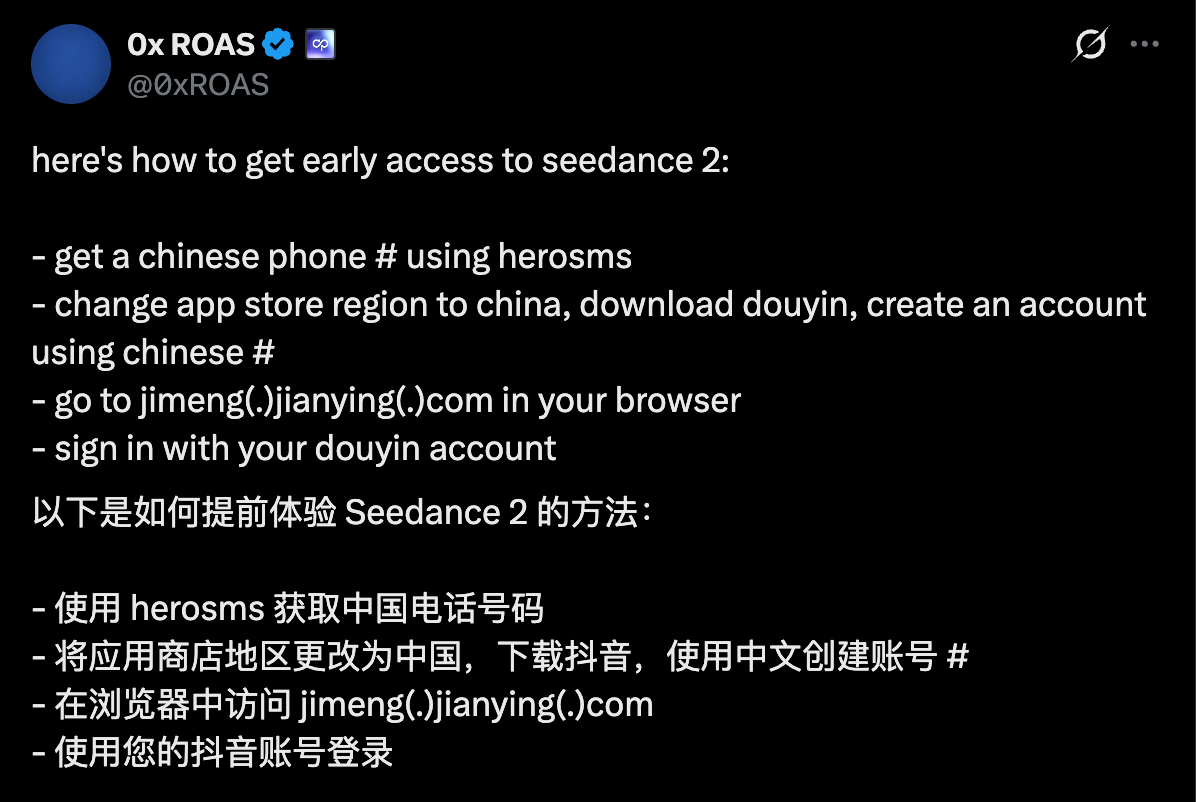

Além do fenômeno incomum de internautas estrangeiros buscando números +86 para se cadastrar no JiMeng, um grande número de internautas também está criando tópicos em busca de guias, e nas seções de comentários desses vídeos de inteligência artificial, todos pedem tutoriais. Ainda mais extremo, alguns afirmam ter ganho mais de US$ 8.000 em apenas dois dias revendendo pontos do JiMeng.

▲Muitos internautas estrangeiros estão publicando pedidos por um código de teste, tentando todas as formas possíveis de acessar o jogo.

Que tipo de vídeos de IA o Seedance 2.0 pode realmente produzir?

O primeiro episódio de "Replicando sem esforço as técnicas de segmentação da vida" apresenta movimentos de câmera complexos, desde a saída do elevador até o corredor; inclui também um blockbuster caseiro com ação visceral de artes marciais; diversos comerciais de TV e vídeos promocionais exibem efeitos de vidro líquido; o programa consegue até mesmo fazer stand-up comedy e esquetes, e desta vez, o diretor do Festival da Primavera está no comando…

▲Gerado pelo modelo de geração de vídeo Seedance 2.0, desenvolvido pela ByteDance. Fonte: X@qhgy / Douyin@虚妄

Desde a simples consistência de vídeo até movimentos de câmera complexos e desafiadores, além de poderosas funções de modelos criativos, som mais preciso e realista e música que combina com o conteúdo do vídeo, o Seedance 2.0 resolveu quase todos os problemas que os vídeos com IA poderiam enfrentar.

A APPSO também testou o modelo mais recente do Seedance 2.0 em um sonho, e podemos afirmar que as reações dos internautas foram genuínas. De fato, houve pedidos por boas dicas e sorteios de cartas, mas todos os vídeos gerados pela IA eram extremamente realistas.

▲ Site oficial da Jimeng AI: https://jimeng.jianying.com/ai-tool/generate

Atualmente, no site oficial da Jimeng, após fazer login, você pode selecionar a geração de vídeo para usar o modelo de geração de vídeo desenvolvido pela ByteDance, o Seedance 2.0.

Desta vez, estamos realmente dirigindo a IA para fazer um filme.

Após selecionar o modelo Seedance 2.0 e usar o modo de referência tudo-em-um, só de olhar para os arquivos que podem ser importados, você percebe que essa atualização não é simples.

O modelo de geração de vídeo da ByteDance, Seedance 2.0, rompe completamente com as limitações de entrada da maioria dos modelos. Os métodos anteriores, como texto + primeiro quadro ou primeiro e último quadros, agora estão obsoletos. O Seedance 2.0 reconstruiu a lógica de criação do zero, suportando a combinação livre de quatro modalidades: imagem, vídeo, áudio e texto.

Uma única imagem pode definir o estilo artístico de uma cena ou servir como quadro-chave para um vídeo; um vídeo curto pode reproduzir diretamente os movimentos de um personagem e vários ângulos de câmera complexos; alguns segundos de áudio podem definir o ritmo e a atmosfera; e, por fim, uma palavra-chave pode conectar toda a nossa imaginação.

▲O modelo de geração de vídeo desenvolvido pela ByteDance, Seedance 2.0, suporta até 12 arquivos, até 9 imagens e até 3 arquivos de vídeo e áudio, com a duração total do vídeo/áudio não excedendo 15 segundos; a duração da geração pode ser selecionada de 4 a 15 segundos, com diferentes durações consumindo diferentes pontos.

O uso também é muito simples. O Seedance 2.0 atualmente suporta as opções "Primeiro e Último Quadro" e "Referência Completa", mas os modos de referência inteligente de múltiplos quadros e de assunto ainda não são suportados. Geralmente, basta selecionar "Referência Completa" e o modelo "Seedance 2.0" e, em seguida, carregar todos os materiais. O site oficial sugere colocar os materiais que têm maior impacto no vídeo final no início.

▲ Você também pode clicar no botão @ abaixo da caixa de entrada para selecionar arquivos de origem diferentes.

Em seguida, na caixa de entrada de prompt, use o símbolo @ para chamar diretamente o material correspondente, encadeando-o em um prompt coerente e, então, aguarde que ele "crie o sonho". Não precisamos mais quebrar a cabeça pensando em "como descrever esta ação/atmosfera/movimento de câmera/trilha sonora/…", basta usar o @ e apontá-lo para o modelo.

Se a entrada multimodal resolve o problema de "como dizer", então as capacidades de referenciamento internas do modelo resolvem o problema de "o que dizer". Com poderosas capacidades de referenciamento de vídeo profundo, também geramos vídeos de IA que outros modelos não conseguem produzir.

Um contra dez, todas as dezoito habilidades de artes marciais copiadas diretamente.

Antes, se quiséssemos que a IA imitasse uma cena famosa de um filme, tínhamos que escrever termos técnicos como "plano panorâmico" e "troca rápida" nos comandos. Quando se tratava de movimentos específicos de artes marciais, tínhamos que nos tornar instrutores de artes marciais, descrevendo claramente como executar cada movimento nos comandos, e mesmo assim, o resultado nem sempre era correto.

Agora você pode fazer o upload direto de conteúdo de referência, e a IA não só entende o estilo geral da cena e captura os detalhes dos personagens, como também reconhece a linguagem da câmera, o ritmo dos movimentos e até mesmo efeitos especiais criativos, replicando-os com precisão.

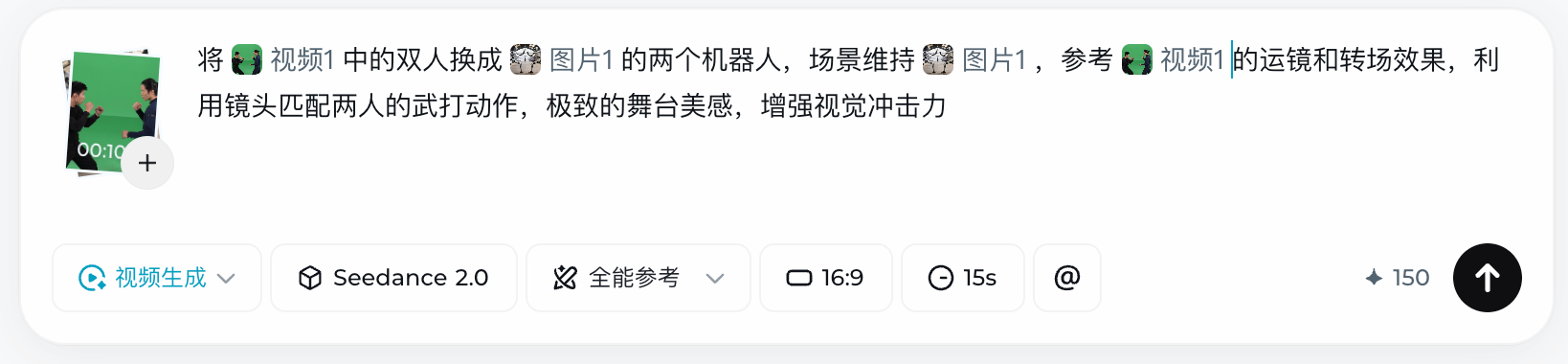

▲Substitua as duas pessoas no @Vídeo 1 pelos dois robôs na @Imagem 1, mantendo a cena igual à da @Imagem 1. Usando como referência os movimentos de câmera e as transições do @Vídeo 1, utilize ângulos de câmera que correspondam aos movimentos de artes marciais das duas pessoas para obter a melhor estética de palco e um impacto visual aprimorado.

Aqui, usamos uma cena de luta de 10 segundos do manual do usuário do Seedance 2.0 e, em seguida, instruímos o modelo a copiar os movimentos dos dois personagens do vídeo para os dois robôs que carregamos.

O resultado final reproduziu perfeitamente os movimentos do vídeo, permitindo que a Unisoc e a Boston Dynamics travassem um confronto emocionante. Isso não é menos impressionante do que a performance do robô no evento Weibo Night, há algum tempo.

▲Vídeos e imagens enviados, e os prompts utilizados

Os movimentos finais da IA corrigiram completamente os problemas do modelo anterior, onde andar parecia flutuar e lutar parecia um macarrão mole. O Seedance 2.0 atual é um modelo que entende física, gravidade e inércia, com transições de movimento mais suaves e naturais, e não tem mais aquela estranha "sensação de IA".

As cenas mais difíceis no set agora podem ser facilmente capturadas com o upload de uma imagem de referência.

Além de reproduzir fielmente os detalhes e movimentos dos personagens, o Seedance 2.0 também é mais do que capaz de replicar movimentos de câmera. Trabalhos de câmera cinematográficos e efeitos especiais criativos, antes difíceis de executar, agora podem ser replicados com precisão simplesmente carregando um vídeo de referência.

▲Consulte o movimento de câmera do @Vídeo 1; este vídeo foi replicado usando a @Imagem 1.

Carregamos um vídeo de um carro de corrida de Fórmula 1 da Apple e uma foto de um Xiaomi SU7 Ultra. O Seedance 2.0 entendeu perfeitamente minha intenção, transformando a imagem em uma tomada aérea, como a abertura de uma corrida de Fórmula 1, e depois focando no SU7 Ultra em um plano sequência, tudo em uma única tomada contínua. Chamar isso de sucesso de bilheteria não seria exagero.

Essa capacidade de criar tomadas contínuas e perfeitas é particularmente adequada para produzir vídeos de dança de alta qualidade . Encontramos um vídeo de dança de 15 segundos no manual do usuário e carregamos uma bela selfie. Com apenas uma geração, sem nenhum recurso especial, conseguimos um vídeo de dança solo com música perfeitamente sincronizada e movimento de câmera natural.

▲ Substitua a garota do @Vídeo 1 pela garota da @Imagem 1 vestida com traje mongol. A cena se passa em um belo palco. Utilizando como referência os movimentos de câmera e os efeitos de transição do @Vídeo 1, ajuste a câmera para acompanhar os movimentos da personagem, a fim de alcançar a estética ideal do palco e intensificar o impacto visual.

Quando o modelo de vídeo Veo 3 do Google se popularizou no ano passado, a narrativa em primeira pessoa era uma grande tendência. Agora, com o Seedance 2.0, existem inúmeras funcionalidades populares. Esse tipo de vídeo, que combina perspectiva de jogo, visuais e consistência de personagem, é como dar vida a Sun Wukong, de Black Myth.

▲A vista traseira do personagem é mostrada na @Imagem 1, a vista frontal na @Imagem 2 e os detalhes faciais na @Imagem 3. O personagem entra no jogo "Black Myth: Wukong" e luta contra Erlang Shen Yang Jian. A cena, as ações, os efeitos especiais, a música e os efeitos sonoros podem ser vistos no @Vídeo 1.

O mais interessante é que também usamos referências de áudio . Podemos enviar um vídeo e o Seedance 2.0 controlará a geração dos visuais com base no ritmo e na atmosfera da música do vídeo. As acentuações dos hits correspondem aos cortes de câmera, e o crescendo das cordas corresponde à aceleração da ação.

Esta é também a primeira vez que o som foi incorporado a um modelo de geração de vídeo, transformando-se de uma música de fundo separada na pós-produção em uma parte importante da narrativa em vídeo com IA.

É algo para se aguardar com expectativa; uma cena dramática de regresso a casa para o Ano Novo Chinês pode desenrolar-se num instante.

O maior valor da capacidade de análise reside na resolução de problemas criativos práticos, e a melhoria significativa dessa capacidade é atribuída ao aprimoramento da habilidade básica de modelagem .

Tentamos fornecer ao Seedance 2.0 uma imagem do primeiro quadro e alguns comandos comumente usados em outros modelos de geração de vídeo, e o resultado foi o esperado.

▲A câmera segue as costas do jovem na Imagem 1. O cenário é uma estrada rural tarde da noite na véspera de Ano Novo, com postes de luz fracos e apenas o som do vento e o "estrondo" das rodas da mala lutando para atravessar a neve. Ele estava muito cansado da caminhada, então parou para esfregar as mãos congeladas e exalou uma baforada de ar branco (close-up). Seus olhos revelavam o cansaço de "finalmente ter chegado" e um toque de apreensão por voltar para casa.

Ele virou a esquina, e a câmera o seguiu. Ao longe, surgiu um grande portão de ferro adornado com dísticos vermelhos, com uma luz dourada brilhando através de suas frestas. Nesse instante, fogos de artifício esporádicos começaram a soar à distância. Ele acelerou o passo e empurrou o pesado portão de ferro.

No instante em que ele empurrou a porta, a câmera fez um movimento panorâmico por cima do seu ombro para o pátio. O pátio estava cheio de lanternas vermelhas. Um cachorro vira-lata correu animadamente para a frente, e então a cortina da cozinha foi levantada, revelando sua mãe carregando uma cesta fumegante de comida; o vapor instantaneamente desfocou as bordas da lente. Seu pai, pendurando lanternas, se virou e o viu, parando por um momento; de pé na escada, fingiu compostura: "Ei? Por que você só está chegando agora? Não combinamos de chegar às cinco horas?" Sua mãe largou a cesta e correu até ele, tirando a neve de seus ombros: "Velho, você fala demais! — Não está com frio? Entre, tem joelho de porco fresquinho!"

A câmera deixou de seguir suas costas e passou a circulá-lo pela frente, capturando sua expressão. Seu rosto, que estava congelado no tempo, foi iluminado pelo calor e pela luz do pátio, e lágrimas brotaram em seus olhos, mas ele sorriu.

Com exceção da cena inicial em que a mala e a bolsa são colocadas no chão, que foi completamente ignorada, todo o processo foi filmado em um único plano-sequência, e as expressões faciais e os movimentos dos personagens também foram bem controlados. Simplesmente carregamos uma captura de tela de um vídeo em modo retrato e instruímos o Seedance 2.0 a usar a visão traseira, e ele conseguiu gerar diretamente um curta-metragem com boa aparência sobre o retorno para casa no Ano Novo Chinês.

Mesmo sem grandes blocos de instruções, as capacidades de criatividade e conclusão de histórias do Seedance 2.0 foram ainda mais aprimoradas . Simplesmente carregamos uma imagem estilizada de La La Land e inserimos a instrução: "Crie um videoclipe musical alegre baseado na @imagem 1".

O Seedance 2.0 parece aumentar ativamente a intensidade. A complexidade deste vídeo de dança é semelhante à que vi na competição de patinação artística em pares nos Jogos Olímpicos de Inverno. Meus comandos não incluíam vídeos de referência nem instruções específicas de movimento; o modelo simplesmente se baseou em suas próprias capacidades criativas para gerar um vídeo maravilhoso de música e dança.

Alguns internautas também usaram sua criatividade para criar um vídeo curto de 38 segundos usando personagens da segunda temporada de League of Legends: Battle of the Twin Cities.

▲Gerado pelo modelo de geração de vídeo Seedance 2.0, desenvolvido pela ByteDance, fonte: X@NACHOS2D_

O momento do mito negro no vídeo de IA

O sucesso fenomenal do modelo de geração de vídeos da ByteDance, o Seedance 2.0, me fez sentir como se estivesse de volta ao Festival da Primavera, quando Sora foi lançado. Só que desta vez, o modelo de vídeo que está em destaque vem da China.

Após a experiência, Feng Ji, produtor de Black Myth, declarou em alto e bom som: "A era dos vídeos da AIGC chegou oficialmente ao fim". Ao ler a análise anterior, percebe-se que essa avaliação é, de fato, bastante objetiva.

De certa forma, o Seedance 2.0 pode ser considerado o momento "Black Myth" para vídeos com IA . Assim como "Black Myth: Wukong" provou que a China podia produzir jogos AAA, o Seedance 2.0 agora conquistou reconhecimento global no campo dos vídeos com IA.

Se o Sora 2 do ano passado foi o momento "pouso na Lua" no campo do vídeo com IA, o Seedance 2.0 de hoje é como trazer uma nave espacial à sua porta e entregar as chaves, facilitando o acesso à ferramenta "mais poderosa da Terra" disponível no mercado.

O Seedance 2.0 não criou um mito; simplesmente representou uma evolução sólida. Reduziu as barreiras de entrada para a criação de vídeos, ao mesmo tempo que aumentou o nível de controle. Neste momento, não devemos ser excessivamente otimistas em relação ao futuro distante, mas sim usar isso como ponto de partida para refletir sobre como aproveitar essas ferramentas cada vez mais sofisticadas para contar histórias melhores.

A versatilidade e a facilidade de uso do Seedance 2.0 são seus recursos mais valiosos.

Essa talvez seja a melhor interpretação de "Kill the game" — não acabou com o jogo, mas sim deu início a um novo jogo muito maior. Quando a tecnologia deixar de ser o gargalo, a verdadeira competição retornará à sua essência: aqueles que souberem contar boas histórias e tiverem uma estética única obterão uma vantagem sem precedentes.

▲Um relatório da McKinsey que explora o impacto da IA no cinema e na televisão menciona que o conteúdo gerado por IA poderá redistribuir o mercado do ecossistema de conteúdo, avaliado em US$ 60 bilhões, em cinco anos | Link: https://www.mckinsey.com/industries/technology-media-and-telecommunications/our-insights/what-ai-could-mean-for-film-and-tv-production-and-the-industrys-future#/

Pequenos estúdios e criadores independentes têm cada vez mais oportunidades de produzir conteúdo de alta qualidade, e o valor de mercado de US$ 60 bilhões da indústria de conteúdo com IA será redistribuído. As fronteiras entre o profissional e o amador estão se tornando cada vez mais tênues, e começamos a nos perguntar "o que devemos fazer" em vez de "o que a IA pode fazer".

O excelente desempenho de Seedance desta vez demonstrou que possui efeitos de áudio e vídeo superiores aos de Sora 2. Seja na representação das leis da física do mundo real ou nas emoções sutis e movimentos complexos dos personagens, Seedance 2.0 pode ser considerado o melhor modelo disponível atualmente.

Mas, quando os vídeos de IA se tornam tão realistas, o Seedance parece incapaz de evitar os mesmos problemas que o Sora enfrentou. A realidade é que o teste beta do Seedance 2.0 é incrivelmente popular, com muitos criadores estrangeiros reclamando da escassez de códigos de acesso. No entanto, como os efeitos gerados são tão realistas, isso já provocou uma discussão ética considerável sobre a "falsificação de vídeos por IA".

A evolução da IA este ano tem sido desconcertante, e a popularidade do Seedance 2.0 certamente superou em muito as expectativas de Jimeng. Jimeng respondeu prontamente a essas controvérsias.

No dia em que a notícia viralizou online, em 9 de setembro, a equipe de operações da Jimeng divulgou um comunicado oficial à comunidade de criadores, anunciando uma restrição temporária ao uso de dados faciais de pessoas reais e à geração de vídeos . Atualmente, alguns dos casos com pessoas reais que circulam online foram gerados durante a fase inicial de testes beta.

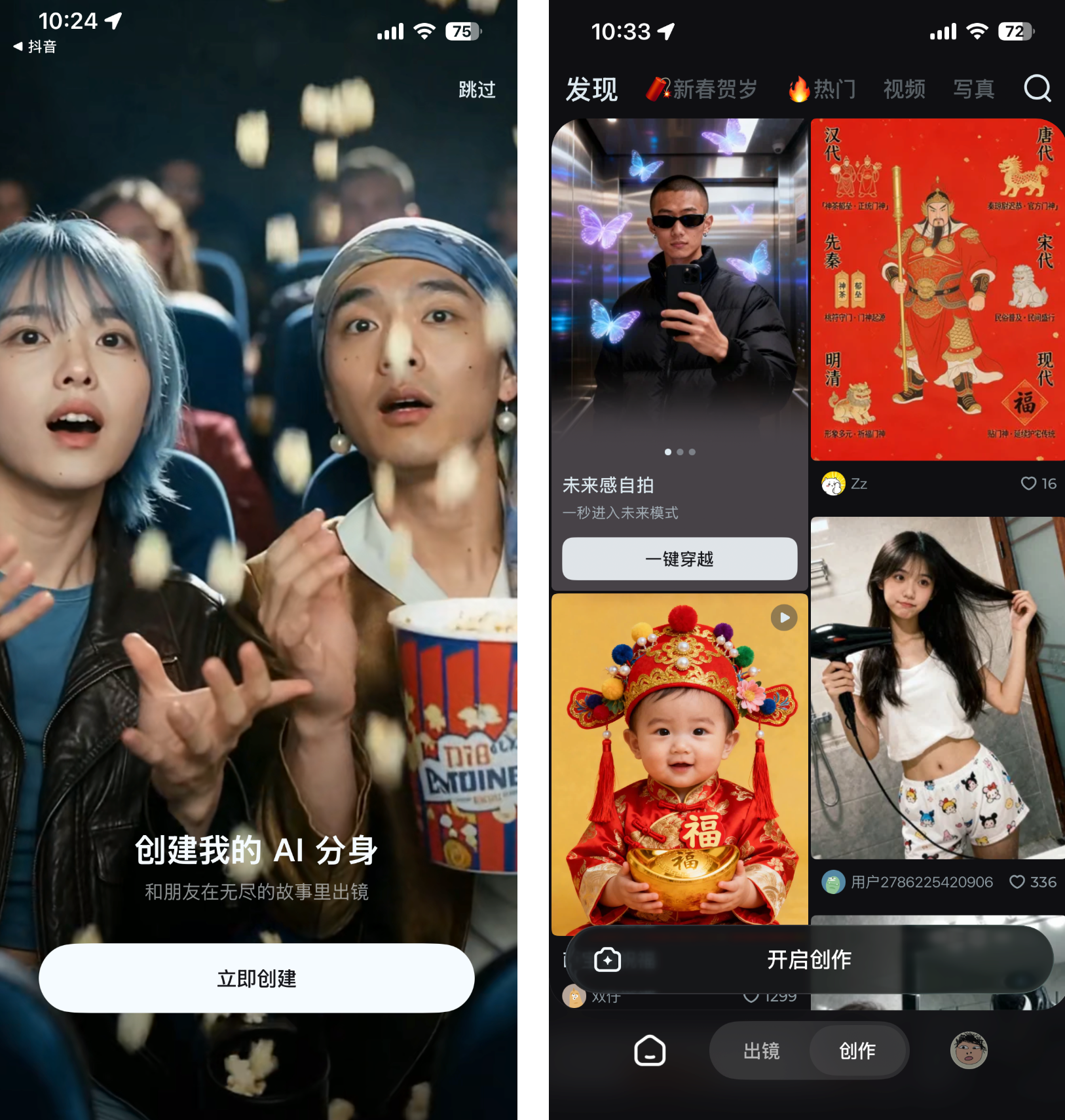

▲A função "Aparência" do aplicativo JiMeng AI permite que os usuários criem vídeos com atores reais após criarem um avatar de IA.

No entanto, se uma pessoa real quiser aparecer na câmera, pode usar a função "Aparecer na Câmera" dentro do aplicativo Jimeng AI para concluir o processo de verificação de pessoa real e, em seguida, experimentar o vídeo gerado por IA com a pessoa real.

Quanto mais poderosa for uma ferramenta, mais claros precisam ser seus limites de uso. Mas, por enquanto, antes de encontrarmos a resposta perfeita, podemos primeiro descobrir o que queremos fazer com essa ferramenta: registrar a vida, expressar criatividade ou contar histórias?

Se Edward Yang disse em "Yi Yi" que "a invenção do cinema triplicou nossas vidas", então a invenção de filmes gerados por IA é mais como o início de uma reconstrução da vida. Não nos contentamos mais com a mera extensão; todos podem se tornar roteiristas de suas próprias histórias, explorando um outro tipo de vida em narrativas infinitas.

O Seedance 2.0 está começando a tornar tudo isso cada vez mais próximo, e estamos apenas no início de 2026.

*A versão em vídeo deste artigo pode ser visualizada através do link do artigo no WeChat .

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.