O modelo de código aberto mais poderoso mudou de mãos? A Kimi lança o k2.5, usando clusters de agentes para resolver a geração de textos longos e elementos visuais.

Acaba de ser lançado o Dark Side of the Moon, que disponibilizou oficialmente o código aberto do Kimi k2.5.

A primeira frase do relatório técnico oficial é direta: "o modelo de código aberto mais poderoso até o momento".

Diferentemente de seu antecessor, o Kimi k2.5 não é simplesmente uma "versão atualizada", mas sim um modelo multimodal nativo pré-treinado com 1,5 trilhão de tokens híbridos visuais e textuais. Com base nisso, a equipe do Kimi construiu um sistema chamado Inteligência Visual Agenética.

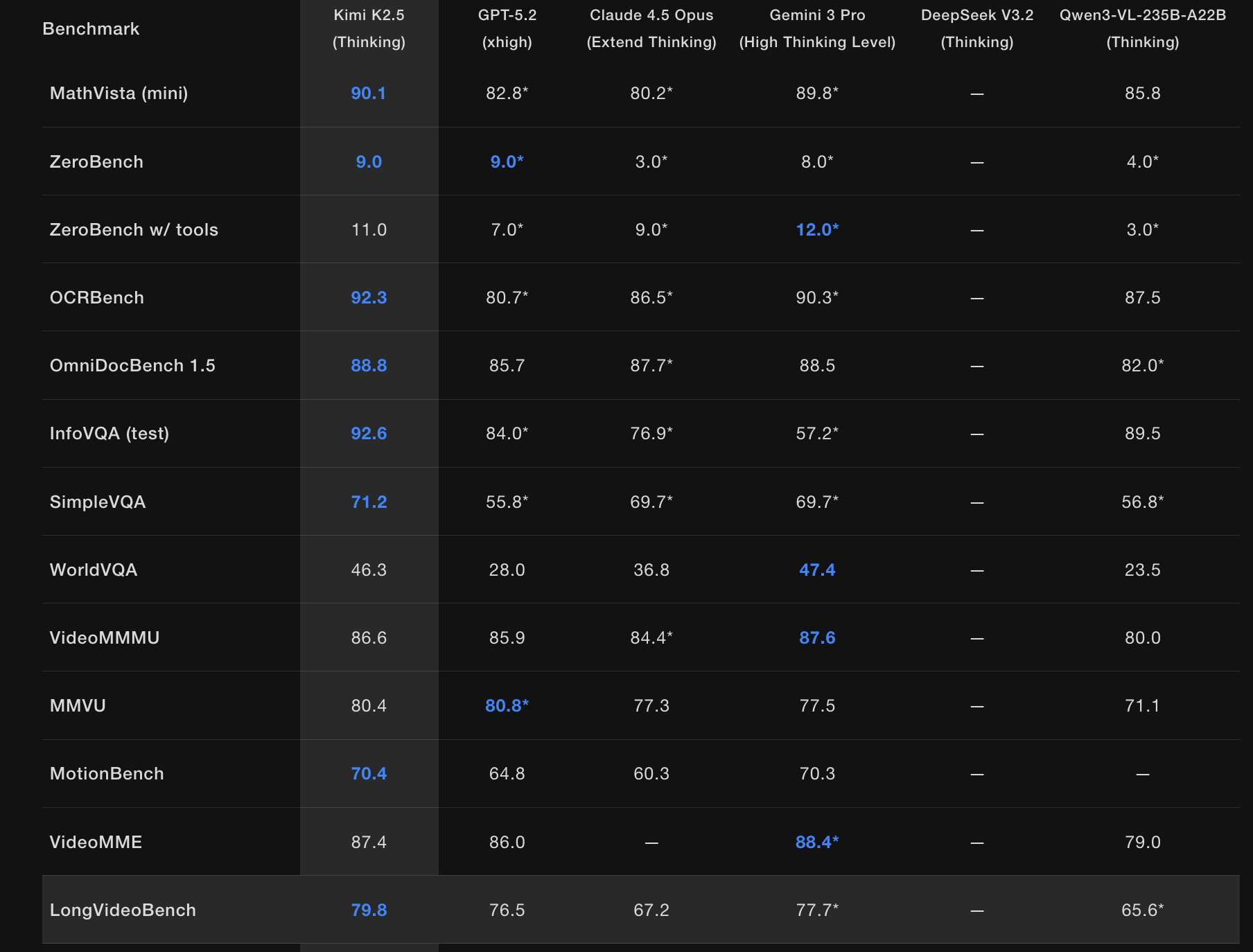

Isso significa que o Kimi k2.5, que já era extremamente poderoso no processamento de textos longos, evoluiu mais uma vez para um super-gerente com "olhos" capazes de compreender telas complexas e "mãos" capazes de comandar um grande conjunto de agentes inteligentes. Em testes de benchmark rigorosos, como o SWE-Bench Verified (programação) e o HLE (Human's Last Test), ele não apenas superou o DeepSeek V3, como também obteve resultados superiores aos algoritmos proprietários GPT e Gemini em diversas métricas.

Isso significa que o Kimi k2.5, que já era extremamente poderoso no processamento de textos longos, evoluiu mais uma vez para um super-gerente com "olhos" capazes de compreender telas complexas e "mãos" capazes de comandar um grande conjunto de agentes inteligentes. Em testes de benchmark rigorosos, como o SWE-Bench Verified (programação) e o HLE (Human's Last Test), ele não apenas superou o DeepSeek V3, como também obteve resultados superiores aos algoritmos proprietários GPT e Gemini em diversas métricas.

Da "combate individual" ao "pensamento coletivo"

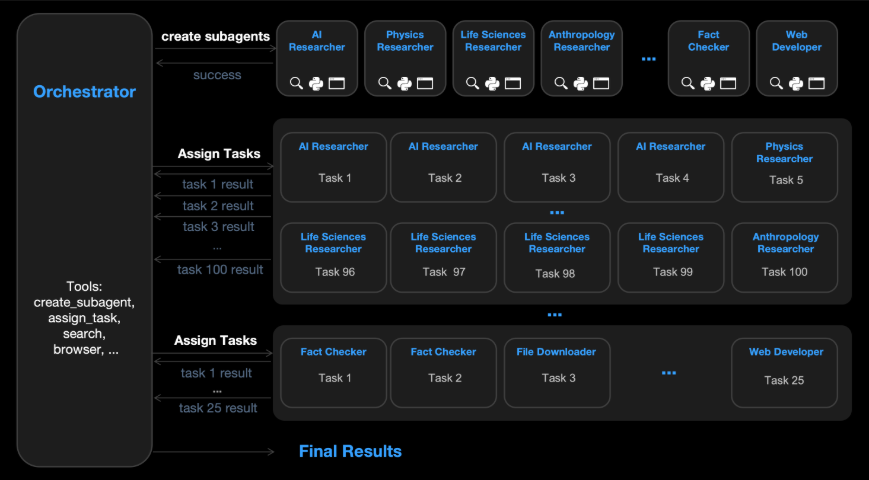

Nesta atualização, o Agent Cluster é indiscutivelmente a inovação mais disruptiva do Kimi k2.5.

Nos últimos anos, por mais poderoso que seja o modelo, ao se deparar com tarefas extremamente longas e complexas (como "ajude-me a pesquisar as estratégias de preços de 100 concorrentes"), elas geralmente só podem ser processadas sequencialmente: verificar a primeira, depois verificar a segunda… Se ocorrer um erro no meio do processo, toda a cadeia de tarefas fica sujeita a falhas.

O Kimi k2.5 introduz uma arquitetura de Enxame de Agentes totalmente nova, cujo conceito central é Escalabilidade Horizontal, Não Apenas Vertical – não apenas para crescer em tamanho, mas para fazer mais. No modo Enxame, o Kimi k2.5 atua automaticamente como comandante. Ao receber uma tarefa complexa, ele não trabalha sozinho, mas cria e direciona instantaneamente e dinamicamente até 100 agentes como supervisores.

Esses agentes inteligentes podem ser "buscadores de IA", "físicos de IA", "verificadores de fatos de IA" e assim por diante. Eles trabalham em paralelo sob o comando de um comandante. A documentação técnica mostra que o Kimi k2.5 suporta até 1500 chamadas de ferramentas em paralelo.

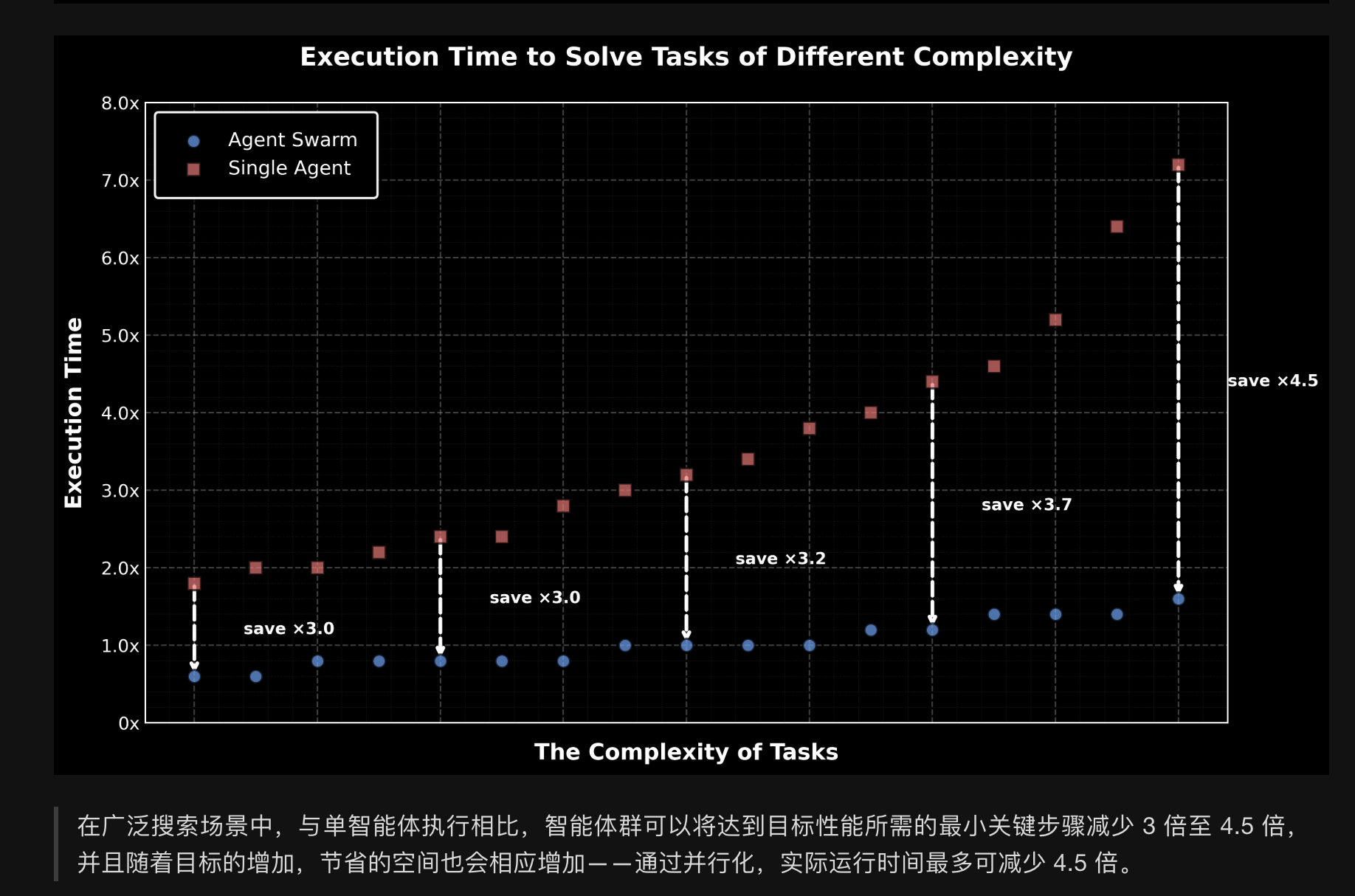

Os resultados são imediatos. Na demonstração oficial da tarefa "encontrar os principais blogueiros do YouTube em 100 nichos de mercado", os humanos precisariam de vários dias, a IA tradicional independente precisaria de várias horas, enquanto o Kimi Agent Swarm precisaria de apenas alguns minutos.

Os dados mostram que, em comparação com o modelo tradicional, a arquitetura Swarm reduz o tempo de execução de tarefas de ponta a ponta em 80% e melhora a eficiência geral em 4,5 vezes.

Para lidar com essa incrível concorrência, a equipe de Kimi empregou um método de treinamento chamado PARL (Aprendizado por Reforço de Agentes Paralelos). Isso permitiu que o modelo dividisse tarefas, distribuísse tarefas e processasse feedback paralelo de forma autônoma, sem um fluxo de trabalho predefinido. Mesmo que um subagente falhe (colapso serial), o comandante pode detectar e reagendar rapidamente.

O VLM está desatualizado; isso é para "engenheiros de visão".

Se Swarm é o "cérebro" de Kimi, então a Codificação Visual são os seus "olhos" em constante evolução.

O modelo K2.5 suporta a geração de interfaces front-end completas a partir de diálogos simples em linguagem natural e consegue lidar eficazmente com layouts interativos e efeitos dinâmicos, como gatilhos de rolagem. Antes do Kimi K2.5, a maioria dos VLMs (Modelos de Linguagem Visual) disponíveis no mercado ainda se encontrava no estágio "baseado em imagens" — você fornecia uma captura de tela de uma página da web e o modelo informava "há um botão vermelho aqui". Mas, se você solicitasse que o modelo escrevesse um código para replicar essa página, ele geralmente só conseguia produzir um esqueleto HTML rígido e não compreendia a lógica de interação.

O Kimi k2.5 apresenta uma vantagem significativa em relação aos VLMs tradicionais. O exemplo abaixo demonstra o processo de reconstrução de um site a partir de um vídeo; o lado esquerdo mostra o vídeo original e o lado direito mostra o site reconstruído pelo Kimi.

Basta gravar um vídeo da operação de uma página da web e enviá-lo para o Kimi k2.5. Ele não só entende layouts de interface estáticos, como também a lógica de interação dinâmica — como efeitos acionados pela rolagem e animações complexas de virada de cartas. Em seguida, ele gera diretamente um código utilizável contendo toda a lógica CSS e JS.

Ainda mais impressionante é sua capacidade de depuração visual. Após escrever o código, o Kimi k2.5 "dará uma olhada" na página renderizada. Se detectar que "o botão está torto" ou que "a cor é inconsistente com o vídeo original", ele modificará o código com base no feedback visual, assim como um engenheiro humano, em vez de recriá-lo às cegas.

Essa capacidade de circuito fechado de "observação-codificação-verificação-correção" faz do Kimi k2.5 o novo rei indiscutível do mundo do código aberto, lidando com código e visão com igual facilidade.

No teste SWE-Bench Verified, considerado uma referência, o Kimi k2.5 alcançou a alta pontuação de 76,8, um resultado que não só supera o GPT 5.2, como também excede o DeepSeek V3.2, outro benchmark de código aberto de alto nível.

Enquanto todos tentam ampliar cada vez mais um único modelo, Kimi mostrou outra possibilidade: compreender o mundo através da percepção visual extrema e transformá-lo por meio de um enorme conjunto de agentes inteligentes.

Atualmente, o Kimi k2.5 é de código aberto no Hugging Face, e o modo Agent Swarm também está disponível em Kimi.com. Tanto para usuários quanto para desenvolvedores, este pode ser o modelo de código aberto mais interessante para experimentar em 2026.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.