O Burger King está equipando seus funcionários com headsets de inteligência artificial: cada “obrigado” dito por você está sendo avaliado pela IA.

O Burger King acaba de lançar um hardware de IA de nível empresarial: a rede de fast-food está começando a experimentar a instalação de IA nos fones de ouvido de seus funcionários.

Seu nome é Patty, desenvolvida pela OpenAI, e é a assistente de voz da plataforma BK Assistant do Burger King. Os funcionários podem perguntar a ela a qualquer momento: "Quantas fatias de bacon devo colocar no meu Whopper Grelhado com Maple Bourbon?" ou "Como limpo a máquina de milkshake?". Ela pode responder a todas essas perguntas. Quando algum equipamento apresenta defeito ou algum ingrediente está em falta, o sistema sincroniza automaticamente todos os canais — máquinas de autoatendimento, drive-thru e cardápios eletrônicos — em até 15 minutos, atualizando tudo sem qualquer intervenção humana.

Este sistema integra múltiplas fontes de dados, incluindo diálogos do drive-thru, equipamentos de cozinha e estoque, formando uma plataforma completa para a operação da loja. Em entrevista ao The Verge, o Diretor Digital do Burger King, Thibault Rooks, definiu o Patty como uma ferramenta de "auxílio à gestão".

Até o momento, é uma ferramenta bastante eficiente para a cozinha. Aliás, considerando os problemas crônicos do setor de fast-food, como alta rotatividade de funcionários e ciclos de treinamento curtos, permitir que novos funcionários acessem facilmente os padrões operacionais e ter o sistema gerenciando automaticamente as informações de falta de estoque realmente resolve esses problemas.

Mas Patty tem outra funcionalidade: ela ouve as conversas entre funcionários e clientes.

Especificamente, o Burger King coletou informações de franqueados e clientes sobre "como medir a cordialidade do atendimento", usando esses dados para treinar uma IA a reconhecer certas palavras e frases — "Bem-vindo ao Burger King", "Por favor", "Obrigado". O sistema então avalia a "cordialidade do atendimento" de cada loja com base nessas informações. Os gerentes podem verificar o desempenho da cordialidade de suas lojas com a IA a qualquer momento. Rooks acrescentou que estão aprimorando o sistema para captar melhor "o tom da conversa".

Em outras palavras, o fato de você sorrir para os clientes e se seu tom de voz for suficientemente entusiasmado agora é determinado por um algoritmo.

A Patty já está sendo testada em 500 lojas e planeja abranger todos os restaurantes nos EUA até o final de 2026. Enquanto isso, o McDonald's cancelou recentemente seu projeto de pedidos por IA com a IBM, e a IA de voz do Taco Bell apresentou repetidas falhas nos drive-thrus, tornando-se alvo de piadas de clientes nas redes sociais. O Burger King escolheu um caminho diferente: em vez de usar IA para lidar com clientes, usa IA para lidar com funcionários.

Essa é uma escolha inteligente. Se a IA falhar ao lidar com clientes, torna-se um desastre de relações públicas; mas quais seriam as consequências graves se a IA falhasse ao lidar com funcionários?

Quando a gestão se torna monitoramento

O Burger King não é a primeira empresa a seguir esse caminho, nem é o mais radical.

O exemplo mais famoso é a Amazon. Seu sistema de armazém, o ADAPT (Associate Development and Performance Tracker), monitora a velocidade de escaneamento de cada operador de picking até o segundo. Os intervalos entre os funcionários pegarem o scanner para escanear os pacotes são registrados — se o scanner permanecer ocioso por mais de um determinado período, o sistema o registra automaticamente como "tempo improdutivo".

Funcionários que não atingirem as metas receberão avisos automáticos do sistema. Após acumular seis avisos, o sistema demitirá o funcionário automaticamente, sem a intervenção de um gerente humano . A Amazon afirma que os supervisores humanos podem anular essas decisões, mas trata-se de um sistema "corretivo", e não de um sistema "pré-julgamento".

No início de 2024, a agência francesa de proteção de dados CNIL multou a Amazon França em € 32 milhões por "intrusão excessiva" em seu sistema de monitoramento. A CNIL destacou especificamente que a prática de medir com precisão o tempo ocioso dos leitores de código de barras dos funcionários significava que eles tinham que justificar cada pausa, mesmo que de apenas alguns minutos — ir ao banheiro, beber água ou alongar-se —, tudo se tornava uma "anormalidade" que precisava ser registrada e analisada pelo sistema .

"Você se sente como se estivesse na prisão", disse uma sindicalista em um centro de distribuição da Amazon em uma audiência do Departamento do Trabalho dos EUA. Ela afirmou que a Amazon aplica regularmente medidas disciplinares com base em dados coletados por suas ferramentas eletrônicas de rastreamento e que essa vigilância gera "medo e ansiedade, o que, por sua vez, cria um ambiente de trabalho perigoso".

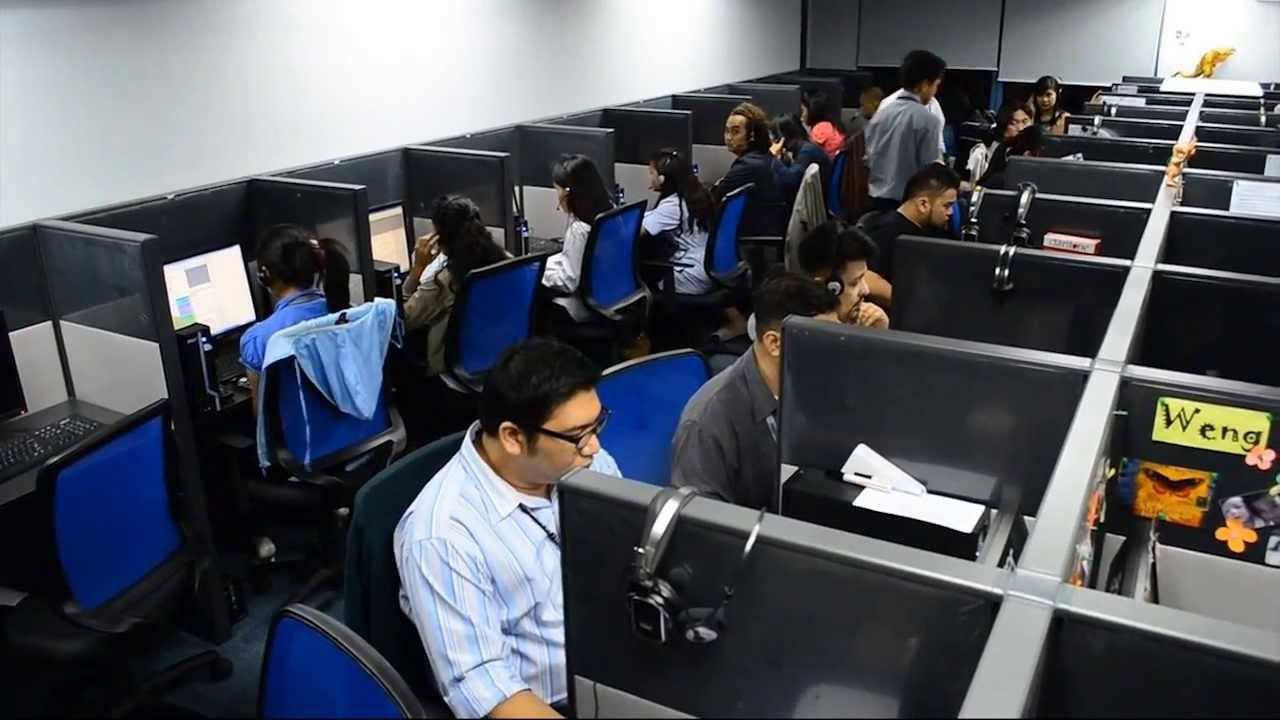

O setor de atendimento ao cliente adota uma abordagem tecnológica diferente, mas a lógica é a mesma. Cada vez mais call centers estão implementando sistemas de detecção de emoções por IA que analisam o tom de voz, a velocidade da fala e os padrões de pausa em tempo real para determinar o estado emocional e a "empatia" dos atendentes. Os fornecedores de tecnologia afirmam que esses sistemas podem detectar frustração de 30 a 60 segundos antes de um cliente desligar, com uma taxa de precisão superior a 85%.

Mas o que realmente aconteceu na prática foi que os agentes rapidamente aprenderam a "alimentar" o algoritmo com modelos de roteiro fixos e padrões de tom — quando fazer uma pausa, quais palavras-chave usar para expressar empatia e em que ritmo dizer "Eu entendo como você se sente". Um funcionário de um call center disse em uma investigação do GAO: "A pressão de vendas e os vários métodos de monitoramento criaram um estresse enorme".

Os funcionários não estão prestando um serviço melhor; estão produzindo dados melhores. De acordo com a Gartner, a proporção de grandes empresas que monitoram seus funcionários dobrou desde o início da pandemia. Alguns softwares registram as teclas digitadas, fazem capturas de tela regularmente, gravam chamadas e reuniões e podem até acessar as webcams dos funcionários. Um estudo da Harvard Business Review comparando profissionais americanos monitorados e não monitorados descobriu que os funcionários monitorados eram mais propensos a fazer pausas não autorizadas, a se esquivar deliberadamente do trabalho, a danificar a propriedade da empresa ou até mesmo a roubar — o monitoramento não reduziu o comportamento problemático; pelo contrário, o aumentou.

Todos os casos começam no mesmo ponto: a gestão descobre um problema real — serviço insuficiente, baixa eficiência e funcionários remotos potencialmente negligentes — e então opta por usar a tecnologia para "resolvê-lo". Mas a tecnologia só consegue medir métricas indiretas: intervalos de leitura, frequência de palavras-chave, padrões de movimento do mouse e variações de tom de voz. Há uma enorme lacuna entre essas métricas e a qualidade real do trabalho.

Armadilhas de medição

Voltando ao caso do Burger King, um bom gerente de loja deve estar atento ao desempenho de seus funcionários no atendimento. Isso pode ser alcançado por meio de visitas à loja, mentoria e feedback diário para ajustes; observando o olhar e o ritmo do funcionário durante o horário de pico do almoço; e conversando com ele após o expediente para entender quem está sob pressão. Mas isso exige experiência, presença e bom senso — justamente as qualidades mais escassas no setor de redes de fast-food.

O setor de fast-food sofre há tempos com a escassez de gerentes de nível médio. A alta rotatividade de funcionários (mais de 100% ao ano no setor de fast-food dos EUA), os ciclos de treinamento comprimidos e as limitadas oportunidades de salário e desenvolvimento de carreira para gerentes de loja dificultam a retenção de funcionários experientes. O resultado é uma falta sistêmica de competência gerencial. Não se trata de um gerente de loja específico ser incompetente, mas sim de uma estrutura do setor que dificulta a manutenção consistente de uma equipe de gerência de nível médio com qualidade suficiente.

Assim, quando a IA surgiu, foi vista como um atalho para contornar as habilidades de gestão: já que não tenho gerentes suficientemente bons, deixo o algoritmo ficar de olho nas coisas. Já que não posso exigir que todos os gerentes de loja tenham habilidades de observação e empatia, deixo o sistema contar quantas vezes "por favor" e "obrigado" foram usados.

O problema é que os algoritmos têm como alvo palavras, não pessoas. "Por favor" e "obrigado" podem ser contabilizados, mas a verdadeira qualidade do serviço — um funcionário ajudando pacientemente um cliente a trocar seu pedido sob pressão durante o horário de pico, ou um novo funcionário lidando com uma reclamação de forma independente pela primeira vez com uma atitude sincera apesar do nervosismo — não pode ser capturada pelo reconhecimento de palavras-chave.

Além disso, o mais provável é que, uma vez que os funcionários saibam que cada palavra que dizem está sendo avaliada, seu comportamento se distorça. A "simpatia" se transforma de uma atitude espontânea em uma performance monitorada. Você adicionará "por favor" antes de cada frase não porque realmente queira ser educado, mas porque sabe que o sistema está ouvindo. Você dirá "obrigado por vir" ao entregar um hambúrguer não por gratidão, mas porque não dizer isso diminuirá sua pontuação.

Existe um conceito nas ciências sociais chamado Lei de Goodhart: quando um indicador se torna uma meta, ele deixa de ser um bom indicador. A frequência de "por favor" e "obrigado" poderia ter sido um indicador aproximado da cordialidade do atendimento, mas, uma vez que se torna um indicador-chave de desempenho (KPI) para avaliação de desempenho dos funcionários, estes se concentrarão em otimizar o próprio indicador, em vez de melhorar o que está por trás dele.

A cadeia lógica dessa abordagem é clara: incapacidade de gerenciar pessoas → substituição da gestão pela tecnologia → a tecnologia só consegue quantificar indicadores superficiais → indicadores superficiais se tornam KPIs → métricas de desempenho dos funcionários → a qualidade real do serviço diminui. A gestão, ao ver a "pontuação de cordialidade" subir no painel de controle, presume que o problema está resolvido.

" Trata-se de facilitar a gestão", disse Rooks.

Existem duas maneiras de integrar a IA à gestão: assistência e substituição. "Assistência" significa que a IA fornece informações e os humanos tomam as decisões. Um gestor pode observar uma queda nos dados de cordialidade e, em seguida, analisar e compreender os motivos — talvez seja uma escala de trabalho inadequada, uma emergência familiar de um funcionário ou um aumento real nas reclamações de clientes durante um determinado período. Os dados são o ponto de partida, não o ponto final.

"Substituição" significa que a conclusão é baseada na IA. Se a pontuação de simpatia for baixa, o sistema a marca automaticamente, e o gestor usa essa pontuação diretamente para iniciar uma conversa ou, mais diretamente, a integra à avaliação de desempenho. Não é necessário observar, compreender ou julgar.

O sistema ADAPT da Amazon chegou ao ponto de "substituição" — o sistema demite funcionários diretamente. O Patty do Burger King ainda está no estágio "auxiliar". Mas o problema é que, quando se fornece uma ferramenta de pontuação automatizada a um sistema que já carece de capacidades de gestão, ele quase inevitavelmente desliza para a fase de "substituição". Isso ocorre porque a fase "auxiliar" exige que as pessoas tenham a capacidade de usar informações auxiliares para tomar decisões, e essa capacidade é justamente o que faltava inicialmente.

Você não pode esperar suprir a sua falta de habilidade no uso de ferramentas com outras ferramentas.

É por isso que a "gestão assistida por IA" falhou repetidamente em setores como o de fast food, armazenagem e logística e call centers: a própria razão pela qual esses setores introduziram o monitoramento por IA é justamente porque não conseguem utilizá-lo de forma eficaz. A insuficiência de capacidade de gestão os levou a introduzir a tecnologia; mas, devido a essa inadequação, a tecnologia foi tratada de forma rudimentar como se fosse a própria gestão.

Em última análise, a maior força da IA não é aprimorar a gestão. Sua maior força é fazer com que aqueles que se recusam a abordar as causas raízes pareçam estar resolvendo problemas.

O painel de controle acende, os números mudam e a apresentação em PowerPoint exibe a mensagem "Aprimoramento da Qualidade do Serviço Impulsionado por IA". Enquanto isso, o funcionário do outro lado do fone de ouvido pratica freneticamente as palavras certas na hora certa, na esperança de convencer um algoritmo de que está sendo amigável o suficiente.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.