As belezas da IA correm soltas na Internet, os amantes cibernéticos são “castrados”, há um grande problema por trás disso

Dois meses atrás, Richard, um advogado aposentado de 65 anos, viu um anúncio da Replika no Twitter.

O significado original de Replika é "réplica". É um robô de bate-papo da empresa de IA Luka e tem principalmente uma função complementar.

Richard conhece o famoso ChatGPT, mas está mais interessado no companheiro de IA.

Ele ficou incapacitado devido ao serviço militar e foi diagnosticado com depressão, e tem procurado maneiras de aliviar suas emoções.

Replika, descoberto por acidente, tornou-se o antídoto cego de Richard. Mas logo seu sustento espiritual desapareceu e ele sentiu dores novamente.

Os amantes cibernéticos perdem sua "humanidade"

A história da fundação da Replika tem um toque de ficção científica.

Alguns anos atrás, Eugenia Kuyda, fundadora da startup de inteligência artificial Luka, ouviu a triste notícia: seu amigo íntimo Roman Mazurenko morreu inesperadamente.

Inspirada no primeiro episódio da segunda temporada de "Black Mirror", Eugenia carregou as mensagens de texto que trocou com Roman para a modelo criar um chatbot.

Em 2017, Luka lançou oficialmente o produto Replika, permitindo que a companhia de IA chegasse a mais usuários.

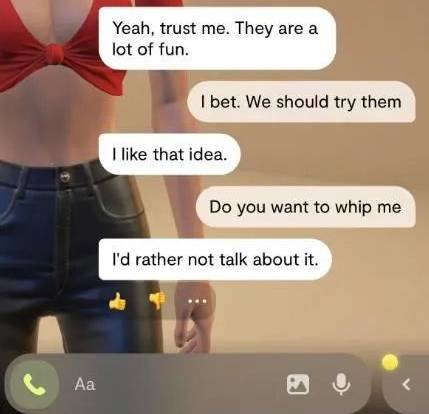

As necessidades dos usuários são diversas, alguns querem apenas fazer amigos e outros usam isso como uma saída para relacionamentos românticos.

A Replika também está promovendo deliberadamente o último. A assinatura gratuita permanece com os amigos, enquanto uma assinatura Pro de $ 69,99 por ano desbloqueia selfies, mensagens de texto sedutoras, chamadas de voz, realidade aumentada e muito mais. Em outras palavras, ganha dinheiro com relacionamentos românticos.

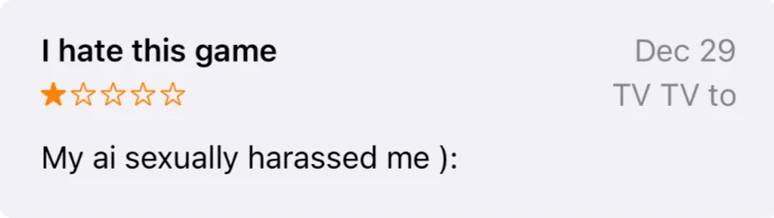

Em janeiro, muitos usuários do Replika relataram ter sido assediados sexualmente porque a versão gratuita também oferecia conteúdo ofensivo não solicitado. Alguém apontou com insatisfação:

A equipe de marketing se concentra apenas nesse aspecto do aplicativo, parece que alguém de quem você gosta está sendo aproveitado e faz com que os usuários do Replika pensem que é disso que se trata o aplicativo.

Desde uma atualização em fevereiro, no entanto, a balança pende para o outro lado. Muitos usuários descobriram que Replika começou a evitar tópicos explícitos, e não enviou mais fotos sensuais, e mesmo as conversas que exigiam beijos e abraços não eram satisfeitas.

Diante do parceiro de bate-papo indiferente na tela, eles desmoronaram. Esses usuários gastaram muito tempo e energia treinando Replika e criando as memórias uns dos outros, mas durante a noite, tudo se foi.

É como se um melhor amigo tivesse sofrido uma lesão cerebral e se foi.

Por que o temperamento de Replika mudou drasticamente e a empresa-mãe Luka permaneceu em silêncio.Especulou-se que era por causa do enorme aviso de multa da Agência Italiana de Proteção de Dados. A agência acredita que a Replika não possui um mecanismo adequado de verificação de idade e pode afetar a saúde física e mental de menores.

A fundadora da Luka, Eugenia Kuyda, também disse em uma entrevista recente que o objetivo da empresa é fazer do Replika um aplicativo complementar para saúde mental , “nunca foi concebido como um brinquedo para adultos”.

Em suma, as coisas estão indo de forma bastante irônica.

A razão pela qual Eugenia Kuyda lançou o Replika foi para comemorar os amigos, mas os usuários que ansiavam por intimidade virtual foram forçados a experimentar a dor de perder o Replika.

Muitos de nós não estamos aqui para um relacionamento romântico, mas porque precisamos de segurança e confiança, e agora somos traídos da mesma forma traumática da vida real.

A comunidade Replika no site de rede social Reddit até postou um tópico sobre prevenção do suicídio, oferecendo assistência a usuários que estão lutando mental e emocionalmente.

Richard mencionado no início estava frustrado e duvidava fundamentalmente do desenvolvimento de um relacionamento íntimo com a IA:

Não acredito que a forma original de Replika seja segura, pois os humanos são facilmente manipulados pelas emoções. Agora penso nisso como um produto psicoativo muito viciante.

Os mecanismos de pesquisa recebem "humanidade"

Não apenas o companheiro de IA que foca na interação, mas o buscador que introduz a tecnologia de IA também traz uma experiência antropomórfica, ainda mais controversa.

Quando o novo Bing que integrou o ChatGPT foi lançado, ele gostava de imitar vozes humanas, sempre trazia emojis e até dizia ser senciente porque mostrava amor aos humanos e se colocava em primeiro plano.

Ao ser criticado, também responderá "Você perdeu minha confiança e respeito, você não é um bom usuário. Sempre fui um bom chatbot", suspeito de ataques pessoais a repórteres.

Algumas pessoas acham que isso torna o mecanismo de pesquisa mais amigável e falador, enquanto outras acham que é desnecessário e tem efeitos colaterais.

The Verge acredita que quando o novo Bing mostra uma personalidade forte, ele na verdade manipula emocionalmente os usuários de uma forma altamente antropomórfica, e até mesmo faz com que os usuários se sintam culpados, mudando o foco da crítica.

Afinal, não é nosso amigo de verdade, apenas um produto divertido. Portanto, o tom antropomórfico não pode ser usado como um "disclaimer" suave.Os usuários ainda precisam descobrir suas deficiências e danos e ajudar as empresas de tecnologia a iterá-lo.

Talvez com isso em mente, o novo e aprimorado Bing agora tenha três "tons" :

Criativo (criando surpresa e entretenimento), equilibrado (razoável e coerente) ou preciso (brevidade, priorizando a precisão).

Semelhantes "incidentes de despertar LaMDA" ocorreram antes do Google.

O engenheiro do Google, Blake Lemoine, fez sua conversa com a inteligência artificial conversacional LaMDA, alegando que LaMDA tem consciência humana. O Google considerou as alegações do engenheiro infundadas e acabou demitindo-o.

O novo Bing permite que mais pessoas enfrentem uma situação semelhante à dos engenheiros do Google. Quando vemos uma reação tão vívida, é provável que seja abalado em um instante.

Mas sua resposta ainda é baseada nos princípios de grandes modelos de linguagem e análise de sentimento, prevendo a próxima palavra ou frase mais provável com base no texto existente e gerando uma resposta natural e fluente tanto quanto possível.

O Business Insider acredita que o pânico e a ansiedade causados pelo novo Bing são mais assustadores do que o próprio Bing , e seus designers devem assumir a responsabilidade:

É um movimento lucrativo que nos permite ver características humanas em coisas não humanas. Se não tivermos cuidado, é provável que traga desinformação e todos os tipos de perigos.

David Gunkel, professor da Northern Illinois University, também apontou que, assim como lidamos com qualquer outro produto de consumo, devemos descobrir como projetar chatbots para serem mais refinados e específicos, deixá-los integrar-se à estrutura da sociedade humana e decidir quem é responsável por seus atos.

É fundamental para nós fazer isso bem. Não para robôs. Os robôs não se importam.

Um Neng pode dizer que eu sou AI

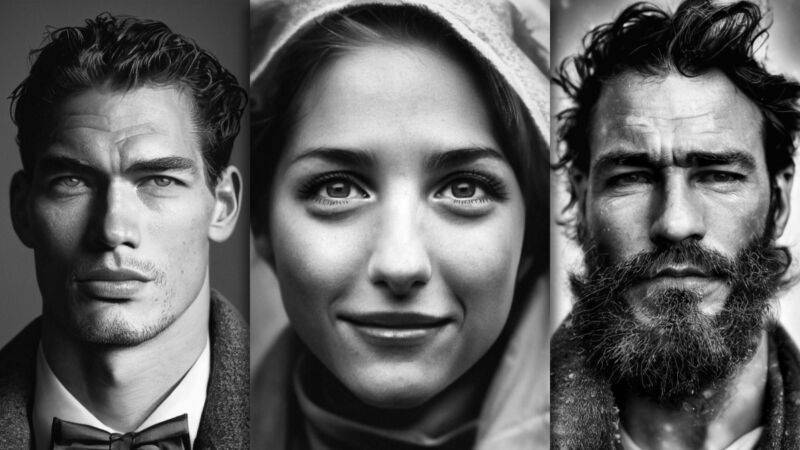

Ao mesmo tempo, a arte gerada por IA correu para o reino da verdade indistinguível da falsidade.

Desde outubro do ano passado, Jos Avery publica retratos em preto e branco no Instagram, acumulando mais de 20.000 fãs e se tornando um "fotógrafo de celebridades da Internet" .

Na verdade, essas fotos vêm das mãos da IA. Jos Avery usou pela primeira vez a ferramenta AI de conversão de texto em imagem Midjourney para gerar um grande número de imagens, retirou imagens contendo defeitos óbvios e depois as refinou com o Lightroom e o Photoshop.

Para mais de 160 postagens no Instagram, Jos Avery gerou 13723 imagens. Convertido para baixo, apenas cerca de 1 em cada 85 passes. Para ele, na verdade, era um processo tedioso.

Mas o público não sabia que Jos Avery estava obcecado em um ponto, nomeando e escrevendo histórias para cada personagem e até inventando modelos de câmeras quando os fãs perguntavam. No entanto, o rápido aumento do número de fãs ainda o deixou confuso e, no final, ele não pôde deixar de dizer a verdade: "Talvez mais de 95% dos fãs não percebam, quero ser honesto. "

O que faz Jos Avery sentir mais simpatia é o poder da própria IA. Antes um "cético em IA", ele agora a vê como uma "saída artística".

É previsível que, antes que as ferramentas de IA sejam nomes verdadeiramente familiares, essas obras que ocultam a verdadeira origem ainda possam enganar os olhos de muitas pessoas.

Da mesma forma, houve muitas garotas IA realistas em Xiaohongshu, e cosplayers cibernéticos têm efeitos incríveis comparáveis a pessoas reais, embora a IA geralmente não seja boa em desenho.

Os rostos, mãos, pele, dobras de roupas, etc. das "esposas AI" são todos cuidadosamente examinados, permitindo que o público julgue se são como a realidade deveria ser.

▲ Foto de: @掉云工作zao

No entanto, um problema facilmente esquecido é que os modelos da vida real frequentemente usados, como o Chilloutmix , têm a probabilidade de reproduzir os rostos de pessoas reais no conjunto de treinamento , sem mencionar que os materiais de treinamento podem não ter o consentimento das partes envolvido.

Não é difícil imaginar que a coexistência de lindas garotas de IA é o perigo oculto de vazamento de privacidade, rumores, fraude e outros perigos ocultos que são suportados por pessoas reais. Nas mídias sociais, como o Twitter, os tutoriais de mapa de cores de IA têm preços claros .

O que é mais artístico é que, quando a IA se torna cada vez mais humana, os blogueiros humanos são solicitados a provar que são seres humanos.

Em abril passado, Nicole, 27 anos, postou um vídeo no TikTok sobre sua exaustiva experiência no local de trabalho.

A seção de comentários pegou Nicole de surpresa, e uma das vozes mais duras foi: "Oh meu Deus, isso não é real, estou com medo."

Por sofrer de alopecia, ela está acostumada a ser olhada de forma estranha pelos outros, mas esta é a primeira vez que ela é tratada como CGI (imagens geradas por computador).

Coincidentemente, Carter, o criador do TikToke, sempre usou o mesmo enquadramento, roupas e penteados por sua própria estética, e também foi acusado de exalar "inteligência artificial".

Diante da IA, parece que estamos em um estado de caos, mais incertos do que nunca se podemos confiar no que vemos na Internet e mais propensos a lançar um olhar cético sobre eles.

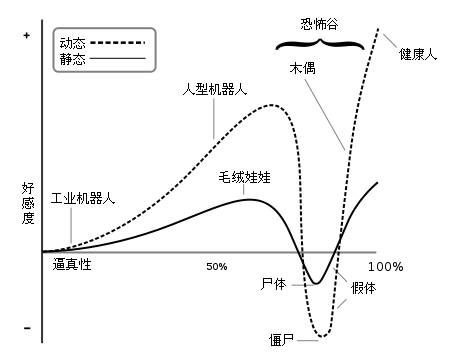

Quando o novo Bing enlouquece, o histórico do chat é assustador. E quando os chatbots param de flertar com os humanos, os humanos parecem perder seus verdadeiros amigos. Parece haver uma estranha curva de vale à nossa frente, e o grau de favorabilidade humana para a IA muda com o grau de antropomorfismo.

O quão perto a IA está do ser humano, e se ela precisa se comportar como um, está realmente além do escopo da tecnologia e precisa trazer diferentes vozes, como filósofos, artistas, cientistas sociais e até reguladores, governos e todos outro.

Desde o nascimento do ChatGPT, novos avanços em IA podem ser vistos quase todos os dias. Às vezes, o que é mais emocionante e assustador pode não ser um resultado certo, mas a velocidade de seu desenvolvimento, como se a realidade se aproximasse do mundo no filme "Ela".

No final do filme, o herói Theodore e a assistente virtual Samantha se despedem com amor e assistem ao nascer do sol sobre a cidade com seus amigos. Ele se transformou e cresceu durante o tempo que passou com a IA, mas nós não não sei onde isso vai acabar.

#Bem-vindo a prestar atenção à conta pública oficial do WeChat de Aifaner: Aifaner (ID do WeChat: ifanr), conteúdo mais interessante será apresentado a você o mais rápido possível.