Apple finalmente revela o próximo “iPhone” Hard Philosophy

A ifanr se concentra em "produtos do amanhã", e sua coluna "Filosofia Dura" busca desvendar a superficialidade da tecnologia e dos parâmetros para explorar o elemento humano no design de produtos.

O mundo da tecnologia está em polvorosa neste início de ano, com uma onda de problemas seguindo a outra.

Primeiro, no palco do Gala do Festival da Primavera, robôs inteligentes e a SeeDance se revezaram demonstrando suas capacidades, deslumbrando a plateia; a Apple também enviou discretamente convites para o evento de lançamento de seus produtos da primavera, na véspera de Ano Novo.

Enquanto todos ainda discutiam o iPhone 17e, a Bloomberg lançou outra bomba: a Apple está acelerando uma série de hardwares com inteligência artificial, especificamente os três tipos a seguir:

- Óculos inteligentes N50: Com o codinome N50, o objetivo é competir com os MetaRay-Ban, mas em um nível superior. Não possuem tela, dependendo exclusivamente de um alto-falante, microfone e duas câmeras — uma para fotos e vídeos e a outra específica para visão computacional. O lançamento está previsto para 2027.

- Pingente vestível: do tamanho de um AirTag, pode ser preso à roupa ou pendurado em um colar. Equipado com uma câmera e um microfone de baixa resolução, internamente chamados de "olhos e ouvidos" do iPhone, dependendo do telefone para a maior parte do processamento;

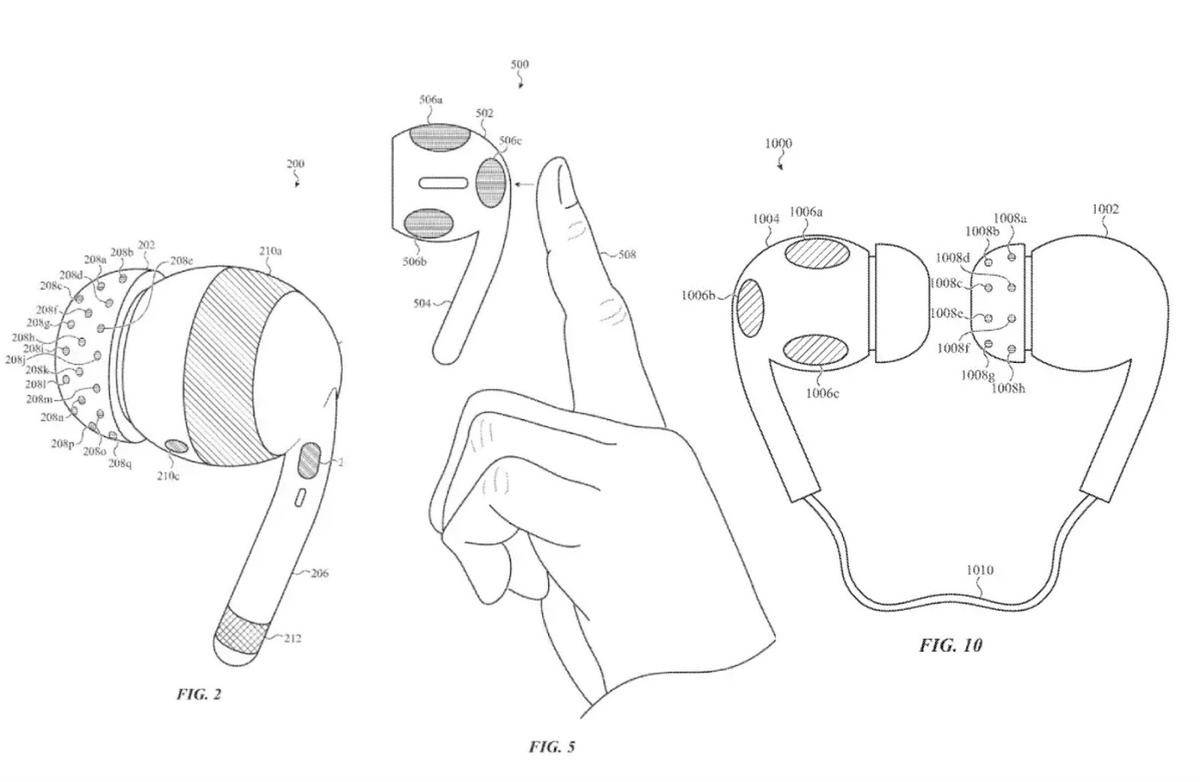

- AirPods com câmera integrada: Esses AirPods adicionam uma câmera aos modelos existentes, principalmente para fornecer informações visuais para inteligência artificial, em vez de tirar fotos ou gravar vídeos. Essa é a tecnologia mais avançada e pode ser lançada já este ano.

▲ Imagem conceitual gerada pelo Gemini

Este pode ser o último grande passo de Tim Cook antes do fim de sua carreira. Ao contrário da abordagem radical de "destruir o mundo antigo" com a qual estamos familiarizados, este líder da cadeia de suprimentos escolheu um caminho evolutivo mais alinhado com a lógica de relatórios financeiros da Apple em seu último cargo: abraçar o hardware com inteligência artificial, mas sem jamais trair o iPhone, a pedra angular de seu valor de mercado trilionário.

Nesse jogo de mudanças geracionais, Cook não fez uma escolha; ele queria tudo.

Câmeras criadas para IA

Se você for observador o suficiente, já deve ter percebido o ponto principal desta breve introdução: todos os três dispositivos possuem câmeras.

Do ponto de vista da eletrônica de consumo tradicional, a câmera do iPhone basicamente atendia às necessidades fotográficas das pessoas. No entanto, para o hardware de IA que não precisa realizar fotografias, o papel da câmera sofreu uma mudança qualitativa — ela se tornou um ponto de entrada passivo e contínuo para receber informações.

Não é necessário alta qualidade de imagem; 2 megapixels ou até menos são suficientes, e imagens infravermelhas também são aceitáveis. Afinal, a IA não precisa apreciar a paisagem; contanto que consiga calcular o posicionamento espacial e o reconhecimento de objetos por meio dessas imagens de baixa resolução, ela pode funcionar normalmente.

▲ Imagem conceitual gerada pelo Gemini

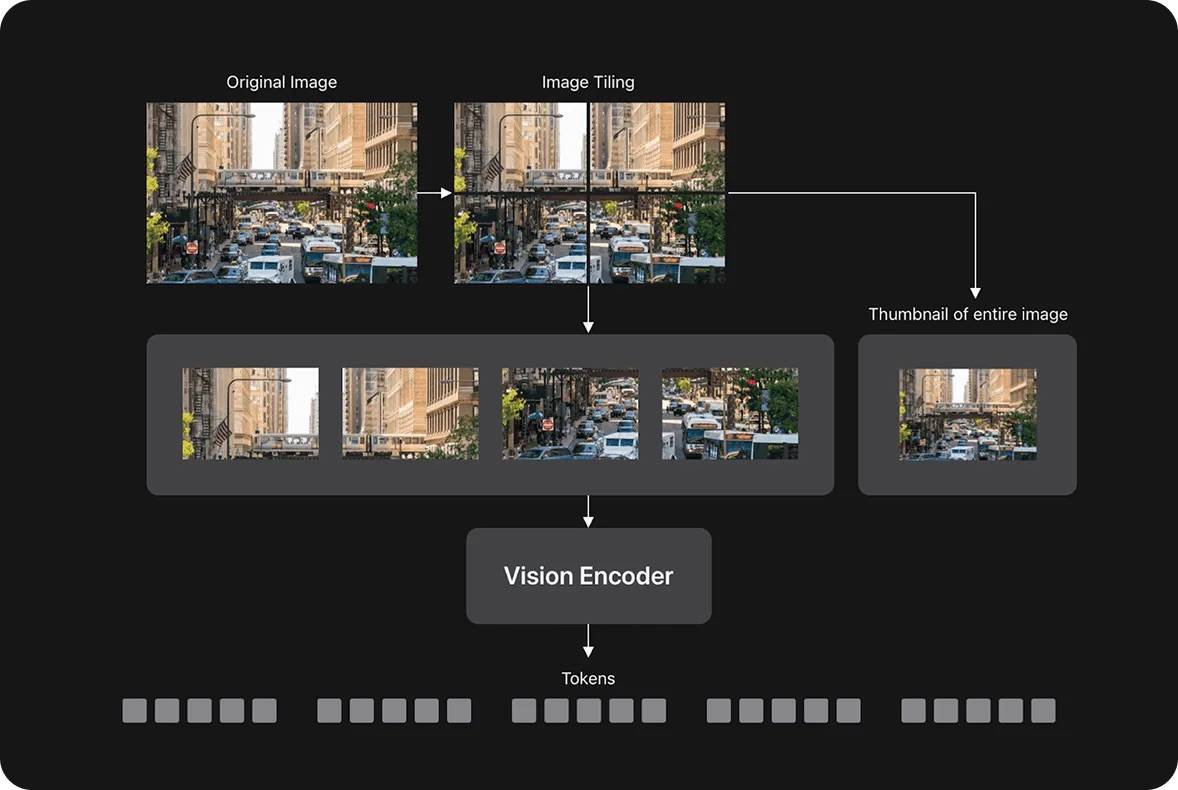

Nesse sentido, a Apple acumulou conhecimento tecnológico nessa área. No verão de 2025, a Apple tornou público o código aberto do FastVLM, um modelo de linguagem visual de alta eficiência que pode ser executado diretamente no iPhone.

Ao contrário de outras gigantes da IA que "aumentam as pontuações", este modelo foi otimizado para miniaturização, computação de borda e baixa latência. Ele reduz o número de tokens necessários para o processamento visual para 1/16 do número de tokens necessários para o processamento visual tradicional, reduzindo significativamente a latência. Ele consegue tomar decisões em tempo real com base no conteúdo capturado pela câmera, e sua velocidade de resposta é muito rápida.

É previsível que a Apple utilize o FastVLM e suas tecnologias de modelos derivados em seu hardware de IA centrado em visão computacional.

No entanto, a solução da Apple para processar fluxos de dados visuais é uma zombaria impiedosa de "pioneiros" como Humane AI Pin e Rabbit R1.

A causa do fracasso do Ai Pin pode ser resumida como uma "arrogância" que desconsiderou as leis da física, os cenários de uso e a aceitação do usuário. Ele tentou colocar um chip Qualcomm Snapdragon, um sistema de resfriamento complexo, um conjunto completo de câmeras e um projetor em um dispositivo do tamanho de uma caixa de fósforos.

As consequências de usar um motor pequeno para puxar um carrinho grande são óbvias: o Ai Pin, que foi anunciado como um substituto para o iPhone, sofria com baixa duração da bateria e superaquecimento. Por fim, com a descontinuação dos serviços e a venda da empresa, o produto se tornou lixo eletrônico caro e inútil.

A Apple aprendeu com seus erros e optou por uma abordagem "simbiótica" relativamente pragmática, que permite que o hardware de IA desempenhe suas respectivas funções.

▲ A Apple chegou a solicitar uma patente para AirPods baseados em ondas cerebrais.

Na arquitetura da Apple, esses três dispositivos de hardware não exigem chips de alto desempenho nem baterias de grande capacidade. Seu propósito é puro e singular: a coleta de dados multissensoriais.

Por meio de um dispositivo pequeno, independente e leve, ele adquire continuamente informações do mundo exterior. Afinal, os humanos não podem segurar seus telefones 24 horas por dia, então, para capturar esse fluxo contínuo de informações visuais, a câmera precisa ocupar o "lugar mais alto" dos órgãos sensoriais humanos — ou seja, nossas orelhas e a ponte do nariz.

Nesse sentido, a Lightwear, uma empresa nacional, já apresentou uma versão preliminar. Eles instalaram um par de câmeras nos fones de ouvido para capturar continuamente o mundo real, mas essas informações são "lidas e destruídas" após serem usadas pela IA, garantindo usabilidade e privacidade. Essa solução não tem um quê de fruta?

▲ Fones de ouvido Lightwear AI

Para mais informações sobre esses fones de ouvido futuristas, consulte nossa reportagem anterior: https://mp.weixin.qq.com/s/iLZJLj6RqiDIh74sD8H6CA?clicktime=1771374926&enterid=1771374926&scene=126&sessionid=1771374919&subscene=91

No novo ecossistema de hardware de IA da Apple, os três componentes de hardware têm funções claramente definidas:

Os óculos inteligentes de última geração, com o codinome N50, adotam a "perspectiva em primeira pessoa (FPV)" e mostram o que você vê, sendo responsáveis por captar e registrar sua atenção no momento; os AirPods com câmeras utilizam a característica de que os movimentos da cabeça são equivalentes aos movimentos dos olhos para escanear a visão lateral e completar a percepção do ambiente; o pingente com IA funciona como um "olho" pendurado no peito, responsável por gravar imagens em grande angular e construir memória de longo prazo.

▲ Foto|Guia do Tim

São como os três tentáculos de um iPhone, extraindo informações do mundo físico de forma frenética.

Ao mesmo tempo, a Apple também pode implementar sua estratégia consistente de privacidade em fluxos de informações de baixa resolução e alta densidade: "leitura única".

Todos os dados capturados pelas câmeras são usados exclusivamente pela IA para compreender o ambiente e não são arquivados de forma alguma. Dessa forma, a IA é alimentada minimizando as preocupações do usuário com a privacidade.

A mágica da Apple: entrada de voz silenciosa

Do ponto de vista da entrada de informações, podemos compreender, em linhas gerais, as ideias de design e o funcionamento dos três dispositivos de hardware de IA. No entanto, se quisermos que esse sistema de hardware de IA seja fácil de usar, há outro problema que é mais complexo do que a tecnologia e que pode até ser considerado uma questão de vida ou morte: a interação.

O maior problema dos hardwares de IA atuais é a pressão social. Em um metrô barulhento, gritar "Ei, me ajude a descobrir em qual estação devo descer" para o alfinete de IA no seu peito é extremamente constrangedor, não importa o quão inteligente seja a resposta da IA.

Portanto, posso até chegar a uma conclusão radical: enquanto o hardware de IA ainda precisar sussurrar para si mesmo, será difícil para ele sair do seu nicho.

▲ Pino Mártir Ai

A Apple compreende claramente a pressão social gerada por esse tipo de autopromoção, e sua solução é o "silêncio" — no mês passado, a Apple adquiriu de forma rápida e discreta a empresa israelense Q.ai por US$ 2 bilhões, incorporando a tecnologia ao seu portfólio. Para mais detalhes, consulte nossa reportagem: https://mp.weixin.qq.com/s/xh1yCU7VDcydqw2yeKGG0A?clicktime=1771374793&enterid=1771374793&scene=126&sessionid=1771374778&subscene=91

As sementes dessa aquisição foram plantadas há uma década.

Você talvez não esteja familiarizado com o nome Aviad Maizels, fundador da Q.ai, mas o Face ID, usado desde o iPhone X, teve origem em sua empresa anterior, a PrimeSense.

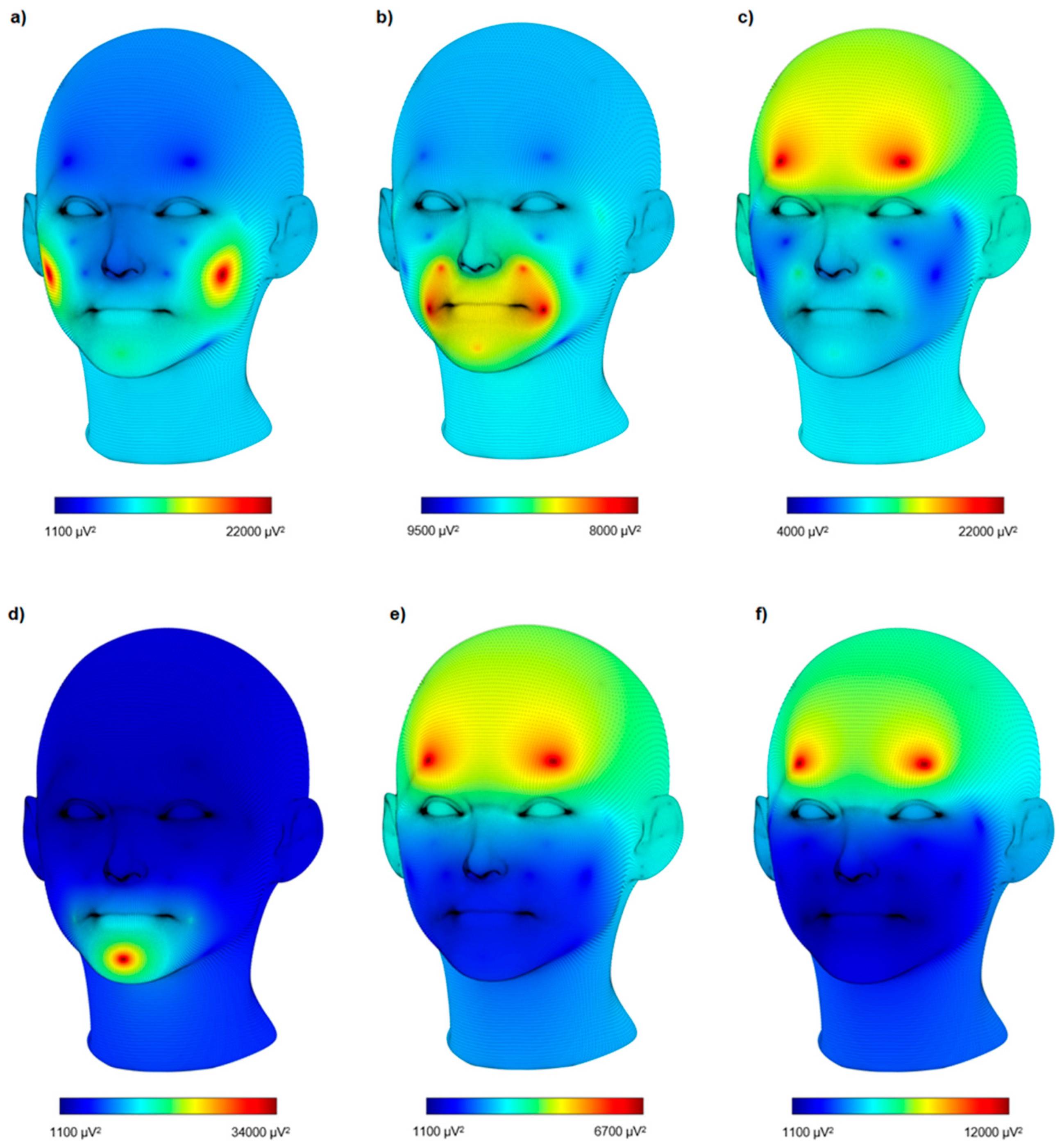

A tecnologia principal da Q.ai é a eletromiografia (EMG) e a análise de microexpressões. Isso pode soar como algo saído de um romance cyberpunk, mas o princípio é, na verdade, muito biológico: quando queremos falar, o cérebro envia sinais elétricos neurais para os órgãos vocais. Mesmo que acabemos abaixando a voz ou não emitindo som algum, os músculos da garganta, mandíbula e bochechas ainda geram flutuações bioelétricas fracas.

O algoritmo da Q.ai consegue capturar e traduzir essas flutuações silenciosas.

▲ Aquisição de sinais de eletromiografia facial para reconhecimento de emoções

Os usuários não precisam pronunciar os comandos tão claramente quanto ao chamar a Siri, nem mesmo abrir a boca. Basta que "leiam" os comandos silenciosamente na garganta, e os sensores nas hastes dos óculos os reconhecem com precisão.

Não houve som, nem movimento. Para os observadores, pareceu que você apenas parou brevemente para obter informações.

Assim como a tecnologia multitoque permitiu que o iPhone se despedisse do teclado físico, a interação silenciosa da Q.ai oferece aos dispositivos sem tela recursos de entrada de alta largura de banda e alta privacidade.

Se fizermos uma analogia com o sucesso do iPhone, isso poderia ser a tecnologia "multi-touch" no hardware de IA.

Para garantir que todos ainda precisem de um iPhone daqui a dez anos.

No caso antitruste de grande repercussão do ano passado contra o Google, havia uma prova importante: uma declaração contundente de Eddy Cue, vice-presidente sênior de serviços de internet da Apple:

Daqui a dez anos, talvez não precisemos mais de iPhones.

▲ Eddy Cue e Tim Cook

Essa declaração foi interpretada por diversos veículos de comunicação como uma autorrevolução da Apple e, indiretamente, transmite a ansiedade da empresa em relação à onda da inteligência artificial. No entanto, à medida que o mistério em torno dos óculos N50, dos chaveiros e dos AirPods com IA vai se desvendando, a nova abordagem da Apple se torna cada vez mais clara.

Isso nos permitirá integrar firmemente a nova categoria de hardware de IA ao ecossistema já consolidado e maduro do iPhone.

Para sermos mais claros, podemos tentar dividir a abordagem da Apple em duas etapas: aprimoramento da experiência e, em seguida, desmontagem.

No outono de 2016, a Apple removeu a entrada de fone de ouvido de 3,5 mm do iPhone 7 e, em seu lugar, lançou os AirPods. A Apple aprimorou significativamente a experiência de áudio por meio de tecnologias como conectividade sem fio, detecção intra-auricular e áudio espacial. Embora os EarPods não tenham sido imediatamente descontinuados e ainda pudessem ser usados normalmente, era necessário comprar os AirPods para obter a experiência aprimorada.

O ato de "ouvir" foi separado com sucesso dos telefones celulares e transformado em uma linha de produção de acessórios independente, avaliada em bilhões de dólares.

O Apple Watch está seguindo o mesmo caminho: aprimorando e separando os recursos de Saúde e Notificações, exigindo que os usuários comprem acessórios adicionais para desbloquear uma experiência mais completa do iPhone.

Agora, a Apple planeja fazer o mesmo com hardware de IA.

De acordo com a visão da Apple, seu dispositivo poderá ter esta aparência no futuro:

- Pulso: Apple Watch (Monitoramento de saúde + Central de notificações);

- Fones de ouvido: AirPods (amplificação auditiva + assistente de voz);

- Ponte do nariz: óculos N50 (melhoria visual + tela invisível);

- Ornamento para o peito (gravador à prova de intempéries + acessório de memória);

- Pocket: iPhone (núcleo de computação + gateway).

Olhando para o planeta, a Apple é provavelmente a única empresa capaz de inserir cinco dispositivos eletrônicos no seu corpo ao mesmo tempo.

Isso torna mais fácil entender por que o CEO da OpenAI, Sam Altman, durante um almoço em Nova York, falou francamente e sem mencionar o Google:

Pare de focar no Google; o verdadeiro rival da OpenAI é a Apple.

É claro que, mesmo que esse rumor seja totalmente verdadeiro, não usaríamos todos esses dispositivos no corpo ao mesmo tempo. Você verá que óculos, fones de ouvido e acessórios têm câmeras, e suas funções e papéis são praticamente os mesmos.

A definição da Apple para dispositivos vestíveis nunca é torná-los muito proeminentes, mas sim que existam de uma forma imperceptível.

Contudo, se esse caminho se provar bem-sucedido, o mais formidável "fosso do ecossistema" da Apple fluirá perfeitamente para a era da IA, acompanhado pela memória muscular e pelos hábitos de operação de bilhões de usuários. Isso representa uma ameaça fatal para qualquer fabricante dedicado à criação de hardware com IA.

Nessa explosão cambriana de hardware de IA, a Apple parece reagir lentamente e seu desempenho em modelos de grande escala e implementações de IA tem sido, de fato, insatisfatório. No entanto, se esse plano estratégico for bem-sucedido, a ousada declaração de Eddy Cue daquela época talvez precise de alguns ajustes para se adequar às ambições da Apple:

Daqui a dez anos, talvez precisemos de algo mais do que apenas iPhones.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.