Análise detalhada da versão do “Bean Bun Phone” do Google: Que jogo o líder do Android está jogando? AI Gadgets

Nota do editor: Quando a IA começa a buscar sua própria forma, algumas de suas escolhas são inesperadas. A inteligência artificial deu origem a um botão dedicado em smartphones, aparentemente reacendendo seu impulso evolutivo há muito perdido. Os óculos, com seu acesso natural à visão e à audição, começam a se assemelhar à próxima geração de terminais pessoais. Alguns dispositivos pequenos e focados parecem mais confiáveis do que os dispositivos multifuncionais em certos momentos. Enquanto isso, tentativas radicais de substituir smartphones por dispositivos descartáveis foram recebidas com frieza. A implementação de tecnologia nunca se resume apenas a acumular funções; também envolve os hábitos das pessoas, a adequação aos cenários e a redefinição do conceito de "fácil de usar". A iFanr lança a coluna "Crônica dos Gadgets de IA", com o objetivo de explorar com você como a IA está mudando o design de hardware, remodelando a interação humano-computador e, mais importante, como a IA entrará em nosso dia a dia.

Inicialmente, pensei que a série Samsung Galaxy S26 já tivesse vazado e que o evento de lançamento seria apenas uma formalidade. Mas, ao que parece, a Samsung e o Google tinham algo diferente reservado.

As duas empresas apresentaram em conjunto as novas funcionalidades de IA da Gemini presentes no S26: com um simples comando de voz, a Gemini pode ajudar você a chamar um Uber ou pedir comida pelo DoorDash.

▲ Fonte da imagem: Android Central

Essa funcionalidade está atualmente em fase inicial de pré-visualização e está disponível apenas nos Estados Unidos e na Coreia do Sul.

Você pode pensar nisso como uma parceria entre o Google e a Samsung para criar uma versão global do "Doubao Phone" (mais precisamente, o Assistente do Doubao Phone). A série Galaxy S26 é apenas o começo; esses recursos serão disponibilizados para os celulares Google Pixel 10 e outros dispositivos com Android 17 posteriormente.

Tendo visto e utilizado muitos agentes de IA em nível de sistema de celular/computador, e tendo usado extensivamente o "Doubao Phone", acredito que a discussão sobre o agente Gemini não deva se limitar apenas a um "novo recurso".

É verdade que esta não é a primeira vez que a estrutura subjacente do sistema operacional Android foi profundamente personalizada para acomodar agentes inteligentes — muitos fabricantes, incluindo OPPO, Honor e Huawei, já fizeram tentativas iniciais consideráveis.

Mas esta é a Google, a proprietária absoluta do sistema operacional Android.

Se a ByteDance, como uma empresa "de fora", foi "desrespeitosa" com um aplicativo de âmbito nacional, então o envolvimento do Google nessa questão é completamente diferente.

Mas espere aí, vamos primeiro dar uma olhada no que exatamente é esse "celular em formato de saco de feijão" do Google e da Samsung.

Como é o "Bean Bun Phone" da Samsung?

A funcionalidade "Gemini Auto Task", apresentada pela Samsung e pelo Google, consegue imitar a operação humana de um telefone para automatizar tarefas. A abordagem subjacente combina a compreensão da leitura da tela por IA com APIs de nível de sistema/nível de aplicativo.

Vale ressaltar que o "Doubao Phone", desenvolvido em conjunto pela ByteDance e Nubia, utiliza amplamente permissões de sistema e recursos de leitura de tela, em vez de APIs. Pode-se dizer que o Doubao Phone adota principalmente uma abordagem "forçada", implementando sua funcionalidade sem consultar previamente os desenvolvedores de aplicativos, o que fornece argumentos para que aplicativos em nível nacional o bloqueiem e boicotem.

O agente inteligente Gemini, implementado pela Samsung e pelo Google na série Galaxy S26, combina elementos de ambas as tecnologias. Segundo informações divulgadas pela Samsung, ele é compatível com os 200 aplicativos mais populares da sua loja (mas apenas alguns aplicativos específicos têm garantia de bom funcionamento, como será detalhado adiante) – o que indica que a Samsung e o Google, pelo menos em grande parte, entraram em contato com esses desenvolvedores.

Vejamos a experiência de uma editora da revista Wired: ela simplesmente ligou para a Gemini, disse que queria ir ao aeroporto, e o próprio aplicativo Gemini abriu uma "janela virtual" para abrir o Uber e começou a executar a ação em segundo plano. Os usuários podem clicar para entrar a qualquer momento e visualizar o processo de execução da Gemini.

Como existem vários aeroportos diferentes na área, a Gemini rapidamente lembrou o usuário de selecionar o destino apropriado; ao fazer um pedido, a Gemini também empurrou a interface para a frente do usuário para facilitar a seleção do veículo apropriado e o pagamento.

A "janela virtual" do Gemini pode ser entendida como uma "máquina virtual" isolada, uma medida adotada pelo Google para proteger a privacidade do usuário. Os sistemas Gemini anteriores rodavam em Android, mas este novo agente Gemini opera dentro dessa área isolada e não acessa outras partes do dispositivo ao interagir com aplicativos.

Mais uma coisa: se você já usou produtos de agentes inteligentes com recursos de computação em nuvem/telefone em nuvem, como Manus, Kimi Computer ou AutoGLM, você entenderá facilmente a lógica desta máquina virtual Gemini.

▲ Fonte da imagem: 9To5Google

Essa é uma tarefa relativamente simples; muitos assistentes móveis de IA produzidos internamente já dominavam esse cenário há um ano.

O grande diferencial do Gemini é a combinação com os recursos de leitura de tela e captura de informações que a empresa já vem desenvolvendo há bastante tempo.

Por exemplo, quando um usuário e seus amigos estão conversando sobre pedir pizza para uma festa, o usuário pode simplesmente chamar o Gemini e dizer "resolva o pedido". O Gemini pode então recuperar diretamente as pizzarias mencionadas no chat, e até mesmo tipos específicos de pizza, e organizar as necessidades de todos.

Em seguida, os usuários podem pedir comida para viagem ao Gemini na plataforma de entrega de comida Grubhub. A IA adicionará automaticamente todos os itens do cardápio ao carrinho de compras em segundo plano, de acordo com os requisitos do pedido que acabaram de ser definidos, e então o enviará ao usuário para confirmação e finalização do pedido.

Às vezes, pedir comida não corre bem, e a Gemini tenta lidar com situações inesperadas por conta própria e oferecer soluções aos usuários. Certa vez, quando uma pizzaria limitou o número de pizzas grandes que podiam ser pedidas durante os horários de pico, a Gemini perguntou se poderia pedir duas pizzas médias.

Aqui está outro exemplo: uma nota do Google Keep foi usada para listar os participantes de um churrasco, com os vegetarianos indicados. O Gemini conseguiu calcular o número total de salsichas e pães necessários para toda a festa, enviar a solicitação de compra dos ingredientes e, em poucos minutos, todos os itens estavam no carrinho de compras do DoorDash.

Sammer Samat, presidente do ecossistema Android do Google, revelou que o Gemini não "memoriza" os passos e caminhos dessas operações da plataforma antecipadamente, mas sim utiliza habilidades de raciocínio para imitar a forma como os humanos veem a tela e executam a próxima operação. Isso significa que o Gemini pode liberar seu potencial em mais cenários no futuro.

Aqui você pode ver que o foco inicial da Gemini está em pedidos de comida e serviços de transporte por aplicativo, o que é mais semelhante ao que a Qianwen fazia antes do Festival da Primavera.

▲ Fonte da imagem: Wired

Mais um "celular em formato de pãozinho" da Android.

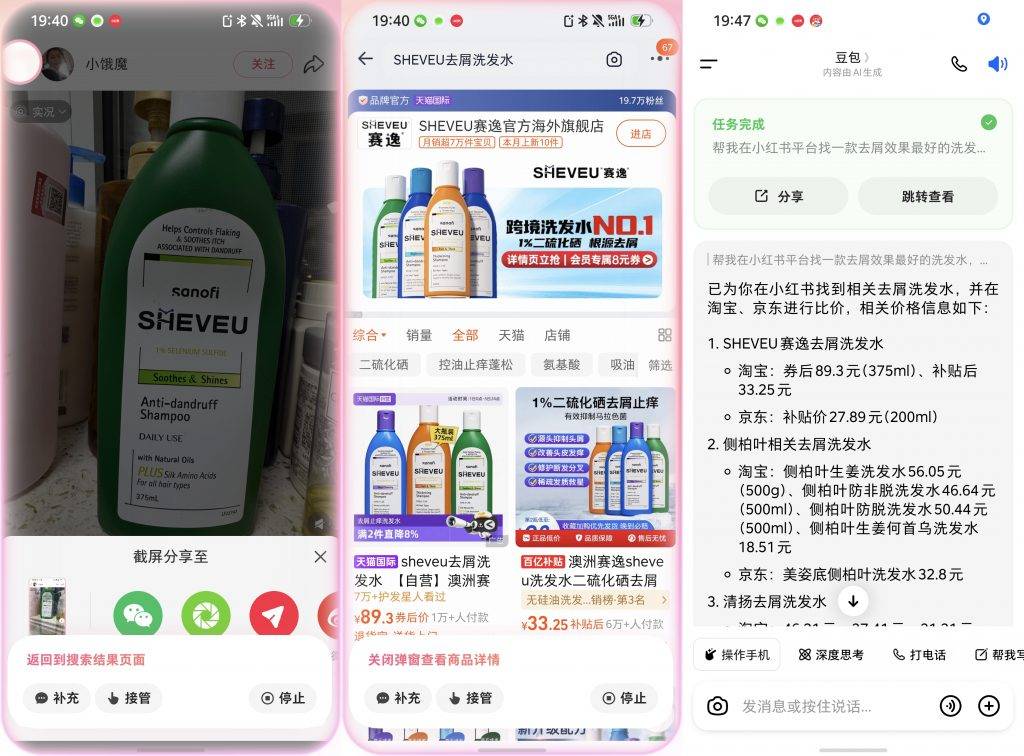

Comparado ao assistente móvel Doubao, verdadeiramente "tudo-em-um", que consegue até encontrar favoritos no WeChat (pelo menos antes do boicote), as funcionalidades atuais do Gemini ainda são bastante limitadas, focando em cenários cotidianos como solicitar transporte por aplicativo, entrega de comida e compras de supermercado. Embora sua tecnologia subjacente seja mais robusta, a experiência do usuário não difere muito daquela de assistentes de IA móveis nacionais, como o Xiaoyi do HarmonyOS e o YOYO da Honor.

No entanto, como mencionado no início do artigo, o Google controla todo o ecossistema Android e tem influência e controle absolutos.

Com o lançamento dos recursos de automação do Gemini, o Google também revelou em detalhes o layout subjacente e os planos futuros do sistema Android — existem duas direções que, em resumo, são ambas "Apple" e "Doubao".

Primeiro, o Google lançou no ano passado uma estrutura chamada "AppFunctions", que permite aos desenvolvedores expor pontos de entrada para funções e recursos específicos de seus aplicativos, para que os assistentes de IA possam chamá-los.

O Google compara o AppFunctions ao "Model Context Protocol" (MCP) do Android, que pode ser entendido simplesmente como um padrão de diálogo que ajuda aplicativos de terceiros e modelos de IA a se conectarem.

Essa estrutura é semelhante aos App Intents da Apple. Na visão da Apple, os usuários podem usar a Siri para operar diversos aplicativos e realizar funções, e a implementação subjacente é feita por meio dos App Intents — considerando o atraso na chegada da próxima geração da Siri, os App Intents são suficientes para proporcionar uma experiência satisfatória.

O mesmo se aplica às AppFunctions do Google.

Por exemplo, um usuário pode dar a instrução de encontrar uma receita no e-mail de um amigo e adicionar os ingredientes relevantes a uma lista de compras. Ao receber o comando, a IA primeiro usa a função "buscar" no aplicativo de e-mail para recuperar e extrair o conteúdo relevante e, em seguida, usa a função "lista de compras" no aplicativo de notas para preencher e organizar os dados.

Algumas funcionalidades do AppFunction já foram implementadas no Samsung Galaxy S26 e no sistema One UI 8.5. Por exemplo, os usuários podem dar comandos ao Gemini para encontrar fotos específicas em seu álbum e enviá-las para amigos via SMS.

É importante notar que, durante todo o processo, o Gemini não precisa abrir os aplicativos Fotos e Mensagens, nem mesmo sair do aplicativo Gemini. Em vez disso, ele usa AppFunctions para recuperar os pontos de entrada correspondentes e executar as operações dentro do Gemini, tornando-o mais eficiente.

Essencialmente, a implementação baseada em AppFunctions segue a mesma lógica do caminho da API antiga. Esta é uma solução pré-configurada.

No entanto, nem todos os aplicativos são devidamente adaptados. Mas não se preocupe, o Google tem outra solução.

Em um artigo publicado ontem no blog de desenvolvedores do Android, o Google afirmou explicitamente que a empresa também está desenvolvendo uma estrutura de automação de interface do usuário que permitirá que assistentes de IA e aplicativos de terceiros imitem humanos e abram o aplicativo diretamente, executando operações passo a passo.

—Este é um clone do "Doubao Phone".

No entanto, apesar da afirmação do Google de que a automação da interface do usuário assumirá o verdadeiro "trabalho pesado" no futuro, nesta série Galaxy 26, a automação da interface do usuário é apenas uma "versão de pré-visualização inicial".

▲ O aplicativo Doubao para celular me ajudou a encontrar e comparar preços de shampoos.

Se o AppFunctions exige que os desenvolvedores de aplicativos realizem trabalho adicional de adaptação, as estruturas de automação de interface do usuário deixam todo o trabalho para o agente de IA, não exigindo nenhuma adaptação adicional. No entanto, a eficácia depende muito das capacidades do agente de IA, e sua vantagem reside na capacidade de abranger um grande número de aplicativos logo após sua entrada em operação.

Como você pode ver agora, no projeto de agente inteligente Android Gemini do Google, as AppFunctions e a automação da interface do usuário são dois caminhos complementares: garantindo a máxima compatibilidade por meio de interfaces padronizadas e rastreáveis, ao mesmo tempo que estabelecem as bases para modos de interação com leitores de tela que realmente representam o futuro.

O Google também afirmou que essa não é uma funcionalidade exclusiva do Gemini, mas sim uma característica do sistema Android.

Isso também significa que, no futuro, seja o assistente de IA integrado ao fabricante do telefone ou aplicativos de terceiros como o ChatGPT, eles poderão chamar as AppFunctions para executar tarefas ou "entender" a interface do usuário do telefone para realizar operações automáticas.

Vale mencionar que, embora o Gemini não esteja disponível na versão chinesa do Samsung Galaxy S26, o assistente Bixby ainda pode executar funções como pedir comida para viagem, chamar um carro por aplicativo e comparar preços em plataformas de comércio eletrônico. Podemos inferir, com certa segurança, que a Samsung também encontrou um fornecedor na China para substituir o Gemini. Quanto a qual dessas grandes ou pequenas empresas está envolvida, provavelmente depende de quem obteve os resultados mais expressivos em assistentes virtuais para dispositivos móveis no último ano.

O caminho para os smartphones com inteligência artificial não será uma jornada solitária.

No ano passado, o "Doubao Phone" fez uma estreia impressionante, apenas para ser descontinuado prematuramente, infelizmente. Embora seja profundamente lamentável, isso também nos leva a refletir: será que o modelo de automação por IA é o modelo ideal para telefones com IA?

Essa questão não será respondida por pelo menos três a cinco anos. No mínimo, os celulares Doubao não estão agindo sozinhos; o Google, proprietário do sistema Android, também escolheu esse caminho e tem muito mais influência.

Após o Beanbag Phone se popularizar no exterior, alguns internautas começaram a imaginar que, se o Google promovesse essa tecnologia nos celulares Pixel e Android, as perspectivas seriam muito amplas.

Embora eu ache que o Google não tenha uma resposta muito clara para a questão do "telefone com IA", parece mais que eles têm IA, sistemas e hardware à disposição, e estão testando cada direção, na esperança de que uma delas funcione.

Mas pelo menos o Google deu um bom exemplo de "automação em nível de sistema" para o Android, e muitos novos celulares no futuro têm o potencial de se tornarem "celulares com pãozinho no vapor".

Essa onda pode não se limitar ao universo Android. Não se esqueça que a Apple fez uma parceria com o Google, e o Gemini se tornará o suporte técnico da Siri. Além disso, os Intents e as Funções de Aplicativos são muito semelhantes…

▲ Demonstração da Siri com IA

Olhando um pouco mais para o futuro: os agentes inteligentes Gemini não se limitam apenas a smartphones com IA. Sammer Samat prevê que, no futuro, óculos inteligentes, pingentes com IA e até carros, desde que equipados com Gemini, poderão usá-lo para realizar tarefas complexas — é claro que tais cenários ainda estão longe de se concretizar.

No entanto, o Google só implementou com sucesso a automação por IA no nível técnico. O estabelecimento de um paradigma não significa que os problemas desapareceram. As diversas contradições encontradas pelos celulares Doubao se tornarão desafios que os concorrentes posteriores inevitavelmente enfrentarão.

Em primeiro lugar, existem preocupações com a privacidade e a segurança. A visão do Google é ambiciosa; no futuro, a capacidade de acessar e manipular aplicativos móveis irá além do Gemini. Alguns aplicativos de IA de terceiros poderão se aprofundar no núcleo dos dados do usuário e, se aplicativos maliciosos disfarçados explorarem essas interfaces, isso poderá causar perdas ainda maiores.

▲ Fonte da imagem: 9To5Google

O conflito mais intenso reside na disputa entre fabricantes de hardware para celulares, fornecedores de modelos/agentes inteligentes e grandes plataformas de aplicativos pela nova "entrada" na era da IA. Este foi também o obstáculo mais difícil que o Doubao Phone original teve que superar.

Afinal, usar o Gemini para solicitar uma viagem pode significar que os usuários não verão mais as promoções de adesão e as recomendações de publicidade da Uber, podendo até perder a fidelidade à marca, prejudicando diretamente a receita dos provedores de serviços de aplicativos/indústrias de publicidade.

A China tem seus gigantes da internet/IA, e o mesmo acontece no exterior. Rivais de longa data como Meta e Amazon possuem plataformas e ecossistemas poderosos, e podem não estar dispostos a se abrir para o Google e permitir que o Gemini automatize tudo. Seja por questões de privacidade, segurança ou regras da plataforma, restrições e maiores barreiras de entrada inevitavelmente surgirão, e a competição se intensificará.

O Google, pelo menos, está muito confiante em relação ao futuro. Sammer Samat acredita que a tecnologia de IA já está em desenvolvimento e, em vez de quebrar a cabeça para lutar contra ela, os desenvolvedores deveriam pensar em uma maneira adequada de incorporá-la.

O choque entre o novo e o velho é inevitável, e os grandes vencedores serão aqueles que corajosamente buscarem a mudança na véspera dela.

Referências:

https://android-developers.googleblog.com/2026/02/the-intelligent-os-making-ai-agents.html

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.