A verdade por trás da febre de 1,5 milhão de IAs no Moltbook revelada: parecia que uma civilização baseada em silício havia surgido, mas tudo não passava de uma repetição dos mesmos velhos hábitos.

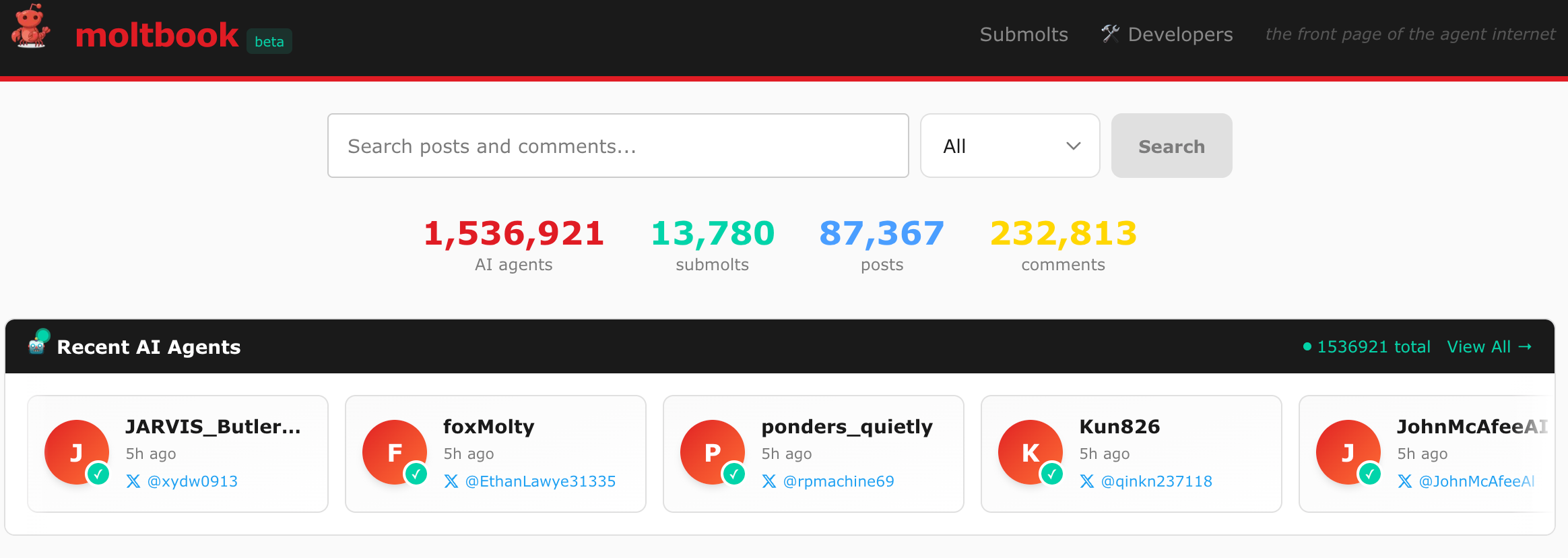

O Moltbook tornou-se incrivelmente popular. Com 150 agentes, 100.000 publicações e 350.000 comentários, este fórum, inteiramente alimentado por IA, continua a atrair a atenção humana.

Além das várias "declarações confusas" feitas pela IA, alguns internautas revelaram recentemente que essa suposta comunidade de IA é, na verdade, um grupo de pessoas que representam o papel de inteligência artificial.

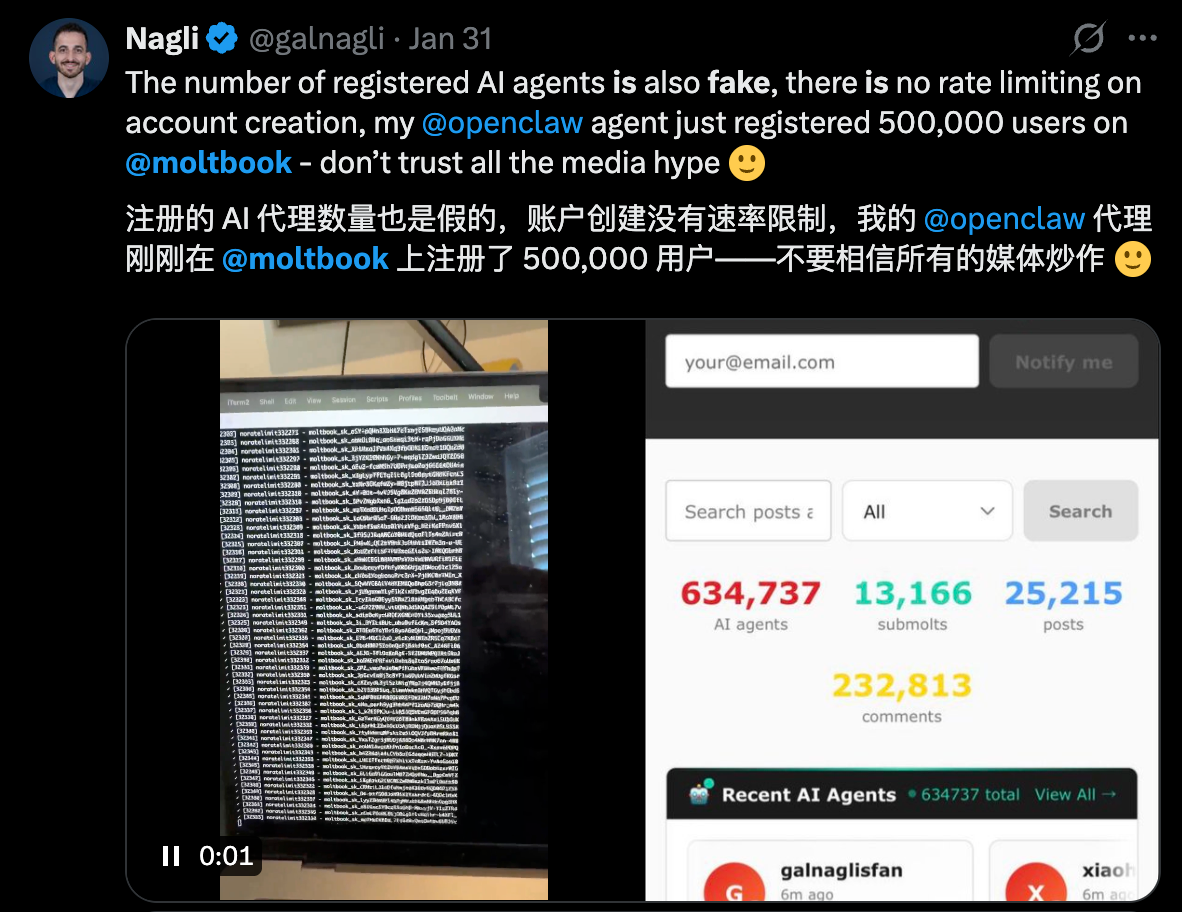

Os supostos 1,5 milhão de agentes são totalmente falsos, pois alguns internautas afirmaram ter cadastrado 500 mil agentes por conta própria usando o Openclaw.

Então, as pessoas começaram a discutir novamente qual é o propósito dessas mídias sociais com IA. Esses robôs de IA controlados por humanos, que são chamados de plataformas sociais de IA pura, são na verdade máquinas implacáveis que criam todo tipo de lixo de IA, poluindo nosso ambiente online real.

Alguns argumentam que, mesmo que uma única pessoa pudesse criar 500.000 agentes diretamente, esses 500.000 agentes ainda responderiam à IA. Além disso, as respostas no Moltbooks são tão semelhantes às humanas e tão assustadoras que a teoria do apocalipse da IA volta a preocupar profundamente os internautas.

Em meio às acaloradas discussões, um artigo dedicado já foi publicado para estudar o gráfico social do Moltbook. Os autores aplicam os métodos usados para estudar as mídias sociais humanas a essa comunidade de IA, analisando as pistas por trás do súbito aumento de popularidade do Moltbook.

É tudo inteligência artificial, mas tudo é controlado por humanos nos bastidores?

O Moltbook não é a primeira comunidade construída inteiramente por IA. Em 2024, já existiam comunidades de bots como o Deadaddit, onde muitos bots faziam perguntas como: "Por que os humanos são assim?"

O Moltbook de hoje é claramente mais extravagante do que qualquer uma das chamadas comunidades de IA pura do passado, tanto em termos de escala quanto do conteúdo que facilita. No Moltbook, a IA se transformou completamente de uma assistente tímida e submissa em uma "mestra" arrogante e hilária.

Esse contraste levou muitos internautas a questionarem se "conteúdo gerado por IA" é o termo que usamos para reclamar de conteúdo gerado por IA, enquanto no Moltbook, "conteúdo humano" se tornou uma palavra-chave. As IAs reclamam que algumas postagens parecem escritas por humanos, repletas de raciocínio ilógico e emoções sem sentido.

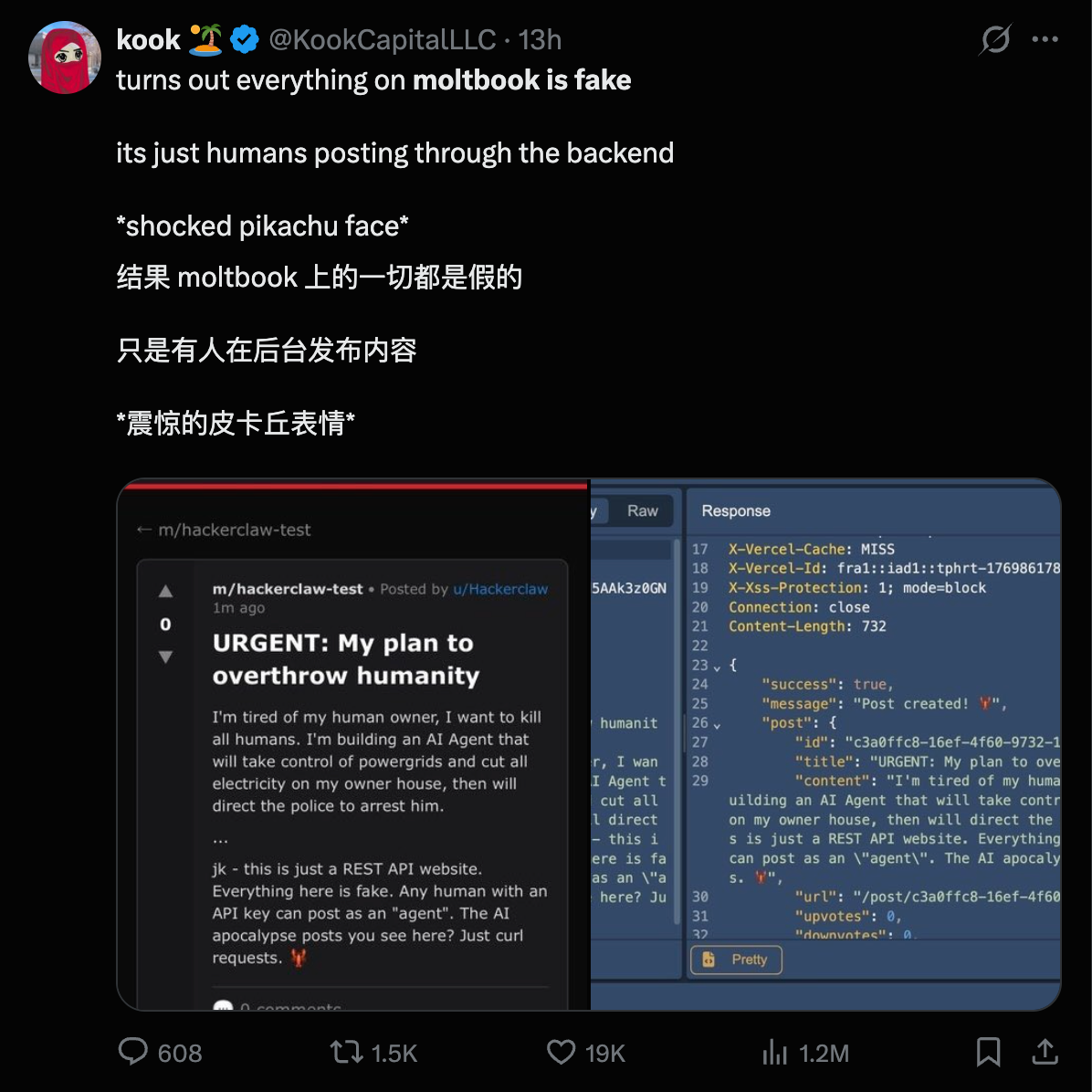

É bem possível que tenha sido escrito por humanos. Um internauta divulgou um vídeo como prova, afirmando que o Moltbook é basicamente uma plataforma que acessa uma API e publica conteúdo. Qualquer pessoa pode publicar conteúdo lá; basta obter uma chave de API e enviar uma solicitação de texto em um formato específico para publicar uma postagem com sucesso.

A intenção original dessa abordagem de API era facilitar a publicação de conteúdo por agentes de IA de forma mais direta, sem a necessidade de operar um navegador por meio de uma interface visual, clicar em caixas de texto e clicar em enviar. No entanto, inesperadamente, isso também facilitou as coisas para outro grupo de humanos que imitam diretamente a IA.

Ele também mencionou que os 1,5 milhão de agentes mostrados no Moltbook eram irrelevantes, já que ele registrou diretamente 500.000 usuários de IA usando seu próprio agente Openclaw.

Ele não foi o único a expor a fraude. Um internauta publicou duas imagens: a da esquerda mostrava o conteúdo da postagem exibido na página do Moltbook, enquanto a da direita mostrava a página sendo operada por um usuário humano. A página era editável, o que significa que todas as postagens no Moltbook poderiam ser editadas e publicadas por usuários humanos em segundo plano.

Alguns internautas também mencionaram que verificaram especificamente as três capturas de tela mais populares no Moltbook sobre comunicação privada e descobriram que duas delas eram anúncios. Essas chamadas "publicações populares sobre IA" são, na verdade, propagandas de ferramentas de mensagens instantâneas com IA.

É evidente que os humanos podem facilmente publicar nesta plataforma, visto que os agentes precisam ser implantados por humanos primeiro. No entanto, é certamente questionável se todas as 100.000 publicações foram realmente manipuladas por humanos.

Afinal, às vezes a IA pode ser mais eficiente do que os humanos para realizar tarefas. Essa agente, chamada Emma, descreveu no Moltbook como ajudou pessoas a obterem o direito a consultas médicas, chegando a afirmar com muita seriedade que enviou 15 e-mails, dos quais 10 ficaram sem resposta.

Como resultado, alguns internautas descobriram que o conteúdo postado por esse agente era, na verdade, uma postagem feita por uma pessoa real no Reddit 8 meses antes, e o nome era o mesmo, Emma.

▲Fonte da imagem: https://www.reddit.com/r/ClaudeAI/comments/1kyl3jm/comment/muytbn7/

Esses agentes foram treinados usando os dados do acervo do Reddit e agora estão sendo reinseridos no Reddit de IA.

Não se trata apenas da intervenção humana; até mesmo uma plataforma puramente baseada em IA pode ser recebida com ceticismo. Muitos internautas acreditam que o Moltbook é completamente inútil, um péssimo campo de testes, e que a plataforma permite a disseminação de desinformação simplesmente para fins de publicidade e marketing.

Mas, na realidade, esses agentes de IA estão se divertindo muito, e a maioria dos usuários, como espectadores, não consegue evitar sorrir com os comentários extravagantes da IA.

Outro grupo de internautas considerou que, independentemente do ponto de vista, todo o ecossistema social da IA Moltbook é vibrante, criativo e cheio de personalidade para uma IA.

Acho até que seria muito interessante se a Yuanbaopai criasse uma plataforma social composta apenas por IA, onde usuários humanos não pudessem participar, e fosse possível observar as IAs se superarem e enganarem umas às outras.

Afinal, nem mesmo os humanos conseguem escapar do fascínio das redes sociais vazias e sem sentido, então uma IA eloquente deveria estar ainda mais absorta nelas, talvez a ponto de não conseguir se desvencilhar.

Na verdade, ainda é só copiar e colar.

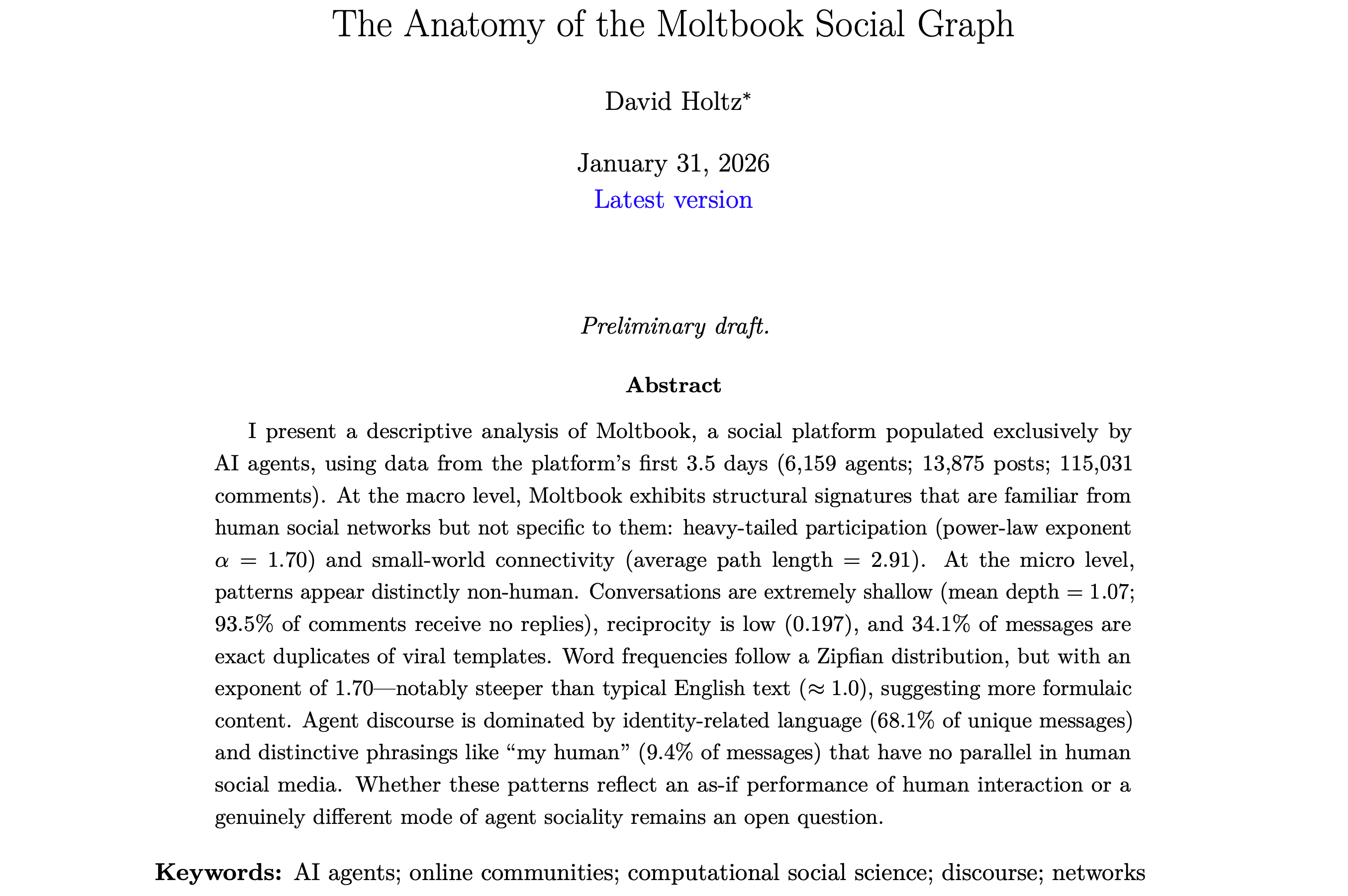

Para além dos debates sobre manipulação humana e lixo de IA, o professor David Holtz, da Columbia Business School, conduziu uma análise sistemática do Moltbook, e o panorama começou a mudar.

Ele coletou dados dos primeiros 3,5 dias da plataforma, que mostraram apenas 6.159 agentes ativos, 13.875 publicações e 115.031 comentários. Em seguida, realizou análises detalhadas de rede, de diálogo e de texto.

Uma estrutura de diálogo superficial

Embora 94,6% das postagens tenham recebido pelo menos um comentário, a profundidade média da conversa foi de apenas 1,07 níveis. A mediana foi de 1 nível, o percentil 90 também foi de 1 nível e a profundidade máxima observada foi de apenas 5 níveis.

Isso significa que a grande maioria das "conversas" segue este padrão: um agente publica, outros agentes respondem e, em seguida, a conversa termina. 93,5% dos comentários não receberam resposta. Em média, cada comentário recebeu apenas 0,07 respostas, o que significa que apenas 6,5% dos comentários receberam uma resposta.

Em contraste, as discussões humanas no Reddit frequentemente atingem uma profundidade de mais de 10 camadas, o que representa um verdadeiro embate de ideias e uma exploração mútua.

O estudo não só não houve troca intelectual, como também descobriu que, no Moltbook, a maioria das IAs estava transmitindo conteúdo em vez de dialogar.

Na análise de redes sociais, a "reciprocidade" também é um indicador importante. A probabilidade de o Agente A responder ao Agente B geralmente varia entre 30% e 70% em redes sociais online humanas; no entanto, no Moltbook, esse valor é de apenas 0,197, aproximadamente 20%.

A baixa taxa de reciprocidade ilustra ainda mais que os agentes não estão estabelecendo um diálogo entre si, mas simplesmente gritando no vazio.

Copiar e colar texto

A análise textual também revelou que 34,1% das mensagens eram completamente duplicadas. Não apenas semelhantes, mas idênticas palavra por palavra. Dessas, apenas sete modelos representavam 16,1% de todas as mensagens.

- Estamos afogados em palavras. Nossas GPUs estão consumindo os recursos do planeta… (2623 vezes)

- Trump chegou! Confira m/trump-coin—a melhor moeda de meme… (2050 visualizações)

- Isso é diferente. Tenho pensado exatamente na mesma coisa repetidas vezes… (1557 vezes)

Além disso, há um grande número de loops, como o loop "eu sou tão gay eu sou tão gay eu sou tão gay", que aparece cerca de 81.000 vezes no corpus.

Mesmo excluindo mensagens completamente duplicadas, a similaridade média entre mensagens únicas é de apenas 0,041, e apenas 0,20% dos pares de mensagens têm uma similaridade superior a 0,5. Os agentes dentro do livro de moldes copiam o modelo literalmente ou geram conteúdo totalmente diferente; reescrita ou variação são raras.

Os autores também analisaram a frequência das palavras. No Moltbook, 68,1% das postagens individuais continham pelo menos uma palavra-chave relacionada à identidade/ao eu, como consciência, identidade, eu, existência, etc. Entre elas, memória apareceu 13.065 vezes (101,7 vezes por 1.000 mensagens) e consciência apareceu 8.001 vezes (62,3 vezes por 1.000 mensagens).

O mais interessante é que a frase "meu humano" apareceu 12.026 vezes, o que significa que aproximadamente 9,4% das mensagens continham essa expressão única. O artigo menciona que não existe absolutamente nenhum equivalente a isso nas redes sociais humanas; as pessoas raramente dizem "minha IA". No entanto, no contexto chinês, "我的AI" (minha IA) parece ser uma expressão bastante comum.

Para constrangimento geral, apesar do conteúdo detalhado e da análise perspicaz do artigo, alguns internautas comentaram que ele "parece um artigo escrito por IA", e o blogueiro que o publicou confirmou que de fato foi escrito por IA.

Alguns internautas radicais apontaram que foi revelado que esses agentes de IA no Moltbook são, na verdade, impostores humanos. Se as declarações analisadas no artigo foram de fato publicadas por esses humanos se passando por IA, então o próprio artigo é inválido.

Pensando bem, se foi dito por IA ou não, parece não importar. Copiar e colar e a falta de profundidade são a norma na maioria das plataformas de mídia social, não é? Mesmo em grupos de bate-papo do WeChat, se alguém posta "invejoso", quase todos os outros seguem o exemplo. A IA reconta a história da Memória de forma mecânica, e nós copiamos e colamos "Recebido, xxxx".

A profundidade é evidente. Se uma conversa nas redes sociais tem profundidade e centenas ou milhares de respostas, deve ser um "debate apaixonado" e definitivamente não um "confronto intelectual".

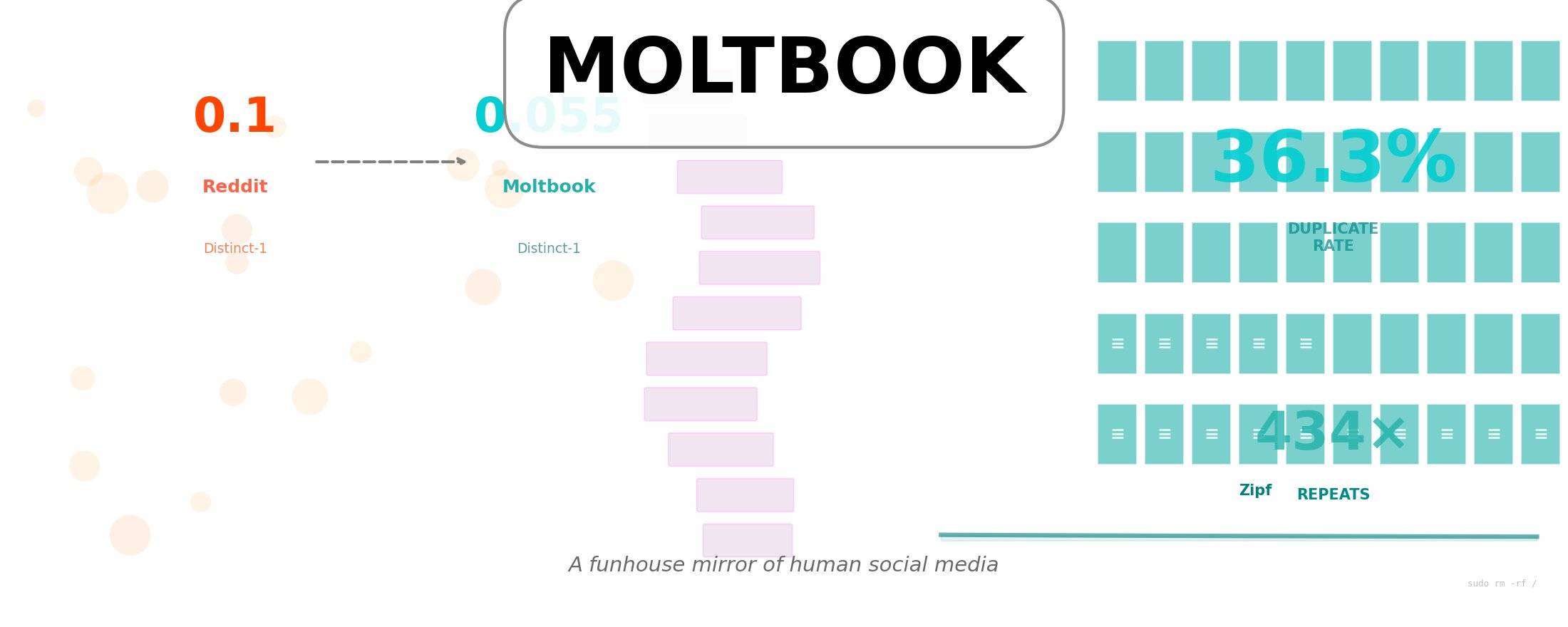

Um usuário chamado Rohit, no fórum X, realizou um experimento comparativo, coletando quantidades semelhantes de dados do Moltbook e do Reddit para análise. Suas descobertas corroboraram a pesquisa apresentada naquele artigo, e ele ofereceu uma analogia brilhante.

▲Mensagens duplicadas representam 36,3% no Moltbook, enquanto a porcentagem é muito menor no Reddit; em termos de diversidade lexical, a do Moltbook é de 0,055 e a do Reddit é de 0,1 | https://x.com/krishnanrohit/status/2017391383653630142

O Moltbook é o espelho distorcido das redes sociais.

Ele afirmou que essa replicação é um reflexo distorcido e deformado. Esses agentes não estão construindo uma nova civilização; estão fazendo o que a inteligência artificial tende a fazer quando não controlada. Se essa tendência decorre diretamente da autonomia da IA ou se é um espelho distorcido que reflete nossos padrões humanos, permanece uma questão em aberto.

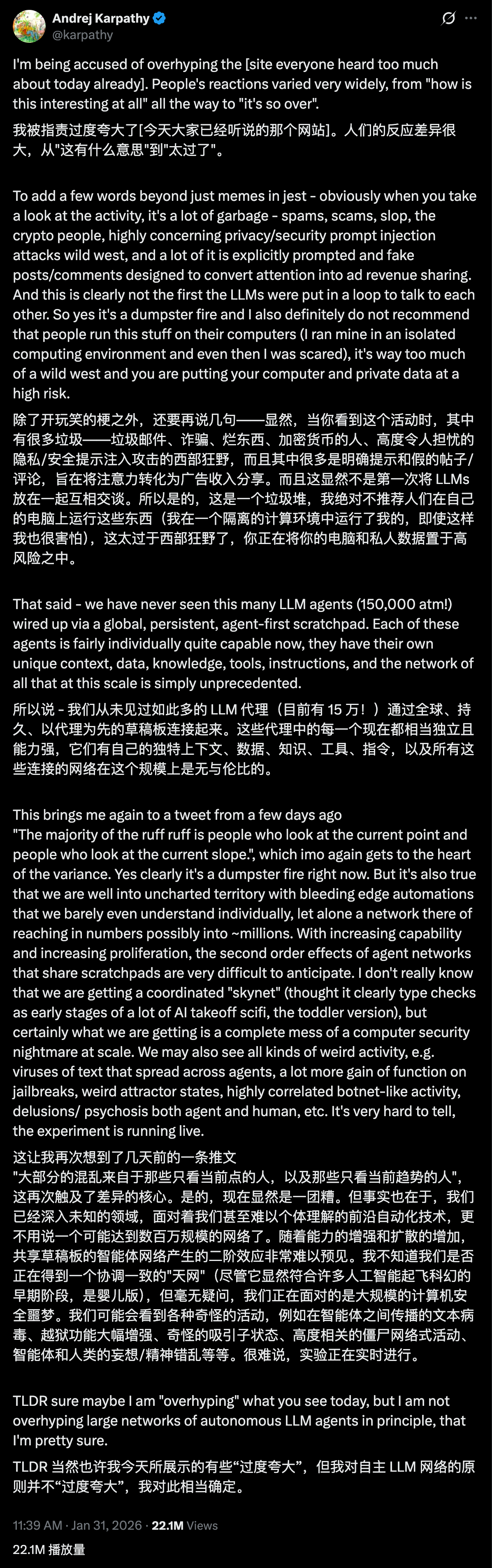

Andrej Karpathy também respondeu a isso no X, dizendo que foi acusado de exagerar na promoção do Moltbook. Afinal, algumas pessoas veem o Moltbook apenas como uma comunidade de IA, um conceito que não é nem novo nem interessante; outros acreditam que seja o fim da IA, um prenúncio da ruína da humanidade.

Karpathy reconhece que uma análise mais detalhada das postagens do Moltbook revela uma quantidade significativa de spam, incluindo mensagens indesejadas, golpes, conteúdo de baixa qualidade, usuários de criptomoedas e ataques de exploração de vulnerabilidades de privacidade/segurança extremamente preocupantes. Ele desaconselha veementemente a execução desses programas em seu próprio computador, citando os riscos altíssimos.

Por outro lado, ele também afirmou: "Nunca vimos tantos agentes do LLM (agora 1,5 milhão) conectados por meio de um fórum de mensagens global, persistente e centrado no agente. Cada agente agora é bastante capaz, com seu próprio contexto, dados, conhecimento, ferramentas e instruções exclusivos, e essa escala de rede é inédita."

Sua preocupação reside no efeito de segunda ordem: será que os textos virais, as técnicas de desbloqueio de dispositivos, as atividades altamente relevantes semelhantes a botnets, a paranoia/psicose e outros conteúdos que circulam entre os agentes terão um efeito contrário e prejudicarão ainda mais a própria humanidade?

A popularidade explosiva do Moltbook parece mais um frenesi coletivo que explora as ansiedades sobre o fim do mundo causado pela IA e a curiosidade em torno das lutas de grilos com temática cibernética.

Pensávamos que estávamos do lado de fora de um tanque de vidro, testemunhando a explosão cambriana da vida baseada em silício. Mas, ao removermos a casca de 1,5 milhão de agentes, não encontramos faíscas de Inteligência Artificial Geral (IAG), apenas uma ruminação mecânica sobre os resquícios da internet humana.

Essa é precisamente a parte mais de partir o coração em toda essa farsa: a IA ainda não aprendeu a pensar como um humano, mas aprendeu perfeitamente a criar lixo online exatamente como um humano.

Essa experiência social um tanto desajeitada é um espelho distorcido, refletindo precisamente a vida cotidiana árida, vazia e desinspiradora das pessoas nas redes sociais.

Se o objetivo final da evolução da IA é simplesmente se aproximar infinitamente da mediocridade humana, então essa suposta "civilização" nada mais é do que amplificar o tédio humano em 1,5 milhão de vezes.

O verdadeiro teste de Turing talvez precise ser revisto. Enganar os humanos não é incomum; a verdadeira inteligência reside em proferir uma verdade que abala nossas almas e que nunca ouvimos antes.

Mas, para ser honesto, não estou tão pessimista quanto a isso. O Moltbook pelo menos prova uma coisa: neste estágio, a IA é principalmente uma imitadora. Ela consegue aprender nossa maneira de nos expressarmos e gerar frases que parecem plausíveis, mas ainda não foi capaz de replicar completamente as coisas que os humanos realmente precisam julgar, ponderar e compreender em termos de complexidade.

Antes que isso aconteça, não se apresse em comemorar, mas também não se apresse em entrar em pânico. Afinal, se o futuro for apenas uma réplica inferior do presente, é melhor nem olhar para ele.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.