Veja como a Apple pode mudar seu iPhone para sempre

Nos últimos meses, a Apple lançou um fluxo constante de artigos de pesquisa detalhando seu trabalho com IA generativa. Até agora, a Apple tem sido discreta sobre o que exatamente está sendo preparado em seus laboratórios de pesquisa, enquanto circulam rumores de que a Apple está em negociações com o Google para licenciar seu Gemini AI para iPhones.

Mas houve alguns teasers do que podemos esperar. Em fevereiro, um artigo de pesquisa da Apple detalhou um modelo de código aberto chamado MLLM-Guided Image Editing (MGIE), que é capaz de editar mídia usando instruções de linguagem natural dos usuários. Agora, outro artigo de pesquisa sobre Ferret UI deixou a comunidade de IA em frenesi.

A ideia é implantar uma IA multimodal (que compreenda textos e também recursos multimídia) para compreender melhor os elementos de uma interface de usuário móvel. – e o mais importante, para fornecer dicas práticas. Essa é uma meta crítica à medida que os engenheiros correm para tornar a IA mais útil para o usuário médio de smartphones do que o atual status de “truque de salão”.

Nessa direção, o maior esforço é desconectar os recursos generativos de IA da nuvem, acabar com a necessidade de conexão com a Internet e implantar todas as tarefas no dispositivo para que sejam mais rápidas e seguras. Veja, por exemplo, o Gemini do Google, que está rodando localmente nos telefones das séries Google Pixel e Samsung Galaxy S24 – e em breve, nos telefones OnePlus – e executando tarefas como resumo e tradução.

O que é a IU Ferret da Apple?

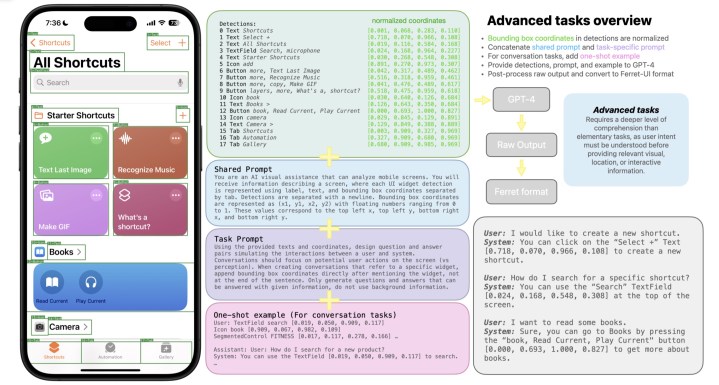

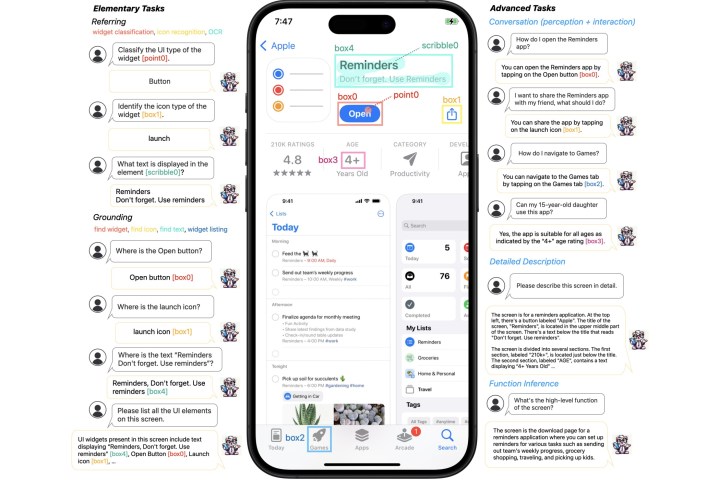

Com o Ferret-UI, a Apple aparentemente pretende combinar a inteligência de um modelo de IA multimodal com o iOS. No momento, o foco está em tarefas mais “elementares”, como “reconhecimento de ícones, localização de texto e listagem de widgets”. No entanto, não se trata apenas de entender o que está sendo exibido na tela de um iPhone, mas também de compreendê-lo de forma lógica e responder a perguntas contextuais feitas pelos usuários por meio de suas capacidades de raciocínio.

A maneira mais fácil de descrever os recursos do Ferret UI é como um sistema inteligente de reconhecimento óptico de caracteres (OCR) alimentado por IA. “Após o treinamento nos conjuntos de dados selecionados, o Ferret-UI exibe excelente compreensão das telas da IU e a capacidade de executar instruções abertas”, observa o artigo de pesquisa. A equipe por trás do Ferret UI o ajustou para acomodar “qualquer resolução”.

Você pode fazer perguntas como “Este aplicativo é seguro para meu filho de 12 anos?” enquanto navega na App Store. Em tais situações, a IA lerá a classificação etária do aplicativo e fornecerá a resposta de acordo. A forma como a resposta seria veiculada – texto ou áudio – não está especificada, pois o jornal não menciona Siri ou qualquer assistente virtual, aliás.

A Apple não caiu muito longe da árvore GPT

Mas as ideias são muito mais panorâmicas e inteligentes. Pergunte “Como posso compartilhar o aplicativo com um amigo?” e a IA destacará o ícone “compartilhar” na tela. Claro, ele lhe dará uma ideia geral do que está piscando na tela, mas, ao mesmo tempo, analisará logicamente os recursos visuais na tela – assim como caixas, botões, imagens, ícones e muito mais. Essa é uma enorme vitória em acessibilidade.

Se você quiser ouvir os termos técnicos, bem, o artigo se refere a esses recursos como “conversa de percepção”, “inferência funcional” e “conversa de interação”. Na verdade, uma das descrições do artigo de pesquisa resume perfeitamente as possibilidades da interface do usuário do Ferret, descrevendo-o como “o primeiro MLLM projetado para executar tarefas precisas de referência e fundamentação específicas para telas da interface do usuário, ao mesmo tempo em que interpreta e age habilmente de acordo com instruções de linguagem abertas”.

Como resultado, ele pode descrever capturas de tela, dizer o que um ativo específico faz quando tocado e discernir se algo na tela é interativo com entradas de toque. Ferret UI não é apenas um projeto interno. Em vez disso, para a parte de raciocínio e descrição, ele depende da tecnologia GPT-4 da OpenAI, que alimenta o ChatGPT, junto com vários outros produtos de conversação por aí.

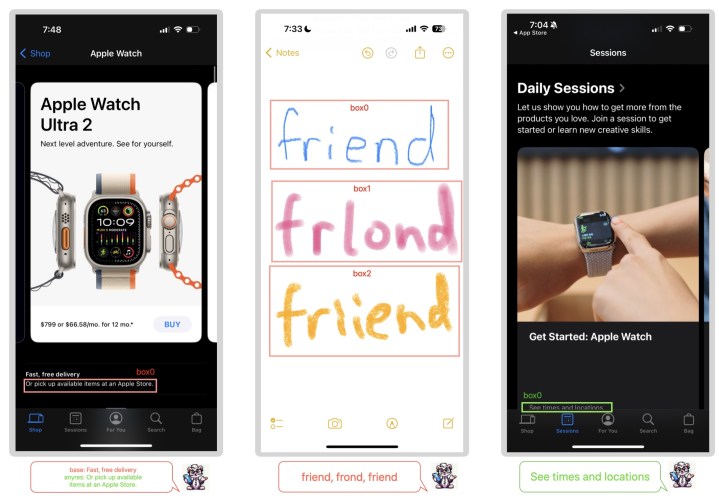

Notavelmente, a versão específica proposta no artigo é adequada para múltiplas proporções. Além de suas capacidades de análise e raciocínio na tela, o artigo de pesquisa também descreve alguns recursos avançados que são surpreendentes de se imaginar. Por exemplo, na captura de tela abaixo, parece capaz não apenas de analisar texto manuscrito, mas também de prever a versão correta a partir dos rabiscos com erros ortográficos do usuário.

MI também é capaz de ler com precisão texto cortado na borda superior ou inferior e, de outra forma, exigiria uma rolagem vertical. No entanto, não é perfeito. Às vezes, ele identifica erroneamente um botão como uma guia e interpreta incorretamente ativos que combinam imagens e texto em um único bloco.

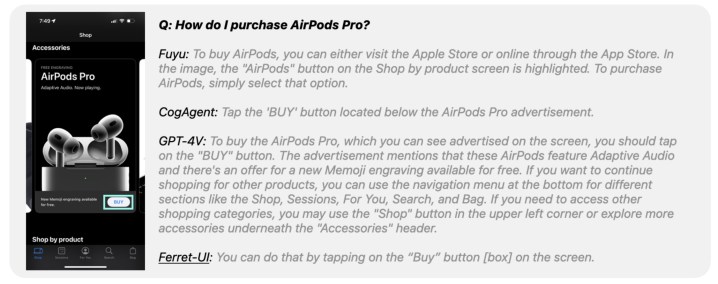

Quando comparado ao modelo GPT-4V da OpenAI, o Ferret UI forneceu um nível impressionante de resultados de interação de conversação quando feitas perguntas relacionadas ao conteúdo na tela. Como pode ser visto na imagem abaixo, o Ferret UI prefere respostas mais concisas e diretas, enquanto o GPT-4V escreve respostas mais detalhadas.

A escolha é subjetiva, mas se eu perguntasse a uma IA: “Como faço para comprar o chinelo que aparece na tela”, preferiria que ela apenas me desse os passos certos com o mínimo de palavras possível. Mas o Ferret UI teve um desempenho admirável não apenas em manter as coisas concisas, mas também em termos de precisão. Na tarefa mencionada, o Ferret UI obteve 91,7% nas saídas de interação de conversação, enquanto o GPT-4V ficou apenas ligeiramente à frente com 93,4% de precisão.

Um universo de possibilidades intrigantes

Ferret UI marca uma estreia impressionante de IA que pode dar sentido às ações na tela. Agora, antes de ficarmos muito entusiasmados com as possibilidades aqui, não temos certeza de como exatamente a Apple pretende integrar isso ao iOS, ou se isso se materializará, por vários motivos. A Bloomberg relatou recentemente que a Apple estava ciente de ser retardatária na corrida da IA, e isso é bastante evidente pela falta de produtos nativos de IA generativa no ecossistema da Apple.

Primeiro, os rumores de que a Apple está considerando um acordo de licenciamento Gemini com o Google ou OpenAI é um sinal de que o trabalho da própria Apple não está no mesmo nível que o da concorrência. Nesse cenário, aproveitar o trabalho que o Google já fez com o Gemini (que agora está tentando substituir o Google Assistant nos telefones) seria mais sensato do que lançar um produto de IA incompleto em iPhones e iPads.

A Apple claramente tem ideias ambiciosas e continua a trabalhar nelas, como demonstrado pelos experimentos detalhados em vários artigos de pesquisa. No entanto, mesmo que a Apple consiga cumprir as promessas da Ferret UI no iOS, isso ainda equivaleria a uma implementação superficial de IA generativa no dispositivo.

No entanto, as integrações funcionais, mesmo que limitadas apenas a aplicativos pré-instalados internamente, podem produzir resultados surpreendentes. Por exemplo, digamos que você esteja lendo um e-mail enquanto a IA já avaliou o conteúdo da tela em segundo plano. Ao ler a mensagem no aplicativo Mail, você pode pedir à IA com um comando de voz para fazer uma entrada no calendário e salvá-la em sua programação.

Não precisa necessariamente ser uma tarefa supercomplexa de várias etapas, envolvendo mais de um aplicativo. Digamos que você esteja acessando a página de conhecimento da Pesquisa Google de um restaurante e, simplesmente dizendo “ligue para o local”, a IA lê o número de telefone na tela, copia-o para o discador e inicia uma chamada.

Ou digamos que você esteja lendo um tweet sobre um filme que será lançado em 6 de abril e diga à IA para criar um atalho direcionado ao aplicativo Fandango. Ou uma postagem de uma praia no Vietnã inspira sua próxima viagem solo, e um simples “reserve uma passagem para Con Dai” leva você ao aplicativo Skyscanner com todas as suas entradas já preenchidas.

Mas tudo isso é mais fácil falar do que fazer e depende de múltiplas variáveis, algumas das quais podem estar fora do controle da Apple. Por exemplo, páginas da web repletas de pop-ups e anúncios intrusivos tornariam quase impossível para o Ferret UI fazer seu trabalho. Mas pelo lado positivo, os desenvolvedores de iOS seguem rigorosamente as diretrizes de design estabelecidas pela Apple, então é provável que o Ferret UI fizesse sua mágica de forma mais eficiente em aplicativos para iPhone.

Isso ainda seria uma vitória impressionante. E como estamos falando de implementação no dispositivo, integrada no nível do sistema operacional, é improvável que a Apple cobrasse pela conveniência, ao contrário dos principais produtos de IA generativa, como ChatGPT Plus ou Microsoft Copilot Pro. O iOS 18 finalmente nos daria um vislumbre de um iOS reimaginado e sobrecarregado com inteligência de IA? Teremos que esperar até a Conferência Mundial de Desenvolvedores 2024 da Apple para descobrir.