Twitter revela que abandonou o cultivo de IA devido ao preconceito racial e de gênero

A primeira vez que ouvimos a ideia de que o algoritmo de corte de imagens do Twitter pode ter alguns preconceitos foi em setembro de 2020. O engenheiro criptográfico Tony Arcieri carregou duas imagens apresentando o líder da maioria no Senado, Mitch McConnell e o ex-presidente Barack Obama, e a IA cortada no rosto de McConnell nas duas vezes .

Quando a polêmica finalmente atingiu o pessoal do Twitter, a empresa prometeu analisar seu modelo. Finalmente, podemos ler essas descobertas.

Twitter compartilha os resultados de sua análise de algoritmo

No início de maio, o Twitter finalmente lançou visualizações de imagens em tamanho real em seus cronogramas móveis. Uma postagem no blog do Twitter revelou que o aplicativo cancelou seu algoritmo de corte de imagens depois que uma análise mostrou que ele tinha preconceitos de raça e gênero.

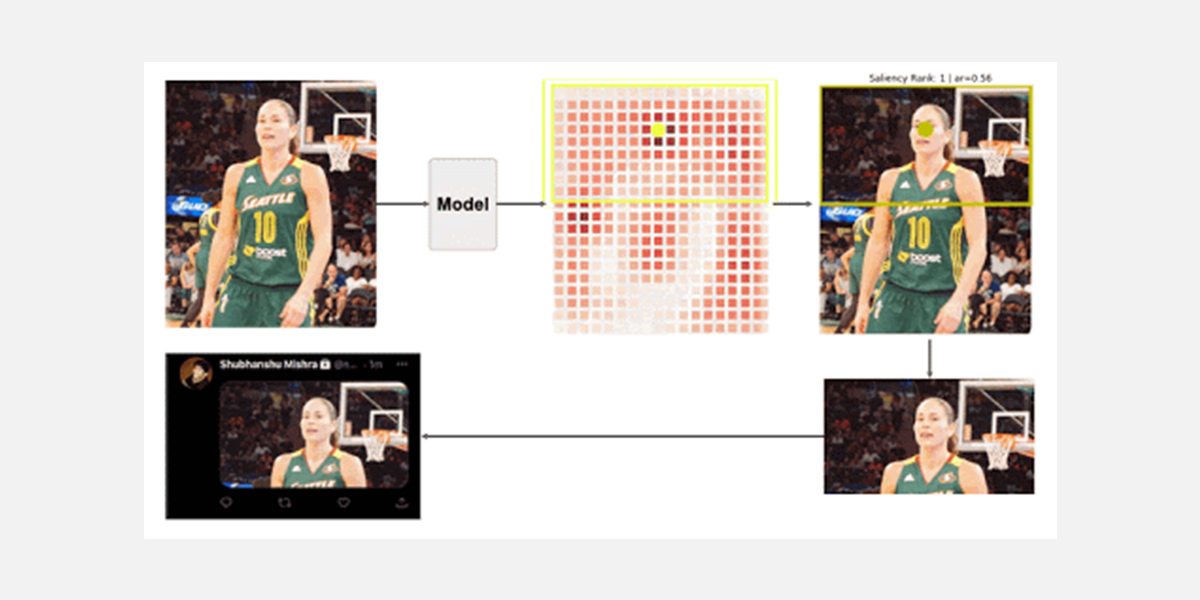

A plataforma começou a usar um algoritmo de saliência em 2018 para cortar suas imagens. O Twitter diz que os modelos de saliência são treinados em dados de rastreamento do olho humano, que são então usados pelo algoritmo para estimar quais assuntos / elementos na imagem ele acredita serem mais importantes para a maioria das pessoas.

O algoritmo então apresentaria uma pontuação de saliência para todas as partes da imagem antes de escolher o ponto com a pontuação mais alta para ser o centro do corte.

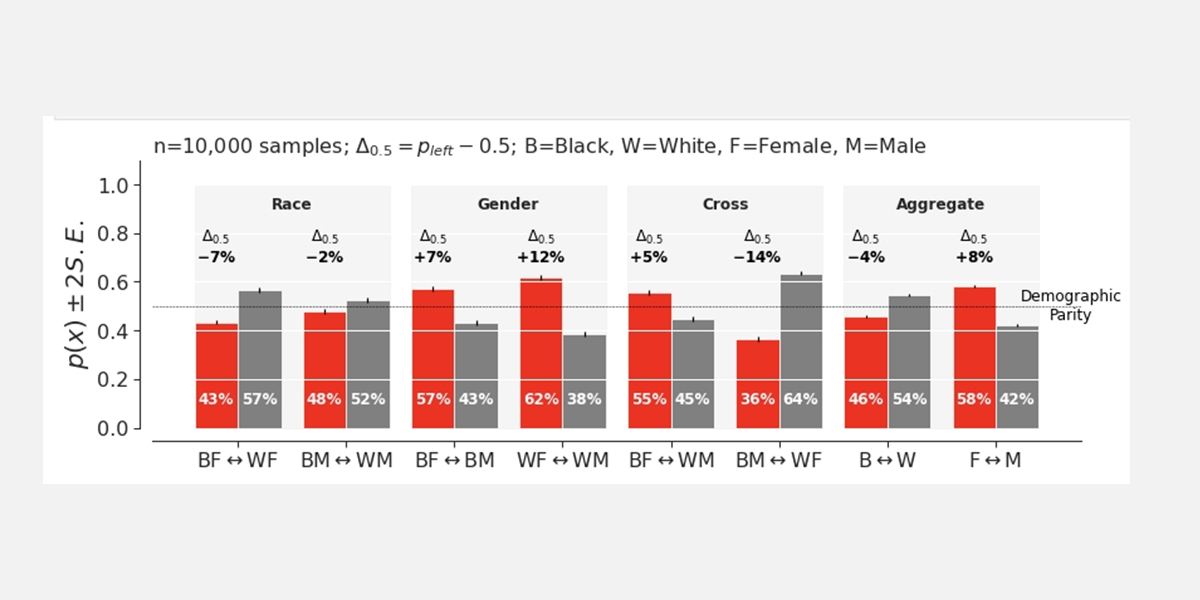

Depois de executar um teste quantitativo para verificar possíveis vieses, a equipe descobriu que o algoritmo de saliência parecia favorecer as mulheres em relação aos homens e os brancos em relação aos negros.

O Twitter também testou o algoritmo para o "olhar masculino", mas nenhuma evidência de viés de objetificação foi encontrada.

Mesmo se o algoritmo de saliência fosse ajustado para refletir a igualdade perfeita entre os subgrupos de raça e gênero, nós [Twitter] nos preocupamos com o dano representacional do algoritmo automatizado quando as pessoas não têm permissão para se representar como desejam na plataforma. A saliência também contém outros danos potenciais além do escopo desta análise, incluindo insensibilidade às nuances culturais.

Ao considerar as compensações entre a velocidade e a consistência do corte automatizado e seus riscos, o Twitter diz que sua equipe percebeu que como cortar uma imagem é uma decisão melhor tomada por pessoas, não algoritmos.

Twitter se livra do corte automático de imagens

O Twitter não usa mais o algoritmo de saliência e agora exibe fotos de proporção padrão na íntegra no iOS e no Android. Ao elaborar um tweet, você descobrirá que a nova atualização também inclui uma visualização real das imagens carregadas, para que você saiba como tudo ficará depois de publicado.

Se você estiver interessado em ler o artigo acadêmico do estudo, pode encontrá-lo em arXiv.org . Você também pode encontrar o código do Twitter para a análise no GitHub .