Sob a onda do DeepSeek, o catalisador de inovação da IA final

Há uma história metafórica sobre a caverna em "A República" de Platão. Um grupo de prisioneiros foi trancado em uma caverna desde a infância, de frente para a parede, com um fogo atrás deles. Os prisioneiros só viram sombras refletidas na parede ao longo de suas vidas, e pensaram que essas sombras eram o mundo real.

Grandes modelos também foram enganados por "sombras" semelhantes e já consideraram o pré-treinamento que pode produzir milagres como a norma. Até as capacidades de raciocínio demonstradas pelo DeepSeek R1 no início de 2025, a IA passou do estágio de apenas observar sombras para explorar o verdadeiro conhecimento de maneira introspectiva e dialética.

DeepSeek permite que modelos saiam da “caverna” e também está mudando o paradigma dos terminais inteligentes.

O modelo de destilação DeepSeek foi implementado em terminais comerciais equipados com a plataforma Snapdragon em menos de duas semanas após seu lançamento. O hardware de IA não será mais apenas uma “história sexy” para aumentar a avaliação, mas já possui valor de aplicação real e potencial comercial.

O último white paper da Qualcomm, "A transformação da IA está promovendo a inovação na inferência no lado do terminal", destaca que o lançamento do DeepSeek marca a entrada da IA na era da inovação em inferência.

Liu Zhiyuan, professor associado da Universidade de Tsinghua e cofundador e cientista-chefe da Wall-Facing Intelligence, também propôs que essa mudança de "escala em primeiro lugar" para "eficiência em primeiro lugar" fornece uma inspiração importante para a IA no dispositivo: por meio da compressão do modelo, otimização de parâmetros e inovação de algoritmos, é possível reduzir significativamente os requisitos de recursos de computação, mantendo o desempenho do modelo, tornando-o adequado para execução em dispositivos terminais.

O modelo Qwen-7B destilado usando DeepSeek foi capaz de funcionar no mesmo nível do modelo de nuvem GPT-4o mais avançado lançado no ano passado.

Isso também significa que muitos modelos que no passado só podiam executar parâmetros em grande escala na nuvem podem ser implantados em dispositivos terminais portáteis para completar processos de raciocínio complexos localmente e podem até mesmo funcionar em plena capacidade. Ao mesmo tempo, sob a nova onda de IA no dispositivo, estamos testemunhando outra transição importante em terminais inteligentes – de dispositivos puramente funcionais para agentes com compreensão autônoma e capacidades de ação.

O ponto de inflexão tecnológica da IA no dispositivo: da “escala em primeiro lugar” à “era da inovação de inferência”

Há dois anos, Bill Gates publicou um blog dizendo que testemunhou duas demonstrações revolucionárias em sua vida. A primeira foi em 1980, quando viu a interface gráfica do usuário (GUI), o antecessor dos sistemas operacionais modernos, e a outra foi quando viu a forma como a IA respondia alguns meses antes do GPT-3.5.

No entanto, como usuários comuns, a percepção dessa mudança obviamente não é tão forte, porque o portador de mudanças interativas não pode ser separado dos terminais inteligentes, assim como o iPhone transformou as operações de botão na era do feature phone em interação por toque, remodelando assim todo o ecossistema do smartphone.

Então, qual é essa operadora na era da IA?

Talvez não seja necessariamente uma nova forma de terminal, mas uma nova forma de experiência trazida pelos terminais inteligentes – desde orientada por aplicação até orientada por agente.

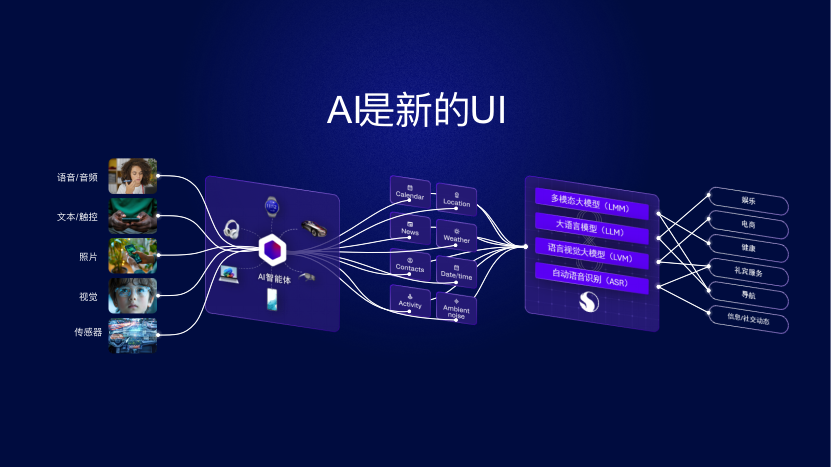

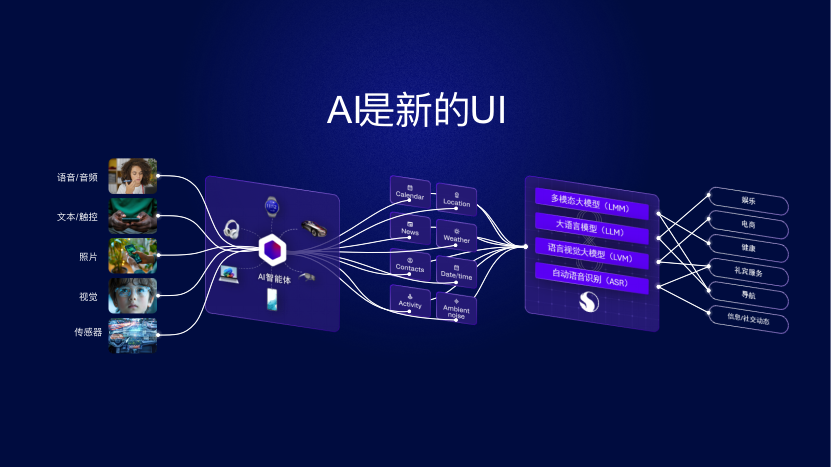

Assim como a nova tendência mencionada pelo CEO da Qualcomm, Anmon, no final do ano passado, a IA é a nova interface de usuário (IU). A implementação da IA final mudará a lógica de interação tradicional.

O usuário não precisa abrir um aplicativo específico, e o agente de IA pode executar tarefas diretamente por meio de entrada multimodal (voz, imagem, vídeo). Na verdade, essas funções são inseparáveis do suporte de IA de ponta.

Por exemplo, muitas funções interativas do agente YOYO na série Honor Magic7 requerem o suporte de recursos de processamento de IA no lado do terminal. O Qualcomm Hexagon NPU equipado com o Snapdragon 8 Extreme Edition fornece poder de computação de IA suficiente para o lado do terminal concluir tarefas de IA, como raciocínio e compreensão localmente no telefone.

No passado, a IA do lado do dispositivo era limitada pelo desempenho do hardware, mas os requisitos de computação para modelos grandes estão crescendo rapidamente. Embora os smartphones equipados com Snapdragon 8 Extreme Edition tenham sido capazes de executar modelos em escala 7B no dispositivo, alguns casos de uso e tarefas complexas de IA generativa, como geração de imagens de alta qualidade, ainda precisam ser combinados com o poder da computação em nuvem.

No entanto, o ponto de inflexão técnica da IA do lado do dispositivo apareceu agora. O white paper "A transformação da IA está promovendo a inovação do raciocínio do lado do terminal" aponta quatro tendências principais para acelerar a implementação da IA do lado do dispositivo:

- Os atuais pequenos modelos avançados de IA já apresentam excelente desempenho. Através da destilação de modelos e da nova arquitetura de rede, o desempenho superou os modelos maiores que só podiam ser executados na nuvem há um ano.

- Os tamanhos dos parâmetros do modelo estão diminuindo rapidamente, e técnicas avançadas de quantização e remoção permitem que os desenvolvedores reduzam o tamanho do modelo, mantendo a precisão.

- Os desenvolvedores podem criar aplicações mais ricas na borda, como resumo de texto, assistentes de programação e tradução em tempo real

- Deixe o Agent se tornar um novo portal de interação, e agentes de IA multimodais personalizados simplificarão a interação

Ma Dejia, vice-presidente sênior e gerente geral de planejamento de tecnologia e negócios de soluções de ponta da Qualcomm Technologies, disse ao iFaner que, à medida que a escala do modelo continua a diminuir, os modelos com escala de parâmetros de 1 a 2 bilhões no futuro ocuparão menos memória operacional e se adaptarão melhor a terminais com configurações de memória de 8 a 12 GB.

Arquitetura de computação heterogênea: a base de hardware da IA final

A Qualcomm Technologies possui três unidades de processador líderes do setor, que são muito importantes para o desenvolvimento da IA final.

Ma Dejia disse: “Temos CPUs Qualcomm Oryon personalizadas líderes do setor e as aplicamos em nossas plataformas de PC, móveis e automotivas”.

A GPU Qualcomm Adreno pode atender aos muitos requisitos funcionais necessários para a operação de IA no terminal. Além disso, o Qualcomm Hexagon NPU foi totalmente projetado para lidar com cargas de trabalho generativas de IA;

Essas três principais unidades de processador devem ter capacidades líderes do setor e ser capazes de trabalhar juntas para alcançar computação heterogênea e atender às necessidades de desenvolvimento de IA generativa. A Qualcomm tem uma vantagem muito forte nesta área.

A implementação da IA do lado do terminal apresentou requisitos mais elevados para a arquitetura de chips. A abordagem da Qualcomm é integrar NPU, GPU e CPU na arquitetura de computação heterogênea do terminal, produzindo assim maior poder de computação com menor consumo de energia e atendendo às necessidades de tarefas de processamento de IA em diferentes cenários.

O núcleo desta arquitetura é a colaboração entre as três principais unidades de processador, como uma orquestra sinfônica:

- CPU Oryon desenvolvida pela Qualcomm: A CPU Oryon de segunda geração mais recente usa o processo de 3 nm da TSMC, com uma frequência principal máxima de 4,32 GHz e um design de cache grande (o maior cache L2 de 24 MB do setor) para reduzir significativamente a latência de inferência de IA.

- GPU Qualcomm Adreno: atende aos diversos requisitos funcionais para operações de IA no terminal e tem um desempenho particularmente bom em computação paralela e processamento de imagens.

- Qualcomm Hexagon NPU: Projetado especificamente para lidar com cargas de trabalho generativas de IA, permitindo que o Snapdragon 8 Extreme Edition alcance uma melhoria de 45% no desempenho da IA e uma melhoria de 45% na eficiência energética da IA.

Entre eles, a CPU Oryon é reutilizada em celulares e chips automotivos. Isso significa que esses dispositivos terminais podem usar uma arquitetura subjacente comum, ter melhor compatibilidade e a interconexão entre si será mais suave.

Essa arquitetura de computação heterogênea foi refletida em muitos dos telefones mais recentes do Snapdragon 8 Extreme Edition. O iQOO 13 usa o poder de computação de IA do Snapdragon 8 Extreme Edition para criar um mecanismo de sinal de e-sports de IA. Ele otimiza a rede de forma inteligente por meio de IA para obter menor latência em cenários multitarefa.

O REDMI K80 Pro aplica a tecnologia AI à experiência de conexão, trazendo integração multi-rede Xiaomi Star AI, que pode realizar previsão inteligente de sinal e otimizar automaticamente a rede. Na cena do metrô, a taxa de atraso de vídeo do WeChat é reduzida em 31% e a taxa de atraso de vídeo curto é reduzida em 29%.

Se os terminais inteligentes entraram na era do Agente, então a arquitetura de computação heterogênea é o "sistema nervoso central" do agente inteligente. Ela não apenas processa várias informações sensoriais, mas também coordena o "pensamento" e a "ação" para garantir a operação eficiente, suave e estável da IA do lado final.

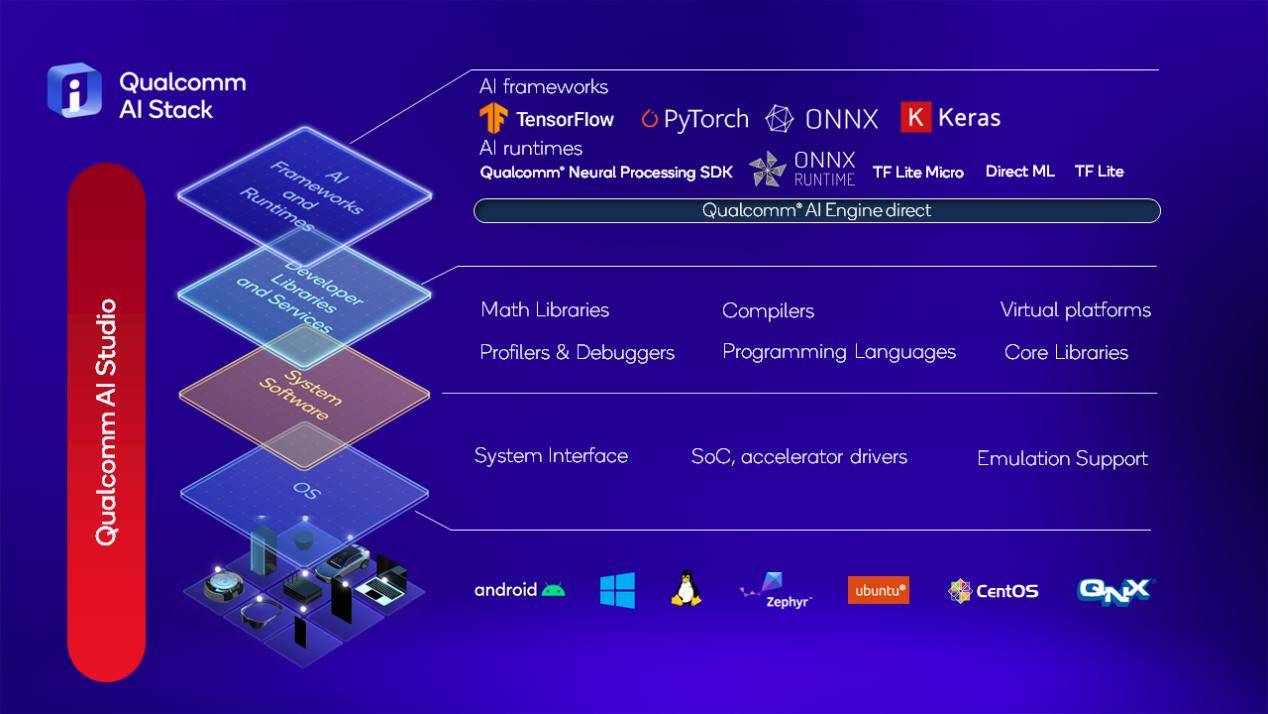

O software também é a chave para desbloquear o potencial da IA final

Assim como as corridas de alto desempenho exigem não apenas um motor potente, mas também um ajuste preciso e um excelente piloto. A implementação de IA no dispositivo não depende apenas de um poderoso poder de computação de hardware, mas também requer suporte eficiente e completo de ferramentas de software.

Para os desenvolvedores, não há necessidade de conhecer os detalhes específicos do design do hardware. O mais importante é o suporte da biblioteca de ferramentas de software, que lhes permite escolher de forma livre e flexível a estrutura, o tempo de execução e as ferramentas necessárias de acordo com suas próprias necessidades e projetar aplicativos e agentes de IA para qualquer sistema operacional.

Ao mesmo tempo que fornece a base de hardware, a Qualcomm também está construindo uma pilha de software de IA, incluindo bibliotecas, SDKs e ferramentas de otimização, que podem simplificar a implantação de modelos e melhorar o desempenho.

Os desenvolvedores podem usar esses recursos para adaptar modelos com eficiência às plataformas Qualcomm e reduzir o tempo de lançamento no mercado de aplicativos habilitados para IA. Não importa quão poderoso seja o poder computacional da IA final, ele só pode ser liberado por meio de aplicativos e, em última análise, transformado em experiência do usuário.

Em aplicações práticas, você pode pegar o telefone para identificar os ingredientes que usará para cozinhar. Após a identificação bem-sucedida, o telefone pode ajudá-lo a gerar as receitas correspondentes, e você também pode solicitar ao telefone algumas combinações de menu de baixas calorias.

Após o cozimento, você pode usar a câmera para perguntar ao telefone as calorias contidas nos alimentos. Com os smartphones agora suportando recursos de IA multimodais, esse caso de uso pode ser totalmente implementado no lado do dispositivo.

Este cenário é uma aplicação típica de agentes inteligentes como uma nova plataforma – os usuários não precisam mais abrir vários aplicativos, mas podem concluir tarefas complexas diretamente por meio de interações naturais.

Esta estratégia centrada no desenvolvedor simplificou bastante o processo de integração de recursos avançados de IA em produtos comerciais e de consumo, e também está acelerando a aplicação da inovação do raciocínio de IA no lado do dispositivo.

AI Hub está se tornando um baú de tesouro para desenvolvedores

Atualmente, muitos fabricantes de smartphones, PCs e automóveis integraram o DeepSeek em dispositivos terminais e começaram a praticar o uso de pequenos modelos de alta qualidade para atualizar a experiência de IA no lado do terminal ou criar novos aplicativos de IA. A inovação em aplicações de IA de ponta está pronta para decolar.

Se você é desenvolvedor, também há uma necessidade mais urgente de implantação de IA em plataformas de chips em diferentes segmentos. O Qualcomm AI Hub lançado pela Qualcomm no ano passado deu um grande passo em frente, permitindo aos desenvolvedores escolher a plataforma e o modelo de desenvolvimento correspondentes, escrever aplicativos e, finalmente, implantá-los em diferentes tipos de terminais móveis.

O Qualcomm AI Hub contém mais de 100 modelos de IA pré-otimizados, como Llama, Allam 3B, Tongyi Qianwen, OpenAI e modelos de outros fabricantes, e suporta implantação contínua em terminais equipados com a plataforma Snapdragon. Um ano após seu lançamento, mais de 1.500 empresas estão usando-o atualmente , promovendo ainda mais a popularização de aplicativos de IA do lado do dispositivo.

Os terminais cobertos pelo AI Hub também estão aumentando. Ma Dejia nos apresentou que o Qualcomm AI Hub pode suportar plataformas móveis, PC, IoT, automóveis e até mesmo terminais de rede Wi-Fi, como a plataforma Qualcomm Robot RB3 de segunda geração, uma plataforma de robô para o campo IoT.

A Qualcomm está se tornando uma construtora de ecossistemas de IA no lado do dispositivo. Por meio da cooperação ativa com fabricantes globais de modelos de IA, a Qualcomm não apenas fornece uma plataforma de computação poderosa, mas também desenvolve uma pilha completa de software e ferramentas de desenvolvimento, permitindo que os desenvolvedores integrem modelos de IA em aplicativos com mais facilidade.

Antes que a era dos agentes de terminais inteligentes realmente chegue, a indústria precisa construir um ecossistema completo de IA no lado do dispositivo.

Qualcomm está se tornando o arquiteto-chefe da IA do lado do dispositivo

Na Dinastia Sui da China, nasceu Yu Wenkai, um especialista em engenharia de construção com uma reputação duradoura. Ele não apenas planejou uma rede de hidrovias que vai de norte a sul, mas também projetou de forma inovadora um sistema de eclusas de navios para resolver o problema técnico dos navios que passam entre diferentes níveis de água. Use o pensamento sistemático de “o general prosperará, o bloqueio diminuirá” para integrar os rios dispersos numa rede de transporte interligada.

Isso é bastante semelhante à base de computação unificada e eficiente fornecida pela Qualcomm para IA do lado do dispositivo. Assim como a construção do Grande Canal exigiu a superação de muitos desafios, como terreno e hidrologia, a IA no dispositivo enfrenta demandas mais diversas e complexas de diferentes dispositivos terminais e diferentes cenários de aplicação. Isso inclui não apenas limitações de desempenho de hardware, mas também diversas restrições, como tamanho do modelo, consumo de energia e latência.

Para integrar verdadeiramente a IA nestes diversos terminais, tal como Yu Wenkai planeou o Grande Canal, é necessário um “arquiteto-chefe” para realizar o projeto de alto nível e criar uma arquitetura subjacente poderosa para apoiar a sua operação eficiente. Essa arquitetura não deve apenas ser capaz de lidar com grandes quantidades de dados, mas também de se adaptar de forma flexível a vários cenários de aplicação.

Esta progressão do concreto para o abstrato, da engenharia para a tecnologia reflete, na verdade, o contexto básico do desenvolvimento da civilização humana.

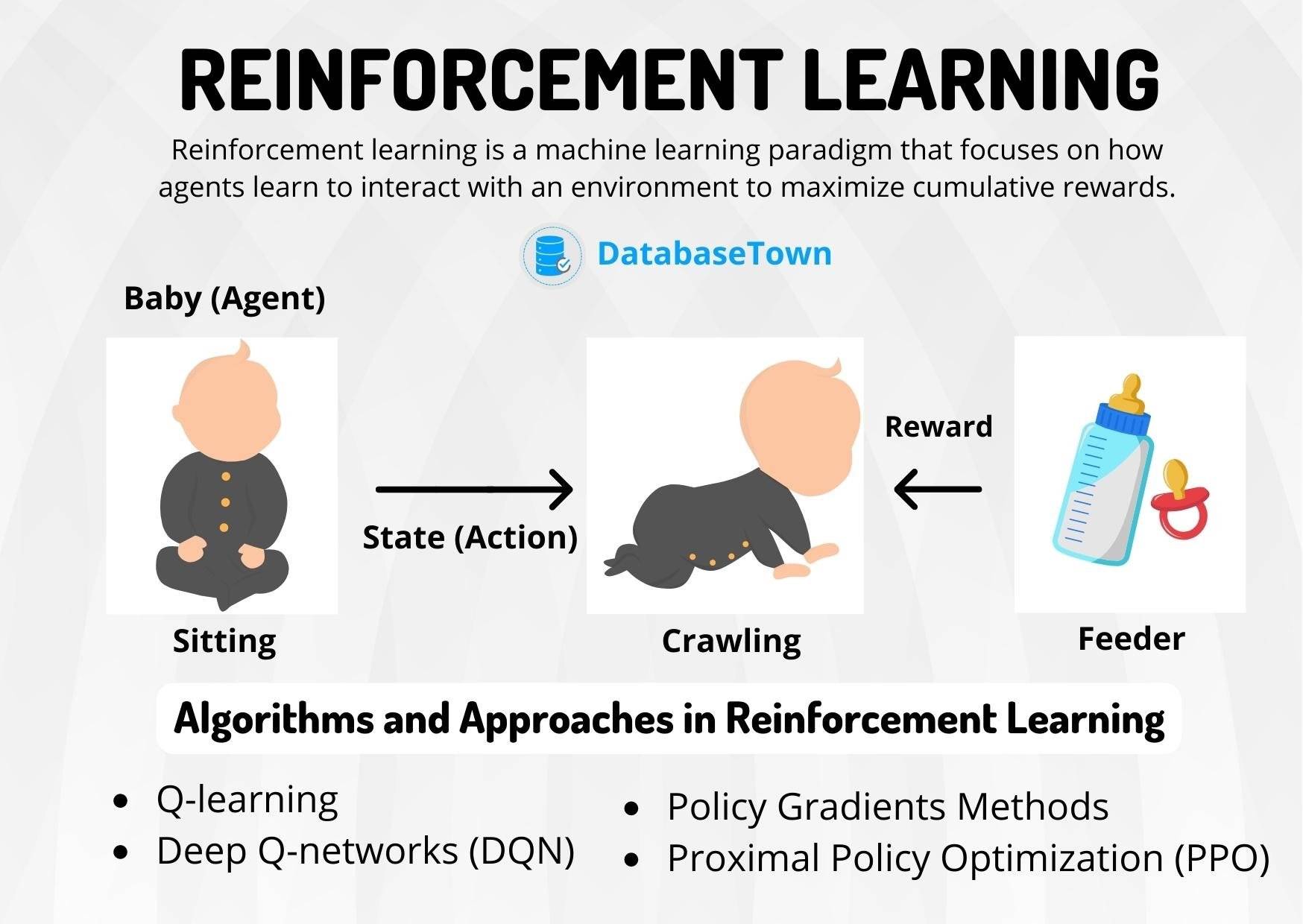

A essência herdada da civilização humana é o processo de destilação de informações. Desde a cópia palavra por palavra na Idade Média e a estrutura sistemática da era da informação, até à era do raciocínio da IA, o refinamento da informação assumiu uma nova forma – os modelos desenvolvem capacidades de raciocínio através da aprendizagem por reforço, como os bebés que compreendem o mundo através da auto-exploração contínua.

Como o Qualcomm AI Hub mencionado anteriormente, a biblioteca de modelos pré-otimizados que ele constrói permite que os desenvolvedores apliquem modelos adaptados a dispositivos terminais à base técnica de telefones celulares, PCs, carros e outros terminais da Qualcomm.

A redução de peso do modelo é a chave para a popularização da IA final. Os modelos de destilação DeepSeek já podem ser executados diretamente em smartphones e PCs com plataforma Snapdragon. Este avanço tecnológico é semelhante ao projeto da comporta que economiza água no projeto do Grande Canal, que atinge a máxima eficiência de tráfego com o mínimo consumo de recursos.

Ao mesmo tempo, a inovação no raciocínio da IA está a explodir no limite.

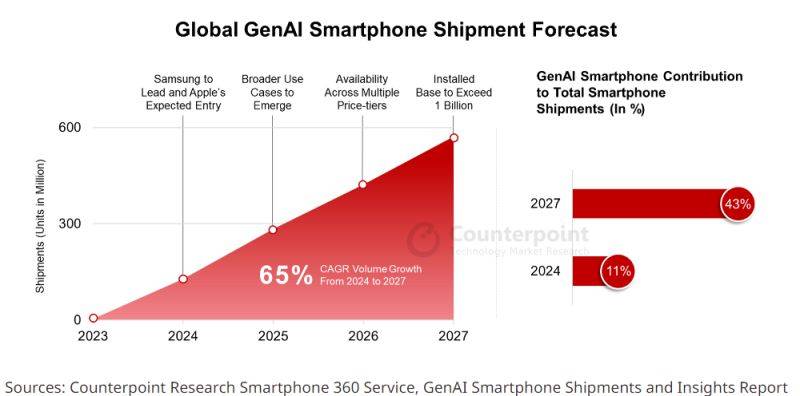

A empresa de pesquisa Counterpoint Research prevê que 2025 será um ponto de inflexão importante para telefones com IA generativos.

A tecnologia de IA generativa está se tornando um recurso padrão em telefones celulares de médio a alto padrão. Espera-se que a taxa de penetração global de telemóveis com IA generativa aumente de 19% em 2024 para 29% em 2025, com remessas de aproximadamente 400 milhões de unidades. Até 2027, espera-se que as remessas de telemóveis com IA generativa atinjam 550 milhões de unidades (representando 43% do mercado global).

Além disso, espera-se que a escala global de chips de IA de ponta aumente de 7,6 mil milhões de dólares em 2023 para 25,2 mil milhões de dólares em 2027 (CAGR 27,1%), sendo os automóveis, a IoT industrial e os cuidados médicos as principais áreas de crescimento.

A Qualcomm está se transformando no arquiteto-chefe da IA final.

As capacidades da IA end-side são injetadas em todos os cantos do terminal, de smartphones a carros, de fones de ouvido XR a PCs. Está se formando um “Grande Canal” tecnológico que conecta diferentes terminais e promove o livre fluxo de inteligência.

# Bem-vindo a seguir a conta pública oficial do WeChat do aifaner: aifaner (WeChat ID: ifanr). Mais conteúdo interessante será fornecido a você o mais rápido possível.