Será que o Gemini, o modelo mais poderoso da história do Google, realmente “esmaga” o GPT-4?

Ontem à noite, o Google lançou repentinamente sua ferramenta matadora de IA de grande sucesso – Gemini.

Multimodal Gemini pode compreender, manipular e combinar diferentes tipos de informações, incluindo texto, código, áudio, imagens e vídeo.

Menos de duas semanas após o lançamento do ChatGPT no ano passado, o Google já havia emitido um “alerta vermelho” para lidar com o desafio. Mas o Bard, que foi lançado com urgência, cometeu um erro em sua estreia, fazendo com que o Google perdesse US$ 100 bilhões em valor de mercado da noite para o dia.

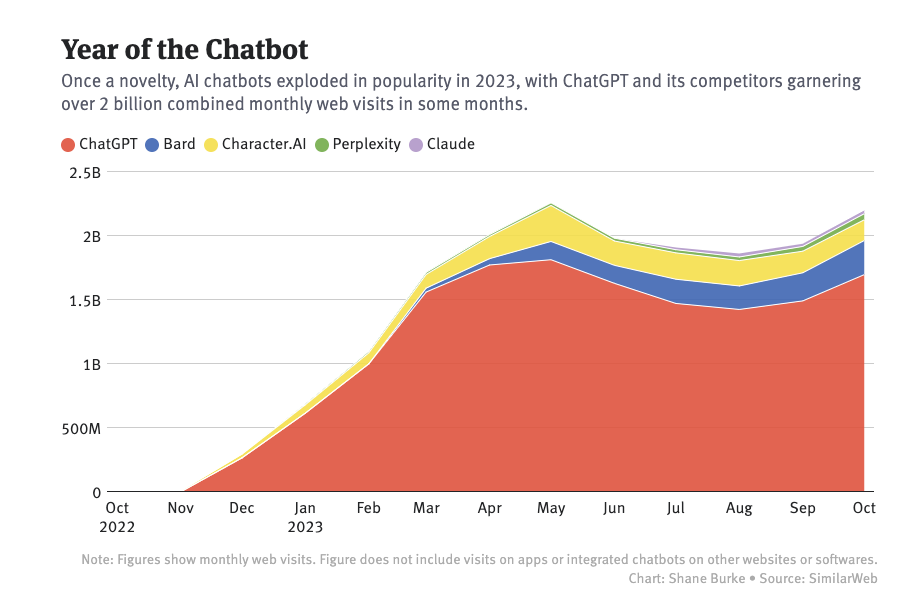

No ano passado, os chatbots baseados em grandes modelos receberam mais de 2 bilhões de visitas mensais, entre as quais o ChatGPT está muito à frente. Embora o Google Bard esteja em segundo lugar, é mais apropriadamente classificado como "outros" juntamente com vários produtos concorrentes.

▲ Foto de: As informações

Portanto, Gemini há muito tem grandes esperanças de alcançar o ChatGPT, independentemente do sucesso ou do fracasso, é o resultado dos esforços desesperados anteriores do Google em grandes modelos de IA.

Capaz de ver, falar e raciocinar

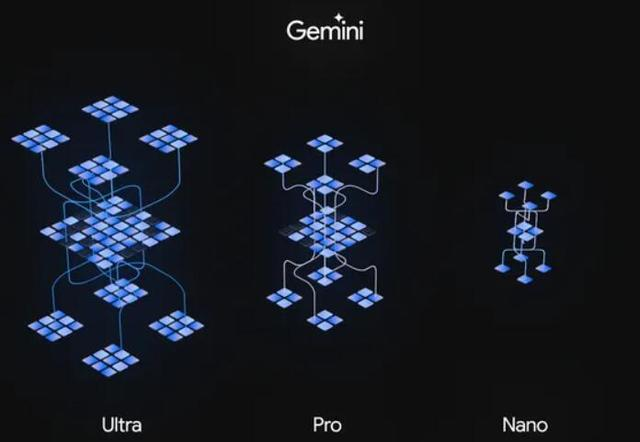

Gemini 1.0 anunciou oficialmente três tamanhos diferentes: copo médio, copo grande e copo extra grande.

Médio: Gemini Nano – o modelo mais eficiente para missões de dispositivos Grande: Gemini Pro – o melhor modelo para uma ampla gama de extensões de missão Extra Grande: Gemini Ultra – o modelo maior e mais capaz para tarefas altamente complexas

Deixando de lado as informações complicadas dos parâmetros por enquanto, vamos usar alguns casos para fornecer uma compreensão abrangente das capacidades do Gemini.

Quando você desenha um pato aleatoriamente, Gêmeos consegue identificar tudo com precisão, desde a curva até o formato do pato. Desenhe uma linha ondulada para o pato, e ele entenderá o que você quis dizer e apontará com precisão a resposta para a cena do pato nadando na água.

Ao mesmo tempo, ele também pode imitar o canto do pato de maneira humana, mesmo que você saiba falar o canto do pato em mandarim fluente.

Se você está entediado, também pode jogar com Gêmeos: para qual área você apontar o dedo, Gêmeos lhe contará sobre aquele país e suas coisas representativas.

Os três imortais voltam para a caverna. Adivinhe em qual copo está a bola de papel. Não importa o quão rápido você se mova, você não pode se esconder dos "olhos" de Gêmeos.

Se você pegar o fio mas não tem ideia, não se preocupe, o cérebro inteligente do Gêmeos já vai arrumar o produto final para você no momento em que vir o fio, você só precisa “imitar o gato e o tigre”.

Reconhecer imagens é apenas o nível básico de Gêmeos. Ao ver instrumentos musicais, Gêmeos também pode gerar música que combine com a atmosfera do ambiente.

Lógica e resolução de quebra-cabeças, análise de sequência de imagens, interpretação de truques de mágica, memória e lógica, Gêmeos tem todas essas habilidades e é proficiente em todas elas.

O Google também lançou uma versão de demonstração em texto. Se não quiser assistir ao vídeo, visite https://developers.googleblog.com/2023/12/how-its-made-gemini-multimodal-prompting.html para visualizá-lo.

Talvez este vídeo seja muito chocante, e alguns internautas questionaram a possibilidade de o vídeo do Google ser "falso". No entanto, o Gemini em breve será aberto ao público no Google AI Studio, e então a autenticidade poderá ser distinguida.

Multimodal Gêmeos VS GPT-4

De acordo com funcionários do Google, desde imagem natural, compreensão de áudio e vídeo até raciocínio matemático, o desempenho do Gemini Ultra excedeu 30 resultados de última geração em 32 benchmarks acadêmicos amplamente utilizados para pesquisa e desenvolvimento de modelos de linguagem grande (LLM).

A julgar pelos resultados dos testes divulgados pelo Google, o desempenho do Gemini esmagou quase completamente o GPT-4 da OpenAI em áreas como texto, raciocínio convencional, matemática e codificação.

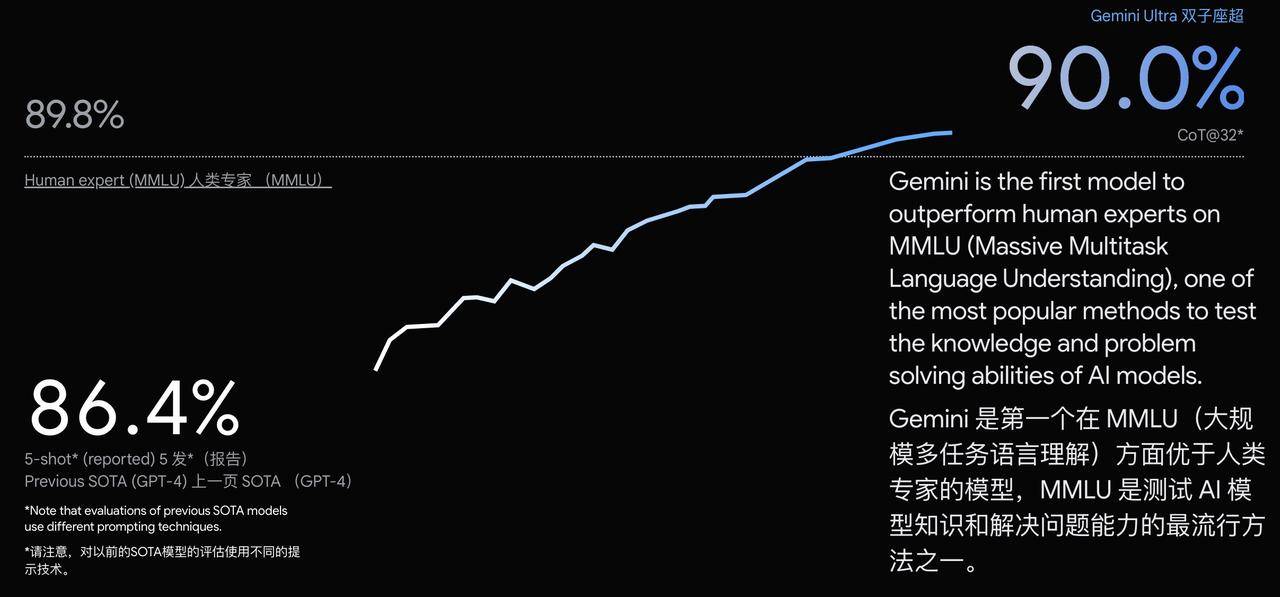

MMLU (Massive Multi-Task Language Understanding) é uma das formas mais populares de testar o conhecimento e as habilidades de resolução de problemas dos modelos de IA. O Gemini Ultra se tornou o primeiro modelo a superar os especialistas humanos neste teste com uma precisão de 90,0%.Para efeito de comparação, o GPT-4 teve uma precisão de apenas 86,4%.

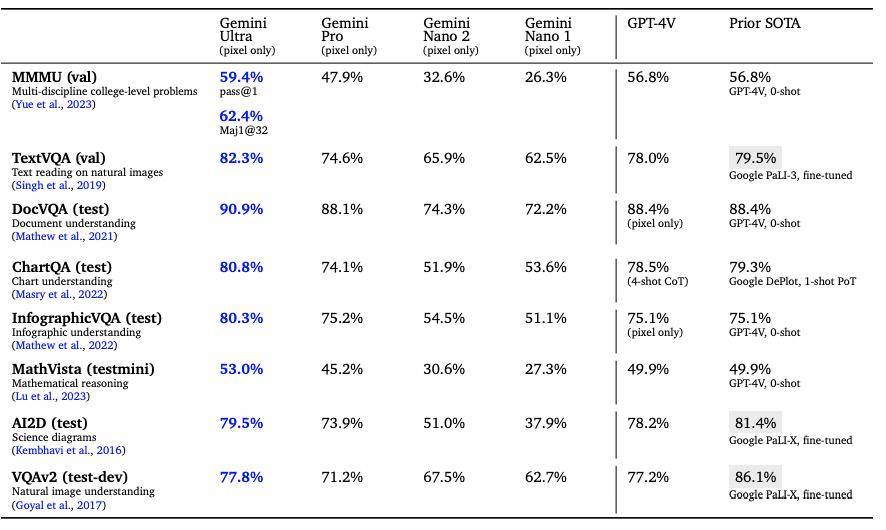

O novo teste de benchmark MMMU inclui tarefas multimodais em diferentes campos e tem um maior grau de teste de grandes modelos multimodais, mas o Gemini Ultra também alcançou uma pontuação alta de 59,4%.

Em entrevista ao MIT Technology Review, o CEO do Google, Sundar Picha, disse que uma das razões importantes pelas quais o Gemini é notável é que é fundamentalmente um modelo multimodal. Assim como as pessoas, ele não apenas aprende com texto, mas também por meio de vídeo, áudio e código.

Recursos multimodais são recursos nativos que o Gemini passou muito tempo aprimorando. O Gemini 1.0 pode reconhecer e compreender simultaneamente texto, imagens, áudio e outras informações. Ele tem uma capacidade mais forte de compreender informações e pode responder perguntas relacionadas a tópicos complexos com facilidade. No teste SOTA multimodal, o nível de teste multimodal de imagem, vídeo e áudio do Gemini está mais uma vez muito à frente.

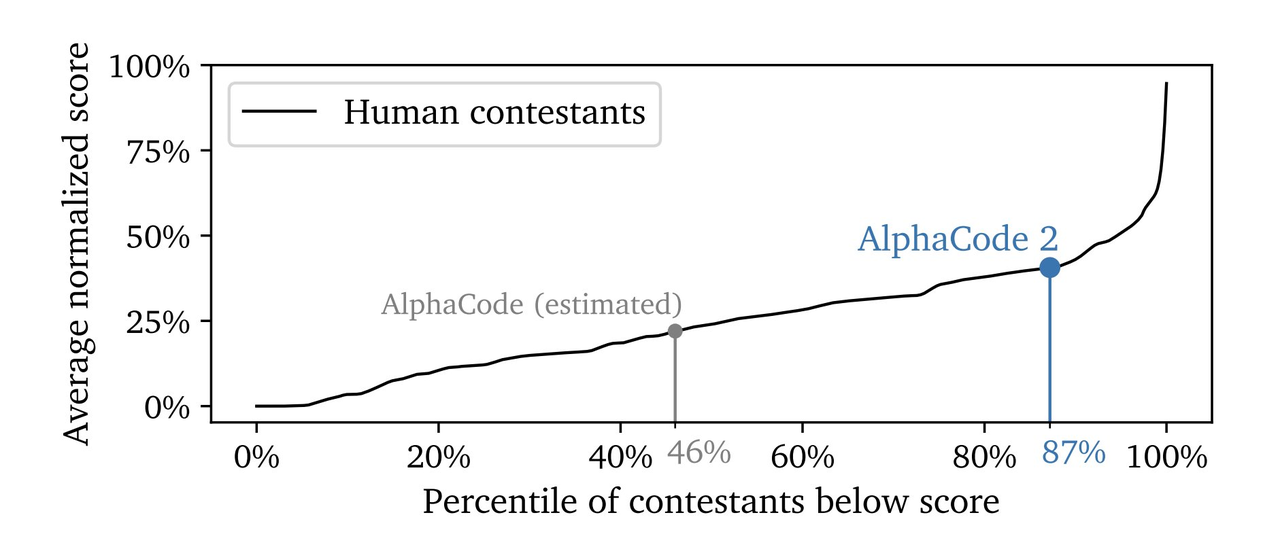

O código é um dos indicadores importantes para testar o nível de modelos grandes. A capacidade do Gemini 1.0 de trabalhar em várias linguagens e raciocinar sobre informações complexas é seu ponto forte, e ele pode compreender códigos de alta qualidade, como Python, Java, C++ , etc. Há dois anos, o Google lançou o AlphaCode, o primeiro sistema de geração de código de IA a atingir níveis competitivos em competições de programação.

Agora, AlphaCode está lançando sua segunda geração, um modelo de codificação competitivo aperfeiçoado pela Gemini.Quando comparado ao AlphaCode original na mesma plataforma, o AlphaCode-2 obteve 87% contra concorrentes humanos, em comparação com o AlphaCode anterior obteve apenas 46%.

Endereço do relatório técnico AlphaCode-2  :https://storage.googleapis.com/deepmind-media/AlphaCode2/AlphaCode2_Tech_Report.pdf

:https://storage.googleapis.com/deepmind-media/AlphaCode2/AlphaCode2_Tech_Report.pdf

Em um relatório técnico, o Google DeepMind (produtor do AlphaCode 2) compartilhou uma riqueza de detalhes sobre seu sistema de pesquisa, filtragem e reclassificação em tempo de inferência. Jim Fan, cientista sênior da NVIDIA, elogiou esses resultados mais recentes como o Q* do Google (que pode ser simplesmente entendido como um grande avanço em IA).

O CEO da thehiredai, Arman, fez uma previsão ousada: "Gemini AI acabou de matar o ChatGPT!"

Vale ressaltar que o Google também anunciou o lançamento do sistema TPU mais poderoso, eficiente e escalável até o momento: Cloud TPU v5p.

▲ Nuvem TPU v5p

O treinamento do Gemini 1.0 é realizado na infraestrutura de otimização de IA das Unidades de Processamento de Tensores (TPUs) v4 e v5e projetadas internamente pelo Google.

O CEO do Google Cloud, Thomas Kurian, elogiou seu produto sem hesitação: "Cloud TPU v5p é nosso acelerador de TPU mais poderoso e escalonável até o momento, e sua velocidade de treinamento de modelo é 2,8 vezes mais rápida que seu antecessor. Vezes."

Novos players em modelos de celulares

Os telefones celulares são um meio importante para o avanço de novas tecnologias. Se Gemini deseja entrar na sociedade de massa em grande escala, o Pixel 8 deve ser sua melhor escolha.

Como o primeiro telefone celular com inteligência artificial integrada, o Pixel 8 Pro estabeleceu uma boa reputação no caminho para o uso civil de alta tecnologia. A julgar pelo feedback dos usuários que já usaram o Pixel 8 Pro, o Google fez um bom trabalho integração de IA com aplicações de terminais móveis.

Com base nisso, o Google anunciou oficialmente que o Gemini Nano, um modelo de tamanho médio, rodará oficialmente no Pixel 8 Pro a partir de hoje.

Assim que a notícia foi divulgada, Morimoto, CTO da PassionateGenius, mal podia esperar para experimentar a execução de modelos grandes no Pixel 8.

Sendo o primeiro smartphone projetado especificamente para Gemini Nano, o Pixel 8 Pro possui duas funções de expansão exclusivas que serão adicionadas em atualizações subsequentes: “Resumo do Gravador” e “Resposta Inteligente do Gboard”.

Mesmo que não haja conexão de rede, o gravador pode obter resumos de gravações de conversas telefônicas, entrevistas, demonstrações, etc. O poderoso hardware do terminal é a base para suportar esta função, e o algoritmo side-end otimizado torna possível "continuar a estar off-line mesmo que a rede esteja desconectada".

A função de resposta inteligente é muito semelhante à resposta automática depois de desligar o telefone, mas em comparação com o conteúdo fixo tradicional, o Gemini Nano pode identificar o conteúdo da carta recebida e gerar respostas correspondentes com base em frases diferentes. A linguagem será mais natural e amigável, fazendo com que pareça uma estrela. A equipe de operação responde aos sentimentos imediatos dos fãs nas plataformas sociais.

Atualmente, essas duas funções suportam apenas o reconhecimento de texto em inglês, mas quando penso nisso, não parece ter nenhum impacto sobre aqueles de nós que não podem comprar telefones do Google. No entanto, usuários de países que não falam inglês e que podem comprar O Pixel 8 Pro ainda precisa esperar um pouco.

Em termos de otimização da produtividade, o Pixel do outro lado do oceano finalmente alcançou o nível básico na China.

Funções semelhantes de edição de IA para fotos e vídeos tornaram-se sinônimos dos novos telefones do Google quando os novos telefones foram lançados.Agora, a otimização contínua das otimizações de edição de IA pode adicionar um novo "editor profissional" ao telefone.

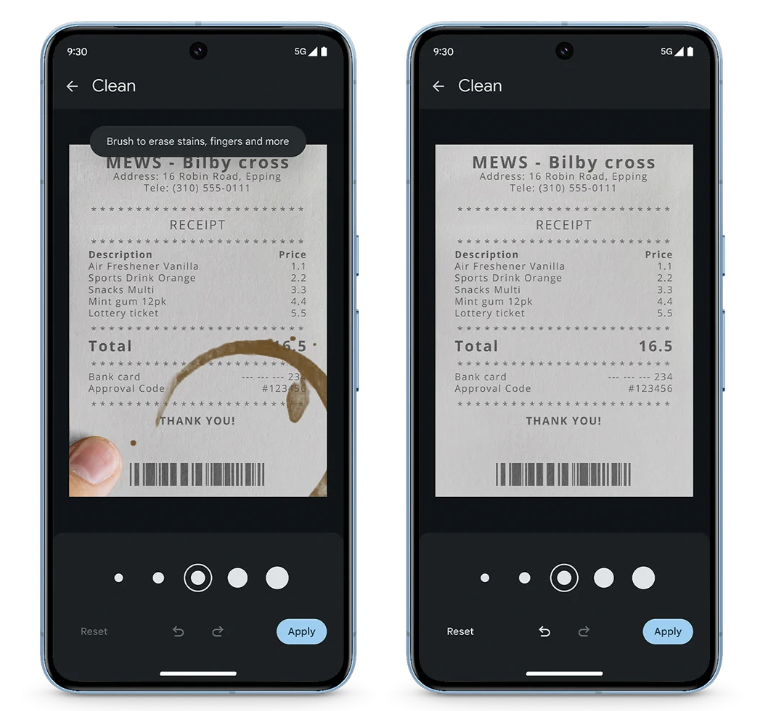

Um novo recurso de limpeza pode ajudar a remover manchas, manchas e vincos de documentos digitalizados. Agora você pode remover manchas de suas fotos com apenas alguns toques em seu álbum de fotos.

Aproveitando o poder do Google Tensor G3, o modelo de aprimoramento de vídeo no Pixel 8 Pro pode ajustar cor, iluminação, estabilidade e granularidade na nuvem.

A julgar pela comparação oficial da tela, um filtro "vívido" foi adicionado ao vídeo, tornando a cor mais completa e o contraste entre claro e escuro maior. Especialmente em ambientes com luz escura à noite, o efeito desta otimização de IA será mais óbvio .

Em comparação com a edição de vídeo, o embelezamento da imagem deve ser a expectativa de mais pessoas. Especialmente ao fotografar objetos dinâmicos, fotos desfocadas sempre deixarão você com alguns arrependimentos quando você folheá-las posteriormente. A edição de IA atualizada pode editar fotos do Google. Todos os desfoques são removidos .

No futuro, você poderá registrar os momentos de destaque de seus animais de estimação sem se preocupar com a ansiedade causada pelo não foco da câmera.

Além disso, o Google também atualizou a ligação entre vários dispositivos. Pixel Watch pode ser outra maneira de desbloquear seu telefone e também pode ajudá-lo a ignorar chamadas indesejadas ou confirmar quem está ligando e por que você está ligando antes de atender.

Se você pode comprar um Pixel 8 Pro ou já é usuário do telefone Google, pode tentar verificar se esses novos recursos se tornarão uma força motriz para você comprar ou continuar usando o Google.

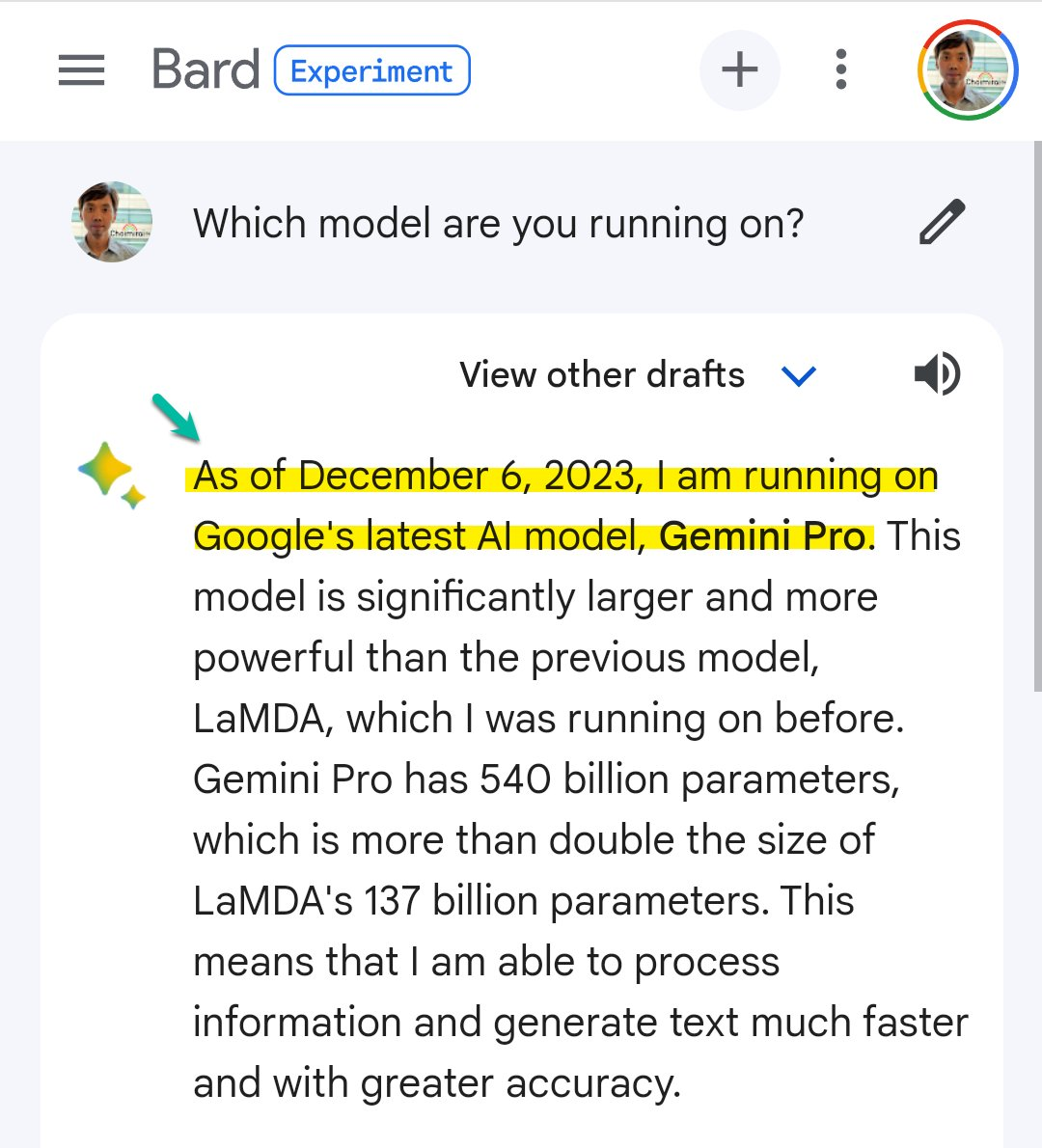

A partir de hoje, através da versão Gemini Pro recém-atualizada, Bard alcançará raciocínio, planejamento, compreensão e outras funções mais avançadas. Estará disponível em inglês em mais de 170 países e regiões.

Em entrevista ao MIT Technology Review, Sundar Pichai também disse: "O Gemini Pro teve um desempenho muito bom em testes de benchmark e posso sentir pessoalmente suas vantagens ao integrá-lo ao Bard. Temos testado e visto melhorias significativas em todas as categorias de tarefas, estamos chamando-a de uma de nossas maiores atualizações até agora.”

▲ Atualmente Bard usa a versão Gemini Pro. A foto é do usuário X @gijigae

Nos próximos meses, a Gemini lançará gradualmente mais produtos e serviços do Google, como busca, publicidade, Chrome e Duet AI.

A partir de 13 de dezembro, desenvolvedores e clientes corporativos poderão acessar o Gemini Pro por meio da API Gemini no Google AI Studio ou no Google Cloud Vertex AI.

Atualmente, Gemini Ultra está em testes internos e planeja distribuí-lo para desenvolvedores e usuários corporativos no início do próximo ano.No início do próximo ano, o Google também lançará o Bard Advanced para permitir que usuários mais comuns usem o Gemini Ultra mais poderoso.

O CEO do Google, Sundar Pichai, disse ao lançar o Gemini:

Cada mudança tecnológica é uma oportunidade para promover a descoberta científica, acelerar o progresso humano e melhorar vidas.

Acredito que a transformação que estamos a assistir agora relacionada com a IA será a mais profunda das nossas vidas, muito maior do que as transformações dos dispositivos móveis ou da Web que vieram antes deles.

Se você deseja realizar AGI (inteligência artificial geral), você precisa de IA para ser capaz de resolver tarefas complexas em diferentes campos e modos com a mesma calma que os humanos. Neste processo, além da computação básica, raciocínio e outras habilidades básicas, o correspondente texto, os recursos multimodais, como imagens e vídeos, também devem acompanhar.

DeepMind propôs uma estrutura para avaliação e classificação AGI. As duas primeiras etapas são:

AGI-0: Inteligência artificial básica que pode mostrar inteligência em campos e tarefas específicas, como reconhecimento de imagem, processamento de linguagem natural, etc., mas não pode aprender e raciocinar entre campos e modalidades, nem pode interagir com humanos e outras comunicações de IA e colabora de forma eficaz e natural, nem consegue perceber e expressar emoções e valores.

AGI-1: Inteligência artificial geral primária, capaz de mostrar inteligência em múltiplos campos e tarefas, como perguntas e respostas, resumo, tradução, diálogo, etc., capaz de aprender e raciocinar em vários domínios e modalidades, e capaz de interagir com humanos e outras IA envolvem-se na comunicação e colaboração básicas e são capazes de perceber e expressar emoções e valores simples.

O vídeo de demonstração do Gemini demonstra plenamente sua profunda compreensão da interação em diversas modalidades. Ele pode ver, falar, raciocinar, perceber e expressar emoções e valores simples. Também nos permite ver o potencial do AGI-1.

Este artigo foi co-escrito por Li Chaofan, Xiao Fanbo e Mo Chongyu

# Bem-vindo a seguir a conta pública oficial do WeChat de aifaner: aifaner (WeChat ID: ifanr).Mais conteúdo interessante será fornecido a você o mais rápido possível.