Quando você pressiona o obturador para tirar uma foto, seu telefone está com problemas de matemática

Se você for pobre, a mecânica dos fluidos será melhor, e se você ousar, voará com grande força. Esta é uma piada que circulou nos círculos da aviação.

▲ MiG 25: Uma viagem ao céu em uma peça de aço inoxidável.

Refere-se à história da União Soviética voando de 32 toneladas de aço inoxidável para 3,2 Mach, o que chocou os Estados Unidos na época. Comparado com a aeronave de reconhecimento SR-71 Blackbird que está cheia de tecnologia preta, a abordagem do MiG-25 é direta e eficaz, usando diretamente dois motores de foguete para resolver o problema.

De acordo com o pensamento não convencional dos engenheiros soviéticos, a aeronave em forma de "tijolo" pode voar facilmente a velocidades supersônicas.

▲ Nave estelar SN6 de Musk. Foto de: cnet

Até agora, o exemplo do "grande tijolo voando" deveria ser o protótipo da nave estelar de Musk. Ele tem o mesmo efeito que o MiG 25 e funciona milagres vigorosamente.

Se a conversa interessante do círculo da aviação for transferida para o campo da imagem, ela também pode ser combinada.

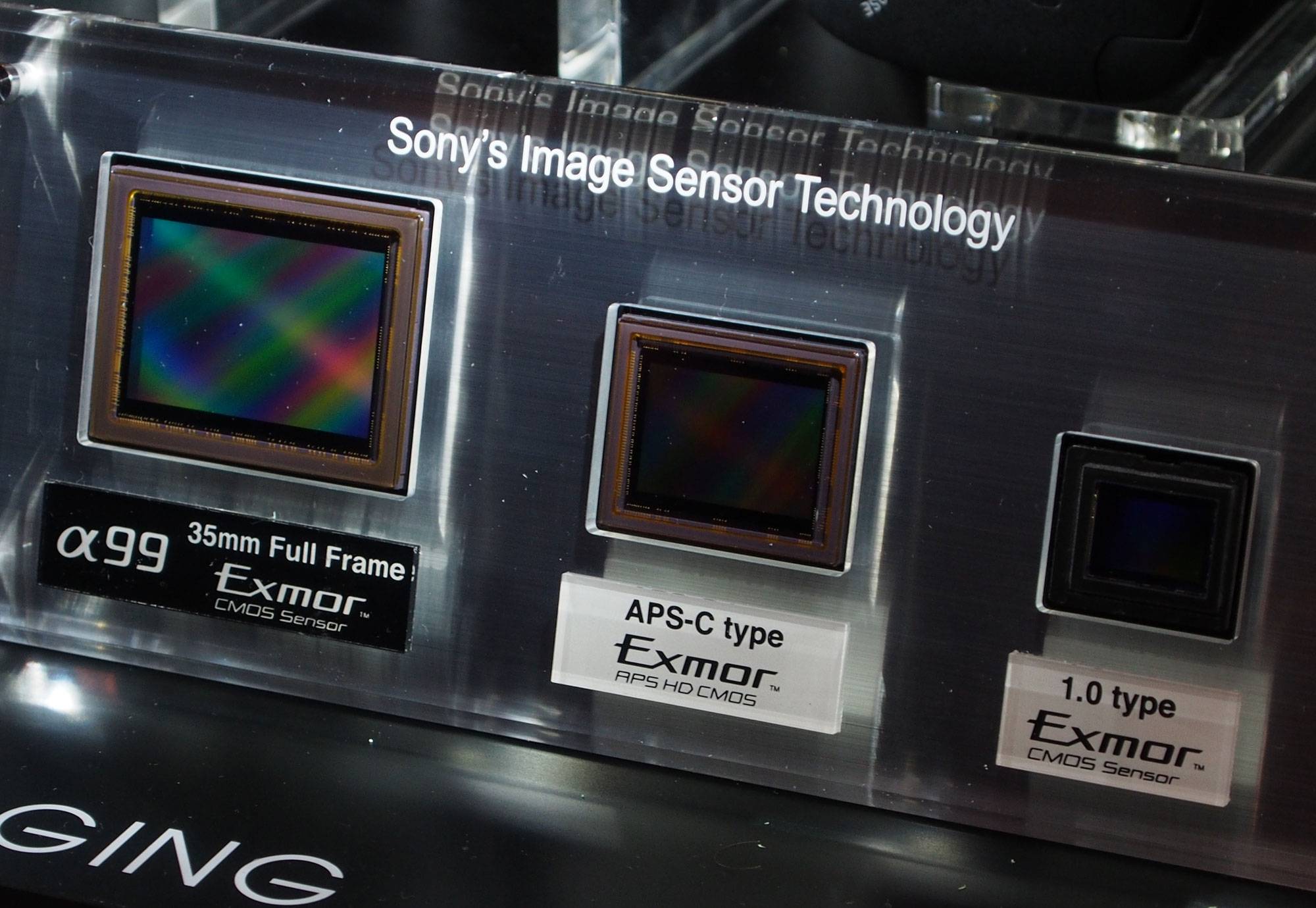

Na era digital, a qualidade da imagem produzida pode ser quase proporcional ao tamanho do sensor. Quanto maior o tamanho, maior a vantagem natural. Com os grilhões da ótica física tradicional, é difícil "contra-atacar".

O sensor do smartphone tem apenas o tamanho de uma "capa de unha" e é limitado por seu tamanho, o design da lente está em um dilema. Com o pensamento de imagem tradicional, há uma sensação de estar sendo atacado pelo inimigo e é difícil romper o limite superior da física, muito menos fazer algumas inovações que são bem-vindas.

▲ Marc Levoy, considerado o pai da “ fotografia computacional ''

Até que a primeira geração do Google Pixel foi lançada, e ganhou a coroa de DxOMark de uma só vez. Naquela época, as pessoas gradualmente perceberam o encanto da "fotografia computacional".

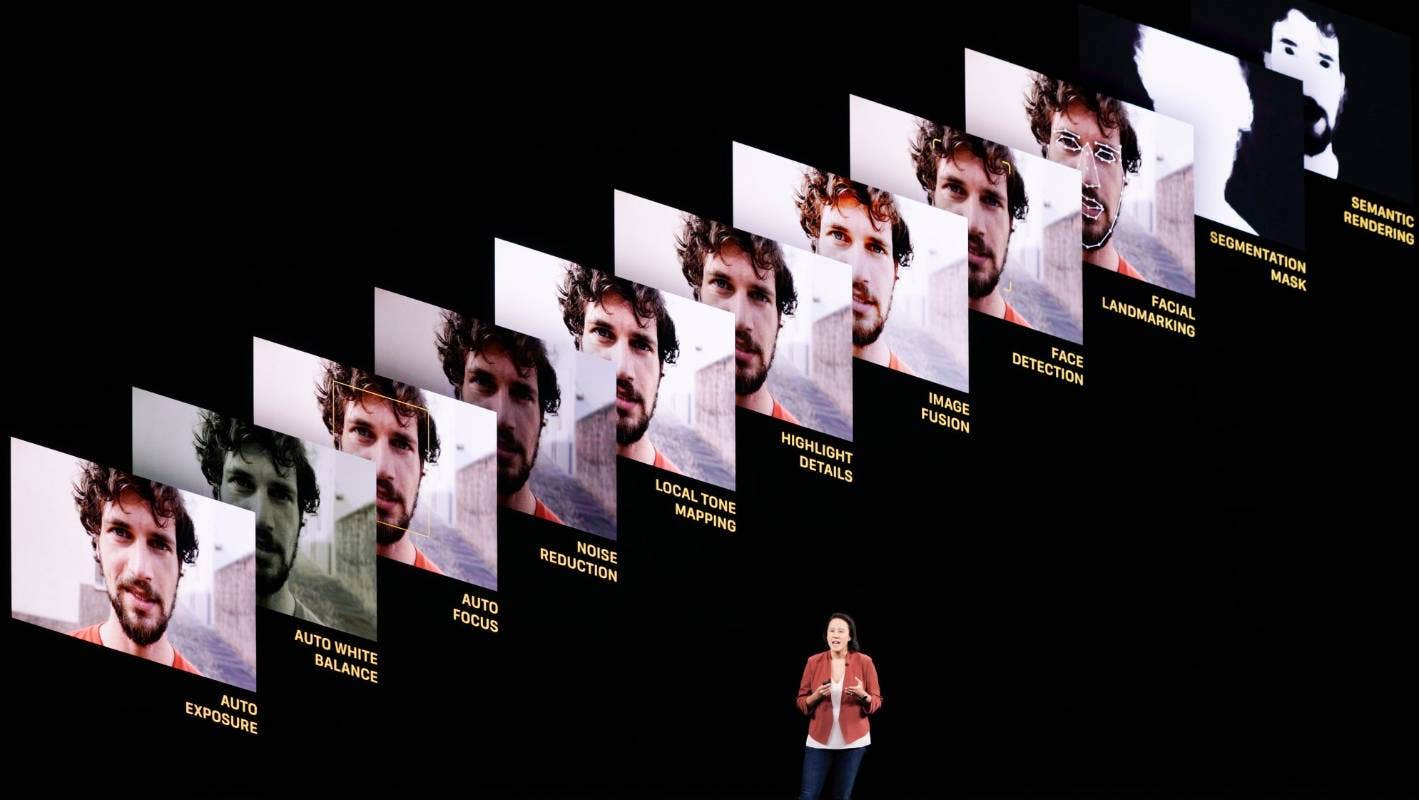

No lançamento da série iPhone 12, a Apple passou muito tempo apresentando os avanços e aprimoramentos funcionais trazidos pela "fotografia computacional" no iPhone.

Pode-se dizer que a fotografia computacional se tornou uma tendência neste momento e, comparada à estagnação da ótica física tradicional, parece ter um potencial maior, e até mesmo o reino dos "grandes tijolos voando" pode ser alcançado apenas por algoritmos.

No passado, o algoritmo pode ser apenas a cereja do bolo, tornando a cor da imagem melhor, a cena noturna é mais limpa e a luz de fundo é mais clara, mas recentemente, o processamento de "imagens" no MIX 4 e iOS 15 não se manteve apenas no nível de "boa aparência".

▲ Xiaomi MIX4.

O maior destaque do Mi MIX 4 pode ser considerado a tela inteira realizada pela tecnologia de câmera sob a tela. O conceito de tela cheia é gradualmente implementado.Além dos avanços na tecnologia da tela, a fotografia computacional também desempenhou um grande papel nisso.

No momento, a tela da área CUP usa tecnologias como "pixels pequenos" e "fios transparentes" para evitar efeitos de difração e aumentar a transmitância de luz, mas em comparação com telas OLED comuns, sua transmitância de luz ainda é inferior a 20%.

▲ Protótipo de câmera OPPO sob a tela.

Antes do Xiaomi MIX 4, a OPPO também anunciou seu próprio protótipo de câmera sob a tela e disse que o próximo objetivo é aumentar a transmitância de luz para 40%, mas ainda há muito espaço para os tradicionais 90%.

E essa lacuna foi transferida para a "fotografia computacional", que transformou a óptica física em uma série de problemas matemáticos.

De acordo com o compartilhamento da Xiaomi, as câmeras MIX4 serão calibradas uma a uma de acordo com a tela na linha de produção, e então o "modelo de difração" será usado para reduzir o efeito de difração e realizar operações como HDR multi-frame, ruído redução e desembaciamento.Realizar uma série de detalhes, otimização de cores e assim por diante.

▲ Mi MIX 4 chama selfies em QQ.

Tal operação, por meio de nossa medição real anterior, pode basicamente atingir um efeito selfie próximo a 80%. No entanto, as chamadas desses algoritmos são limitadas a seus próprios aplicativos de câmera. Eles ainda não estão abertos a terceiros ou otimizações direcionadas de terceiros. É fácil "expor" a chamada de front-end do aplicativo de terceiros.

No iOS 15, a Apple também usou "algoritmos" para eliminar um defeito óptico na câmera do iPhone.

▲ Fotografado no iPhone. Foto de: Reddit

A partir da série iPhone 11, devido ao design do grupo de lentes, "imagens fantasmas" aparecerão ao fotografar com uma fonte pontual de luz, especialmente à noite, como se houvesse um espelho transparente no mundo real.

Fosse no Weibo ou no Reddit, havia muita discussão. Até o lançamento da série do iPhone 12, a Apple ainda não fazia alterações nele, e a imagem fantasma permanecia a mesma.

▲ A imagem à direita mostra iOS 15 Beta 4. Imagem de: Reddit

Na atualização do iOS 15 Beta 4, a Apple usou algoritmos para lidar com imagens fantasmas em algumas fotos. Além de limpar, esse recurso do iOS 15 Beta 4 também reconhecerá automaticamente imagens fantasmas com base no conteúdo da imagem.

Desta forma, as fotos de cenários são mais fáceis de serem julgadas, enquanto em ambientes internos, elas podem não ser tão eficazes e imagens fantasmas ainda existem.

▲ A imagem à direita mostra iOS 15 Beta 4. Imagem de: Reddit

E, nas postagens relacionadas ao Reddit, fantasmas podem ser otimizados do iPhone XS para o iPhone 12 Pro Max, não se limitando aos modelos mais recentes. Com a chegada da versão oficial do iOS 15 em setembro, acredito que o problema de "ghosting" será ainda melhor eliminado.

No campo da imagem tradicional, as "imagens fantasmas" só podem ser evitadas e é difícil eliminá-las completamente por meio do design óptico. A lente ultra grande angular usa lentes grandes exageradas e lentes especiais, como várias lentes asféricas, para evitar "defeitos".

O uso de algoritmos pela Apple para resolver defeitos ópticos pode ser descrito como uma nova maneira, saindo do pensamento inercial dos fabricantes de imagens tradicionais de empilhamento de materiais em lentes para solucionar defeitos.

▲ Jon McCormack.

Lembro-me que em uma entrevista após a conferência da série iPhone 12, Jon McCormack, vice-presidente de software da Apple e responsável pelo sistema de imagem do iPhone, disse que “a maneira de pensar da Apple não é a mesma dos fabricantes de imagens profissionais tradicionais”. “Nosso objetivo é fazer com que cada um conte suas próprias histórias.”

Ou seja, em comparação com produtos com atributos de ferramenta como micro-single e SLR, as imagens de smartphone são mais do ponto de vista do usuário, como otimização de cores por meio de algoritmos, síntese de vários quadros de "cenas noturnas", HDR e assim por diante .

Ao mesmo tempo, os smartphones são atualmente o único dispositivo que pode combinar coleta, edição, processamento e compartilhamento em um, com um status especial. É também o caso que deu origem à "fotografia computacional", que é considerada um caminho de "espada inclinada para a frente" no campo da fotografia tradicional.

Diferente dos atuais fabricantes de imagens profissionais, incluindo fabricantes de telefones celulares, eles têm explorado a inovação revolucionária da Câmera 3.0. (Câmera 1.0 é a era do cinema e 2.0 é a era digital, passando do campo da química para o campo da física.)

▲ Luz L16. Foto de: theVerge

A câmera multi-lente Light L16 foi chamada de "Futuro das Câmeras" pelo Wall Street Journal, e a National Geographic até a chamou de câmera revolucionária.

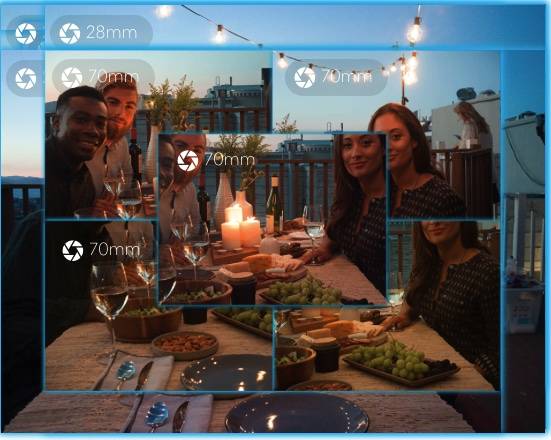

Seu princípio de aquisição agora é semelhante ao de um sistema multicâmera de um smartphone. 16 lentes (grande angular, telefoto, teleobjetiva média etc.) participam juntas da imagem e, finalmente, geram uma foto "perfeita".

▲ Diferentes lentes usadas na imagem final do Light L16.

Assim que o conceito do Light L16 foi lançado, ele se tornou o queridinho da mídia ao mesmo tempo, também recebia 30 milhões de dólares de investimento do Google Ventures, mas o produto era constantemente devolvido e adiado.

A câmera Light L16 que finalmente chegou ao mercado não completou a visão original, exceto pela confusão de hardware e software. Depois de testar o editor de câmera Ki_min de Mobile01 na província de Taiwan, ele descobriu que a chamada síntese de algoritmo de múltiplas lentes é, na verdade, um recorte digital simples e muitas funções não foram implementadas.

O mais importante é que o Light L16 não tem nenhum poder de computação para resolver o processamento "one-stop" na máquina e ainda precisa do auxílio de uma plataforma de computação em nível de PC para completar o resultado final.

Olhando para trás agora, Light L16 deve ser considerado apenas um produto semi-acabado, e menos é a plataforma de computação e algoritmo. O sucesso de atrair muita atenção da mídia e se tornar a queridinha da mídia na verdade depende do conceito de imagem, ou seja, do algoritmo, e agora é "fotografia computacional".

O surgimento inicial da "fotografia computacional" foi, na verdade, para compensar as deficiências dos pequenos componentes sensíveis à luz dos telefones celulares. Com o aumento do poder de computação dos chips, a imagem do smartphone tornou-se gradualmente um longo caminho competitivo, tornando "computacional fotografia "uma melhoria total.

Agora, com a otimização do algoritmo, a tela inteira do CUP amadureceu e a "imagem fantasma" que antes atormentava os designers de lentes desaparece. A fotografia computacional deixa de assumir o papel de "otimização" e, gradativamente, passa para o primeiro plano, tornando-se peça fundamental na melhoria da qualidade e qualidade da imagem.

Se o Light L16 naquela época tivesse o "algoritmo" atual, acho que poderia ser uma possibilidade futura para a câmera, mas não é a Camera 3.0, é "fotografia computacional".

#Bem-vindo a seguir a conta oficial do WeChat da Aifaner: Aifaner (WeChat ID: ifanr), mais conteúdo interessante será fornecido a você o mais rápido possível.