O token de modelo grande é muito caro? A Apple oferecerá aos desenvolvedores “sem taxas”

O gosto residual do Apple Intelligence, que foi superestimado e depois abandonado pela Apple na WWDC do ano passado, ainda está presente.

Na madrugada de 10 de junho de 2025, o discurso principal (gravado) da WWDC25 tinha acabado de terminar, e a parte relacionada à IA ainda faz as pessoas suspirarem de vez em quando: "É isso".

Muitos dos chamados novos recursos anunciados pela Apple em IA este ano, como tradução em tempo real e comandos de atalho, não são muito revolucionários; quanto à inteligência visual, não apenas sua funcionalidade está seis ou sete anos atrás do Google Lens, mas sua experiência interativa também está longe do nível de produtos de IA/Agent integrados de vários concorrentes do Android no primeiro semestre de 2025.

Mas depois de assistir ao programa inteiro, posso afirmar que há apenas uma notícia sobre a inteligência da Apple que terá um impacto de longo alcance – tanto para usuários comuns quanto para desenvolvedores.

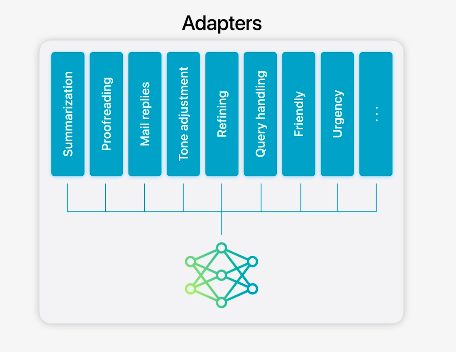

Trata-se do "Foundation Models Framework", um framework de acesso a modelos de IA de ponta a ponta fornecido pela Apple para desenvolvedores. Com ele, os desenvolvedores da Apple poderão acessar facilmente o modelo de linguagem de ponta a ponta para seus aplicativos sem pagar custos de token.

Isso significa que os desenvolvedores podem fornecer aos usuários recursos e serviços baseados em LLM sem nenhum ônus e executar raciocínio de ponta a ponta sem se preocupar com as taxas de token geradas pela chamada da API LLM na nuvem e, naturalmente, não precisam repassar os custos aos usuários.

Os desenvolvedores podem manter de forma mais respeitável o modelo de preços de sua escolha, e os usuários se beneficiam como resultado.

Apple inteligente, puro de ponta a ponta

No ano passado, na WWDC, a Apple anunciou uma série de produtos, recursos e capacidades técnicas de IA que poderia fornecer aos desenvolvedores sob o nome de "Apple Intelligence". Já sabemos que a maioria desses anúncios foi adiada ou até mesmo completamente "vaporware" (software que foi anunciado, mas seriamente atrasado).

Isso afeta o julgamento do mundo externo sobre o sucesso da Apple em IA.

Mas a Apple ainda detém as maiores remessas de smartphones do mundo. Mesmo que demore a agir em relação ao LLM na nuvem com parâmetros amplos, a empresa ainda tem grande influência na forma como as pessoas usam a IA e como os desenvolvedores aplicam a tecnologia de IA em seus projetos – isso é objetivo e inquestionável.

Na WWDC25 deste ano, vi a Apple exercendo esse direito de expressão. Ela disse aos desenvolvedores:

Deseja fornecer recursos de IA aos usuários? Sem problemas. Você pode usar o modelo de ponta fornecido pela Apple para executar o raciocínio LLM completamente localmente no dispositivo, sem a necessidade de conexão com a internet, o que protege a privacidade do usuário e não gera custos de nuvem.

O "Basic Model Framework" é uma ferramenta poderosa que a Apple entregou aos desenvolvedores.

O modelo básico é o núcleo da inteligência da Apple. No ano passado, ele era usado apenas para produtos e funções da própria Apple. A partir de hoje, a Apple abriu o modelo básico para desenvolvedores. Qualquer aplicativo de terceiros pode usar diretamente esses modelos básicos do lado do terminal para implementar funções baseadas em IA e proporcionar uma experiência totalmente nova aos usuários.

Por exemplo, o Kahoot!, um produto educacional demonstrado no local, pode usar o modelo do lado do cliente para gerar um conjunto de perguntas personalizadas para os usuários.

Ou o Alltrails, um produto essencial para entusiastas de caminhadas no exterior, pode fornecer aos usuários a assistência necessária mesmo em situações onde não há rede alguma em áreas montanhosas perigosas.

Então, quais são os modelos básicos?

- No ano passado, na WWDC, a Apple lançou um modelo de linguagem de ponta a ponta com 3 bilhões de parâmetros , bem como sua versão atualizada subsequente.

- Modelo ChatGPT personalizado para cliente/Apple.

——Pelo menos essas duas categorias são conhecidas (os tipos específicos de modelos são desconhecidos e a Apple ainda não forneceu informações mais específicas para não desenvolvedores). Atualmente, o "Basic Model Framework" oferece suporte nativo ao Swift (outras linguagens são desconhecidas), e os desenvolvedores precisam apenas de algumas linhas de código para acessá-lo, suportando geração de conteúdo, chamadas de ferramentas e outros recursos de LLM.

Mas hoje em dia, os desenvolvedores têm opções demais: DeepSeek, Claude, série O, Gemini… e seus diversos modelos oficiais e versões retreinadas para cenários específicos. Por que eles deveriam competir com o modelo básico da Apple?

A proposta de valor da Apple é direta.

Simplificando, há um custo econômico direto no uso desses LLMs. Quanto maior o número de usuários e o nível de atividade/aderência, maior o custo de chamar a API da nuvem e gerar tokens.

Diante desse tipo de custo, startups de destaque podem levantar fundos por meio de capital de risco, e grandes empresas podem usar reservas de caixa para subsidiá-los. Como resultado, os usuários de hoje estão acostumados há muito tempo com produtos de LLM gratuitos.

Mas para desenvolvedores de pequeno e médio porte, especialmente desenvolvedores independentes, isso se torna um problema muito prático: imagine que um usuário acabou de baixar seu aplicativo e quer testar sua função de IA, e imediatamente ele vê "Há 3 cotas de geração gratuitas este mês"… e se um de seus concorrentes for uma grande empresa, como você compete com ela?

Agora, a Apple oferece a "Estrutura do Modelo Básico" e abre o modelo final gratuitamente, permitindo que você utilize o poder de computação local do iPhone/iPad/Mac para executar o raciocínio LLM de forma rápida, eficiente e privada para atender às necessidades do usuário.

Você não precisa mais se preocupar com sua cadeia de capital para pagar taxas de API na nuvem; não precisa mais "mudar" sua estratégia de preços para cobrir os custos dos tokens. Você pode escolher com firmeza e decência o modelo de negócios que mais lhe agrada e que deixa seus usuários confortáveis — seja você um desenvolvedor pequeno, médio ou independente, isso não parece ótimo?

É uma situação vantajosa para desenvolvedores e usuários. É claro que, se você adicionar a Apple à mistura, todos sairão ganhando.

“Tarde, mas chegou”, versão AI

O conhecido desenvolvedor e analista da Apple John Gruber escreveu uma postagem de blog muito interessante alguns dias atrás.

Ele ressaltou que a Apple está sempre atrás de seus concorrentes em alguns produtos/tecnologias importantes, o que é algo que todos sabem; mas é preciso admitir que, na história da empresa, a Apple de fato não perdeu nenhuma grande revolução tecnológica de nível paradigmático.

Por exemplo, o navegador Safari da Apple e seu kernel de navegador WebKit foram lançados no início de 2003, oito anos depois do navegador Netscape, que fez sucesso no mundo todo e até ameaçou tirar a Microsoft do mercado, e até três anos depois do estouro da "bolha do .com" – mas antes tarde do que nunca, sem mencionar que não havia um bom navegador na plataforma Mac antes do Safari.

Se essa lógica for aplicada, a Apple, que é forçada a entrar na era da IA, precisa de uma nova combinação de tecnologia de produto que possa estar no mesmo nível do Safari/WebKit hoje.

A boa notícia é: como mencionado no início deste artigo, as vendas e a vantagem de mercado do iPhone são muito grandes. Não importa o quanto o mundo exterior zombe da Apple por ficar para trás na era da IA, uma realidade é inegável:

Por muito tempo, a Apple ainda terá voz suficiente para definir como os usuários usam a IA (em produtos iPhone/iPad/Mac/Vision) em vez de deixar a IA definir a aparência de seus produtos.

Você pode ver que a OpenAI adquiriu a empresa do antigo líder de design da Apple, Jony Ive, tentando desenvolver um novo dispositivo de formato que seja "completamente nativo de IA"; mas você também verá que a OpenAI e a Apple chegaram a um acordo para se tornarem o único "parceiro inteligente global" no ecossistema da Apple – ou seja, o único fornecedor externo de modelos básicos.

A Apple acha que está ficando para trás da OpenAI? Não. Caso contrário, a Apple deveria pagar à OpenAI. Pelo contrário, de acordo com o The Information, a OpenAI pagará à Apple um "pedágio" para entrar no ecossistema da Apple e se tornar o modelo básico padrão, assim como seu antecessor, o Google, que se tornou o mecanismo de busca padrão do iOS.

Se a taxa de assinatura mensal para usuários do ChatGPT for de US$ 20, a comissão da Apple pode chegar a 30%, e essa receita é quase igual ao lucro líquido.

Veja bem, a Apple coleta dinheiro da OpenAI e então subsidia desenvolvedores e usuários finais disfarçadamente – não é surpreendente?

Na conferência de resultados do primeiro trimestre de 2009 da Apple, Cook, que ocupava o cargo de CEO interino da Apple pela segunda vez devido à grave doença de Jobs, disse algumas palavras que mais tarde ficaram conhecidas como o "Credo Cook". Uma delas foi:

Acreditamos que precisamos possuir e controlar as principais tecnologias por trás dos produtos que produzimos e participar apenas de mercados nos quais podemos fazer uma contribuição significativa.

Combinado com a análise de John Gruber, resumi essa ideia em uma frase:

A Apple deveria criar um dispositivo, uma operadora para executar produtos/serviços/LLM de IA e, então, usar esse dispositivo/operadora para definir como as pessoas usam a IA, em vez de deixar a IA definir como desenvolver produtos.

Após a WWDC25, o mundo exterior poderá adotar essa nova perspectiva ao observar e comentar o trabalho de IA da Apple.

Apple smart, micro atualização

Por fim, vamos dar uma olhada em outros novos anúncios de IA da WWDC25.

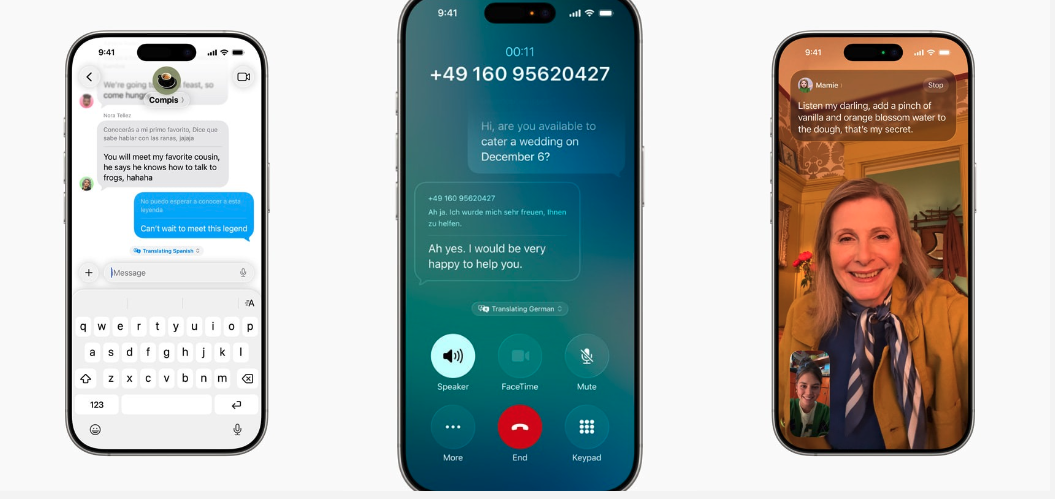

Tradução em tempo real

A Apple finalmente integrou uma função de tradução em tempo real no iOS/iPadOS/macOS que atinge o nível de referência da indústria (dois ou três anos atrás).

Atualmente, a tradução em tempo real suporta três aplicativos: Mensagens, Telefone e FaceTime. Todas as traduções podem ser concluídas integralmente no lado do cliente.

- Ao enviar uma mensagem, o usuário pode inseri-la em seu próprio idioma, ver a saída de streaming de texto em idioma estrangeiro traduzido em tempo real na interface do usuário e, então, clicar manualmente para enviar; da mesma forma, a mensagem enviada pela outra parte também pode ser traduzida automaticamente na interface do usuário local.

- No telefone, o texto original é falado primeiro e depois ambas as partes podem ouvir o texto traduzido.

- No FaceTime, uma parte pode falar e a outra pode ver as legendas traduzidas.

Genmoji e Playground de Imagens

Genmoji: Os usuários agora podem usar comandos de prompt do LLM para gerar avatares Genmoji com mais elementos novos. Por exemplo: combine uma preguiça e uma lâmpada.

No Image Playground, os usuários podem chamar o modelo multimodal do ChatGPT para gerar fotos de estilos diferentes ou aleatórios – você pode pensar nisso como um shell oficial do Apple OpenAI 4o.

Inteligência Visual

O Visual Intelligence já ofereceu suporte à busca de fotos por câmera e, na WWDC deste ano, recebeu outra atualização surpreendente: suporte para busca de captura de tela/interação subsequente.

Por exemplo, você pode pesquisar itens diretamente na captura de tela chamando qualquer aplicativo da App Store ou ler a data, a hora e o local na captura de tela e adicioná-los a um item de calendário ou memorando.

(A inteligência visual está finalmente alcançando o que o Google Image Search e o Lens alcançaram há 6 ou 7 anos.)

Mas o principal que deixa sem palavras é que o método de interação é muito antiquado: capturas de tela, em vez de ser como os telefones Android no primeiro semestre de 2025, que podem ler e responder diretamente ao conteúdo na tela do usuário sem fazer capturas de tela, e ainda ter recursos de agente que podem controlar diretamente a tela em nome do usuário.

Claro, meu entendimento é que a Apple pode fazer isso por dois motivos: 1) seus recursos são de fato inferiores aos dos fabricantes do Google/Android; 2) devido a questões de privacidade, os usuários são obrigados a fazer capturas de tela manualmente e clicar no botão de reconhecimento visual inteligente.

Atalhos

O Shortcuts é compatível com smartphones da Apple, permitindo que os desenvolvedores façam algumas modificações e adaptem seus aplicativos, permitindo que os usuários gerem atalhos rapidamente. Não sei quantas pessoas usam atalhos, mas deve haver dezenas deles ao redor do mundo.

#Bem-vindo a seguir a conta pública oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde mais conteúdo interessante será apresentado a você o mais breve possível.