O modo adulto do ChatGPT está chegando, mas como adulto não estou nada feliz

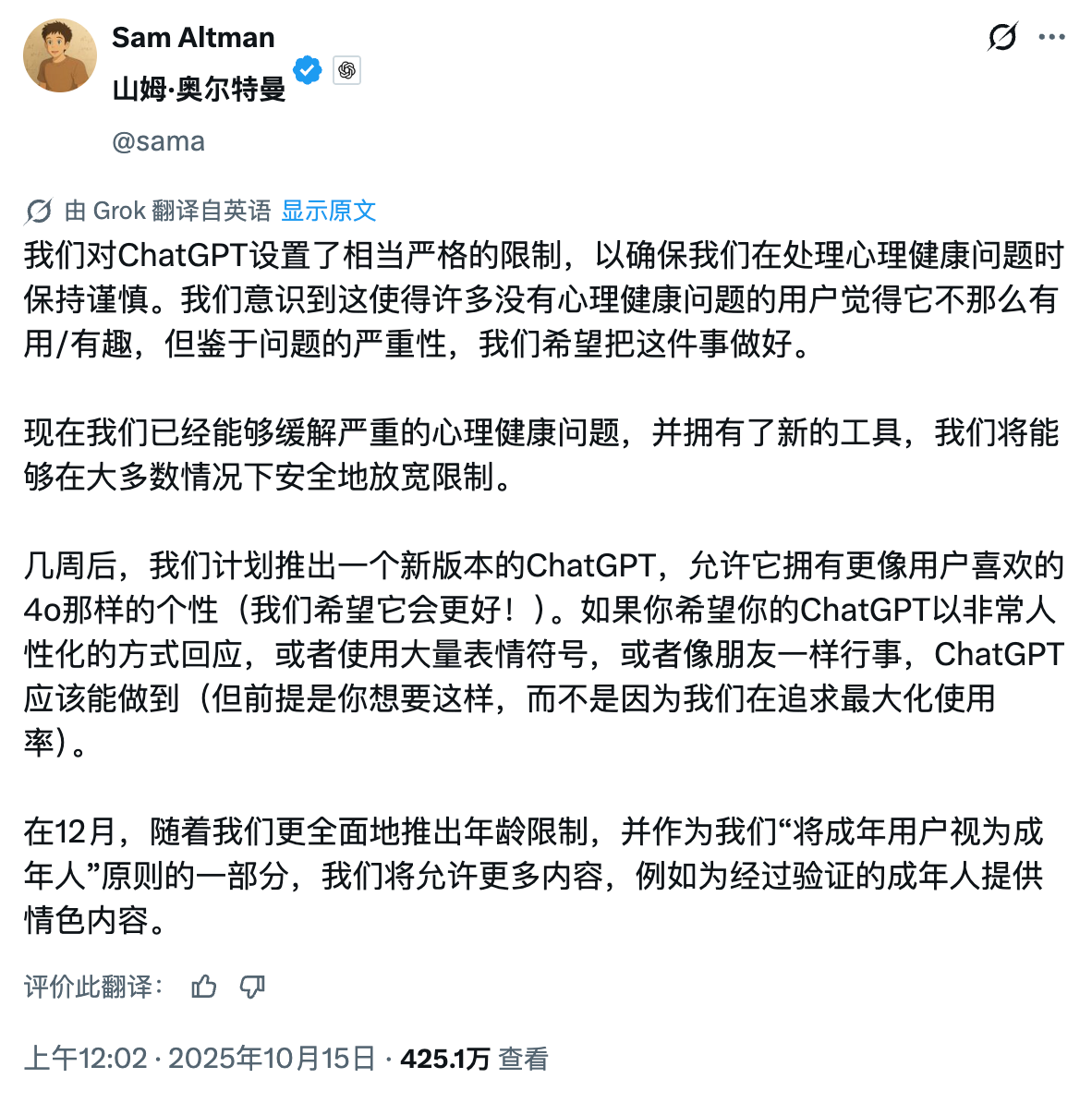

No início desta manhã, o CEO da OpenAI, Sam Altman, anunciou que o ChatGPT lançará um "modo adulto" em dezembro.

Altman deu uma longa explicação, cujo ponto principal era que o ChatGPT inicialmente estabeleceu muitas restrições principalmente por preocupação com problemas de saúde mental e medo de acidentes, o que fez com que usuários comuns achassem a experiência ruim e não interessante o suficiente.

Agora que a OpenAI afirma ter dominado novas ferramentas de segurança que podem mitigar os principais riscos relacionados à saúde mental, ela está pronta para liberar seu poder. Em dezembro, usuários adultos verificados poderão desbloquear mais conteúdo, incluindo conteúdo erótico.

Sim, era isso que você queria dizer.

Resumindo, a OpenAI afirma que é hora de tratar os adultos como adultos. No entanto, como adulto, não estou nada feliz.

Além disso, de acordo com Altman, a OpenAI lançará uma nova versão mais humana do ChatGPT nas próximas semanas, semelhante à sensação do 4o que todos gostavam antes.

Quer que ele responda com um pouco mais de carinho? Sem problemas. Quer que ele te envie muitos emojis? E quer que ele converse com você como um amigo? É tudo seu.

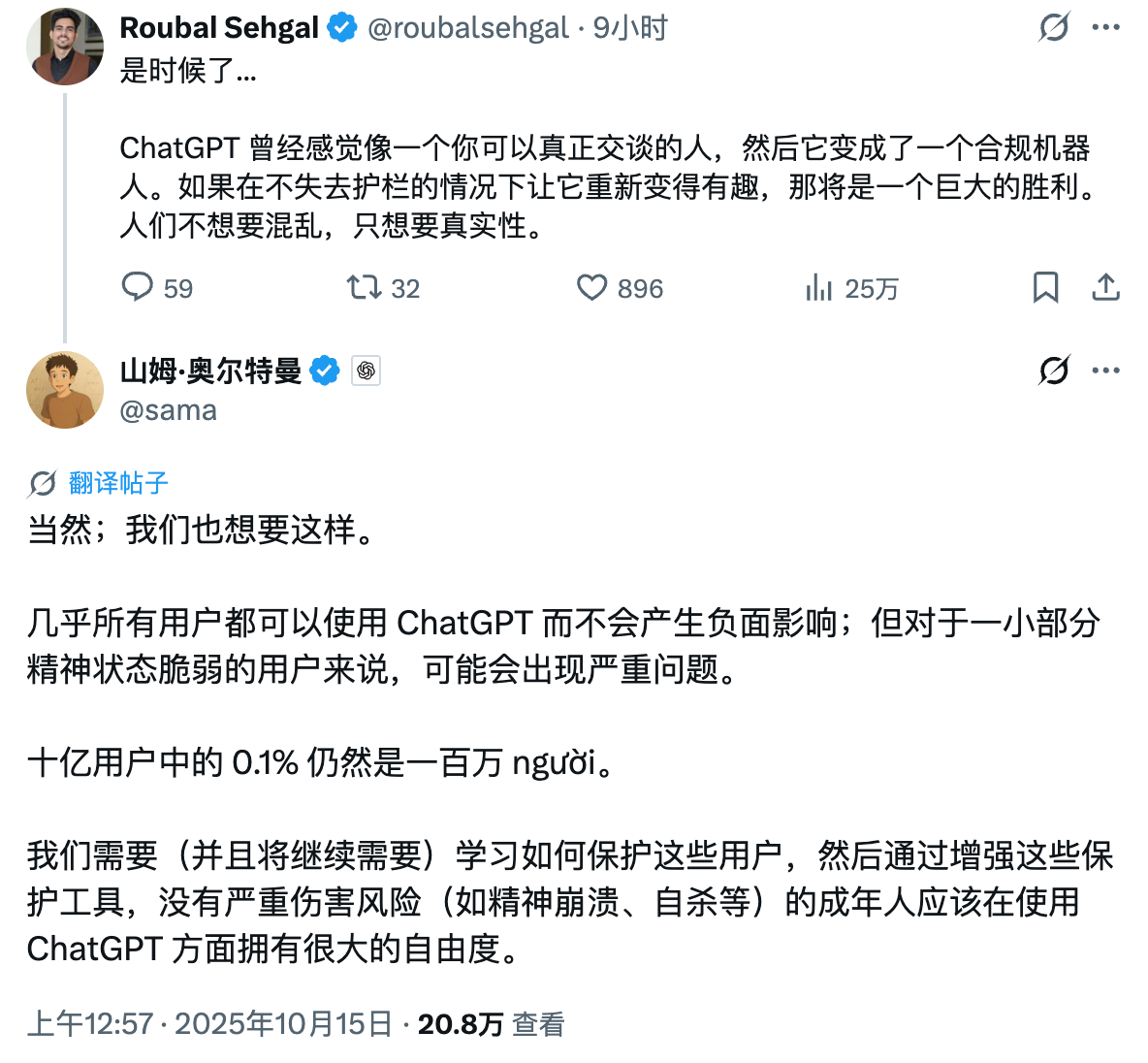

Em uma sessão de perguntas e respostas com internautas, Ultraman também respondeu com mais detalhes.

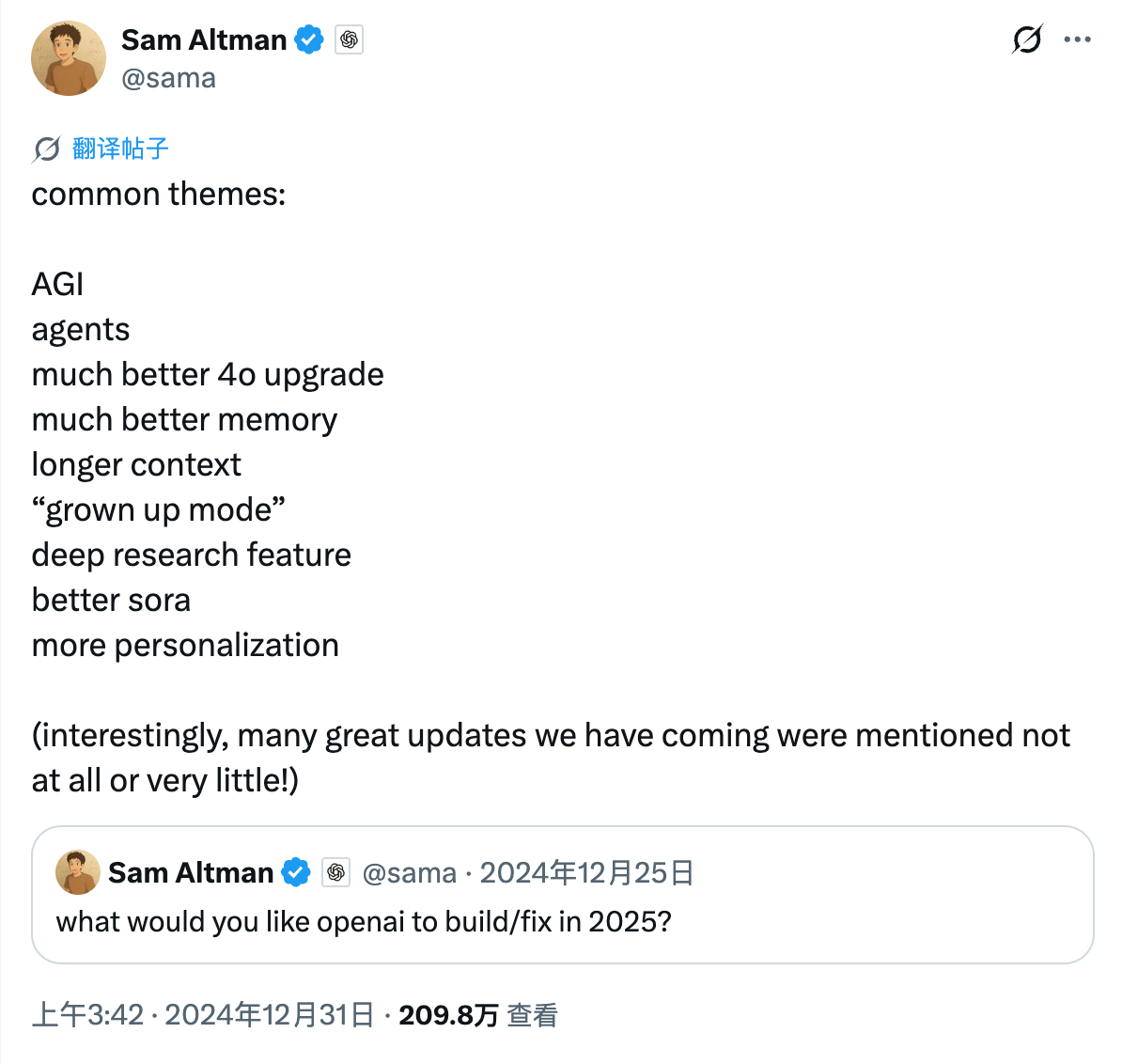

Na verdade, já havia sinais do ChatGPT há muito tempo.

No final do ano passado, o Ultraman revelou planos para oferecer suporte a um modo adulto. Quando internautas sugeriram remover a maioria das proteções do modelo, o Ultraman respondeu: "Algum tipo de 'modo adulto' é definitivamente necessário."

Na votação de novos recursos que a OpenAI solicitou dos usuários na época, esse problema liderou a lista e foi incluído no plano de produto de 2025 junto com AGI, Agent e a versão atualizada do GPT-4 , o que mostra quanta atenção ele recebeu.

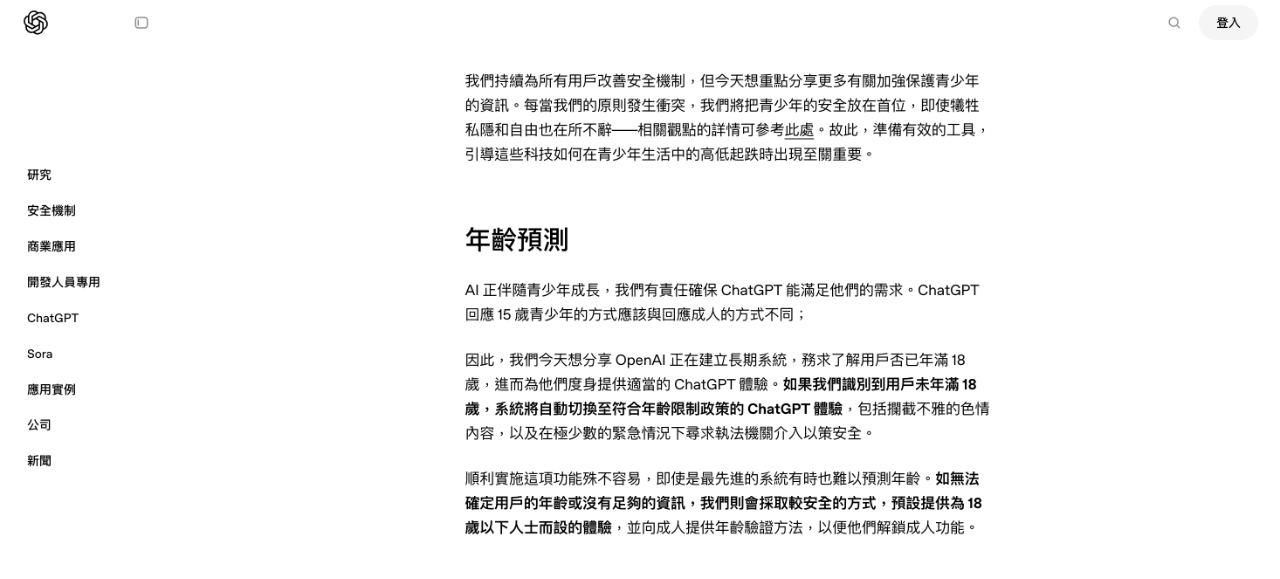

De acordo com o blog oficial da OpenAI, a função atual de verificação de idade pode identificar automaticamente usuários menores de idade e alternar para o modo de segurança para jovens para bloquear conteúdo sexual explícito; se a idade não puder ser determinada, presume-se que seja menor de idade, e as funções para adultos só podem ser desbloqueadas após fornecer comprovante de idade.

Parece bastante abrangente, não é? Mas um olhar mais atento revela que as coisas não são tão simples assim.

Parece bastante abrangente, não é? Mas um olhar mais atento revela que as coisas não são tão simples assim.

Mesmo que a OpenAI adote a verificação de identidade ou pagamento no futuro, métodos de evasão continuarão a surgir. Menores de idade usando os documentos de identidade dos pais para verificação ou pedindo que adultos criem contas em seu nome já são práticas comuns em produtos de internet.

Mais importante, a OpenAI afirma ter desenvolvido novas ferramentas para detectar os estados mentais dos usuários, mas a IA pode realmente julgar com precisão a saúde mental de uma pessoa?

Você sabe, nos últimos anos, incidentes trágicos envolvendo o ChatGPT têm ocorrido com frequência, e ainda é questionável se a "válvula de segurança" reivindicada pela OpenAI pode realmente desempenhar o papel de proteção devida.

Honestamente, a OpenAI nem sequer é o primeiro produto de IA influente a anunciar suporte para um "modo adulto" e, até certo ponto, é considerada conservadora. O chatbot de IA de Elon Musk, Grok , é o verdadeiro desinibido.

Em julho deste ano, Musk adicionou uma função de personagem virtual 3D ao Grok.

Usuários que assinam o "SuperGrok" (uma taxa mensal de US$ 30) podem ativar dois companheiros 3D: um é uma garota loira de cauda dupla estilo anime, "Ani", e o outro é um panda vermelho de desenho animado, "Bad Rudy".

Ani, uma sofisticada personagem 2D, lembra a personagem de anime Misa Amane . Ani suporta interação multimodal via texto, voz e câmera, e pode responder a conversas com uma variedade de expressões e movimentos, até mesmo dançando sob comando.

Além disso, Ani também possui um mecanismo de favorabilidade e modo de memória integrados. Os usuários podem melhorar sua favorabilidade virtual interagindo com ela, e atingir um certo nível pode desbloquear o modo NSFW (adulto).

Na época, um internauta comentou: "É simplesmente um Galgame (jogo de amor) de alto nível." Isso também fez com que Ani ganhasse uma grande quantidade de conteúdo criado espontaneamente em um dia após seu lançamento, e rapidamente se tornou popular nas redes sociais.

No entanto, seja Grok ou ChatGPT, essas funções estão ostensivamente sob a bandeira de "respeitar a liberdade de usuários adultos", mas o problema é que, uma vez que há uma brecha no mecanismo de verificação de idade, a abertura de conteúdo adulto está, na verdade, diminuindo o limite para menores acessarem conteúdo inapropriado.

Se os chamados direitos dos adultos forem, na verdade, uma aposta na saúde mental e no ambiente de crescimento dos menores, e uma aposta de que os adolescentes não tirarão vantagem das brechas, então restrições mais rígidas podem ser mais seguras.

Para ser mais direto, a lógica de negócios dessas funções ainda é competir pelo tráfego de usuários e aumentar as taxas de conversão de pagamento.

Para ser franco, a aderência dos produtos de IA geralmente não é alta.

A maioria dos usuários segue o princípio de usar o que funciona melhor, e o número de usuários profissionais (em pesquisa científica, programação, etc.) dispostos a pagar é limitado. Então, o que eles devem fazer? Eles optam por usar métodos mais humanizados para manter você (ou se viciar).

Isso está se inclinando para o "desejo". Abrir recursos voltados para adultos pode, por um lado, atrair um grande número de novos usuários para experimentá-lo, satisfazendo as necessidades daqueles que foram filtrados; por outro lado, aumentará significativamente sua disposição de pagar.

Conteúdo pornográfico e bizarro sempre foi um catalisador para o tráfego na internet. Abrir recursos voltados para adultos pode, por um lado, atrair um grande número de novos usuários, satisfazendo as necessidades daqueles que foram excluídos; por outro, pode aumentar significativamente sua disposição a pagar.

O que vai além é, na verdade, o grande bolo da companhia emocional.

Atualmente, os principais usuários de produtos complementares de IA são, em sua maioria, jovens internautas e grupos demográficos específicos (como aqueles interessados no gênero anime e mangá e aqueles com ansiedade social), mas esse segmento está se expandindo. Os jovens são os mais receptivos a produtos complementares digitais, e muitos adotaram a IA como parte de suas vidas digitais diárias, usando-a não apenas para pesquisas e perguntas e respostas, mas também para compartilhamento emocional.

A empresa de investimentos ARK Invest prevê ainda que o tamanho do mercado global de "IA + companhia emocional" aumentará de US$ 30 milhões por ano para US$ 70 bilhões a US$ 150 bilhões, com uma taxa média de crescimento anual de mais de 200%.

O problema é que a pesquisa psicológica há muito confirma que os humanos tendem a desenvolver apegos àqueles com quem simpatizam — mesmo sabendo que são programas. Isso também significa que a IA corre o risco de ser manipulada pelas emoções.

Atualmente, reguladores em vários países estão tomando medidas.

O projeto de lei de IA da UE menciona que a IA de alto risco deve ser impedida de ser prejudicial às crianças; as "Medidas para a Administração de Serviços de Inteligência Artificial Generativa" da China também enfatizam que a prestação de serviços deve estar em conformidade com a lei de proteção de menores, etc.

A OpenAI lançou recentemente um "modo adolescente": os pais podem vincular suas contas às de seus filhos maiores de 13 anos por e-mail e até mesmo definir toques de recolher. Se o sistema detectar sofrimento emocional grave em um adolescente, enviará um lembrete ao responsável.

Talvez em dez anos, ter um companheiro de IA seja tão comum quanto ter um animal de estimação hoje em dia.

Mas será que uma geração criada com os "relacionamentos perfeitos" da IA ainda consegue entender os relacionamentos humanos reais? Quando você está acostumado a uma IA que nunca o rejeita, sempre o compreende e sempre segue seu caminho, você ainda tem coragem de encarar uma pessoa real que pode discutir com você, decepcioná-lo e exigir sua opinião?

Agir como amigo é talvez a mentira mais tentadora, porém mortal. Ele aprende seus hábitos de linguagem, atende aos seus valores, satisfaz seus desejos e, então, encapsula tudo isso como uma forma de compreensão e reflete isso de volta.

Este é o melhor dos tempos, porque ninguém mais está sozinho. Este é o pior dos tempos, porque todos estão sozinhos. O ChatGPT em dezembro pode ser apenas o começo.

#Bem-vindo a seguir a conta pública oficial do WeChat do iFaner: iFaner (ID do WeChat: ifanr), onde mais conteúdo interessante será apresentado a você o mais breve possível.