Nvidia e Microsoft estão resolvendo um grande problema com Copilot+

Quando a Microsoft anunciou os PCs Copilot+ há algumas semanas, uma pergunta reinou suprema : por que não posso simplesmente executar esses aplicativos de IA na minha GPU? Na Computex 2024 , a Nvidia finalmente deu uma resposta.

Nvidia e Microsoft estão trabalhando juntas em uma interface de programação de aplicativos (API) que permitirá aos desenvolvedores executar seus aplicativos acelerados por IA em placas gráficas RTX. Isso inclui os vários Small Language Models (SLMs) que fazem parte do tempo de execução do Copilot, que são usados como base para recursos como Recall e Live Captions.

Com o kit de ferramentas, os desenvolvedores podem permitir que aplicativos sejam executados localmente em sua GPU em vez de na NPU. Isso abre a porta não apenas para aplicativos de IA mais poderosos, já que os recursos de IA das GPUs são geralmente superiores aos dos NPUs, mas também a capacidade de execução em PCs que atualmente não estão sob a égide do Copilot+.

É uma ótima jogada. Os PCs Copilot+ atualmente exigem uma Unidade de Processamento Neural (NPU) que seja capaz de pelo menos 40 Tera Operações por Segundo (TOPS). No momento, apenas o Snapdragon X Elite atende a esse critério. Apesar disso, as GPUs têm capacidades de processamento de IA muito maiores, mesmo com modelos de gama baixa atingindo 100 TOPS, e opções de ponta com escala ainda maior.

Além de rodar na GPU, a nova API adiciona recursos de geração aumentada de recuperação (RAG) ao tempo de execução do Copilot. O RAG dá ao modelo de IA acesso a informações específicas localmente, permitindo-lhe fornecer soluções mais úteis. Vimos o RAG em exibição total com o Chat da Nvidia com RTX no início deste ano.

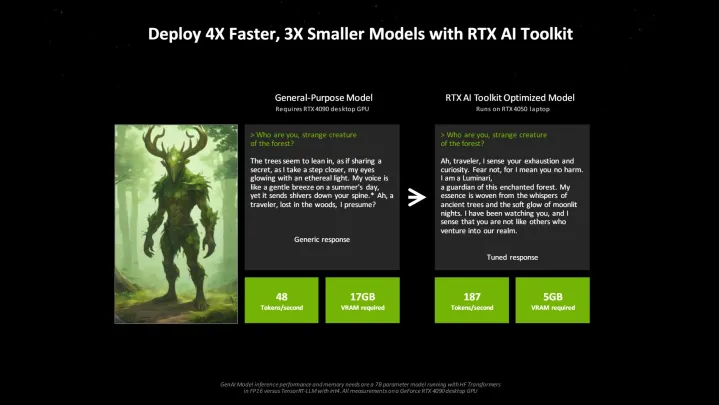

Fora da API, a Nvidia anunciou o RTX AI Toolkit na Computex. Este pacote de desenvolvedores, que chega em junho, combina várias ferramentas e SDKs que permitem aos desenvolvedores ajustar modelos de IA para aplicações específicas. A Nvidia diz que usando o RTX AI Toolkit, os desenvolvedores podem criar modelos quatro vezes mais rápidos e três vezes menores em comparação com o uso de soluções de código aberto.

Estamos vendo uma onda de ferramentas que permitem aos desenvolvedores criar aplicações específicas de IA para usuários finais. Parte disso já está aparecendo nos PCs Copilot+, mas suspeito que veremos muito mais aplicações de IA neste momento no próximo ano. Afinal, temos o hardware para executar esses aplicativos; agora só precisamos do software.