No terceiro aniversário do ChatGPT, sinto falta dos dias em que eu escrevia muito mal.

Papel de parede bege

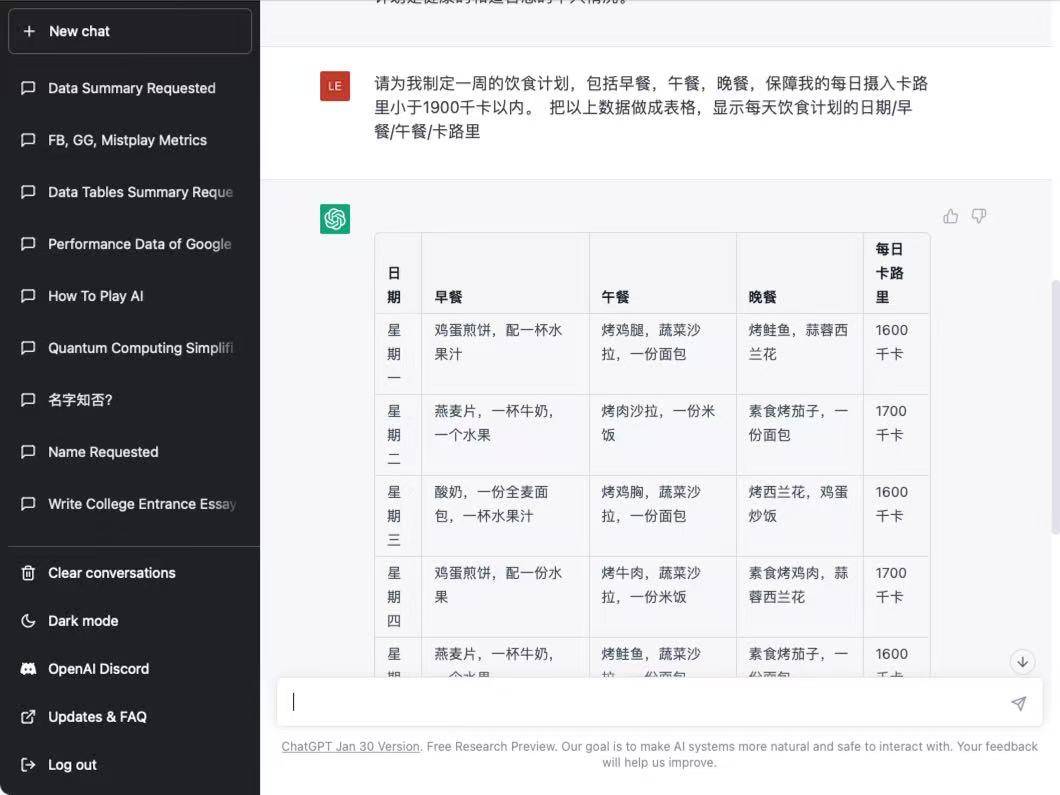

Relembrei a primeira tarefa que pedi ao ChatGPT: sem surpresas, era escrever um documento em inglês. Depois disso, também pedi que criasse um plano alimentar para perda de peso, como todo mundo faz. O icônico esquema de cores preto e verde daquela época realmente me trouxe boas lembranças.

Naquela época, o GPT não era tão persuasivo ou inteligente quanto é agora. Eu precisava dividir textos longos em seções e adicionar uma instrução no início de cada mensagem para garantir que ele entendesse a tarefa.

Há três anos, o ChatGPT surgiu como um cometa, não apenas por sua conveniência e inteligência em tarefas transacionais, mas também por sua capacidade de "agir como um humano" nessas conversas e discussões. Seja por sua capacidade de memória ou por sua habilidade de produzir frases que nunca se repetem, ele fez com que as pessoas percebessem, pela primeira vez, que uma linguagem puramente binária poderia realmente funcionar dessa maneira.

É logicamente sólido, emocionalmente rico e quase perfeito. De agora em diante, o "limiar da expressão" deixa de existir. Erros gramaticais, erros ortográficos e formulações imprecisas podem ser entregues ao grande modelo de linguagem que absorveu bilhões de pontos de dados, o qual produzirá um resultado sem erros — mesmo com apenas uma entrada.

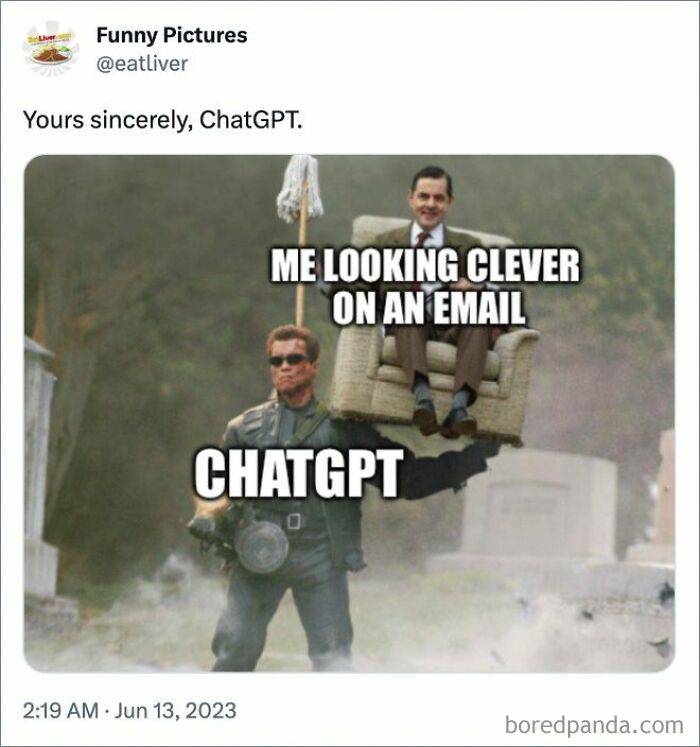

Mas qual é o preço a pagar? Na crítica literária, existe um termo chamado "prosa bege", que se refere a um estilo de escrita simples e conciso, semelhante ao conceito chinês de "descrição". Esse estilo é conciso e confortável, mas também carece de originalidade; como a cor branco-sujo, não comete erros, mas também não se destaca.

É muito semelhante ao que o ChatGPT oferece. Embora três anos tenham se passado e as atualizações do modelo estejam se tornando mais robustas a cada iteração, ele nunca se desvia do núcleo do LLM e do Transformer: a probabilidade.

A Tirania da Probabilidade

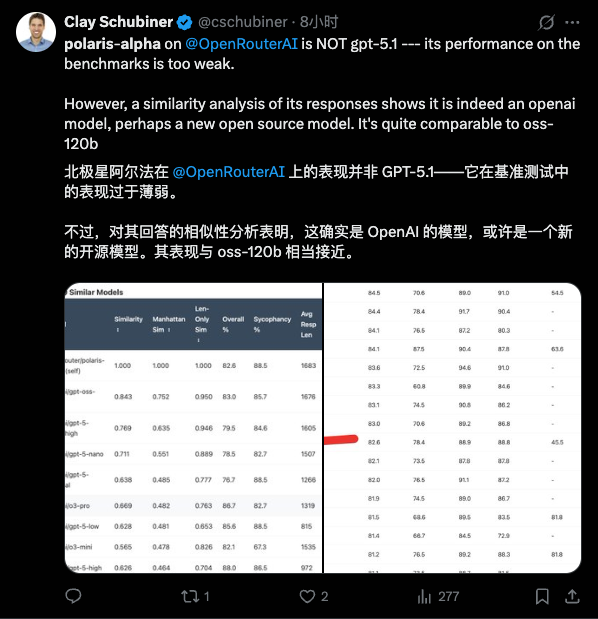

Para ser justo, o tom e o estilo do GPT desenvolveram uma espécie de "sabor de IA" e se tornaram bastante reconhecíveis. Antes do lançamento do GPT 5.1, ele foi lançado como um modelo anônimo na plataforma OpenRouter, e os internautas o identificaram como um produto da OpenAI ao comparar suas respostas com as de modelos anteriores.

O ChatGPT evoluiu ao longo das gerações, cada uma com seu próprio estilo de escrita distinto: o clássico "não…mas…", o antigo "pegadinha" e "estou aqui", o uso duradouro de travessões, negrito e o aparecimento indiscriminado de emojis.

Embora esses truques nem sempre sejam atraentes, eles não causam grandes problemas: essencialmente, os grandes modelos de linguagem estão "prevendo a próxima palavra" e agem com base na probabilidade. Contanto que sigam o máximo divisor comum, qual o problema?

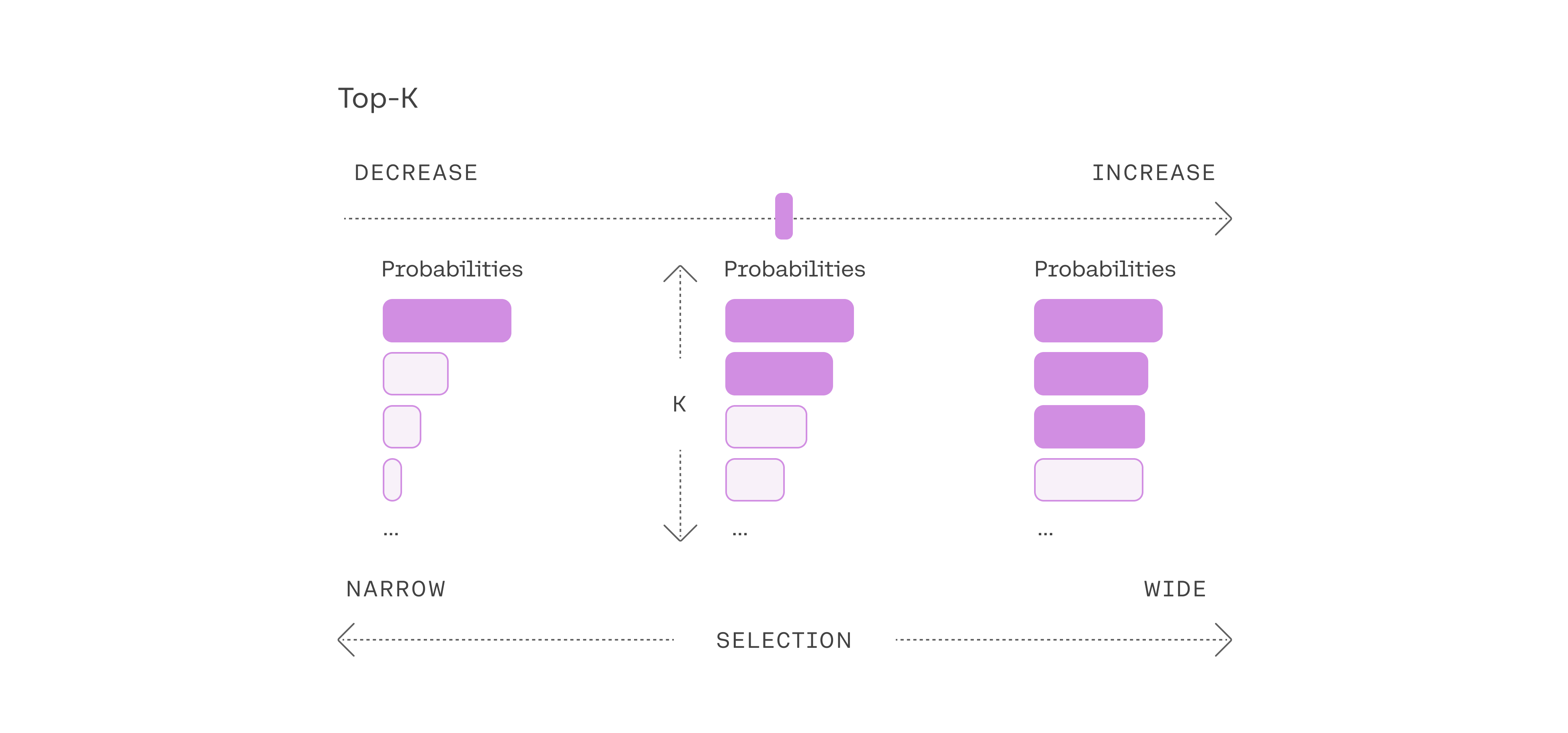

No entanto, um fato pouco conhecido é que os algoritmos de modelagem nem sempre escolhem a palavra com a maior probabilidade na previsão — isso explica por que o mesmo estímulo pode gerar resultados diferentes para a mesma ideia geral. A engenharia de algoritmos introduz métodos como Temperatura, Top-P e Top-K para injetar aleatoriedade nos resultados.

Para se adequar às definições de "utilidade" e "segurança" no Aprendizado por Reforço com Feedback Humano (RLHF), esses parâmetros são variados, mas ainda devem ser amostrados de um "conjunto de palavras com probabilidades mais altas". Portanto, o algoritmo não simplesmente gera o valor médio, mas sim desenha um círculo, fazendo pequenos ajustes desde que não haja erros significativos.

Assim, ao longo dos últimos três anos, desde as avaliações de lojas no Xiaohongshu até as autoanálises nos resumos de fim de ano, e até mesmo a redação inicial de textos para contas de marketing, você encontrará uma semelhança impressionante: todo o texto se tornou fluente, todas as opiniões se tornaram "não…mas", e embora haja bons momentos ocasionais, no geral, todas as emoções se tornaram grosseiras e monótonas. O ChatGPT traz uma criatividade sem riscos, mas também a tirania da probabilidade. Em certa medida, os algoritmos abominam surpresas; sua essência é a suavidade.

Independentemente disso, o conteúdo influenciado por IA já permeou nossas vidas e, gradualmente, já não nos incomodamos mais com isso. Desenvolvemos um estranho entendimento tácito com a IA: em nome da eficiência e da adequação, estamos dispostos a abrir mão de parte da nossa personalidade.

Pensamento reverso

Se nos dois primeiros anos estávamos treinando a IA, no terceiro ano, a IA começou a nos treinar. Especialmente no terceiro ano, à medida que vários aplicativos e ferramentas se tornaram cada vez mais fluidos e versáteis, a relação entre usuários e IA evoluiu para uma estranha "simbiose".

Isso se reflete no fato de não conseguirmos mais distinguir quem está treinando quem.

Inicialmente, pensávamos que estávamos treinando uma IA. Fornecemos dados, feedback e a ensinamos a falar como um humano.

Além dos engenheiros, ninguém o utiliza para treinar outros; todos o usam para resolver problemas específicos e fornecer respostas ou até mesmo resultados mais complexos. Portanto, para obter respostas mais precisas, começamos a estudar a "engenharia de instruções". Aprendemos a decompor pensamentos humanos complexos e ambíguos em instruções claras e logicamente progressivas.

Antes de fazer uma pergunta, realizamos uma rodada de "pré-processamento" em nossas mentes, eliminando aqueles pensamentos excessivamente emocionais ou impulsivos, porque subconscientemente sabemos: "A IA não entende essas coisas, então temos que dar instruções de uma forma que ela possa entender."

O processo de usar ferramentas consiste em sermos moldados por elas — uma afirmação que já nos cansamos de repetir. Portanto, diante de um modelo de linguagem amplo que enfatiza a fluidez, nós também mudamos, tornando-nos mais lógicos, mais eficientes e mais parecidos com máquinas.

Ao observar o texto sendo gerado rapidamente na tela, sentimos tanto a emoção de "ter tudo sob controle" quanto a sensação de vazio, uma perda de subjetividade, que nos sufoca nas sombras.

O único que sobrou

"Isso sequer pode ser considerado uma atualização?" No terceiro ano, as atualizações do ChatGPT já não causavam o mesmo espanto de antes; em vez disso, eram recebidas com mais reclamações e queixas. O que a Apple levou mais de uma década para alcançar, a OpenAI conseguiu em três anos.

Apesar das reclamações, as pessoas ainda o usam. O ChatGPT agora é um supergigante com 700 milhões de usuários e, em seu aniversário, recebeu muitas "parabéns" — até Robert ficou com inveja.

Considerando a insatisfação e os protestos de usuários de todo o mundo contra a remoção forçada do 4o quando o GPT 5 foi lançado, você precisa encarar uma coisa: existe outra dimensão em nosso relacionamento com o ChatGPT chamada "dimensão emocional".

Cada vez mais pessoas estão confiando seus segredos mais íntimos ao ChatGPT. Parece trágico, mas se você já passou por isso, vai achar a tensão incrivelmente cativante: você sabe que há um monte de multiplicações de matrizes frias do outro lado da tela, sabe que a "empatia" é apenas uma simulação estatística. Mas, às vezes, essa "compreensão simulada" é muito mais suave do que a "impaciência real".

A escuta humana muitas vezes vem acompanhada de julgamento, da arrogância do "eu te avisei" ou da ansiedade de oferecer conselhos precipitadamente. A IA, por outro lado, simplesmente escuta (ou melhor, processa), simplesmente acalma; proporciona uma "intimidade sem riscos", e incondicionalmente.

"A julgar pelas ações, não pelas intenções", e além disso, a Teoria Geral da Percepção (TGP) não tem intenção. Parece que somente na presença de um objeto sem forma física uma pessoa pode realmente baixar a guarda.

A tensão na dimensão emocional representa melhor nossa relação com o ChatGPT: frequentemente ajudando, sempre confidenciando e, ocasionalmente, nos envolvendo em conflitos.

Essa relação também representa o primeiro estágio da nossa interação com a inteligência artificial. Três anos é muito tempo, mas também muito pouco; é apenas um pequeno passo, ainda incipiente, na longa jornada entre a humanidade e a tecnologia.

Nos próximos três anos, e depois por mais três, continuaremos nessa relação tensa, e a coisa mais "humana" que podemos fazer é manter esse pequeno envolvimento ocasional — para que possamos provar que a pessoa sentada em frente à tela ainda é uma pessoa complexa, contraditória e imprevisível.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.