Não é a pessoa que está entrevistando você? Nova York planeja restringir “entrevistadores” de inteligência artificial

"Não podemos fornecer feedback específico sobre os resultados de sua entrevista."

Nos Estados Unidos, cada vez mais empregadores estão usando inteligência artificial (IA) para acelerar o processo de recrutamento. Mas os candidatos a emprego raramente sabem por que as ferramentas de recrutamento de IA rejeitam seus currículos ou como analisar suas entrevistas em vídeo. Quando perdem a eleição, muitas vezes eles só podem receber um e-mail frio, sem saber por que perderam a eleição.

▲ Imagem de: unsplash

Isso é perturbador. Que tipo de poder de decisão a IA desempenha em nossas carreiras?

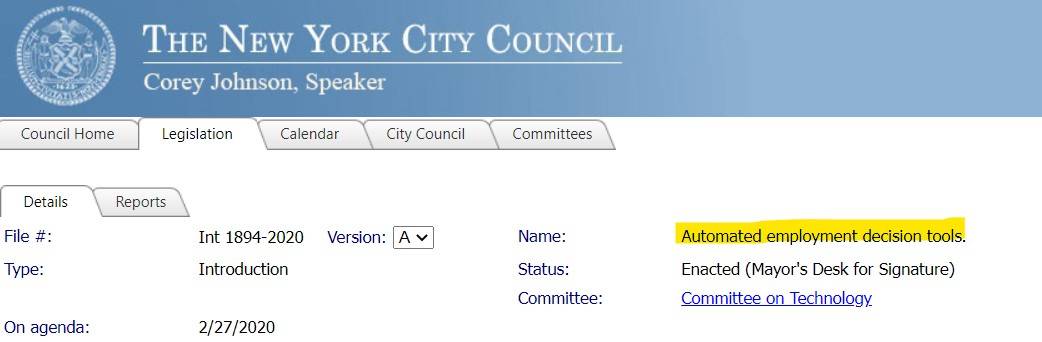

A Associated Press informou que, no início de novembro, o Conselho da Cidade de Nova York aprovou um projeto de lei por 38 votos a 4: se o sistema de recrutamento de IA não for aprovado na auditoria anual, será banido. A auditoria anual verificará o sistema de recrutamento de IA quanto à discriminação racial ou de gênero, permitindo que os candidatos a emprego escolham alternativas, como revisão manual, e os desenvolvedores de IA precisarão divulgar mais detalhes que não eram transparentes no passado.

Curiosamente, são os desenvolvedores de IA os responsáveis pela auditoria anual, mas o empregador será punido. Se eles usarem um sistema de recrutamento de IA que não passar na auditoria anual, a penalidade máxima para cada violação é de US $ 1.500.

Os defensores acreditam que o projeto abrirá uma janela para algoritmos complexos. Os algoritmos geralmente classificam habilidades e personalidades com base em como os candidatos a emprego falam ou escrevem, mas é duvidoso que a máquina possa julgar de forma precisa e justa as características da personalidade e os sinais emocionais.Este processo será mais transparente no futuro.

No mínimo, faz sentido saber que "o algoritmo é rejeitado porque é tendencioso". Sandra Wachter, professora de direito técnico da Universidade de Oxford, disse certa vez:

A lei antidiscriminação é principalmente motivada por queixas. Se eles não souberem o que lhes aconteceu, ninguém pode reclamar por ter sido negada uma oportunidade de emprego.

A empresa iniciante Pymetrics também apóia muito esse projeto de lei. Eles defendem o uso de IA para conduzir entrevistas por meio de jogos e outros métodos e acreditam que isso atende aos requisitos de justiça. Ao mesmo tempo, programas de entrevista de IA desatualizados serão jogados no lixo. HireVue, um provedor de sistema de recrutamento de IA, começou a descontinuar sua ferramenta de escaneamento facial no início deste ano, chamada de "pseudociência" pela academia, uma reminiscência da teoria frenológica do racismo.

A maior parte da oposição ao projeto de lei se baseia em "isso está longe de ser suficiente". Alexandra Givens, presidente do Center for Democracy and Technology, apontou que a proposta realmente exige que os empregadores atendam aos requisitos existentes da Lei de Direitos Civis dos Estados Unidos, que proíbe o recrutamento que tem efeitos diferentes com base na raça, etnia ou gênero, mas ignora o preconceito contra deficiência ou idade.

▲ Imagem de: unsplash

E alguns especialistas em inteligência artificial e ativistas de direitos digitais temem que o projeto de lei apenas permita que os desenvolvedores de IA se autocertifiquem que cumpriram os requisitos básicos e apenas estabelece padrões fracos para reguladores e legisladores federais. O "viés de auditoria" específico é muito vago.

É importante notar que vieses não são incomuns em entrevistas.O principal problema está no algoritmo de alimentação da amostra, mas muitas vezes são colocados em uma "caixa preta", que é difícil para os candidatos comuns a emprego.

Há alguns anos, a Amazon descontinuou sua ferramenta de varredura de currículos porque favorecia homens em cargos técnicos. Parte do motivo é que ele compara as condições dos candidatos a emprego com a mão-de-obra qualificada masculina dentro da empresa; da mesma forma, se o algoritmo se alimenta de setores onde as diferenças de raça e gênero já são comuns, ele está apenas consolidando o preconceito.

Esse preconceito não é só contratar. Em abril deste ano, um novo estudo da University of Southern California mostrou que o Facebook está exibindo anúncios de maneiras que podem violar a Lei de Antidiscriminação. Os homens são mais propensos a ver anúncios de recrutamento de entregadores de pizza, enquanto as mulheres são mais propensos a ver veja compras. anuncie.

▲ Imagem de: unsplash

Em essência, a discriminação de IA é cultivada pela sociedade humana, e o comportamento tendencioso do indivíduo é até mesmo subconsciente, e podemos não estar cientes disso. Se você comparar uma empresa com menos preconceito com uma empresa com sério preconceito, geralmente há dois motivos – o primeiro é melhor para eliminar deliberadamente o preconceito e o segundo é melhor para coletar status quo irracional e perpetuá-lo.

Portanto, a opinião neutra acredita que a melhor parte da proposta da cidade de Nova York são seus requisitos de divulgação para permitir que as pessoas saibam que estão sendo avaliadas pela IA, como estão sendo avaliadas pela IA e para onde seus dados estão indo.

▲ Materiais de referência:

1.https: //apnews.com/article/technology-business-race-and-ethnicity-racial-injustice-artificial-intelligence-2fe8d3ef7008d299d9d810f0c0f7905d

2.https: //apnews.com/article/job-seekers-artificial-intelligence-hiring-decisions-784ccec7ac6175aadc573465ab604fb9

#Bem-vindo a seguir a conta oficial do WeChat da Aifaner: Aifaner (WeChat ID: ifanr), mais conteúdo interessante será fornecido a você o mais rápido possível.