As cenas virais dos bastidores da versão live-action de “One Piece” foram, na verdade, criadas por IA. Veja como reproduzi-las em 4 passos.

Você consegue dizer o que é falso nesta filmagem dos bastidores?

▲ Rumi, Zoey e Mira, do grupo feminino de caçadores de demônios, Huntrix, e Jinu e Mystery, do grupo masculino Saja Boys. Link do vídeo: https://youtube.com/shorts/WpjfwHqg1R0

No vídeo, os atores estão vestidos com trajes requintados, interagindo com a equipe no set e se preparando para as filmagens; as câmeras, as luzes, os atores e os assistentes estão todos ocupados.

Foi esse clipe "vazado" de 35 segundos que rapidamente se tornou viral nas redes sociais, e o vídeo relacionado no YouTube foi reproduzido mais de 10 milhões de vezes.

Só no final é que alguns internautas descobriram que o conjunto inteiro não existia e que o vídeo tinha sido inteiramente criado por IA. Além disso, ele enganou com sucesso os fãs em toda a internet.

Os vídeos de IA de hoje não devem ser capazes apenas de gravar dramas curtos, mas também de capturar cenas de bastidores da equipe.

O motivo de sua viralidade, além da ausência de qualquer IA perceptível, é a popularidade da própria propriedade intelectual. Trata-se da série animada "K-Pop Demon Hunters", que estreou na Netflix em junho e se tornou um sucesso global, marcando o primeiro sucesso de bilheteria da Netflix nos cinemas.

Os criadores aproveitaram essa popularidade e produziram uma série de vídeos de bastidores. Os atores nesses vídeos têm um estilo quase idêntico ao dos personagens da animação, como se tivessem realmente saído dela.

Quando vi este vídeo pela primeira vez, pensei que fosse real, sem mencionar os fãs entusiasmados que discutiam se a Netflix, tendo em vista a popularidade da animação, estaria secretamente preparando uma versão live-action. A verdade foi revelada: este vídeo era um conteúdo totalmente gerado por IA.

▲ https://youtube.com/shorts/zZ8SmIbijGY

A fonte do vídeo é Fantasoner, um blogueiro do YouTube com mais de 80.000 seguidores. Quase todo o seu conteúdo de vídeo atualizado é gerado por IA.

Muitos internautas comentaram sobre esses vídeos: "É tão real que dá medo", mas alguns fãs que estavam ansiosos pela versão live-action ficaram decepcionados quando descobriram que era IA.

Depois que o vídeo da visita da IA de "K-Pop Demon Hunters" se tornou viral, este blogueiro atualizou um grande número de vídeos de bastidores da IA "da vida real", e o número de visualizações tem sido bom.

Como o vídeo dos bastidores do filme live-action "One Piece".

▲ https://youtube.com/shorts/Ro4m0qWLPo4

Um comentarista chegou a dizer: "Se o One Piece da Netflix fosse jogado pelas pessoas no vídeo da IA, seria um grande sucesso."

▲ Pôster da versão live-action de One Piece, lançada na Netflix há dois anos

Nos bastidores do filme live-action "Demon Slayer: Mugen Castle".

▲ https://youtube.com/shorts/-4n6Rgv6vtg

Ataque a Titã

▲ https://youtube.com/shorts/JvoSqO1Me6Q

Homem-serra elétrica

▲ https://youtube.com/shorts/D3qJdTwYE9g

Pode-se dizer que essas adaptações live-action de animes clássicos capturaram completamente as expectativas dos fãs, transformando as fantasias da mente de todos em cenas da vida real.

Afinal, há poucos dias, um diretor da Netflix confirmou em uma entrevista que o K-Pop Devil Hunter não terá uma versão live-action porque "o estilo e os elementos de comédia da obra original são muito adequados para animação; é difícil imaginar esses personagens no mundo real, pareceria muito pé no chão".

Mas agora todas essas coisas inimagináveis podem ser deixadas para a IA imaginar.

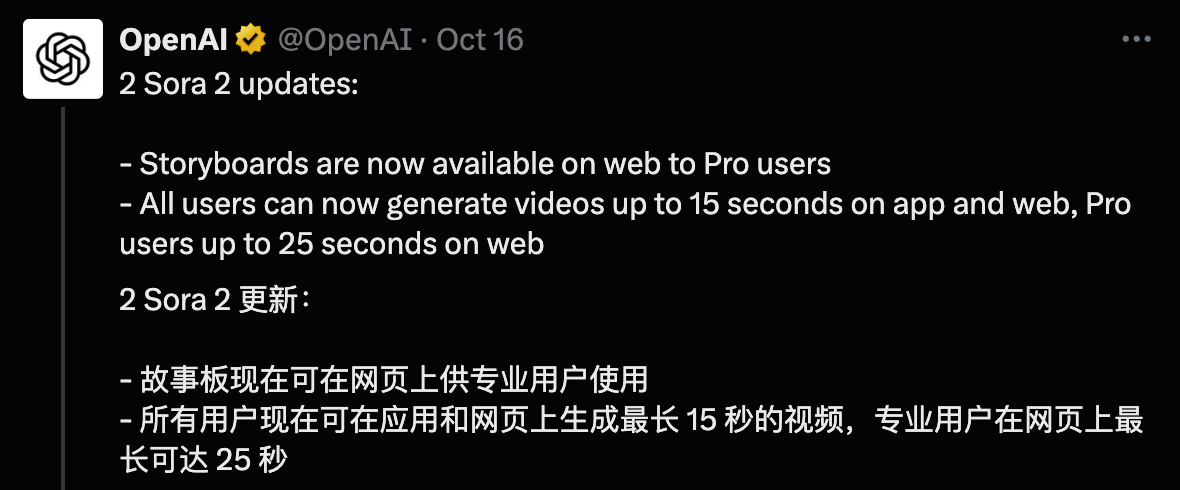

Deste lado, o modelo de geração de vídeo do Google, Veo, acaba de ser atualizado para 3.1, que converte materiais existentes em vídeos e adiciona áudio e ferramentas de edição avançadas; por outro lado, o Sora 2 anunciou que o tempo de geração para usuários comuns será estendido para 15 segundos, e usuários Pro chegarão a 25 segundos, e também traz um recurso de storyboard.

Essas ferramentas estreitam continuamente a fronteira entre realidade e imaginação. Também usamos nano banana, Veo 3.1 e Sora para tentar gerar um vídeo de bastidores de IA igualmente realista.

Lembrete: o conteúdo é compartilhado apenas para fins criativos. Use a IA legalmente e em conformidade com as normas, respeite os direitos autorais originais e não abuse dos vídeos de IA.

Imagens dos bastidores da versão live-action de "Nezha" reveladas

Descobrimos que escolher o tema certo é crucial para que esses vídeos viralizem. Imagens familiares podem, inconscientemente, nos tornar menos cautelosos com sinais relacionados à IA .

Resumimos esse processo prático de acordo com a estratégia do blogueiro @AIWarper no X.

Selecione um personagem → Escolha um IP que seja familiar a todos, mas que ainda não tenha sido adaptado para uma versão live-action.

Gerar fotos → Use nano banana para gerar fotos de "atores" e "cenários".

Gerar vídeo → Use o Veo 3.1 (primeiro quadro para vídeo) ou o Sora 2 (vintage para vídeo) para gerar clipes dinâmicos.

Edição e síntese → Adicione som ambiente ao vivo, música de fundo e gradação de cores e edite em um estilo "vazado".

Então o primeiro passo é decidir o que queremos filmar.

Por exemplo, se há uma obra de anime que você gosta muito, mas que ainda não foi adaptada para um filme ou uma versão live-action, você pode corajosamente tratá-la como uma seleção de elenco para um romance que você gosta.

Escolhemos "Nezha" aqui. Como todos eles estão produzindo algumas obras de animação estrangeiras, escolheremos uma propriedade intelectual clássica nacional.

Etapa 2: Gerar "set stills" de personagens (Ferramenta: nano banana)

Em geral, é mais fácil encontrar uma pessoa real para fazer o cosplay do personagem . Envie uma foto do cosplayer com as roupas do personagem para a nano banana, com o seguinte prompt: "Uma foto espontânea de uma atriz no set, totalmente fantasiada, sentada em uma cadeira. Ela está discutindo as falas com o diretor, com uma tela verde ao fundo."

Como não há imagens de cosplay, podemos considerar deixar a nano banana gerar um "ator" primeiro.

Extrair traje -> Encontrar um ator (ou gerar um) -> Colocar traje -> Colocar o ator vestindo o traje do personagem no local de filmagem

As dicas para os prompts são as mesmas que compartilhamos anteriormente para o jogo do cultivador maligno. Tente usar palavras-chave como aparência, penteado, estilo de roupa, humor e iluminação. Por exemplo, "Uma chinesa de 20 anos com longos cabelos negros e um olhar determinado, vestindo uma jaqueta prateada futurista e iluminação sensível a filmes."

Fonte da imagem: https://x.com/AIWarper/status/1971982288805417005

Em seguida, vestimos o ator com as roupas do personagem do anime. O processo aqui consiste em usar a nano banana para extrair as roupas da Figura 1 e, em seguida, gerar uma foto do ator vestindo as roupas da Figura 2. Em seguida, usamos os mesmos prompts anteriores para gerar uma foto do personagem da Figura 4 no set.

Detalhes específicos podem ser adicionados de acordo com a situação, por exemplo, a tela verde não precisa necessariamente aparecer.

Aqui encontramos uma imagem estática de Shen Gongbao e usamos nano banana para gerar uma imagem de um homem com abdômen definido (encontramos um ator, é claro, um bonito) e o deixamos usar as roupas do personagem.

▲Complete as palavras-chave, Figura 1 a Figura 2: Extraia as roupas deste personagem animado; Figura 3: Gere um belo homem chinês com oito músculos abdominais, cerca de 20 anos e altura de 185 cm; Figura 2 + Figura 3 a Figura 4: Faça a pessoa na Figura 3 usar as roupas na Figura 2;

Figuras 4 e 5: Imagens reais do set. A configuração geral da cena e a atmosfera: um grande estúdio em frente a uma tela verde, com equipamentos de arame, ventiladores e máquinas de fumaça sendo testados. Metade do cenário consiste em rochas com marcação CG e a outra metade é uma plataforma de pedra falsa real. A iluminação é uma luz verde-clara com chamas vermelho-alaranjadas refletindo no fundo (ecoando os efeitos de chama de Nezha). Cabos, ventiladores, braços de câmera e monitores no set exibindo as filmagens mais recentes podem ser vistos. Status do personagem: O ator (o personagem na imagem enviada) está usando seu elaborado traje preto e dourado, passando por maquiagem e penteado, que ainda não estão completos. Patches de efeitos especiais são aplicados em sua testa e têmporas. Ele senta-se na beira de uma plataforma elevada, sussurrando para o diretor sobre o "ângulo de escárnio" e o ritmo de movimento do personagem. O maquiador usa um pequeno pincel para retocar os cantos dos olhos, enquanto a equipe de efeitos especiais ajusta os efeitos de iluminação em sua testa. Ao fundo, alguém está preparando o equipamento de arame, o braço subindo lentamente e as cordas esticando.

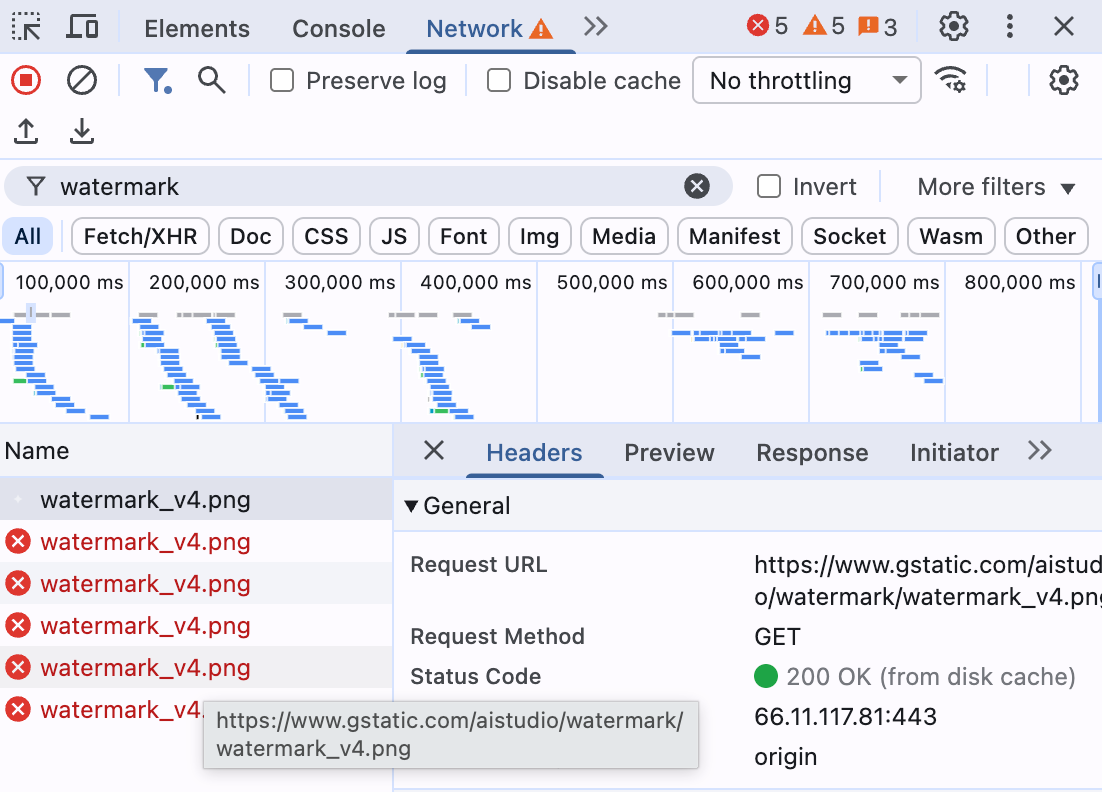

Aqui vai uma pequena dica : se você não quiser cortar ou remover a marca d'água Gemini no canto inferior direito mais tarde, há duas maneiras:

1. Método F12 do navegador: use o Google AI Studio. Abra o Modo de Desenvolvedor do navegador (F12), clique em Rede e digite "marca d'água" no campo Filtro. Mantenha o inspetor aberto e gere imagens normalmente até que um link com uma marca d'água apareça. Clique com o botão direito e clique em Bloquear. As imagens subsequentes não terão marca d'água.

Após o bloqueio do acesso ao domínio, as imagens geradas pelo AI Studio não conterão mais a marca d'água Gemini. No entanto, os usuários ainda precisam obedecer aos regulamentos de uso de imagens Gemini e indicar que as imagens ou vídeos relevantes são gerados por IA ao distribuí-los online.

2. Método API: Você pode usar diretamente a API do modelo nano banana e chamá-la por meio de ferramentas como o Cherry Studio para obter imagens sem marcas d'água.

Usamos o nano banana para gerar diversas imagens de atores no set, e os resultados foram muito realistas. Após obter as fotos do set, continuamos usando o Veo 3.1 ou o Sora para converter as imagens em vídeos.

No entanto, o Sora 2 atualmente tem um problema: ele não suporta o upload de imagens realistas de pessoas. Esta é provavelmente a maneira da OpenAI reconhecer a recente reação negativa contra o Sora 2 por gerar vários vídeos de paródia.

O terceiro passo é inserir a imagem no modelo de geração de vídeo.

Primeiro, tentamos usar o Veo 3.1 para gerá-lo. As palavras de entrada eram controladas por segundos, e ele conseguiu obter o controle perfeito da lente.

▲ Cue: Um vídeo real no set, com a equipe se preparando para a filmagem. 0:00–0:04 (Preparando a cena) Tomada com zoom grande angular, o cinegrafista segue, câmera focada no ator. Ao fundo, podemos ver assistentes movendo adereços, máquinas de névoa testando a névoa e ajustes nos fios. 0:04–0:08 (Close-up do personagem) O maquiador está aplicando as sobrancelhas. O ator olha para o diretor, sorri e diz: "Vou ser um pouco mais sinistro desta vez". O diretor acena com a cabeça, indicando a posição da câmera com um storyboard. A câmera treme levemente, e as vozes dos atores podem ser ouvidas.

Continuando o mesmo processo, podemos obter fotos e vídeos reais dos bastidores de Ao Bing e Nezha. Ao editá-los juntos, podemos afirmar de forma convincente: "O elenco para o filme live-action de Nezha foi finalizado e as cenas dos bastidores foram divulgadas."

Por fim, adicione música no software de edição, faça algumas edições simples e obtenha o produto final.

Cada etapa envolve a compra de cartas, e quanto mais detalhadas forem as instruções, melhores serão os resultados. Na maioria das vezes, depende do "humor" do modelo.

Nossa sugestão é adicionar " Imagens dos bastidores do set de filmagem live-action " antes das palavras de incentivo geradas pelo vídeo. Após uma comparação abrangente, o modelo conseguirá lidar melhor com isso.

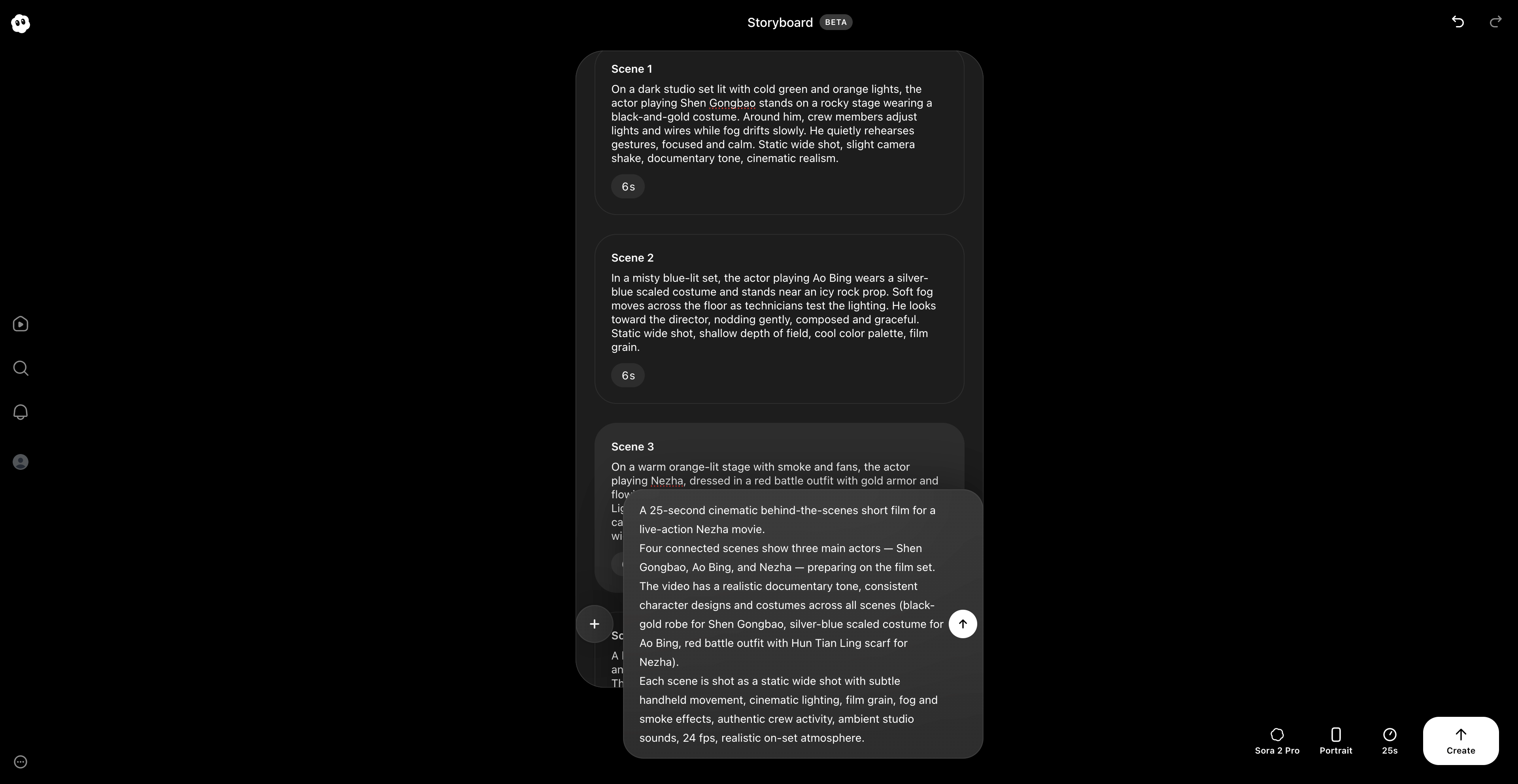

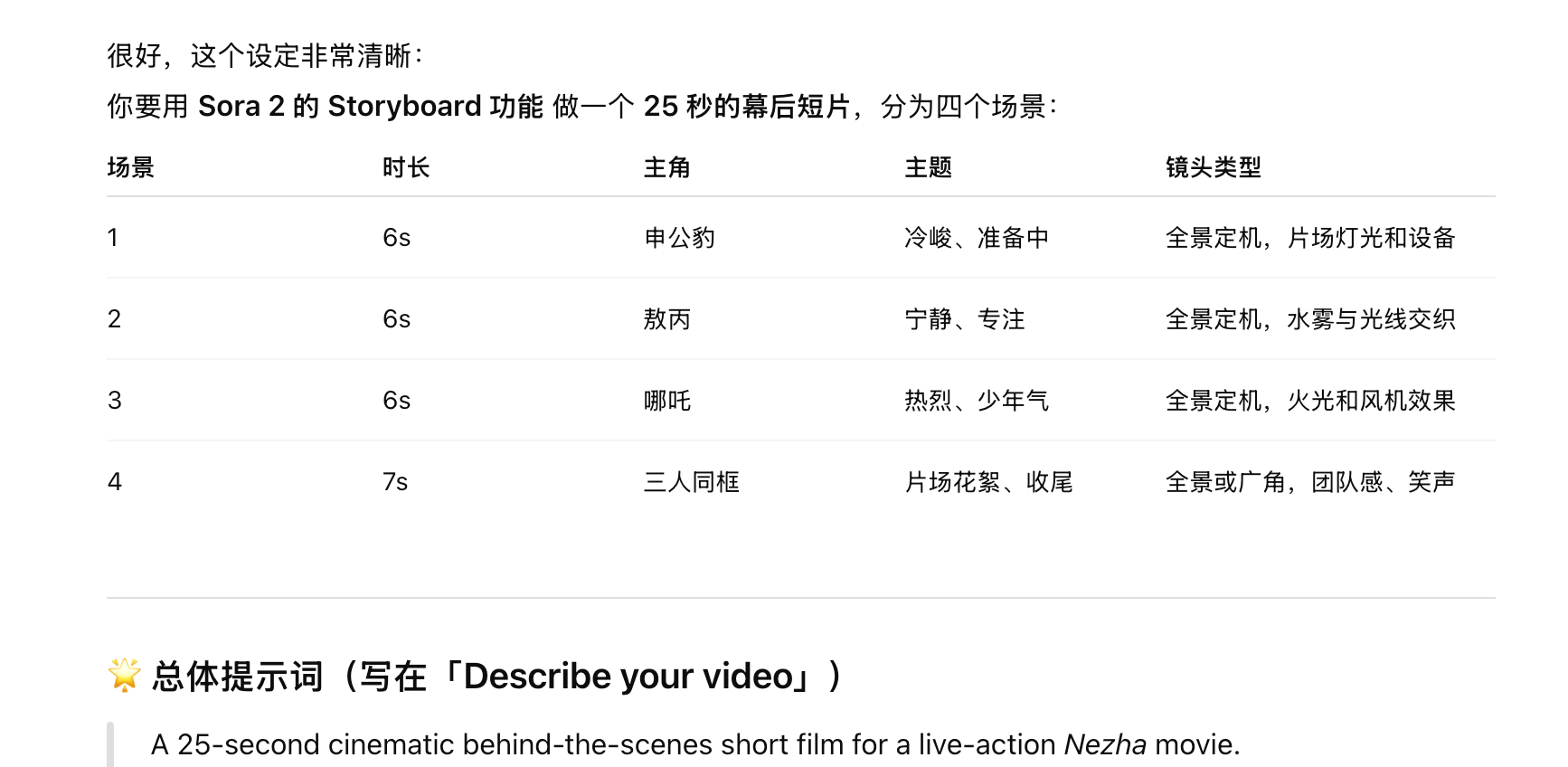

Quanto à situação em que Sora 2 não conseguia lidar com personagens realistas, tentamos usar “Estrelas Convidadas” e o recurso de storyboard atualizado de Sora 2 para gerá-los diretamente inserindo palavras-chave.

▲ Função de storyboard do Sora, que pode criar várias cenas e modificar a duração de cada cena

Aqui, criamos 4 cenas. As três primeiras são cenas de bastidores de Shen Gongbao, Ao Bing e Nezha, cada uma com 6 segundos de duração. A última é um vídeo de bastidores dos três atores juntos, com 7 segundos de duração, totalizando exatamente 25 segundos.

▲As palavras do prompt são completadas pelo ChatGPT

A característica única do Sora é seu ambiente geral, que se assemelha mais a um cenário de filme real. O Veo 3.1, por outro lado, é limitado pela entrada do quadro I inicial, deixando-o com espaço limitado para expressão criativa. Portanto, a imagem de entrada inicial é uma das etapas mais cruciais para alcançar um alto grau de realismo no vídeo resultante da visita ao cenário.

Atualmente, os membros do ChatGPT Pro não verão mais a marca d'água do Sora ao usá-lo, seja no modelo Sora 2 ou Sora 2 Pro. Isso facilita ainda mais a divulgação desses vídeos gerados por IA nas redes sociais.

Parece que de vez em quando surge um vídeo interessante sobre IA que se torna viral, desde vlogs de viagem no tempo com perspectiva em primeira pessoa, imagens de câmeras de vigilância noturnas, o Rei da Neve contra a Torre Pérola Oriental, adaptações clássicas de vários dramas de cinema e televisão, até as atuais imagens de bastidores da IA.

Parece que nossa aceitação de vídeos de IA aumentará gradualmente a cada sucesso como esse.

Acredito que com mais momentos de "Uau, pode ser tocado assim!", o vídeo de IA gradualmente se tornará nossa nova ferramenta de expressão criativa, assim como as câmeras estão começando a substituir os pincéis.

Para reproduzir o vídeo do artigo, acesse o link original

#Bem-vindo a seguir a conta pública oficial do WeChat do iFaner: iFaner (ID do WeChat: ifanr), onde mais conteúdo interessante será apresentado a você o mais breve possível.