Elon Musk está aprontando de novo! Seu recurso de IA natalino irritou artistas do mundo todo, levando a um êxodo em massa de usuários que deletaram suas contas.

Durante as festas de Natal, Musk ofereceu um "presente generoso" a artistas de todo o mundo.

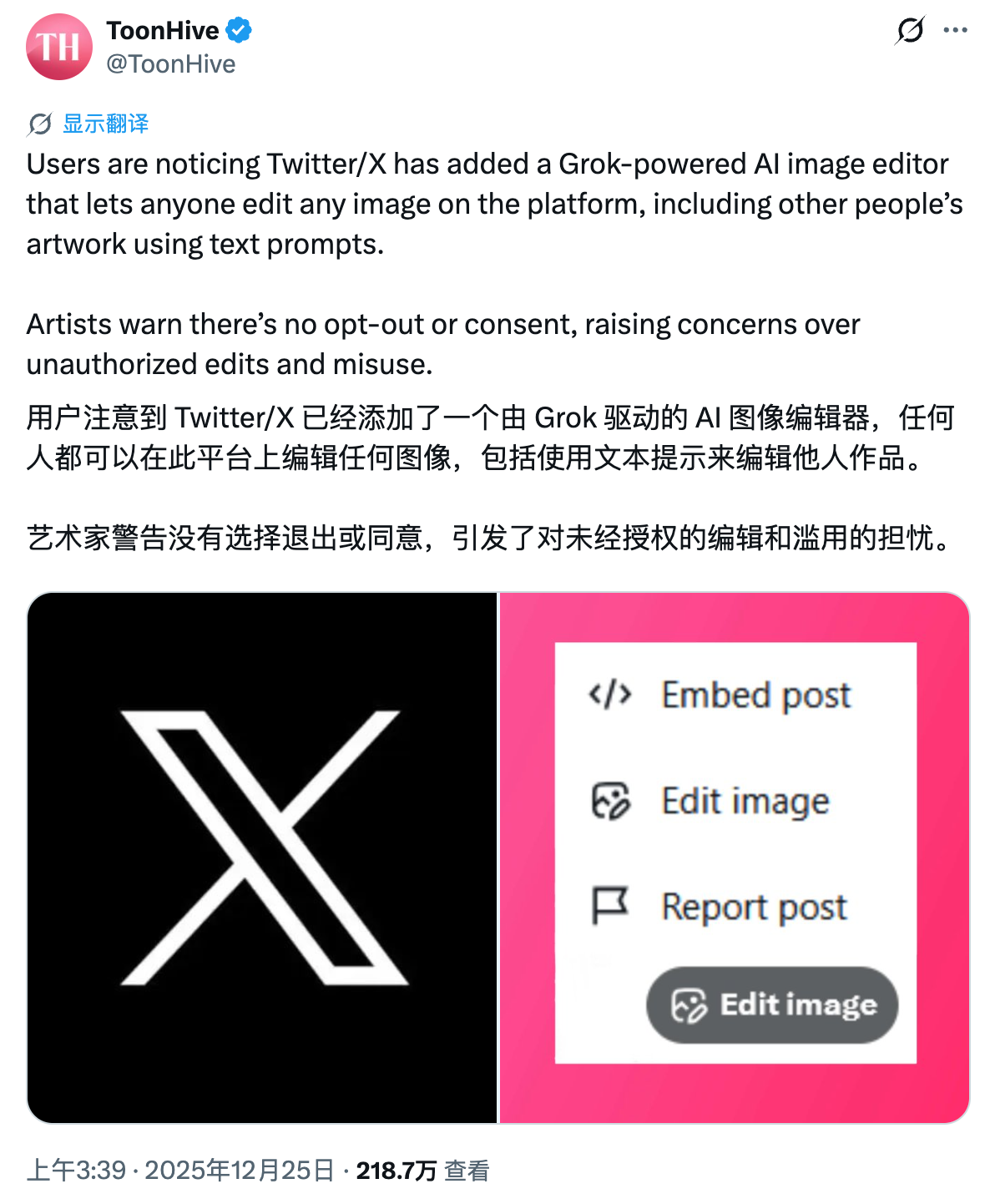

O motivo disso é que a plataforma social X lançou uma função de "edição por IA" baseada no modelo Grok. Os usuários podem simplesmente pressionar e segurar uma foto em seus telefones ou clicar no botão "Editar foto" na versão web para inserir comandos de texto e deixar a IA modificar livremente os trabalhos publicados por outras pessoas.

A intenção original de Musk pode ter sido reduzir as barreiras à criação, ampliar a interação com a plataforma e, incidentalmente, encontrar um cenário de aplicação suficientemente frequente e atraente para o Grok.

Mas a realidade é que os artistas e suas obras perderam o direito de dizer "não" da noite para o dia.

Modificação com um clique e exibição pública: por que o novo recurso do X enfureceu os artistas?

Usar "ultrajante" para descrever o novo recurso do Grok é, na verdade, um eufemismo.

Especificamente, os recursos de edição de imagens do Grok permitem a criação de novas obras com base em comandos de texto. Os usuários podem pedir ao Grok para substituir fundos de imagens, alterar poses, expressões e roupas de personagens, e até mesmo adicionar novos elementos.

À primeira vista, a descrição de suas funcionalidades faz com que pareça igual a outras ferramentas de edição de imagens com IA. No entanto, essa funcionalidade se aplica a todas as imagens disponíveis publicamente, o que significa que qualquer pessoa na rede X pode editar livremente imagens publicadas por outros sem notificar o autor original.

Para piorar a situação, a plataforma X não oferece uma opção para desativar ou recusar esse recurso.

Os criadores não têm o direito de recusar ou retaliar contra imagens "editadas" de terceiros. A versão modificada por IA pode até ser publicada diretamente na seção de comentários da postagem original.

Para que todos possam visualizar, compartilhar e reutilizar.

De acordo com essas regras, uma vez publicada, a obra deixa de pertencer ao criador e entra automaticamente no "estado editável publicamente" da plataforma: qualquer pessoa pode usá-la, e nem mesmo o autor original tem o direito de comentar. Não é de surpreender que os artistas tenham ficado furiosos.

"Isto é realmente terrível."

"Talvez estejam tentando expulsar da plataforma as pessoas que são contra a IA."

"Detesto isto, mesmo quando uso IA para criar arte."

A reação dos artistas não foi algo trivial.

A oposição deles não é à tecnologia de IA em si, mas ao apropriamento desenfreado de seu trabalho árduo e ao desrespeito crônico aos direitos autorais por toda a indústria de IA. Inicialmente, as obras dos criadores foram capturadas sem o seu conhecimento e usadas para treinamento.

Muitos artistas já vivenciaram esse desespero: inserir instruções em ferramentas de IA juntamente com seus próprios nomes, e a obra de arte resultante ser quase indistinguível da original, o que representa um enorme golpe para o bem-estar mental do artista.

É importante entender que esse estilo único representa a alma artística que eles aprimoraram ao longo de anos, até mesmo décadas, mas a IA pode facilmente "copiá-lo" simplesmente selecionando algumas dezenas de obras e dedicando algumas horas ao treinamento. No entanto, de acordo com as leis vigentes em muitos países, a cópia de estilo não constitui violação de direitos autorais, equivalendo ao que é considerado roubo legal.

A polêmica em torno do GPT-4o, no estilo Ghibli, em março deste ano, foi um microcosmo da situação. Quando o CEO da OpenAI, Altman, se vangloriava da adição de milhões de novos usuários ao X, ele estava completamente alheio ao fato de que tal arrogância era uma ofensa flagrante aos criadores originais.

Anteriormente, a Christie's anunciou seu primeiro leilão de arte com inteligência artificial, o que provocou um protesto de mais de 2.800 artistas do mundo todo. Os artistas denunciaram veementemente a iniciativa, alegando que ela "exibe obras roubadas e lucra às custas dos artistas tradicionais".

Embora a Christie's tenha respondido que os materiais de treinamento vieram dos próprios criadores, eles não acreditaram. Os oponentes acreditam que tais práticas de leilão dão um mau exemplo e reduzem ainda mais o espaço para a arte humana.

Se as violações de treinamento anteriores eram "roubo disfarçado", os novos recursos do X são "roubo descarado" que arrancam a máscara: qualquer pessoa pode adulterar uma obra com um clique e publicar a versão adulterada, o que é essencialmente um duplo insulto aos direitos de personalidade e direitos autorais do criador.

Algumas pessoas "racionais e objetivas" argumentam que a manipulação de imagens por IA existe há muito tempo e que pessoas comuns podem fazê-la offline usando um computador; X apenas forneceu a interface. No entanto, esse argumento é completamente insustentável.

O impacto de usar um botão instalado pela plataforma é vastamente diferente de modificar uma imagem de forma privada. O primeiro caso representa um endosso oficial à violação de direitos autorais, um flagrante desrespeito à dignidade dos criadores.

A imagem original, concebida com esmero pelo autor, pode ser transformada em uma versão paródica de baixa qualidade por inteligência artificial em poucos segundos, prejudicando a reputação do autor. Mais grave ainda, o autor perderá o controle sobre os usos derivados da obra, e o direito à atribuição e à integridade da obra se tornarão sem efeito. O autor poderá até mesmo ser responsabilizado pela imagem modificada que contenha conteúdo pornográfico ou difamatório.

O endosso oficial reduz significativamente as barreiras à violação de direitos autorais, permitindo que até mesmo pessoas sem habilidades técnicas os infrinjam facilmente. Esse recurso, claramente concebido com intenções maliciosas, representa um golpe fatal para os criadores, tanto em termos de ética empresarial quanto em seu impacto real.

Exclusão de contas, realocação e retaliação "envenenada": como os artistas encurralados reagem?

Observando o cenário doméstico, controvérsias semelhantes não são incomuns. O ditado "o irmão mais velho não fala mal do segundo irmão" reflete essencialmente o desrespeito coletivo pelos direitos dos criadores por parte das plataformas globais de conteúdo, motivado pela sua ansiedade em relação ao tráfego gerado por inteligência artificial.

O incidente da "Máquina de Desenhar Pombos Antiga" no LOFTER da NetEase é o exemplo mais típico. Em março de 2023, o LOFTER lançou discretamente uma função de desenho por IA, o que imediatamente causou grande alvoroço.

Artistas questionaram se a plataforma estava usando seus trabalhos enviados para treinar IA sem autorização, e a onda de críticas rapidamente se espalhou por todo o site.

Apesar de duas declarações oficiais afirmando que "o conjunto de treinamento veio de dados de código aberto e não utilizou trabalhos criados por usuários", muitos criadores anunciaram que "excluiriam suas contas e deixariam a plataforma". Por fim, a LOFTER removeu completamente o recurso de IA em 10 de março e lançou um "Programa de Proteção ao Criador".

Diante da série de ações questionáveis de diversas plataformas, muitos artistas ficaram profundamente decepcionados.

Eles apagaram todos os seus trabalhos anteriores, chegando a limpar suas contas e abandonar a plataforma, apenas para preservar o último resquício de sua dignidade criativa. Mas para onde irão esses artistas depois que partirem?

Além de sites criados pelos próprios artistas, o BlueSky, uma plataforma social cofundada pelo ex-CEO da X, Jack Dorsey, tornou-se a primeira opção para muitos artistas. Logo após Musk anunciar que o xAI coletaria conteúdo da X para treinar seus modelos, um grande número de artistas se candidatou para participar do BlueSky.

Como a plataforma prometeu oficialmente que "nunca usará dados do usuário para treinar IA", essa postura clara permitiu que os artistas, que haviam sofrido muito, sentissem um respeito há muito perdido.

Cara adota uma abordagem mais radical, se apresentando como um refúgio anti-IA para artistas. A plataforma promete explicitamente não usar conteúdo do usuário para treinar modelos de IA e possui medidas integradas contra a extração de dados por IA, adicionando automaticamente uma camada protetora chamada "Glaze" às imagens e proibindo o upload de imagens geradas por IA.

Mas essas plataformas com limites éticos são, em última análise, minoria. A maioria dos artistas fica presa em um dilema:

Por um lado, existe o risco de violação de direitos autorais nas plataformas convencionais; por outro, há a falta de influência nas plataformas de nicho. Elas não se atrevem a abrir mão das oportunidades de exposição nas plataformas convencionais, mas precisam gastar energia buscando segurança nas plataformas de nicho, como lentilhas-d'água sem raízes, sem saber por quanto tempo conseguirão sobreviver em seu próximo refúgio.

Além de serem forçados a migrar, muitos artistas começaram a retaliar ativamente, "envenenando" suas próprias obras e usando magia contra magia.

Desenvolvido por uma equipe da Universidade de Chicago, o Glaze sobrepõe uma camada invisível, porém altamente disruptiva, de "ruído" a uma imagem. Esse ruído engana os modelos de IA, fazendo com que identifiquem o "estilo de pintura a óleo" como "estilo de esboço", impedindo assim a imitação do estilo.

Outra ferramenta, o Nightshade, é ainda mais radical, ganhando o título de "veneno para IA". Ela rotula dados incorretamente e, se um modelo consumir um grande número de imagens processadas pelo Nightshade, a funcionalidade do modelo ficará desordenada ou até mesmo entrará em colapso.

Por exemplo, o que o olho humano vê como uma vaca pode ser confundido por IA com uma bolsa. Se o modelo processar muitas imagens dessa "vaca venenosa", o resultado final poderá representar a vaca como uma bolsa.

Além disso, a resistência dos criadores não foi em vão.

Sob forte condenação e pressão, as principais plataformas e organizações do setor finalmente começaram a corrigir vulnerabilidades, buscando equilibrar a relação entre o desenvolvimento de IA e a proteção de direitos autorais. Isso inclui a implementação de políticas ou tecnologias anti-raspagem: adição de tags de metadados para bloquear rastreadores de IA, ativação de funções anti-raspagem e monitoramento e interceptação de downloads em lote anormais.

No âmbito jurídico, diversos países e regiões começaram a discutir as regras de direitos autorais para IAGC (Inteligência Artificial Gerada por Computador). No setor, grandes bancos de imagens como o Getty Images estão proibindo estritamente o upload de conteúdo de IA não autorizado, ao mesmo tempo que colaboram com empresas de IA para disponibilizar conjuntos de dados de treinamento pagos.

Na verdade, as reivindicações dos artistas são bastante simples: eles não se opõem cegamente à tecnologia de IA, mas simplesmente querem respeito básico: precisam de autorização prévia para usar seu trabalho para treinamento; e querem uma parte justa dos lucros gerados.

Essa nova funcionalidade na plataforma X, que surgiu do nada, é uma provocação flagrante contra essa reivindicação.

Os artistas precisam resistir à invasão generalizada da IA enquanto lutam desesperadamente para preservar o último resquício de dignidade criativa. O calor que deveria ter marcado o feriado se transformou em raiva, decepção e profundo esgotamento.

Naquela véspera de Natal, nenhum deles riu.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.