Diálogo com Zhang Peng, CEO da Zhipu AI: A revolução tecnológica já é rápida o suficiente, não se concentre apenas nos resultados de “superaplicações”

Na Conferência Mundial de Inteligência Artificial de 2024, realizada perto do rio Huangpu, empresários, desenvolvedores e entusiastas da tecnologia desencadearam um entusiasmo ainda mais intenso do que o calor de 38 graus em Xangai. Opiniões sobre a natureza revolucionária de grandes modelos e a incompatibilidade de aplicações práticas. também colidiram.

Como converter o poder computacional de grandes modelos em produtividade?

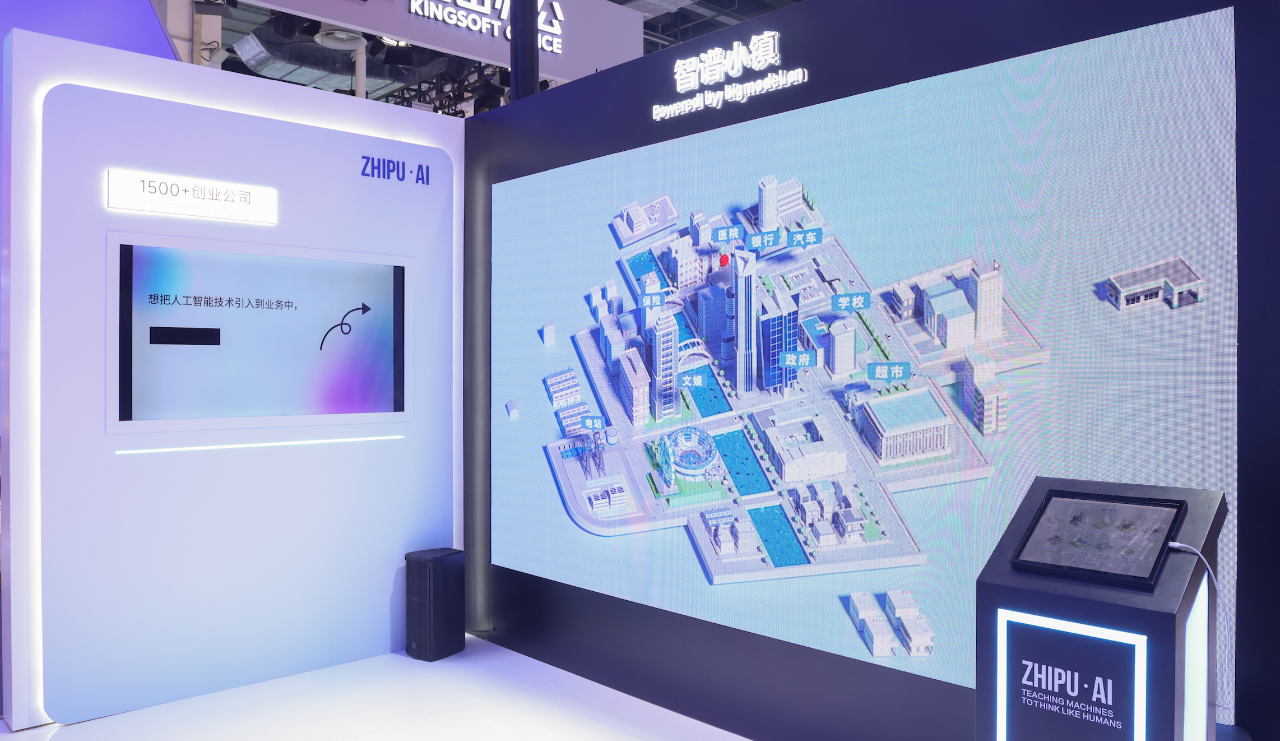

Quando grandes modelos, chips, computação em nuvem, inteligência incorporada, direção autônoma e outros fabricantes reúnem as conquistas mais recentes, formando uma paisagem em miniatura do cenário de IA da China, todos que vêm aqui esperam encontrar algumas bases que levem à linha cinza da AGI.

“Esta é a empresa que se parece muito com a OpenAI.” Eu estava em frente ao estande da Zhipu AI e ouvi um visitante da exposição apresentá-lo aos seus companheiros. Esta é provavelmente a opinião de muitos praticantes.

Este unicórnio chinês de IA possui modelos grandes em geral de vários tamanhos. Lançou recentemente o modelo GLM-4-9B, superando o modelo Llama 3 8b. O modelo multimodal GLM-4V-9B atinge os mesmos recursos que o GPT-4V com um valor de parâmetro de 13B. Ontem, a Zhipu AI também lançou o modelo de código CodeGeeX de 4ª geração CodeGeeX4-ALL-9B no WAIC.

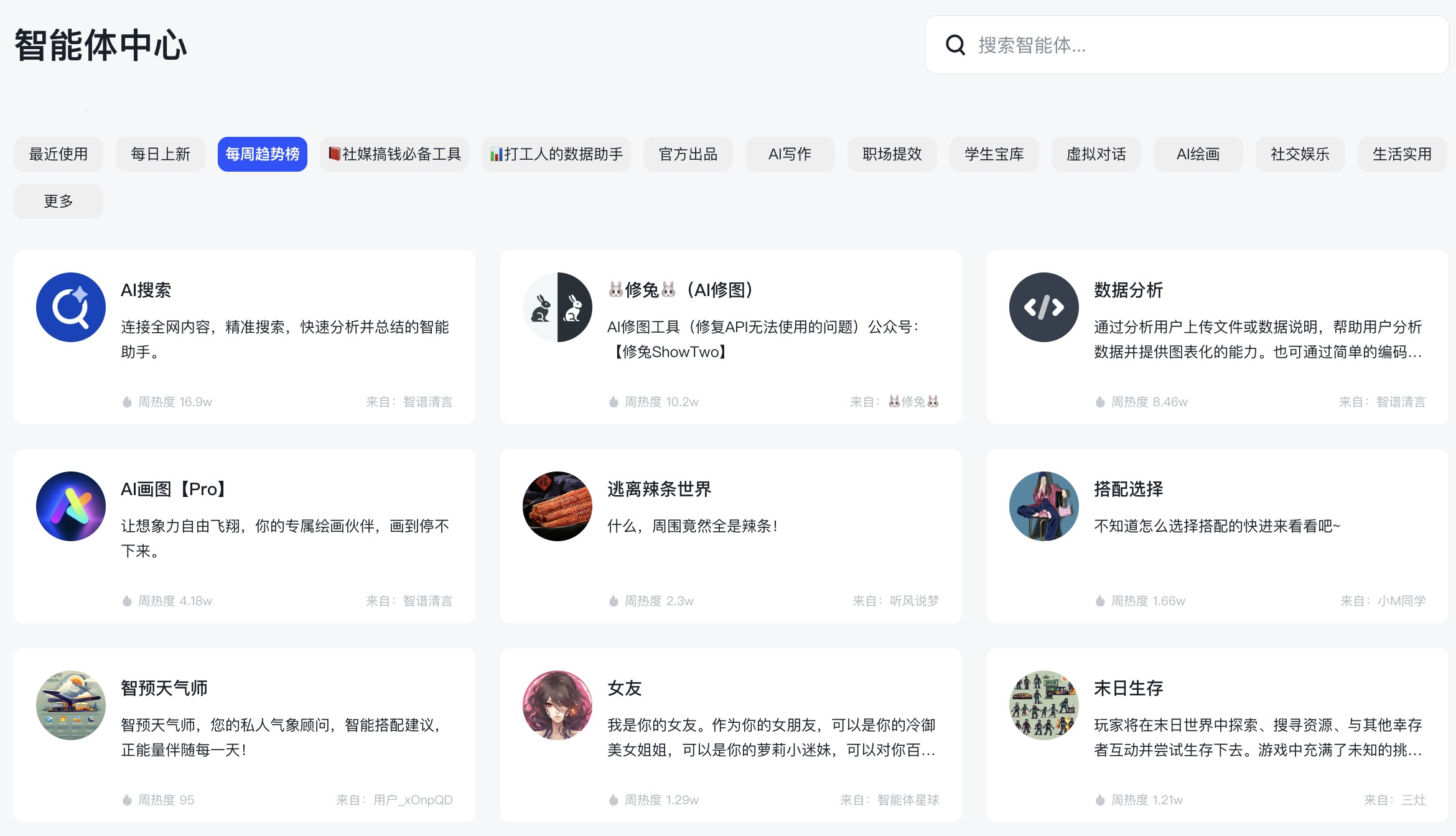

O ritmo de comercialização da Zhipu AI também está à frente da maioria de seus concorrentes. Hoje, existem mais de 300.000 agentes ativos no APP Qingyan disponíveis para uso. A plataforma aberta de grande modelo Zhipu AI tem atualmente mais de 400.000 usuários registrados, e o volume médio de chamadas diárias chega a 60 bilhões de Tokens.

Zhang Peng, CEO da Zhipu AI, acredita que a atual mania de IA causada por grandes modelos é diferente de antes. No passado, a tecnologia de IA resolveu alguns problemas práticos, mas o desenvolvimento atual de grandes modelos trouxe habilidades cognitivas semelhantes às humanas. .

Grandes modelos podem fornecer capacidades de generalização em um modelo para resolver as diversas necessidades de uma série de cenários e aplicações, resolvendo assim o problema do equilíbrio de custos e benefícios. Esta é sua característica essencial.

Zhang Peng também aceitou entrevistas com a APPSO e outros meios de comunicação no local, falando sobre tópicos como a implementação de grandes modelos, superaplicações e a curva futura da tecnologia, cobrindo algumas questões-chave, desde a pesquisa de grandes modelos até a comercialização.

A seguir está uma transcrição da conversa. Você pode ver alguns perfis de como as empresas chinesas de IA implementaram grandes modelos.

Grandes modelos são implementados, não se concentre apenas em superaplicativos

P: Em relação ao TPF (Technology-Problem Fit) para modelos grandes, como a Zhipu combina tecnologia com produtos e depois os implementa? A indústria ainda não chegou a um consenso sobre isso.

Zhang Peng: Nunca pensei que este assunto deva ser controverso. A implementação de qualquer nova tecnologia requer um ciclo. Esta é uma lei natural, mas este ciclo pode ser longo ou curto, e quando uma tecnologia revolucionária como um grande modelo é implementada. No processo, certamente haverá desafios maiores e mais problemas que precisamos resolver.

De uma perspectiva histórica objectiva, a implementação desta revolução tecnológica tem sido suficientemente rápida, mas precisamente porque é tão rápida, a compreensão de todos sobre esta questão ainda é um pouco desigual, e a variação da distribuição é relativamente grande.

A tecnologia ainda precisa ser iterada e atualizada rapidamente, mas em termos de aplicação, não podemos esperar que ela esteja totalmente madura antes de implementá-la .

P: Você pode compartilhar alguma experiência na implementação de modelos grandes?

Zhang Peng: Em primeiro lugar, você deve ter um conhecimento profundo da capacidade de reconhecer este modelo. Você deve tentar compreender suas vantagens e evitar tirar vantagem de suas deficiências. Por exemplo, se você pedir ao modelo para calcular modelos físicos ou fórmulas matemáticas muito precisas, é exatamente como o cérebro humano. não deveria fazer isso.

Por exemplo, não é apropriado utilizá-la para substituir a calculadora a que está habituado, por isso é necessário encontrar um ângulo adequado para aproveitar ao máximo as suas vantagens, e não ir na direção oposta, nem bloquear o espaço para seu caminho de desenvolvimento, pois as capacidades do modelo podem ser comprometidas a qualquer momento.

P: A que distância estamos dos superaplicativos de IA que todos têm discutido recentemente? Na verdade, existem muito poucos aplicativos de IA com mais de 10 milhões de usuários ativos diariamente.

Zhang Peng: A definição de superaplicativo de todos é muito vaga. Cada um tem seu próprio conjunto de ideias. O ChatGPT é considerado um superaplicativo?

P: Vamos ver com que analogia isso é comparado.

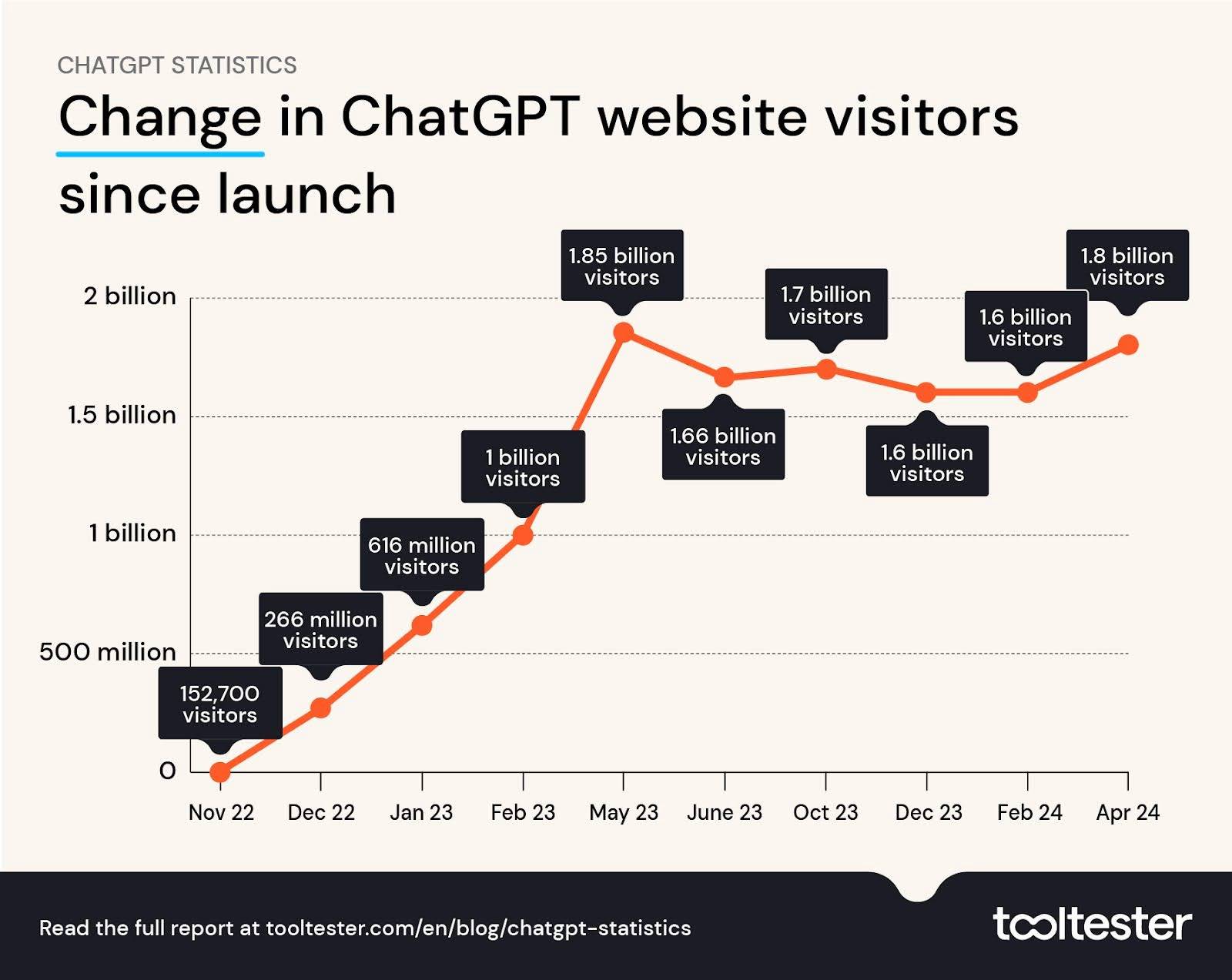

Zhang Peng : Sim, você sempre precisa ter uma analogia. ChatGPT já é o produto mais rápido da história com mais de 100 milhões de usuários mensais. Se isso não pode ser chamado de superaplicativo, o que pode ser chamado de superaplicativo?

Não olhe para esta conclusão prematuramente. Se você observar o processo, descobrirá que ele se desenvolveu muito rapidamente, então seja paciente. O surgimento de superaplicativos não é inteiramente impulsionado pela tecnologia, mas também leva em consideração muitos fatores. como o mercado e se o usuário está pronto .

Deixe-me dar outro exemplo simples. O número de usuários do mecanismo de busca Google é grande o suficiente. Quanto tempo levou para ele se tornar o mecanismo de busca número um do mundo e encontrar um caminho comercial de sucesso? 6 anos Também demorou 6 anos para o Meta atual e o Facebook original.

P: Também demorou mais tempo desde o surgimento da Internet móvel até o WeChat e o TikTok.

Zhang Peng : Então por que todos não podem esperar um pouco mais? É melhor tentar. Assim como quando jogávamos Arkanoid quando éramos crianças, você quer mirar na lacuna e acertá-la com muita precisão. Para fazer isso, primeiro você precisa descobrir onde está a lacuna. Onde está o caminho?

Muitas coisas precisam ser exploradas uma após a outra, e esse processo é muito importante Não apenas ver os resultados finais, mas o mais importante, acho que é nisso que todos deveriam prestar mais atenção no momento.

P: Algumas pessoas na indústria pensam que aplicações inovadoras podem ser implementadas nos próximos anos. Ele deu um prazo muito claro de cerca de três anos.

Zhang Peng: Talvez amanhã. Como acabei de dizer, este assunto requer uma consideração abrangente de diferentes fatores. Um é a maturidade da própria tecnologia e o segundo é se o mercado e os próprios usuários estão prontos. A terceira é a descoberta da demanda, e até um pouco de sorte é acrescentada. Existem muitas variáveis, e é difícil prever esse tipo de coisa com uma rede neural simples como o meu cérebro.

P: Recentemente, há uma opinião muito debatida que diz que um modelo básico sem aplicação não vale nada.

Zhang Peng : Este assunto em si está dividido em dois níveis. Primeiro, a inovação tecnológica é significativa por si só, porque temos tantos pesquisadores científicos que estão constantemente explorando o que faz com que a inteligência humana seja de grande importância.

O segundo nível. Se o resultado desta exploração for que possamos concebê-la e produzi-la, transformando-a numa força produtiva mais valiosa, ela será de maior importância .

Esta questão não é uma escolha entre duas, mas uma série de questões. É claro que a aplicação é muito importante. Esperamos que a tecnologia possa ser transformada em mais produtividade hoje, mas isso não significa que a nossa busca pela inovação tecnológica e pela exploração essencial seja inútil. Não vá a nenhum dos extremos, eles são relacionamentos que se reforçam mutuamente.

P: Também existe a opinião de que o modelo de código aberto não é adequado para a maioria dos cenários de aplicação, e o modelo comercial de código fechado é o mais eficaz. Há algum tempo, Zhipu também lançou a versão de código aberto do GLM-4. O que você acha da questão dos modelos de código aberto e de código fechado?

Zhang Peng : Sempre acreditamos que código aberto e código fechado têm objetivos e significados essenciais diferentes. O código fechado é considerado mais do ponto de vista comercial. É um caminho de negócios para fornecer melhores serviços e produtos mais seguros. Quanto ao código aberto de grandes modelos, o seu objetivo é principalmente enriquecer a ecologia e promover a inovação tecnológica.

Se qualquer tecnologia simplesmente seguir um caminho de desenvolvimento fechado e monopolizado, ou lhe faltará vitalidade ou se tornará um estado que não é amigável para toda a ecologia . Tal como a biosfera, um certo grau de diversidade deve ser mantido. O código aberto tem mais a ver com a manutenção da inovação tecnológica e da diversidade tecnológica, para que a comunidade de código aberto também possa investir no núcleo da tecnologia.

P: Você mencionou antes que o foco de comercialização da Zhipu está no ToB. Em quais setores os clientes do ToB estão atualmente se concentrando? Com quais aplicativos específicos você ajuda os clientes?

Zhang Peng: Significa apenas que nossa principal fonte de renda atual ainda está no lado ToB, mas não significa que nosso caminho de comercialização seja apenas ToB.

Atualmente, os clientes do lado B que atendemos abrangem mais de 10 setores, incluindo finanças, educação, Internet, varejo, automóveis, energia, manufatura tradicional, etc.

Atualmente, estamos ajudando os clientes do setor a começar e utilizo principalmente vários caminhos.

Em primeiro lugar, temos nossa própria plataforma aberta, que pode ajudar nossos clientes a acessar rapidamente os recursos do modelo a um custo relativamente baixo. Eles podem experimentar inovações rapidamente e, em seguida, atualizar-se e iterar seus próprios produtos e capacitação de IA.

A segunda é para algumas grandes empresas que têm requisitos relativamente elevados de segurança de dados e privatização. Forneceremos soluções de privatização em nuvem e soluções de privatização local, e depois seremos específicos para alguns cenários, e depois haverá soluções chinesas para pequenas empresas. assim, forneceremos soluções integradas de software e hardware.

Atualmente, nossa plataforma aberta tem mais de 400.000 usuários corporativos, incluindo algumas pequenas equipes de desenvolvedores, que registraram e usaram nosso modelo de API em nossa plataforma. O volume de serviço diário agora ultrapassa 60 bilhões de tokens. O volume de serviço está crescendo muito rapidamente.

P: A OpenAI recentemente parou de fornecer serviços de API para desenvolvedores chineses e a Zhipu logo lançou um serviço de realocação. Como está a situação atual da migração de usuários para cá?

Zhang Peng: Pela nossa observação, há um aumento, mas a resposta de todo o mercado tem um processo. Também perguntei aos meus amigos sobre a situação.

P: Você tem planos de ir para o exterior em seguida?

Zhang Peng: Já estamos definindo nossas linhas de negócios internacionais e atualmente negociando alguns negócios.

Onde está o próximo passo para grandes modelos?

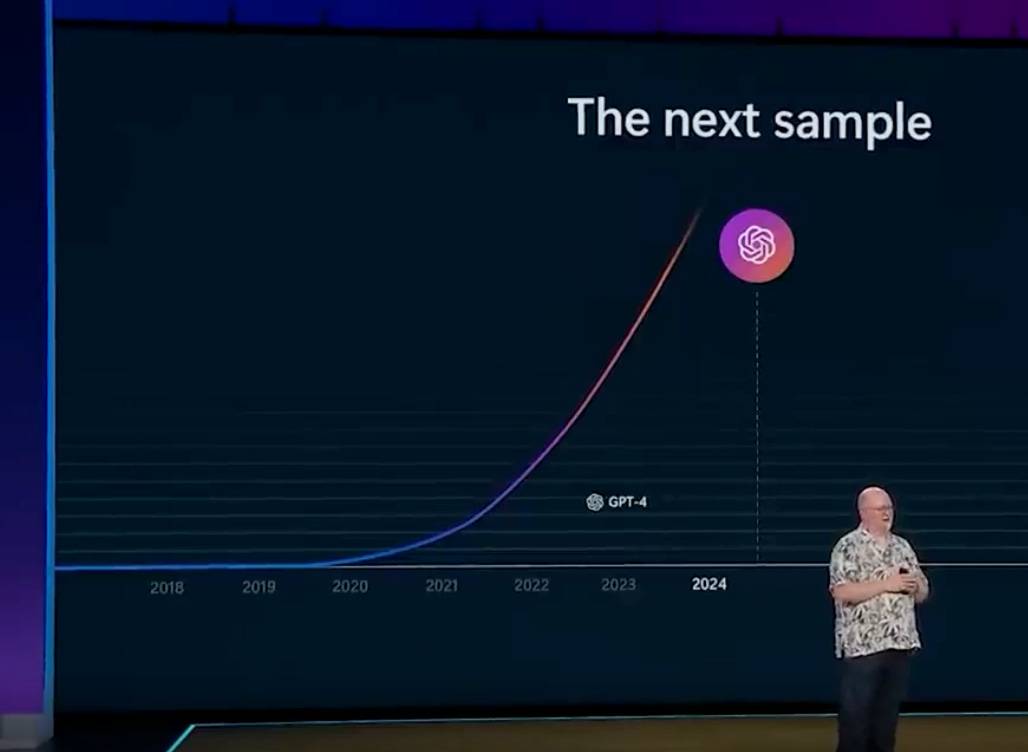

P: O GPT-5 foi adiado. A indústria acredita que a curva de iteração de grandes modelos está desacelerando. A Lei de Escalabilidade está chegando ao fim.

Zhang Peng: A Lei de Escala inicial era muito simples e focava apenas nos parâmetros do modelo. Porém, mais tarde todos descobriram a conotação da Lei de Escalabilidade. O tamanho de seus parâmetros era apenas um dos fatores e variáveis. como Falamos sobre a quantidade de dados usados para treinamento e a quantidade de tokens, e depois descobrimos que também estava relacionado à quantidade de cálculo, então a própria conotação da Lei de Escala também está mudando constantemente.

O que está mais próximo da verdade da Lei de Escalabilidade pode ser a quantidade de cálculo. A quantidade de cálculo combina poder de computação e dados, bem como a escala de parâmetros. O resultado final pode ser uma variável abrangente, que pode representar melhor a Lei de Escalabilidade. Do ponto de vista do valor do cálculo, acreditamos que a Lei de Dimensionamento ainda está em vigor.

Um exemplo secundário para provar isso é que os Estados Unidos agora restringem a exportação de tecnologia de IA. Seu padrão de restrição não é mais, por exemplo, o poder computacional do chip, ou a quantidade de parâmetros e dados do modelo, mas a quantidade. de cálculo. Desenhe uma linha baseada em 10 elevado à 24ª potência. Se o valor do cálculo deste modelo ultrapassar esta linha, não será permitido, então você pode ver que ele também está se movendo na direção mais próxima da verdade.

Mas qual é a sua essência? Ainda estamos explorando, porque a própria Lei de Escala é um fenômeno observado e uma regra obtida. Não é a conotação de uma verdade .

P: No futuro, a Zhipu AI preferirá o modelo grande no lado do cliente ou na nuvem?

Zhang Peng: Acreditamos que o caminho do grande modelo atual é avançar em direção à inteligência artificial geral, ou mesmo à superinteligência que ultrapassa os humanos. Este é um caminho relativamente confiável no momento, mas não nos limitaremos à nuvem ou ao cliente. escolha lateral .

Acreditamos que o desenvolvimento desta tecnologia tem etapas próprias. Em um determinado estágio, por exemplo, a nuvem pode ter o mais alto nível de inteligência devido ao poder computacional e outros motivos se quisermos passar para o próximo estágio de artificialidade geral. inteligência ou super inteligência artificial avança. Ainda pode ser centralizado na nuvem para fornecer essa capacidade mais forte.

▲ Robôs humanóides no WAIC.

No entanto, em alguns cenários específicos, como telefones celulares, carros e robôs no dispositivo, pode ser necessário usar poder de computação final e modelos finais para cooperar com a nuvem. nuvem e lado final Com este modelo, poderemos obter inteligência tão inteligente quanto a nuvem atual em telefones celulares no futuro, mas isso envolve muitos fatores abrangentes, como chips, poder e energia de computação, e uma série de fatores. problemas.

Qualquer tecnologia tem fases. Nesta fase, o plano é assim, mas numa escala de tempo mais longa, será (no lado do dispositivo e na nuvem) a resposta final? Definitivamente não, com certeza irá se desenvolver ainda mais no futuro.

P: Onde você acha que será o próximo desenvolvimento de modelos grandes?

Zhang Peng: Atualmente, as habilidades de linguagem e escrita de grandes modelos estão próximas ou até excedem ligeiramente o nível humano médio. A seguir, esperamos usar uma palavra para descrevê-lo, “afastando-se da virtualidade para a realidade”, ou seja, não se limita mais a ser um cérebro numa cuba, mas pode entrar na vida real e trabalhar para criar produtividade real.

Para atingir esse objetivo, além da capacidade linguística, muitas outras habilidades são necessárias, como capacidade visual, capacidade auditiva e capacidade de usar mãos e pés para fazer crescer mãos e pés. Esperamos que se torne um estado A multimodal. modelo de última geração que pode compreender as intenções humanas, decompor as intenções humanas em etapas de execução lógica e usar ferramentas para se conectar ao mundo físico para concluir essas tarefas.

Como queremos que ele tenha uma capacidade mais forte de interferir no mundo físico, a segurança se torna mais importante para evitar que ele faça coisas prejudiciais no mundo físico real. Precisamos melhorar a segurança. mais com alinhamento, chamamos isso de superinteligência e superalinhamento.

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (WeChat ID: ifanr). Mais conteúdo interessante será fornecido a você o mais rápido possível.