Diálogo com Jiang Daxin, fundador da Step Star: Os modelos multimodais ainda não atingiram o momento GPT-4 e insistimos em buscar o “limite superior da inteligência”

Pode ser discutível se a IA chegará ao segundo tempo, mas é certo que os grandes modelos chegarão à fase eliminatória.

Após o surgimento do DeepSeek R1, a tendência se intensificou. Só neste ano, OpenAI, Anthropic, Google, Meta e Grok lançaram pelo menos 8 novos modelos. Alguns dos tigres domésticos de IA também começaram a desistir do pré-treinamento e abandonaram o idealismo da AGI.

Entre eles, a Step Star é uma empresa um tanto especial. Houve poucas notícias de financiamento antes do final do ano passado, mas tornou-se o “Rei do Volume” nos modelos multimodais. Ela lançou 22 modelos básicos autodesenvolvidos em seus 2 anos de existência, tornando-se o unicórnio de IA mais discreto e misterioso.

Jiang Daxin, fundador e CEO da Step Star, é tão discreto quanto a empresa e raramente aparece no animado campo de opinião pública da indústria de IA.

Ontem, Jiang Daxin realizou uma reunião de comunicação aprofundada com a APPSO e outros meios de comunicação. Ele compartilhou conosco suas opiniões sobre caminhos AGI, modelos multimodais e outras tecnologias, bem como os planos futuros da Step Star.

Modelos multimodais ainda não apareceram no GPT-4, buscando o “limite superior de inteligência”

A atual involução no campo dos grandes modelos de IA não tem fim, e dramas ferozes de “lançamentos cara a cara” são constantemente encenados entre empresas líderes.

No entanto, Jiang Daxin ainda acredita que " a busca pelo limite superior da inteligência ainda é o foco da indústria de IA nesta fase". Em outras palavras, embora existam muitos modelos no mercado agora e todos pareçam bastante capazes, eles ainda estão longe de serem verdadeiramente "inteligentes".

Todo mundo está correndo para lançar novos modelos, e parece animado, mas se você apenas mexer no nível atual, será apenas uma “involução” de ficar parado.

Jiang Daxin sente que o mais importante agora é encontrar uma maneira de aumentar o “QI” da IA, caso contrário ainda estará longe da AGI (inteligência artificial) que todos estão pensando.

Após o lançamento do DeepSeek R1 e a entrada de grandes fabricantes, muitas empresas iniciantes começaram a abandonar o desenvolvimento de modelos básicos. No entanto, Jiang Daxin disse em entrevista à APPSO:

A tecnologia na indústria de IA está se desenvolvendo muito rapidamente e ainda está em uma faixa muito acentuada. Não queremos desistir do crescimento dominante ou da tendência futura neste processo, por isso continuaremos a limitar-nos à investigação e desenvolvimento de modelos básicos.

Ao mesmo tempo, Jiang Daxin disse que aplicações e modelos se complementam. O modelo pode determinar o limite superior do aplicativo e o aplicativo fornece ao modelo cenários e dados de aplicativo específicos.

Então, como podemos tornar a IA mais inteligente? Um caminho fundamental dado por Jiang Daxin é: “ A multimodalidade é a única maneira de alcançar AGI”.

Muita gente fala que este ano é o primeiro ano de Agente. Jiang Daxin acredita que o surto do Agente requer duas condições necessárias, uma é a capacidade multimodal e a outra é a capacidade de pensar devagar .

A multimodalidade, para ser franco, significa que a IA pode não apenas compreender texto, mas também ver imagens, ouvir sons e compreender vídeos.

Se você pensar bem, as pessoas só precisam dos olhos, ouvidos, boca e nariz para compreender completamente o mundo. A IA também deve ser assim, tornando-se um “polivalente” que pode ouvir, ver e falar.

Pode-se dizer que Step Star é o “rei dos volumes” dos modelos multimodais. Ela lança um modelo básico grande quase todos os meses, incluindo 16 modelos multimodais. Abrange a compreensão e geração de imagens, vídeos, fala e música. Nas palavras de Jiang Daxin, adere ao “conceito multimodal nativo”.

No entanto, Jiang Daxin também é bastante honesto. Ele afirmou francamente que “ ainda não houve um momento GPT-4 no campo dos modelos multimodais”.

Embora a multimodalidade seja muito popular agora e todos a promovam, ainda não existe um produto de referência como o GPT-4 na área de texto. Quando for lançado, dirá “Uau” e fará todos pensarem “É isso”. Ainda há muitos ossos duros para roer tecnicamente.

Trilogia de luta contra monstros com IA atualizada

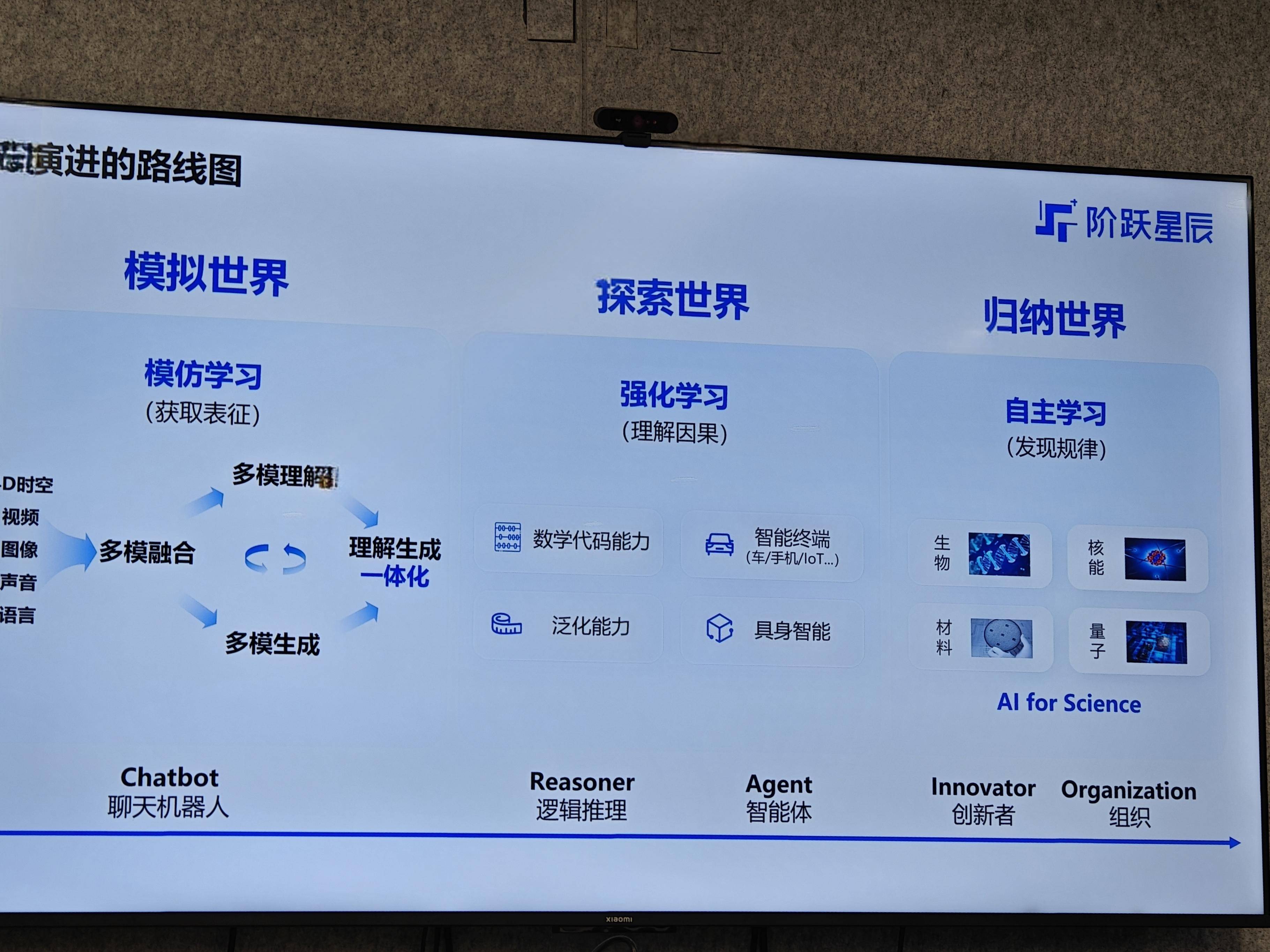

Quanto à forma como o modelo se aproxima do limite superior da inteligência passo a passo, Jiang Daxin traçou um roteiro claro de evolução da "trilogia". Também pode-se dizer que esta é a direção da evolução do AGI entendida por Step Star.

Mundo simulado (estágio de aprendizagem por imitação) : A IA neste estágio é como uma criança que acabou de aprender a falar. Alimente-o com uma grande quantidade de dados e ele aprenderá. A principal tarefa é "prever o próximo token" (prever a próxima palavra) ou "prever o próximo quadro" (prever o próximo quadro). O objetivo é permitir que a IA aprenda primeiro como é o mundo e quais são as características de várias coisas.

Explorando o mundo (estágio de aprendizagem por reforço) : Não basta apenas saber imitar, é preciso também desenvolver a capacidade de resolver problemas complexos. Por exemplo, resolver um problema de Olimpíada de Matemática ou escrever um código complexo requer “pensamento lento”. Neste momento, é necessário aprendizado por reforço, para que a IA possa aprender como resolver o problema passo a passo por meio de tentativa e erro contínuos.

Mundo indutivo (estágio de aprendizagem autônoma da máquina) : Este é o estado mais elevado. A IA pode não apenas resolver problemas conhecidos, mas também descobrir novas leis por conta própria e criar inovações nas quais os humanos não haviam pensado. Por exemplo, no campo da investigação científica, ajudamos os cientistas a descobrir novos materiais, novos medicamentos, e assim por diante.

Estas três etapas coincidem com os conceitos centrais dos cinco níveis AGI propostos pela OpenAI. O desenvolvimento atual de toda a indústria de IA está basicamente avançando de acordo com este roteiro.

Por que “compreender a integração das gerações” é tão importante?

Em termos de multimodalidade, especialmente imagens e vídeos, Jiang Daxin enfatizou muitas vezes uma palavra na reunião de comunicação: a integração de compreensão e geração.

Compreender a integração generativa é uma questão central no campo da visão computacional e é crucial para a realização da AGI.

Para ser franco, isso significa que o modelo pode não apenas entender o que uma imagem ou vídeo significa, mas também criar imagens e vídeos novos e relevantes com base nesse entendimento. Hoje em dia muitas vezes é “usar o modelo A para ver fotos e usar o modelo B para fazer desenhos”, que é como dois departamentos que não conseguem cooperar.

Ele deu um exemplo, como um professor escrevendo no quadro negro. Agora Sora pode imitar os movimentos de escrita do professor, mas o que o professor está pensando e o que vai escrever a seguir depende da “compreensão”. Se compreensão e geração são dois sistemas, então será difícil para o modelo realmente "compreender" você, e o material gerado também poderá ser irrelevante.

Modelos de linguagem como o ChatGPT têm feito um bom trabalho nesse sentido, mas no campo visual os dados são muito complexos, então esse assunto ainda não foi totalmente resolvido. A Step Star continuou a investir nisso e quer superar esse gargalo técnico.

Em última análise, é necessário aplicar capacidades poderosas de modelo para incorporar valor. Step Star adota a estratégia de "supermodelo e superaplicação com tração nas duas rodas".

No nível da aplicação, a Step Star considera o "agente terminal inteligente" como sua principal direção de desenvolvimento. Jiang Daxin acredita que os terminais inteligentes, sejam eles telefones celulares em nossos bolsos, carros que dirigimos diariamente ou robôs que podem ser populares no futuro, não são apenas hardware frio, mas também "uma extensão da percepção e experiência do usuário".

Isso significa que se a IA puder ser profundamente integrada a esses terminais, ela poderá “entender melhor as necessidades do usuário e o contexto da tarefa”.

Por exemplo, o carro-chefe da OPPO, Find X8 Ultra, lançou oficialmente sua primeira função de “memória flash de um clique”. A IA pode identificar de forma inteligente o conteúdo da tela do telefone, gerar resumos para os usuários e classificar informações fragmentadas em diferentes coleções de memória.

Por trás disso está, na verdade, o modelo multimodal step star, que pode compreender o conteúdo exibido na tela, seja imagem ou texto, e os usuários podem fazer perguntas sobre isso. A IA pode não apenas responder, mas também realizar processamento de imagens e até ajudar os usuários a concluir algumas operações no aplicativo, como ir diretamente para a página de reserva de voo e preencher as informações.

Este tipo de cooperação integra mais profundamente as capacidades de grandes modelos e sistemas e os incorpora nos cenários de uso mais frequente de telefones celulares pelos usuários. O valor de escolher telefones celulares como ponto de entrada reside nas propriedades naturais de interação multimodal dos telefones celulares e na enorme base de usuários, que fornece dados reais ricos e feedback instantâneo para a iteração do modelo.

Em geral, a ideia do Step Star é bastante clara: visar tecnicamente a AGI e concentrar-se em questões fundamentais, como a multimodalidade e a integração da compreensão e da geração. Em termos de aplicação, precisamos identificar o ponto inovador dos terminais inteligentes e trabalhar com os fabricantes de hardware para compreender completamente o cenário.

Este caminho não é fácil de percorrer, mas Jiang Daxin e sua equipe parecem bastante determinados. Afinal, para usar a IA para resolver problemas do mundo real, você deve primeiro obter o reconhecimento do usuário no mercado antes de ter a oportunidade de explorar o teto da AGI. Vamos ver que coisas novas o rei multimodal das Step Stars pode inventar.

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (WeChat ID: ifanr). Conteúdo mais interessante será fornecido a você o mais rápido possível.