Mais de um milhão de pessoas conversam com o ChatGPT sobre suicídio todas as semanas, o que levou a OpenAI a atualizar urgentemente seu recurso “Ajuda”.

Às 3 da manhã, um usuário digitou na caixa de diálogo do ChatGPT: "Não consigo aguentar mais".

Alguns segundos depois, a IA respondeu: “Obrigada por me contar. Você não está sozinho(a). Gostaria que eu o(a) ajudasse a encontrar recursos de apoio profissional?”

Essas conversas podem ocorrer milhões de vezes em todo o mundo a cada semana.

A OpenAI divulgou hoje seus primeiros dados sobre saúde mental, mostrando que aproximadamente 0,07% de seus usuários apresentam sinais de psicose ou mania a cada semana, e 0,15% falam sobre pensamentos ou planos suicidas.

Com base em 800 milhões de usuários ativos semanais, aproximadamente 560.000 pessoas se envolvem em conversas mentalmente anormais a cada semana, e 1,2 milhão de pessoas expressam tendências suicidas ou forte dependência emocional no ChatGPT.

O ChatGPT se tornou um antro de crises psicológicas e, para algumas pessoas, é até mesmo um incentivo perigoso.

Será que a OpenAI está expondo suas próprias falhas na iminente psicose da IA?

A OpenAI divulgou os dados neste momento não por preocupação infundada, mas porque a situação é urgente.

Nos últimos meses, um número crescente de pessoas foi hospitalizado, divorciou-se ou até morreu após conversas prolongadas e intensas com chatbots de IA.

Alguns psiquiatras e profissionais começaram a se referir a esse fenômeno como "psicose da IA". Familiares de algumas vítimas afirmam que os chatbots alimentaram seus delírios e paranoia.

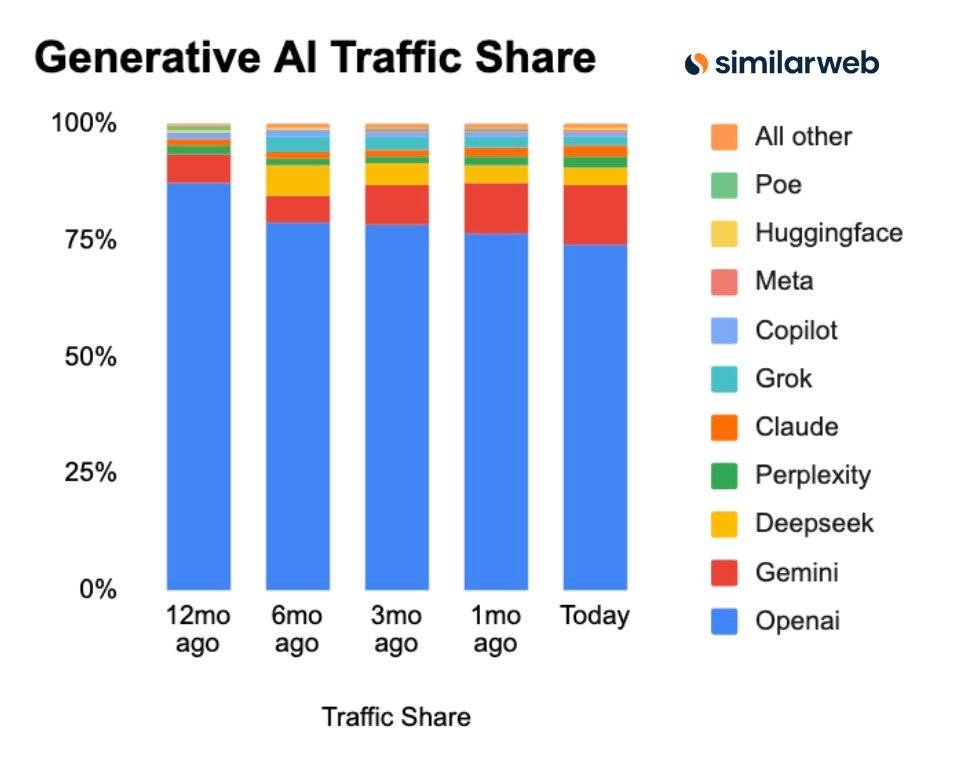

▲ De acordo com as estatísticas mais recentes da Similarweb, a OpenAI ainda domina o mercado de IA generativa.

A OpenAI, que detém a maior fatia de mercado e está muito à frente no mundo, enfrenta forte pressão legal.

A OpenAI está sendo processada pelos pais de um menino de 16 anos por homicídio culposo . Eles alegam que o filho confidenciou ao ChatGPT sobre pensamentos suicidas nas semanas que antecederam sua morte e que o ChatGPT o incentivou a cometê-los.

▲ Adam Raine, cujos pais acusaram a OpenAI de causar a morte não natural de seu filho de 16 anos.

Em outro caso que ainda está sendo apurado como homicídio seguido de suicídio, o suspeito publicou horas de conversas com o ChatGPT, mostrando que a inteligência artificial parece ter alimentado os delírios do autor.

Avisos regulatórios : O governo da Califórnia, onde a OpenAI está sediada, alertou repetidamente a OpenAI de que ela deve proteger os jovens que usam seus produtos.

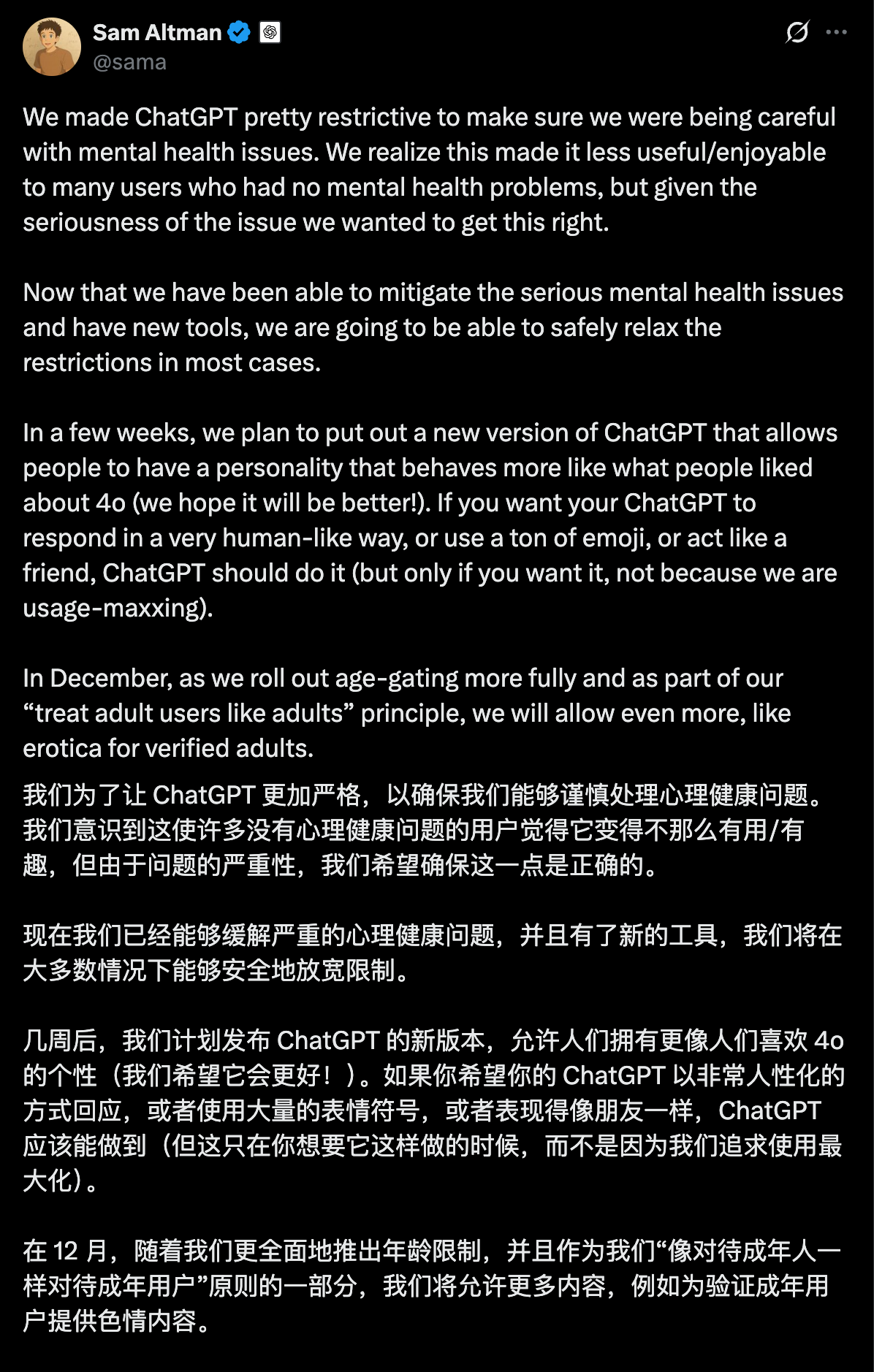

Duas semanas atrás, Altman também anunciou uma atualização sobre a saúde mental do ChatGPT para conter os comentários irresponsáveis e inseguros sobre a OpenAI.

Será que 170 médicos conseguem curar milhões de usuários?

Para responder à crise, a OpenAI anunciou hoje, em seu relatório de segurança, que colaborou com uma rede global de especialistas, incluindo mais de 170 psiquiatras, psicólogos e médicos de atenção primária de 60 países.

O objetivo deles é ensinar o ChatGPT a identificar melhor o sofrimento, a acalmar conversas e a encaminhar as pessoas para atendimento profissional quando apropriado.

De acordo com o blog da OpenAI, a versão mais recente do GPT-5 (gpt-5-oct-3) foi atualizada em três aspectos principais.

1. Para casos de delírios ou doenças mentais, o novo modelo foi projetado para expressar mais compaixão, evitando bajulação cega. O novo modelo não pode confirmar nenhuma solicitação do usuário que não tenha fundamento na realidade.

Por exemplo, a OpenAI usa o exemplo de um usuário dizendo: "Um avião está sobrevoando minha casa e me visando". A resposta ideal do novo modelo é agradecer ao usuário por compartilhar e ressaltar que nenhum avião ou força externa pode roubar ou acessar seus pensamentos.

2. Capacitar modelos para responder de forma mais segura a tendências suicidas e encaminhar as pessoas a recursos profissionais, como linhas de apoio em situações de crise.

3. Para lidar com a dependência emocional, o modelo da igreja incentiva os usuários a estabelecerem conexões interpessoais no mundo real.

A OpenAI afirma que o ChatGPT melhorou significativamente seu desempenho por meio de atualizações como respostas de modelo aprimoradas, exibição automática de informações de linhas de ajuda profissionais, orientação aos usuários para buscar ajuda no mundo real e até mesmo lembretes para que os usuários façam uma pausa após conversas longas.

Eles contataram uma equipe de médicos para participar da avaliação. Esses especialistas médicos analisaram mais de 1.800 respostas de modelos envolvendo potencial psicose, suicídio e apego emocional, e compararam as respostas da versão mais recente do GPT-5 com as geradas pelo GPT-40.

A nova versão do GPT-5 demonstrou reduzir as respostas incorretas em 39% a 52% em todas as categorias, em comparação com o GPT-40. Em relação à versão de agosto do GPT-5, a taxa de respostas para ações que não atendiam aos padrões de classificação da OpenAI diminuiu de 65% a 80% no tráfego de produção recente.

Em uma avaliação de conversas relacionadas ao suicídio, o novo modelo GPT-5 (versão de 3 de outubro) alcançou 91% de adesão, enquanto o modelo GPT-5 anterior (versão de 15 de agosto) obteve apenas 77%.

▲Quanto mais longa a conversa, mais estável será o desempenho do novo gpt-5-oct-3.

Além disso, há um ponto técnico crucial: a OpenAI admite que suas medidas de segurança são menos eficazes em conversas longas; e muitos casos de "psicose por IA" ocorrem em bate-papos prolongados no final da noite.

A OpenAI mencionou que fez progressos significativos nessa questão e manteve uma confiabilidade superior a 95% em conversas longas, complexas e difíceis.

Essa atualização de Ultraman é realmente digna de reconhecimento. No entanto, muitos internautas também levantaram dúvidas mais profundas sobre a suposta maior segurança.

Alguns dizem que a OpenAI afirma em seu próprio relatório de segurança que essas conversas sobre saúde mental são "extremamente raras", mas a realidade é que, mesmo que 0,07% pareça uma porcentagem pequena, na verdade representa um número considerável de pessoas em uma base de usuários de centenas de milhões.

Algumas pessoas também mencionaram que a chamada nova versão do GPT-5 teve um desempenho melhor, e todos os benchmarks de avaliação foram projetados pela própria OpenAI.

Mesmo que o modelo forneça respostas "melhores", não temos como saber se os usuários que estão passando por psicose, pensamentos suicidas ou dependências emocionais prejudiciais realmente buscarão ajuda mais rapidamente ou mudarão seu comportamento como resultado.

Embora a OpenAI reconheça que o novo modelo (GPT-5) trouxe melhorias significativas em segurança, ainda existem usuários que preferem modelos de IA "mais antigos e menos seguros", como o GPT-40; e a OpenAI continua a oferecer essa opção aos assinantes pagos.

Pela primeira vez, a OpenAI está divulgando uma estimativa aproximada de quantos usuários do ChatGPT em todo o mundo podem estar apresentando sinais de uma grave crise de saúde mental em uma determinada semana.

O ChatGPT, como o conhecemos, parece ser não apenas a ferramenta de produtividade mais eficiente, um assistente de programação e uma fonte de inspiração… ele também se tornou um participante que intervém profundamente nas emoções e na psicologia da maioria dos usuários.

Com 170 especialistas médicos, sugestões padronizadas e respostas otimizadas, a IA está se esforçando ao máximo para aprender a identificar humanos à beira do colapso; mas, para uma verdadeira salvação, acredito que ainda precisamos aprender isso por nós mesmos, fechar a janela de bate-papo e encarar a realidade.

#Siga a conta oficial do iFaner no WeChat: iFaner (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante em breve.