Como distinguir uma imagem real de outra criada pela inteligência artificial? Google entra em campo para explicar

Você sabe distinguir uma foto real de uma criada artificialmente? A IA pode ajudá-lo.

A inteligência artificial está a transformar rapidamente setores da medicina à indústria, com aplicações que vão desde o diagnóstico médico automatizado até aos veículos autónomos. No entanto, um dos principais desafios é garantir que a utilização da IA seja ética e transparente. Muitas pessoas estão preocupadas com o uso de algoritmos de IA em áreas como reconhecimento facial e vigilância, onde a privacidade pode ser comprometida. Por esta razão, muitos especialistas e empresas estão a trabalhar em regulamentos e normas que possam limitar o abuso e garantir o uso responsável da tecnologia.

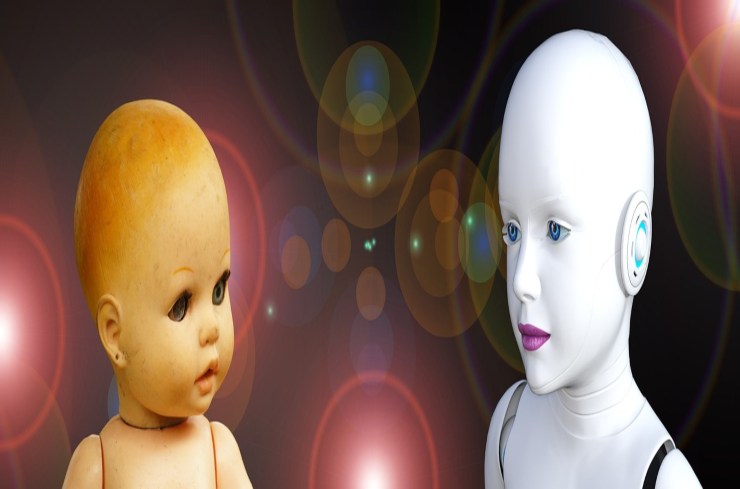

A IA, além de facilitar muitas tarefas do dia a dia, também é utilizada para criar conteúdos gerados artificialmente, como imagens, vídeos e até notícias. Esta capacidade tem levantado dúvidas sobre a veracidade da informação que circula online, à medida que se torna cada vez mais difícil distinguir entre realidade e manipulação digital. Para enfrentar este desafio, algumas empresas tecnológicas estão a desenvolver ferramentas que ajudam os utilizadores a identificar imagens e conteúdos gerados por IA, promovendo maior transparência no mundo digital.

A inteligência artificial (IA) é hoje parte integrante da nossa vida quotidiana, influenciando setores como a medicina, a indústria e o marketing. Os avanços neste campo levaram à criação de algoritmos cada vez mais sofisticados, capazes de realizar tarefas complexas em apenas alguns segundos. No entanto, a utilização da IA levanta muitas questões éticas, especialmente quando se trata de privacidade e transparência. A capacidade de manipular imagens e criar conteúdos realistas, mas falsos, abriu um debate sobre como regular o uso desta tecnologia.

Uma das maiores preocupações é a manipulação digital e a disseminação de conteúdos falsos criados por IA , especialmente no contexto de notícias e imagens virais. Com a capacidade crescente das ferramentas de aprendizagem profunda de gerar imagens e vídeos difíceis de distinguir dos reais, está se tornando cada vez mais difícil para os usuários entenderem se o que veem é autêntico ou modificado. É por esta razão que a transparência na utilização da IA está a tornar-se uma questão crucial, com empresas e governos a procurarem soluções para combater o fenómeno da desinformação digital.

Google apresenta novas medidas para combater a desinformação visual

O Google anunciou recentemente uma série de novas medidas para combater a disseminação de imagens manipuladas por inteligência artificial. Com a crescente popularidade de ferramentas capazes de gerar imagens realistas com IA, como o Stable Diffusion , a empresa está trabalhando para ajudar os usuários a distinguir entre fotos reais e conteúdo gerado artificialmente. O novo recurso “sobre esta imagem” oferecerá detalhes sobre a origem e autenticidade das imagens, promovendo maior transparência e reduzindo os riscos de desinformação visual.

Especificamente, este recurso permitirá aos usuários verificar se uma imagem foi tirada com uma câmera tradicional, modificada com software de edição ou criada inteiramente por modelos de IA. Os usuários poderão acessar essas informações diretamente nos resultados da pesquisa, recebendo detalhes sobre a origem , contexto e eventuais alterações feitas nas imagens. O Google pretende fazer desta tecnologia uma ferramenta essencial para ajudar as pessoas a navegar no crescente mar de conteúdo visual, evitando assim a propagação de falsificações e manipulações.

A iniciativa C2PA: um padrão para garantir a autenticidade das imagens

O Google, junto com grandes empresas de tecnologia como Microsoft e Adobe, aderiu à Coalition for Content Provenance and Authenticity (C2PA) , uma iniciativa que visa criar um padrão para certificar a autenticidade de imagens online. O objetivo é fornecer um rastro verificável da origem das imagens, garantindo que cada arquivo contenha informações sobre como e onde foi criado. Embora a adoção deste padrão ainda seja limitada, a integração nos serviços Google poderá marcar um ponto de viragem na sua difusão global.

Além de certificar a autenticidade, o sistema C2PA visa estabelecer maior confiança no ecossistema digital, dificultando a difusão de imagens falsas ou manipuladas por qualquer pessoa. Este padrão não se aplica apenas a imagens, mas também pode ser estendido a vídeos e outros conteúdos digitais, garantindo que os metadados que acompanham cada arquivo permaneçam inalterados. Com o apoio de gigantes tecnológicos como Google e Microsoft, o objetivo é garantir que a adoção do C2PA se torne uma prática generalizada, facilitando o reconhecimento de imagens autênticas e reduzindo o fenómeno da desinformação visual em grande escala.

O artigo Como distinguir uma imagem real de outra criada por inteligência artificial? | O Google entra em campo para explicar que foi escrito em: Tech CuE | Engenharia de perto .