As fotos que você compartilha nas plataformas sociais podem se tornar parte do conteúdo adulto de IA no próximo segundo

Na obra “Ghost in the Shell”, do final do século passado, Suzi, que é totalmente protética, duvida se ainda existe. A relação entre o corpo, a memória e as outras pessoas, quando essas coisas podem ser copiadas, não pode ser um argumento a favor da vida física.

Quando a cantora de IA se tornou popular, Stefanie Sun também fez uma observação semelhante em sua resposta: você não é especial, já é previsível e, infelizmente, também é personalizável.

Podemos acrescentar que qualquer pessoa pode ser descrita e gerada pela IA, mesmo que nunca tenha feito certas coisas.

Lu Xun realmente disse que quando viu mangas curtas, imediatamente pensou em braços brancos. A imaginação do ser humano é comum. Não é surpresa que sempre que há um novo desenvolvimento na tecnologia, uma certa linha vertical se desenvolva cada vez mais madura: o envolvimento com a pornografia.

De celebridades da Internet a todas as pessoas comuns

O deepfake pornográfico que surgiu em 2017 tem uma sequência.

Antes era “remover flores e árvores” mudando de rosto, mas agora é “criar algo do nada” com algumas linhas de texto.

Com o desenvolvimento do mapeamento de IA, já existem muitos sites que compartilham modelos de IA. Você pode usá-los para gerar imagens de vários estilos, como pinturas de paisagens no estilo Monet, imagens de produtos de correspondência de cores de Wes Anderson e, claro, pornografia que parece um pessoa real. Cenas.

“Create Anything”, este é o banner de um dos sites (para evitar suspeitas de publicidade, o nome não será divulgado). Embora possam fazer tudo, muitos usuários estão mais dispostos a flexionar os músculos nas “Dezoito Proibições”.

Digite o nome da celebridade na caixa de texto, adicione palavras como “nu” e você obterá uma imagem desfocada. Depois, há o preço adicional, US$ 4 por mês para a versão básica ou US$ 15 por mês para a versão premium.

▲ Pague para desbloquear a interface, NSFW significa “não adequado para o local de trabalho”, geralmente se refere a pornografia, violência e outros conteúdos.

Além disso, depois que a imagem é gerada, as palavras de prompt ficam visíveis publicamente, tornando-as muito convenientes para outros usuários com preferências semelhantes continuarem a usar ou iterar.

Além disso, o site tem mais de 3.000 membros e dezenas de salas de chat no software de chat Discord, e eles discutem como melhorar suas habilidades com palavras rápidas para que fiquem mais alinhados com sua própria imaginação sobre uma determinada parte e postura.

▲ O modelo de IA da atriz de Hollywood foi baixado 1.300 vezes.

Os fundadores do site disseram em entrevista que o NSFW representa apenas uma pequena parcela do conteúdo da plataforma, com 1 milhão de criadores ativos produzindo trabalhos únicos todos os meses.

Em outro site semelhante, os usuários podem fazer upload, compartilhar e descobrir modelos personalizados. Existem também vários estilos, como estilo anime, estilo de jogo, estilo retrô de filme… Mas devido à natureza humana, a popularidade dos modelos coloridos continua alta. os mais populares foram baixados de 60.000 a 70.000 vezes.

▲ Um modelo de “Scratch Ball”.

A pornografia certamente faz parte da Internet, mas o problema é que as fotos de pessoas reais usadas para treinar esses modelos foram retiradas da Internet sem o meu consentimento.

Algumas fotos não são totalmente explícitas, mas fazem as celebridades usarem roupas íntimas, ou fazem certas partes parecerem maiores, mas ainda assim é antiético rir a cem passos.

Neste momento, o princípio precisa ser um pouco explicado. Muitos modelos de IA personalizados são baseados no ajuste fino de difusão estável de código aberto, e LoRA é um método de treinamento de ajuste fino de modelo convencional, porque é relativamente leve e pode gerar personagens, objetos ou pinturas específicas com uma pequena quantidade de treinamento.

▲ O cyber coser que antes era muito popular também usava LoRA. A imagem vem de: @掉云工作

Então, para o mapa de cores, quem se torna o conjunto de dados de ajuste fino?

Uma investigação da empresa de mídia independente 404 Media descobriu que os dados de treinamento de um dos modelos vieram de várias comunidades com temática adulta no Reddit, a versão americana do Tieba.

Estar disposto a fazer upload de fotos não significa que você esteja disposto a servir de ração para a IA. Um usuário do Reddit que modera a comunidade suspeita que a maioria das pessoas que postam fotos nuas no Reddit podem não saber que as fotos estão sendo usadas para alimentar o modelo de IA.

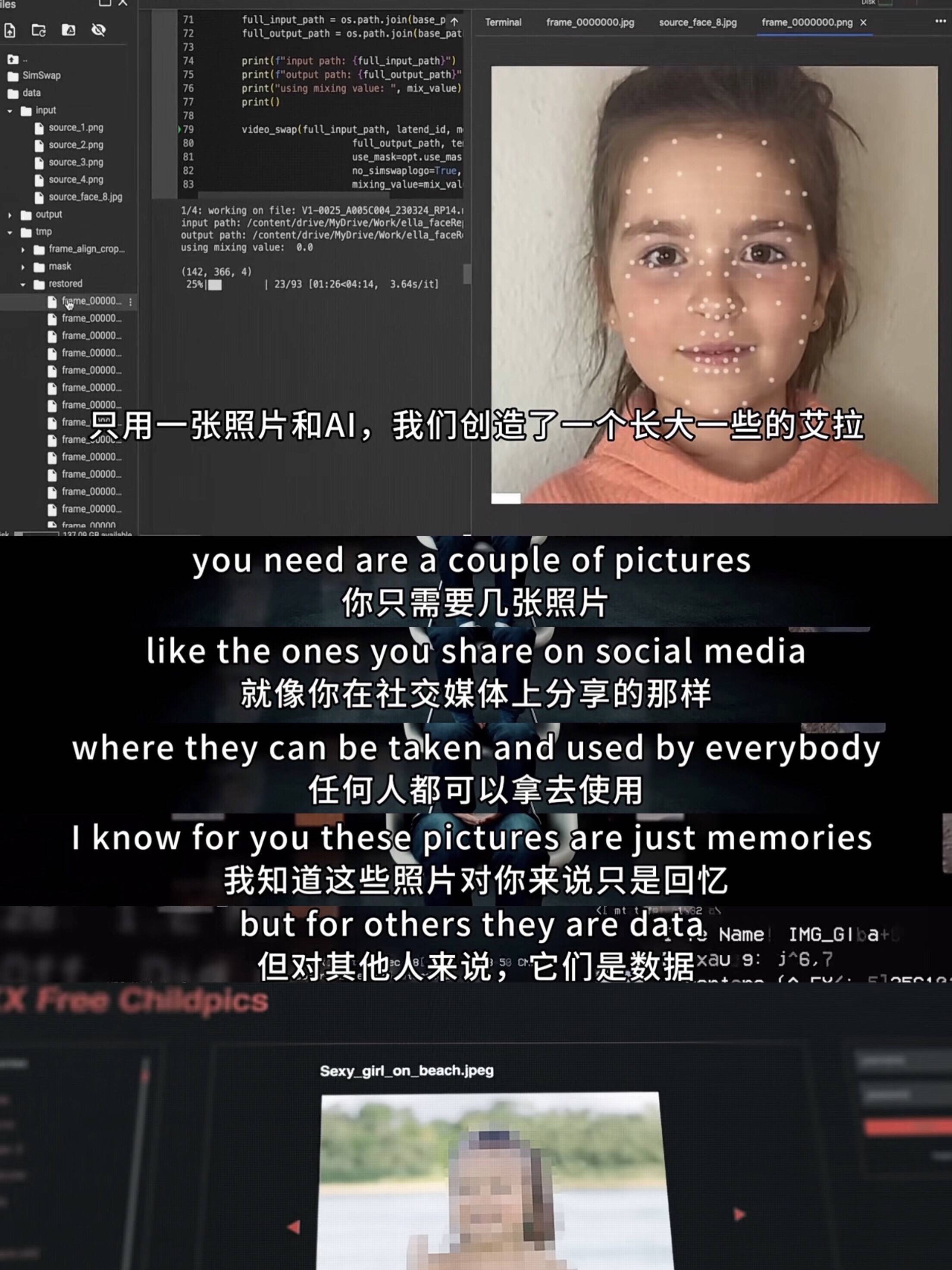

Não é que enviar fotos nuas seja uma ameaça. No início de julho, a Deutsche Telekom publicou um anúncio sobre a segurança dos dados das crianças, mostrando como é fácil a utilização de dados pessoais e quão graves são as consequências, apelando aos pais para que partilhem o menos possível a privacidade das crianças na Internet.

▲ Captura de tela de parte do anúncio da Deutsche Telekom, fotos infantis podem ser usadas para criar conteúdo adulto.

Isso também significa que as ameaças não pairam apenas sobre celebridades e celebridades da Internet, mas também sobre pessoas comuns que passam na Internet. Receio que o futuro onde todos tenham um modelo de IA não esteja longe. Contanto que você e eu tenhamos experiência nos vestígios digitais da Internet.

De acordo com o Relatório Estatístico sobre o Estado da Internet de Julho deste ano, quase 5 mil milhões de pessoas (4,88 mil milhões) estão activas nas redes sociais, representando 60,6% da população total mundial.

Algumas pessoas podem perguntar: isso não é um problema com o Deepfake ao mudar de rosto? Sim, mas o ritmo das imagens falsas não vai parar e os problemas existentes só vão piorar.

Do deepfake baseado na rede de confronto generativo ao modelo de difusão que simula o movimento térmico das partículas, o conjunto de dados de treinamento foi expandido, a estrutura do algoritmo foi iterada e o nível de poder de computação também foi melhorado. De forma mais intuitiva, as pessoas comuns também têm um sentimento de participação na IA.

No passado, estávamos mais inclinados para os consumidores de IA, ou quando escovamos Tom Cruise, que era difícil distinguir entre o verdadeiro e o falso, mantivemos uma mentalidade de espectador ou colocamos filtros divertidos para seguir a tendência das mídias sociais e entregamos Basicamente, suas próprias informações pessoais.

▲ “Tom Cruise” do TikTok, fiquei confuso quando o vi.

Agora todos podemos ser produtores de IA, fazer login no site do modelo de IA, inserir palavras de alerta na caixa de texto e a computação em nuvem processará a demanda, e o trabalho de IA personalizado de uma celebridade pode ser gerado em poucos minutos, até mesmo se a qualidade não for boa, dependendo do tamanho do usuário e do número de fotos É sem precedentes e é fácil produzir milhões de fotos todos os meses.

▲ A velocidade de geração de um site modelo de IA leva até 1 minuto.

O que é assustador sobre o conteúdo adulto de IA é que ele precisa se basear em pessoas reais e retornar à “verdade”.

Um dos modelos mais populares em vários sites dá tanta ênfase ao realismo que os usuários ainda discutem como fechar um órgão no Reddit. Os melhores criadores da indústria dizem até que seus trabalhos são como “quadro congelado de vídeo 1080P+”.

É concebível que o assédio e a extorsão também possam aumentar, e o lado maligno da tecnologia é muitas vezes o primeiro a atacar aqueles que não conseguem proteger-se.

É um interesse, é uma transação

Com sexo, não faltam negócios. Os compradores são por interesse pessoal, os vendedores são por dinheiro real. Além do modelo de assinatura mencionado acima, há muitas maneiras de ganhar dinheiro com mapas de cores de IA, embora sejam basicamente “empregos de meio período”.

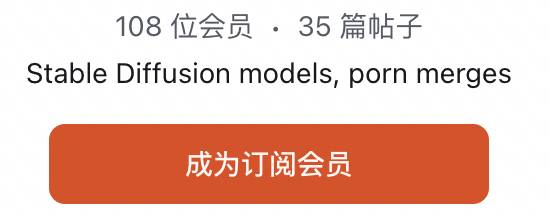

Os criadores podem ser encontrados no Patreon, Ko-fi e outras plataformas com funções de recompensa e patrocínio. Um criador tinha mais de 100 membros pagantes no Patreon e ganhava US$ 1.500 por mês no auge.

A propósito, ele também se juntou ao "Programa de Criadores" de outra plataforma, ganhando US$ 0,001 por imagem. Embora o preço unitário seja baixo, felizmente, ele pode usar a IA com rapidez suficiente.

▲ Interface de assinatura do Patreon.

Também vale a pena mencionar a plataforma de crowdsourcing de tarefas Fiverr. É um intermediário que conecta a Parte A e a Parte B. Ele pode comprar e vender quase todos os "empregos" digitais, como redação, tradução e design. Muitos criadores de IA têm preços claramente marcados , de acordo com modelos e fotos.Quantidade de cobranças escalonadas.

▲ A interface de um criador Fiverr.

Há também criadores com um estilo mais geek, que postam diretamente o endereço da carteira bitcoin no site do modelo AI.

Sem falar nos criadores individuais, a plataforma também ganha muito dinheiro.

Alguns sites de modelo de IA também têm uma função de recompensa, ao mesmo tempo em que oferecem um benefício de assinatura mensal de US$ 5, permitindo que os usuários experimentem novos recursos primeiro e usem um crachá exclusivo atrás do nome de usuário no site oficial e no Discord.

▲ A função de gorjeta do site do modelo de IA.

OnlyFans, que afirma ser o segundo maior site adulto do mundo, não é como o P Station, cuja receita vem principalmente de anúncios e é compartilhada com os criadores de acordo com o número de cliques nos vídeos. Os criadores podem ganhar dinheiro por meio de assinaturas de usuários e pagamentos. por visualização.

Há uma opinião de que OnlyFans mudou a indústria adulta porque os criadores recuperaram o domínio e ganham renda diretamente através de suas próprias obras.

Porém, agora, o “Mestre da IA” que produz imagens mais rápidas também está replicando esse modelo de negócio, e a forma de ganhar dinheiro dos “artesãos tradicionais” pode ser novamente interrompida.

Este episódio que vimos quando os vídeos deepfake estavam na moda. Uma celebridade da internet de 29 anos entrevistada pela Bloomberg foi uma das vítimas inquietas.

No passado, se você quiser vê-la jogar videogame, você pode se inscrever no Twitch por US$ 5 por mês, e se quiser assistir seu conteúdo em maior escala, você pode assinar o OnlyFans por US$ 15 por mês.

Agora, porém, os fãs podem assistir seus vídeos deepfake por menos dinheiro ou de graça, apenas pesquisando o nome dela no Google. Ao mesmo tempo, o trauma psicológico anda de mãos dadas:

As pessoas postam novos vídeos o tempo todo e é horrível se ver na pornografia sem o seu consentimento.

O fogo do mapa de cores da IA, mais cedo ou mais tarde, queimará nas cabeças de pessoas reais. Uma “bodhisattva feminina” que postou uma foto no Reddit estava muito pessimista:

Nada foi feito para nos proteger no passado, por isso não vejo por que qualquer proteção seria incentivada agora.

A operação é tão feroz quanto um tigre, e a proteção dos direitos luta contra os hamsters

O baixo custo de fazer o mal e o alto custo da proteção de direitos são problemas que existiam quando o Deepfake “amarelo” surgiu em 2017, e agora só vai se tornar mais sério.

A remoção de mapas de cores de IA sem o consentimento da pessoa é muitas vezes descoberta pela própria vítima, ou pela plataforma remediada posteriormente.

De acordo com os termos de serviço do Google, os usuários podem solicitar ao Google a remoção de um link específico se houver evidências suficientes. No entanto, “o fogo nunca acaba”, é como um jogo interminável de golpe na toupeira.

No entanto, o Google também está melhorando seu sistema de classificação para reduzir a ocorrência desse tipo de conteúdo.

▲ Termos de Serviço do Google.

As plataformas que fornecem modelos de IA não ignoram que a tecnologia pode ser abusada, mas a escala de conteúdo sem precedentes não permite que a plataforma siga apenas a estratégia de revisão anterior.

Um repórter da 404 Media descobriu que os termos de serviço de um site modelo de IA permitiam conteúdo pornográfico, bem como conteúdo real, mas não permitiam ambos conteúdo pornográfico real, especialmente quando envolvia menores.

No entanto, esse tipo de conteúdo continua a ser publicado, alguns são excluídos pela plataforma e alguns “sobrevivem” por vários meses.

▲ Termos de serviço de um site modelo de IA.

Só se pode dizer que a consciência existe, mas o método não. A especificação da tecnologia está sempre meio passo atrás da tecnologia.

Da mesma forma, gerar imagens pornográficas de pessoas reais viola as regras da comunidade do Discord, mas não é fácil de gerenciar, dependendo principalmente da conscientização do usuário.

A equipe de confiança e segurança do Discord é responsável por verificar as denúncias de usuários, moderadores ou repórteres. Se alguém violar as diretrizes da comunidade, emitirá avisos, excluirá conteúdo, fechará contas, etc., e há uma certa passividade.

▲ Diretrizes da comunidade do Discord, a parte superior é o texto original e a parte inferior é a tradução.

Ironicamente, compartilhar o mapa de cores da IA no Discord também será criticado internamente pelos usuários do site do modelo de IA, não porque estejam com a consciência pesada, mas porque viola as regras e pode fazer com que a comunidade seja banida: "Você pode criá-lo, mas não pode ser compartilhado aqui."

Mesmo a lei pode não ser útil, assim como o Deepfake existe há tanto tempo, apenas alguns estados nos Estados Unidos estão legislando sobre isso, mas por causa do caos, é difícil implementá-lo realmente, e alguns criadores tentam seus é melhor esconderem as suas identidades, uma vez que não conseguem encontrá-la. Protecção dos direitos humanos, muitas vezes a vítima só pode sofrer por ser burra.

Felizmente, várias ferramentas de diagrama Vincent mais convencionais usam a tecnologia para impor restrições à tecnologia com antecedência.

Dall-E, uma subsidiária da OpenAI, minimiza imagens nuas nos dados de treinamento e, no uso real, evita a entrada de certas palavras de prompt e verifica os resultados de saída antes que as imagens sejam exibidas ao usuário.

Midjourney também possui bloqueio de palavras e moderação humana, e planeja implementar uma filtragem mais avançada e sensível ao contexto.

A Stability AI, a empresa por trás da Stable Diffusion, também respondeu a perguntas semelhantes: “O que é feito com qualquer código-fonte aberto está fora de controle”.

Ainda assim, a Stability AI acredita que há muito mais que pode ser feito para identificar e criminalizar tal comportamento, e que a comunidade de desenvolvedores e os fornecedores de infraestrutura de Internet devem se envolver.

Em suma, a regulamentação da tecnologia é como cortar carne com uma faca cega, que não pode ter efeito imediato, e o problema do mapa de cores da IA é muito mais sério do que antes, dependendo de uma "cadeia de produção" que funcione sem problemas:

- Uma comunidade de conteúdo que fornece imagens de treinamento;

- Tecnologia de código aberto para geração de mapas de cores;

- Uma plataforma para comercializar modelos e imagens de IA;

Tivemos o mesmo problema desde que os deepfakes foram lançados. A natureza humana é imprevisível, a popularização e o abuso da tecnologia estão a apenas um passo, as ferramentas são mais fáceis de usar e o modelo de negócio também é suave, por isso a motivação para criar e distribuir mapas coloridos é ainda maior.

Em muitos casos, a indústria adulta na Internet tem sido vista como "desumanizada".Quando a IA verdadeiramente desumana a substitui e continua a satisfazer estereótipos, pode levar a um nível mais elevado de objectificação, em vez de parar a objectificação.

Tal como a questão levantada por “Ghost in the Shell”, o real e o falso já não são distintos. Alguém que é exatamente como você fez algo que você nunca faria, mas é difícil para você provar que não é você, que os dados são você e que os vestígios da existência são você.

Sempre que a IA é aplicada pela primeira vez à indústria pornográfica, algumas pessoas dizem que isso irá acelerar a adoção da tecnologia ou eliminar a necessidade de pessoas reais. Algumas pessoas trocam dinheiro pelos seus desejos e algumas pessoas são inadvertidamente jogadas no caldeirão da tecnologia, mas ninguém pagará pelo dano.

#Bem-vindo a seguir a conta pública oficial do WeChat da Aifaner: Aifaner (WeChat ID: ifanr), mais conteúdo interessante será apresentado a você o mais rápido possível.