A primeira parada do metaverso para pessoas comuns, quem é o guia?

Para os amantes do cinema, a captura facial é um conceito familiar e desconhecido. É familiar porque a captura de movimento e a captura facial são tecnologias comumente usadas em filmes mágicos. Muitos personagens não humanos clássicos dependem dessas duas tecnologias para serem concluídos. É o progresso tecnológico que nos permite testemunhar a magnífica Terra-média e suas diversas raças em "O Senhor dos Anéis", as maravilhas alienígenas em "Avatar" e a conexão entre humanos e outras espécies na tela.

Não é familiar porque, para a maioria das pessoas, a captura facial é uma tecnologia que foi ouvida, mas não experimentada. Temos sido espectadores dessa tecnologia, em vez de testemunhas.

Mas a curva do progresso tecnológico costuma ter duas ramificações, uma avança e vai mais longe; a outra desce, do alto custo para o baixo custo, de afetar algumas pessoas para beneficiar milhões de pessoas. Às vezes, os dois fios também andam de mãos dadas e se entrelaçam para criar uma energia maior.

Fazer captura facial no metaverso é difícil

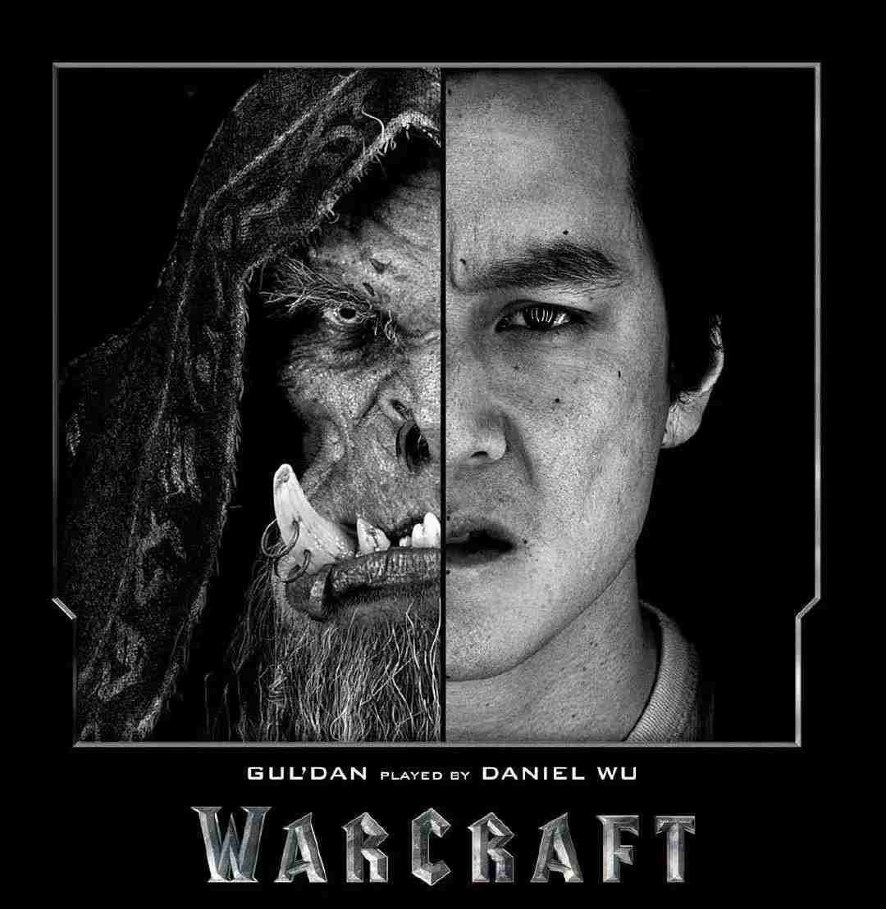

No filme "Warcraft" de 2016, contando com captura de movimento e captura facial, o candidato asiático Wu Yanzu interpretou o feio e malvado orc Gul'dan no filme.

No campo da captura de movimento e captura facial, há até uma superestrela chamada Andy Serkis, que interpretou o personagem-chave Gollum na trilogia "O Senhor dos Anéis" e o protagonista da trilogia "A Ascensão do Planeta dos Macacos". … Gorila César.

▲ Demonstração do Metaverse lançada pela Microsoft no ano passado

Os filmes são o mundo virtual fora do qual vivemos, e o metaverso é o mundo virtual em que podemos viver no futuro. No entanto, os usuários que experimentaram os aplicativos Metaverse VR já devem ter percebido que o "eu" aqui está muito longe do "eu" real. A modelagem aqui é grosseira, sendo até impossível mapear as pernas do usuário no início. Entre , sem falar nas ricas expressões dos usuários.

Portanto, às vezes, como um dos primeiros a adotar, invejarei a tecnologia de captura facial em apresentações de filmes e espero que, no metaverso, não seja o vilão dos desenhos animados como um programa QQ, mas possa viajar pelo continente da Terra-média, Azeroth fantasistas do mundo do Sri Lanka ou do planeta Pandora.

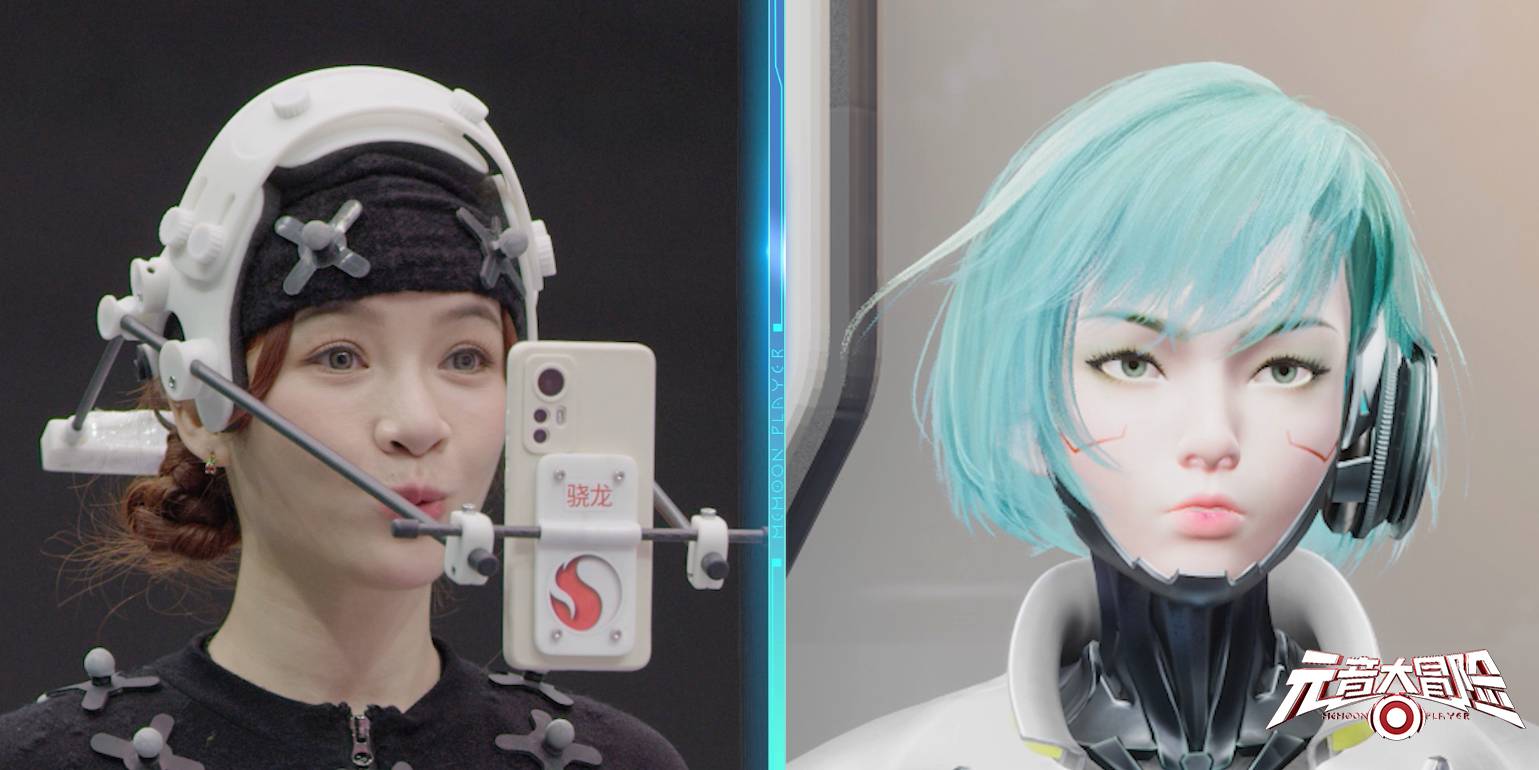

Mas não é sem exceção. O primeiro reality show inovador de jogo de realidade virtual da iQIYI, "Vowel Adventure", trouxe muita tecnologia legal para a produção do reality show, permitindo que os convidados entrem no mundo virtual— ——The Vowel Continent, embarcando em um aventura hilariante e divertida.

Este pode ser um dos poucos conteúdos do Metaverso que tem uma "sensação de refinamento". Essa sensação de refinamento é derivada da "semelhança espiritual" entre o personagem virtual e a estrela correspondente. Por trás dessa "semelhança espiritual" está a já mencionada captura facial tecnologia.

No Metaverso, a captura facial em nível de filme de nível industrial, acessível a apenas algumas pessoas, obviamente não é uma tecnologia inclusiva.Se a captura facial puder ser feita com um telefone celular, é naturalmente a melhor.

No entanto, é naturalmente difícil alcançar o salto do nível industrial para o nível do consumidor.

Nos filmes industriais maduros de hoje, a realização da captura facial precisa quase segue a lei de entrada alta e saída de alta qualidade.

▲ Antes e depois da produção de efeitos especiais de "Avatar"

O investimento aqui inclui tempo e dinheiro. Pegue "Avatar", que já nos trouxe um espetáculo visual, como exemplo. O diretor James Cameron levou 10 anos desde a ideia de filmar até o pouso do projeto.

Nos extras do filme, cada ator precisa marcar seu rosto com pontos pretos, que são captados pela câmera à sua frente, ao mesmo tempo em que várias câmeras são distribuídas para captar os movimentos do corpo.

Quando todas as tramas são filmadas, isso não significa que a produção do filme acabou, pois levará aproximadamente o dobro ou até o dobro do tempo de filmagem para encaixar as expressões faciais e os movimentos corporais coletados pela câmera nos personagens virtuais.

![]()

▲ Antes e depois da produção de efeitos especiais de "Avatar"

E para alcançar um resultado suficientemente chocante, muitas vezes é necessária uma enorme equipe de pós-produção para concluí-lo em conjunto. Esse tipo de linha de montagem tradicional de nível industrial, embora o efeito seja bom, a precisão é total e está tomando o caminho de ter muitos problemas e desistir da velocidade.

A velocidade e a precisão da captura facial são um pouco semelhantes a um peixe e uma pata de urso. No campo do design de algoritmos de IA, eles e o consumo de energia geralmente formam um triângulo impossível, que é o "trilema". Em termos leigos, é um escolha do trilema.

Existem 43 músculos no rosto humano para expressar nossas emoções juntos. Muitas expressões são complexas e sutis, e a diferença entre diferentes expressões geralmente é separada apenas por um rio.

Para expressar com precisão os verdadeiros sentimentos no metaverso, ou para transmitir as microexpressões faciais na realidade para o mundo virtual, a precisão da captura deve atingir um certo nível e é necessário captar com precisão centenas de pontos de recurso e, em seguida, cooperar com o modelo Algoritmos são restaurados.

Vale a pena notar que o "metaverso" que mencionamos não é uma criação. Ele pode ter uma certa quantidade de pós-produção. Se você quiser se sentir imersivo e obter feedback em tempo real, a captura facial e a comunicação precisam ser sincronizadas e calculadas e feedback em tempo real.

Mesmo de acordo com o padrão de 24 quadros de um filme, ele ainda precisa processar 24 quadros de imagens de alta precisão por segundo em tempo real, capturar os pontos-chave de centenas de pontos de recurso e concluir a reconstrução das expressões.

Já dá muito trabalho capturar rostos humanos complexos e dinâmicos. Além dos rostos humanos, existem muitos, muitos fatores externos e emergências que também afetarão o efeito da captura facial. No Metaverso, é impossível para nós para criar um estúdio de cinema, iluminação profissional e computador de pós-processamento para fazer este trabalho.

Tudo acontece e é registrado agora.

Portanto, se você deseja obter melhores resultados, precisa adicionar fatores objetivos e subjetivos, como diferentes mudanças de luz e sombra, vibração do capacete, câmera e outros equipamentos usados e oclusão parcial da face.

Resumindo, a captura facial pode soar como nada mais do que uma tecnologia de captura de imagem, mas na verdade ela precisa levar em consideração diversos pontos de informação relacionados ao rosto, como alterações de microexpressão, ambiente de iluminação e outros fatores.

Ele não apresenta as mudanças musculares do rosto no mundo virtual uma a uma, mas transmite as emoções da realidade com precisão e em tempo real.

Por que o Snapdragon pode obter captura facial no Metaverso?

Para a gravação e apresentação de expressões faciais, de fato, já temos aplicativos correspondentes ao nosso redor, ou seja, os "emoticons animados" que a maioria dos fabricantes adicionou aos aplicativos de bate-papo.

Funciona como uma função de entretenimento que enriquece o bate-papo. Não requer alta precisão, podendo registrar apenas algumas expressões mais características. Na verdade, é difícil apresentar expressões sutis.

Para o programa "Vowel Adventure" da iQiyi, a forma de "emoticons animados" está longe de ser suficiente.

O desafio é que o algoritmo de captura de rosto pode ter peixes e pata de urso, e a dificuldade de captura de rosto humano é maior do que a captura de movimento humano e captura de rosto de animal.

Portanto, hardware, software e suporte de hardware para software, esses três níveis, determinam se o Snapdragon pode fazer um bom trabalho na captura facial, o que significa que requer o poderoso poder de computação subjacente da plataforma do chip do telefone móvel e o suporte da rede neural algoritmos.

Muito antes de o conceito Metaverse se tornar popular, o algoritmo de imagem do chip Snapdragon era suficiente para reconhecer certos dados faciais e a otimização direcionada era realizada por meio do algoritmo correspondente.

No entanto, é a primeira vez que a captura facial, ou o uso da tecnologia de captura facial, participa da produção de "Vowel Adventure".

A primeira é depurar o algoritmo correspondente com base na tecnologia original. Comece com a precisão, treine um modelo complexo com uma grande quantidade de cálculos, cubra todas as expressões possíveis o máximo possível e, em seguida, compare e depure repetidamente para atender às necessidades de gravação do programa. .

Levando em consideração a redução da quantidade de cálculo, é realizado o “cálculo de corte”, ou seja, o ônus é reduzido, mas a premissa é reduzir a quantidade de cálculo mantendo uma certa precisão de captura facial.

Anteriormente, o algoritmo AI para cálculo de dados faciais usava a CPU do celular, que só pode ser mantida a 30fps mantendo uma certa precisão e, no processo de cálculo de alta frequência, causaria facilmente o acúmulo de calor do dispositivo , e em alguma luz complexa A situação de preso sob a expressão.

Para resolver o problema de consumo de energia e vida útil da bateria, a Qualcomm introduziu a ferramenta Snapdragon SNPE (Snapdragon Neural Processing Engine, que é um software de tempo de execução para rede neural profunda acelerada por Snapdragon) otimização neste algoritmo e habilitou o AI motor.

Desta forma, o algoritmo AI original pode rodar a 60 fps e continuar rodando por três horas, o que resolve quase perfeitamente o problema de precisão e velocidade, permitindo que "você possa ter os dois".

O mais chocante é que, quando o programa foi gravado, essa solução era baseada apenas na geração anterior do chip Snapdragon 8+, e o mecanismo de IA também era da geração anterior.

Outro ponto é que nos destaques da gravação pré-exposta, os rostos das estrelas envolvidas na gravação não possuíam os tradicionais pontos de amostragem intensiva de dados, e usavam apenas capacete e terminal de celular Android para equipamentos fixos.

Não há necessidade de marcadores especiais ou gravação em vários ângulos de várias câmeras. Um celular Android baseado no chip Snapdragon pode completar a coleção de 300 pontos de recursos no rosto e usar o mecanismo AI do terminal para analise o complexo algoritmo de IA para renderização em tempo real.

Para a captura facial, a precisão e a velocidade são finalmente alcançadas por meio de algoritmos, mecanismos de IA e aceleração de hardware NPU. Por outro lado, para "Vogal Adventure", a força técnica de Xiaolong tornou este programa desde a concepção até a ação real.

Para todos os tipos de interferência que não sejam rostos humanos, a Qualcomm Snapdragon e a Xiangxin Technology também fizeram avanços tecnológicos para vários detalhes.

Por exemplo, quando um artista está cantando, porque o microfone está muito próximo do rosto, vai causar uma oclusão grave na captação face a face. Isso precisa ser considerado no projeto técnico. No final, eles perceberam que mesmo que a boca esteja parcialmente ocluída, eles ainda podem capturar os movimentos da boca de forma estável e manter a realidade virtual Estabilidade facial da imagem, evitando "contrações, tremores" e outras situações que afetam o efeito no local devido à captura insuficiente.

A primeira parada do metaverso, Xiaolong como guia

Pode-se ver que "Vogal Adventure" provou que, no futuro, podemos usar o celular da plataforma móvel Snapdragon 8 para completar a captura facial, como uma estrela, para refletir e nos expressar no mundo do metaverso. Assim como o pequeno fantasma Wang Linkai, a imagem é um palhaço peculiar, mas a expressão ainda são suas próprias emoções.

▲ Clique para jogar

No passado, podemos perceber claramente os vários avanços trazidos pelo progresso do SoC do telefone móvel: CPU single-core para CPU multi-core, para que o telefone celular não fique mais preso; progresso GPU, os jogos que podem ser jogados , de "Angry Birds" ao nível de desktop "Yuanshin", e a taxa de quadros do jogo móvel, de 30fps a 120fps; a rede é semelhante, graças ao progresso do Modem, a velocidade da rede também mudou de kb para mb para o nível de gb atual.

Mais importante, como mencionado anteriormente, a tecnologia não deve apenas avançar, mas também diminuir. Se a interface do sistema operacional móvel atual ainda precisar inserir símbolos de comando em vez da interface gráfica de toque atual, o poder de computação do chip Snapdragon não não importa o quão forte seja, é difícil enviar centenas de milhões de produtos todos os anos.

Quando a Xiaolong e a Xiangxin Technology cooperaram para completar a tecnologia de captura facial de limiar ultrabaixo para programas de variedades com o tema do metaverso, a proposta encontrada não foi apenas superar as dificuldades técnicas, mas também criar um sistema suficientemente simples, fácil de usar e inteligente. e estável Em comparação com a tecnologia, os usuários dessa tecnologia não são técnicos e desenvolvedores, mas equipes e atores de produção de cinema e televisão.

Existe uma complexa teoria da gravidade por trás de todas as aterrissagens usuais da maçã, semelhante ao progresso do Snapdragon que suporta a captura facial, quem está por trás disso?

A resposta é Qualcomm AI Engine.

Comparado com a CPU e GPU do processador, a presença do mecanismo de computação AI é mais fraca. Mesmo que o poder de computação de cada geração do mecanismo AI esteja aumentando exponencialmente, a percepção que ele traz parece um pouco fraca?

Tome esta apresentação rápida e boa de captura facial como exemplo, o mecanismo de IA em dispositivos comuns atingiu um nível considerável.

Em tempos normais, o poder de computação do mecanismo AI aumenta exponencialmente e todas as operações que você faz, como desbloquear, ligar a câmera, ativar o assistente de voz etc., não são cercadas pelo AI motor o tempo todo.

O alto poder computacional trazido pelo motor de IA faz com que essas operações respondam mais rápido, fazendo com que você desconheça a existência da tecnologia, mas cercado por uma melhor interação humano-computador.

▲ Clique para jogar

O mecanismo Qualcomm AI brilha não apenas na captura facial e na criação de avatar no programa "Vowel Adventure". Se o metaverso quiser imersão suficiente, primeiro ele precisa ter as mesmas percepções do mundo real, como visão e audição.

A captura facial precisa e a captura de movimento podem ser categorizadas em visão, enquanto a audição pode trazer uma experiência de som de baixa latência e alta qualidade com a ajuda da tecnologia Snapdragon Sound.

Por trás dessas tecnologias está a participação do mecanismo Qualcomm AI, e a ajuda do mecanismo AI também se tornou a chave por trás do metaverso.

Se você comparar os avatares em algumas plataformas chamadas Metaverse no país e no exterior, como Meta's Horizon, verá que apenas as imagens apresentadas em "Vogal Adventure" podem ser atraentes para pessoas comuns. A diferença de imagem aqui é completamente a diferença entre a rede 2G e a rede 4G.

O "eu" no mundo virtual está mais próximo do "eu" real, de modo que o metaverso é possível.

A tecnologia, aqui, é o elo que conecta o "eu" nos dois mundos. O "eu" caiu no chão em outro mundo virtual, cambaleando, e saiu da Vila dos Aprendizes. A primeira parada desse metaverso, o celular Snapdragon plataforma , é sem dúvida , é um guia.

#Bem-vindo a prestar atenção à conta pública oficial do WeChat de Aifaner: Aifaner (ID do WeChat: ifanr), conteúdo mais interessante será apresentado a você o mais rápido possível.