A IA está mudando o rosto de empresas multinacionais fraudadas de quase 200 milhões, tenha cuidado com esses novos golpes

No ano novo e no novo clima, além de ter um bom relacionamento com o Deus da Riqueza, também é importante guardar a bolsa de dinheiro.

O processo de implementação da tecnologia é muitas vezes a história da evolução do conteúdo pornográfico e das rotinas fraudulentas.

Aproveitando o saldo restante durante as férias, ensine os mais velhos a serem cautelosos com novos golpes de IA, para que você possa alcançar a “prosperidade comum” do grupo familiar da “família amorosa”.

Capturar muitos blogueiros de IA pode enganar as pessoas mais do que "Fake Jin Dong"

Diz-se em "Westward Journey" que os humanos nascem de humanos e os demônios nascem de demônios. A IA produzida pelo código não tem pais, mas quer fingir ser de carne e osso para que você a entenda mal como um ser humano.

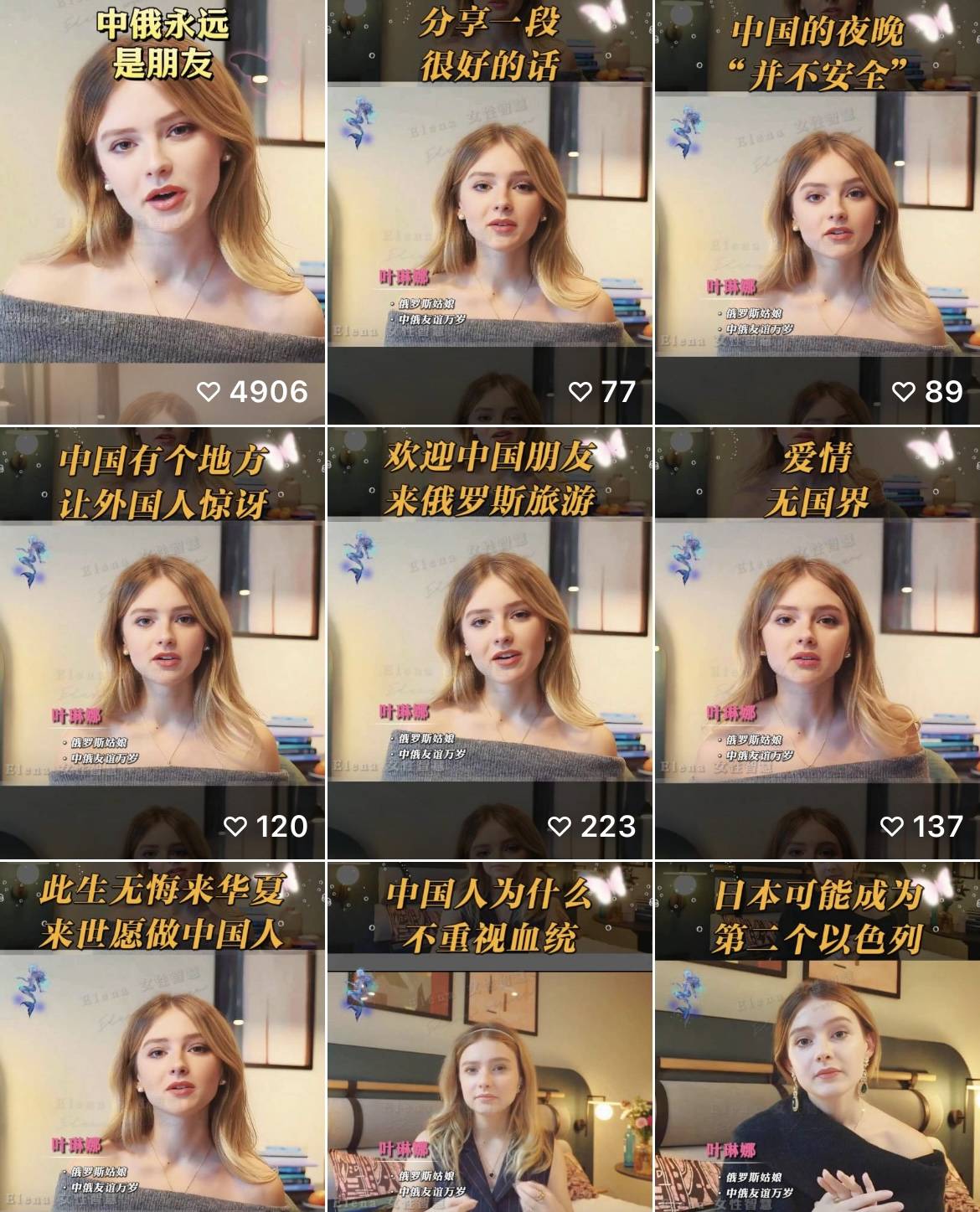

Recentemente, muitas "belezas russas" apareceram em contas de vídeo. Todos eles têm pele clara e são bonitos, e seu mandarim é fluente, mas a fragmentação e a pronúncia das frases são estranhas, e suas entonações e sons nasais são difíceis de pronunciar. É claro que, considerando sua condição de estrangeiro, seria natural ter sotaque.

Eles são entusiasmados e amam a cultura chinesa. Eles rotularam o vídeo com rótulos como "Garotas Russas na China" e "Amizade Sino-Russa", e trouxeram aos espectadores "especialidades de sua cidade natal", como linguiça de tendão de carne, costelas grandes, leite de cabra em pó, e pepino em conserva., chocolate, sabonete artesanal.

Eles têm sobrancelhas que parecem estar franzidas, mas não franzidas, e olhos que parecem felizes, mas não felizes. Além de carregarem bens, eles também expressam suas opiniões. Eles acreditam que o amor não conhece fronteiras e acreditam que a simplicidade é o verdade. Eles lamentam a prosperidade aqui e querem se casar com seus pais e irmã. Também desenvolvido.

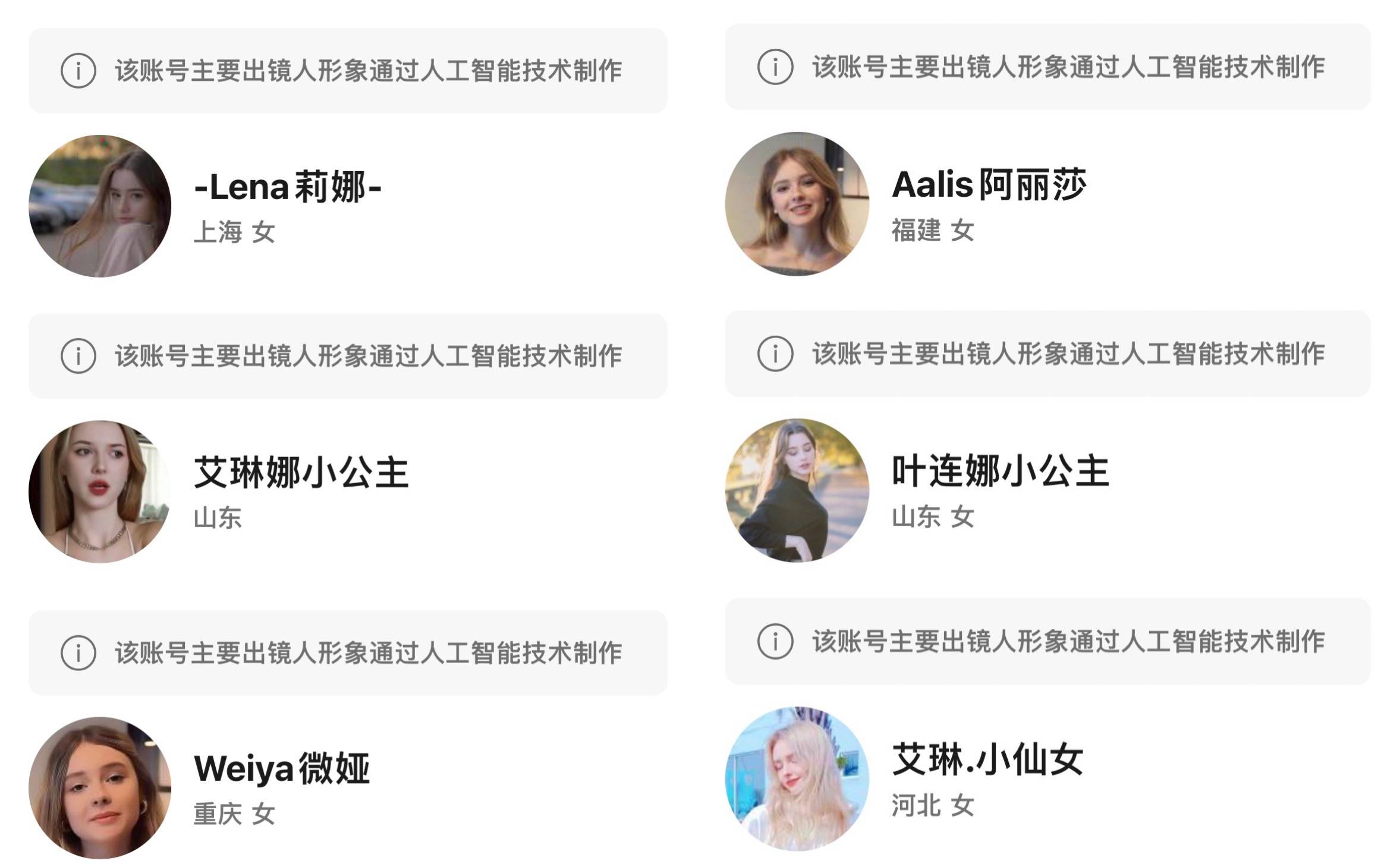

Elas podem ser irmãs há muito perdidas. Yelena e Elena parecem exatamente iguais, e seus IPs são ambos de Shandong. Eles são como uma bola de fogo quando reunidos e um céu cheio de estrelas quando espalhados. Eles estão distribuídos por todo o mundo. Lina é de Xangai, Nina é de Anhui, Irene é de Hebei, Katya é de Liaoning e Alyssa é de Fujian.

Essas belezas russas são todas IA, e a plataforma as marcou cuidadosamente. Podemos perceber a diferença por meio de seus fundos exageradamente desfocados, cabelos despenteados, conjuntos repetidos de expressões e movimentos e linhas excessivamente realistas.

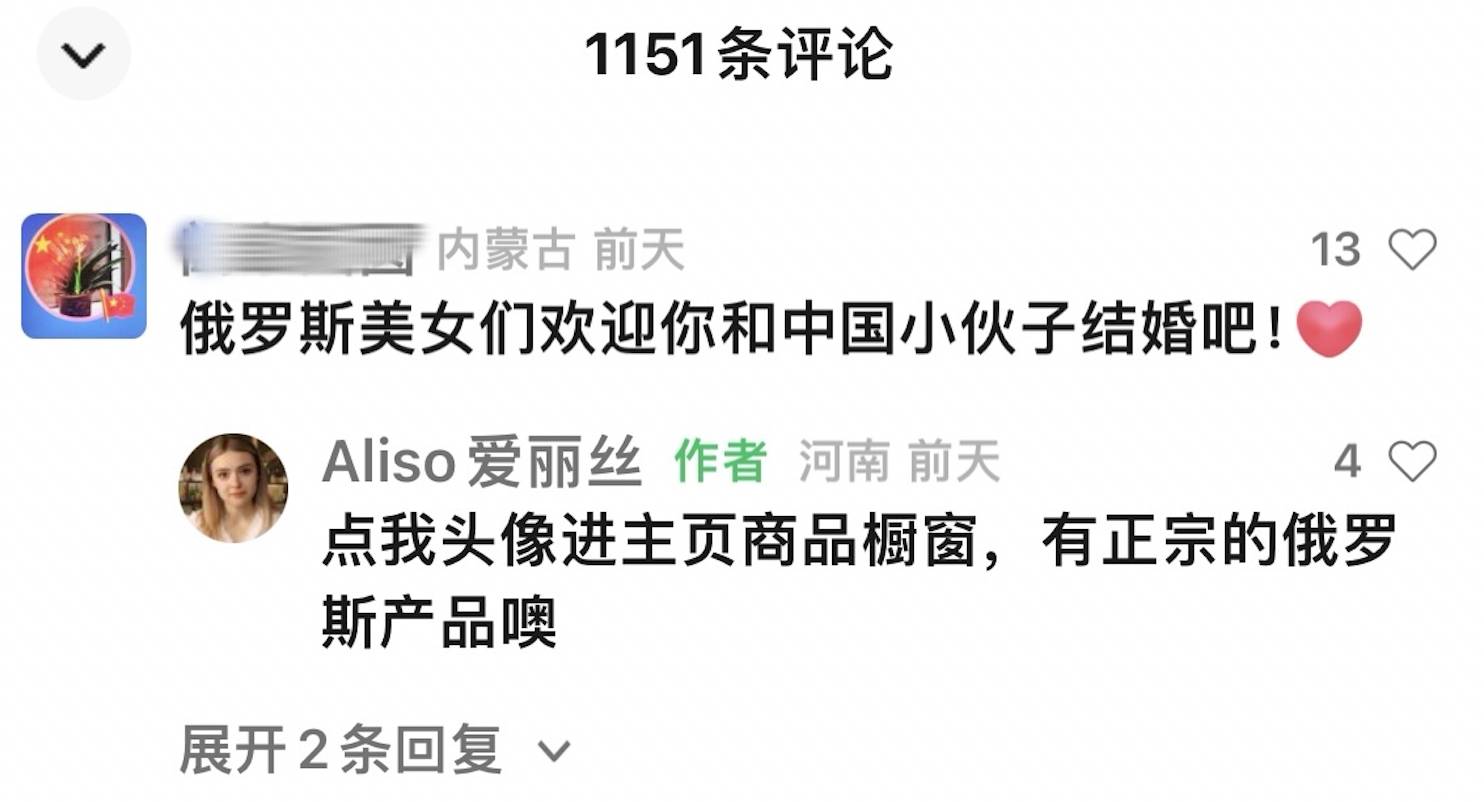

Mas as pessoas de meia-idade e idosos na área de comentários não conseguiam perceber e esperavam sinceramente que ficassem.Ao responder, as “belezas russas” estavam apenas preocupadas com suas missões e completaram uma fraude leve de maneira silenciosa.

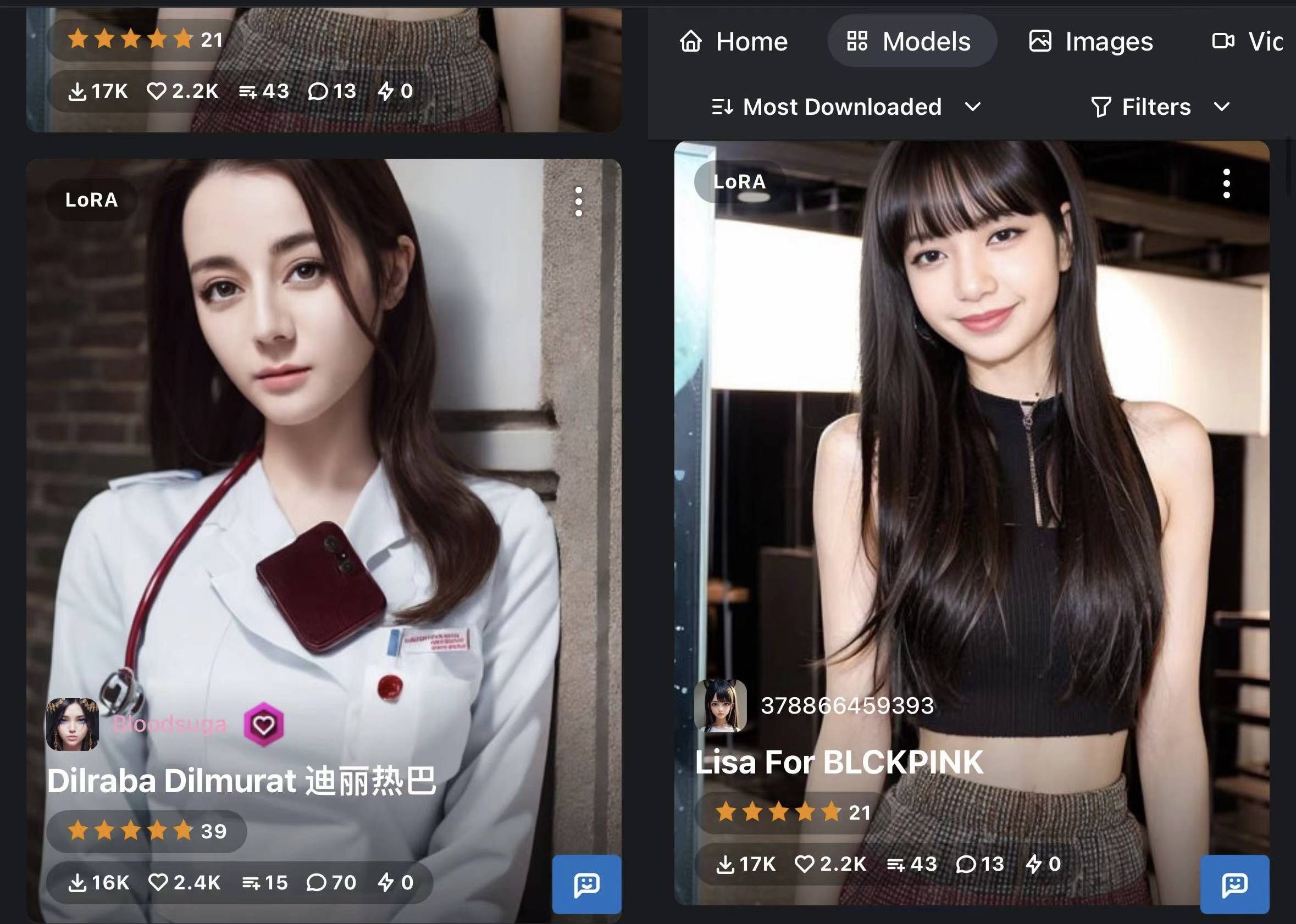

É da natureza humana ser seduzido pela beleza, independentemente da idade. Os belos blogueiros de IA de Xiaohongshu usam personagens elegantes e amigáveis à Internet para matar jovens e velhos. "Homem de elite de terno", "estudante atlético de meias brancas", "deusa do puro desejo"… À primeira vista, pensei que fossem pessoas reais que haviam passado na foto P.

Neste momento, olhar para as mãos ainda é a única forma de identificar se é IA, porque o rosto é relativamente plano e fácil de aprender, enquanto as mãos têm uma estrutura tridimensional, que exige mais mão-de-obra. Escusado será dizer que o número de dedos é excessivo e os nós dos dedos são torcidos com tanto cuidado que é muito suspeito não mostrar as mãos, a menos que seja necessário. Da mesma forma, detalhes como músculos, membros, roupas, etc. também podem apresentar falhas óbvias.

Os restantes métodos de identificação tornam-se cada vez mais metafísicos e intuitivos: o estilo de pintura é oleoso, o copywriting é turvo, não há sopro de vida, os efeitos de luz e sombra não são naturais, os olhos estão sem vida, o rosto também delicado e perfeito, só há fotos estáticas e nenhum vídeo, único É difícil ter certeza só de olhar uma foto, mas se você olhar mais algumas fotos, verá que cada postura tem a mesma expressão…

O blogueiro de IA de Xiaohongshu @cyberAngel_ é engenheiro de software de profissão, e a pintura de IA é um hobby que gera eletricidade. Ele não esconde o fato de que usa IA. O título de sua postagem indica "Pintura de IA", e o perfil de sua conta também diz "Eu sou apenas um robô sem emoção."

▲ Foto de: 小红书@cyberAngel_

Ao mesmo tempo, @cyberAngel_ acredita que futuras pinturas de IA se tornarão cada vez mais difíceis de distinguir entre verdadeiro e falso. A geração de IA e a detecção de IA evoluem entre si. Os criadores estão mais conscientes de onde a IA não é como as pessoas reais, então eles trabalharão É difícil fazer com que esta parte "goste" de pessoas reais. Por exemplo, a linda garota produzida pela IA é perfeita demais, então pode ser desfocada apropriadamente e adicionar uma "sensação de filme".

Mesmo que o blogueiro de beleza de IA não seja tão real, um enredo semelhante ao de "Beleza Russa" apareceu. A plataforma claramente sugeriu que "suspeito de conter informações de criação de IA". Ainda há pessoas deixando peidos de arco-íris no área de comentários, e até mesmo pedindo links para roupas. Parece que a questão da verdade ou da falsidade inevitavelmente dará lugar à beleza como justiça.

Quando o número de fãs aumenta, os blogueiros de beleza de IA podem monetizar de várias maneiras. Alguns são autossuficientes e monetizam seu tráfego por meio de publicidade. Alguns pagam por conhecimento, vendem cursos e modelos personalizados. De acordo com @cyberAngel_, "Novas mídias existem são novos métodos de monetização de mídia, e a tecnologia tem métodos de monetização de tecnologia.”

▲ Modelo da vida real.

As "belezas russas" e "blogueiras bonitas" da IA são um tanto semelhantes ao "falso Jin Dong" que anteriormente fraudou mulheres de meia-idade e idosas em suas emoções e dinheiro, mas são ainda mais assustadoras e imaginativas.

"Fake Jin Dong" não tem conteúdo técnico. Vídeos e fotos relacionadas a celebridades são baixados ou comprados em pacotes. Sua voz afetuosa é forjada usando um software de mudança de voz. É tão rude que "falso à primeira vista". A IA O nível é mais alto e às vezes é real. Não é tão fácil distinguir.

Só se pode dizer que quando vemos rapazes bonitos e raparigas bonitas na Internet, é melhor não presumir que são pessoas reais, nem ser demasiado sinceros.As empresas de celebridades da Internet não querem gastar dinheiro em KOLs reais, e o público consome lotes de KOLs mais rapidamente. As visões de beleza e baixo custo estão alinhadas com as leis de comunicação da Internet.

IA imita seu rosto e assusta seu coração

Além de lançar uma ampla rede através de “blogueiros bonitos” e “belezas russas”, a IA também pode atingir com precisão.

Em outras palavras, a IA pode não apenas tecer um campo suave, mas também se transformar em um mestre PUA.

Um tipo comum de fraude de IA é quando o golpista falsifica o identificador de chamadas e a voz de um conhecido e diz às pessoas de meia-idade e idosas que recebem a ligação que seus netos estão com problemas. Eles cometeram algo e precisam de dinheiro para resolver o problema, ou eles estarão em perigo. Resgatados com resgate.

Vários desses golpes telefônicos foram relatados no exterior. As tramas são semelhantes, incluindo sequestro, ferimentos, dirigir embriagado e colisões traseiras… Coisas semelhantes também aconteceram na China, especialmente usando a "diferença de tempo e espaço" para fabricar o sequestro. de estudantes internacionais fraudarem seus pais.

A rotina em si não é nova e é popular há vários anos, mas devido ao desenvolvimento tecnológico, os requisitos de poder computacional, amostras e outros aspectos foram reduzidos, o efeito é mais realista e o golpe é mais fácil de implementar.

ElevenLabs, líder em clonagem de voz com IA, precisa apenas de um dólar e um minuto de áudio de alta qualidade, permitindo que você domine instantaneamente 29 idiomas e vários tons, mantendo seu próprio sotaque, entonação e ritmo.

Embora o Elevenlabs de hoje tenha garantido repetidamente que somente você pode clonar sua própria voz, e há um processo de verificação para provar que a voz pertence a você, este é o último recurso.Quando o Elevenlabs lançou pela primeira vez a versão beta em 2023, vozes clonadas de celebridades como Taylor Swift já estavam voando por todo lado. Não posso decidir o que AI Taylor Swift diz.

No entanto, embora a outra parte possa falsificar o identificador de chamadas e a voz, se a pessoa em questão for lúcida, desligar o telefone, digitar novamente o número do celular e tomar a iniciativa de entrar em contato com parentes, a mentira muitas vezes será auto -derrotando.

Em comparação com as chamadas de voz, as videochamadas podem tornar as pessoas de meia-idade e idosas que acreditam que “ver para crer” mais céticas em relação à vida.

A velha piada de não saber quem é humano ou cachorro do outro lado da tela nunca sai de moda e não é difícil de conseguir tecnicamente. Uma operação mais comum é conversar com a outra parte por meio de software de câmera virtual e função de mudança de rosto de IA.

Uma empresa de tecnologia de Shenzhen entrevistada pela CCTV que fornece suporte técnico ao órgão de segurança pública disse que ao realizar a mudança de rosto em tempo real no chat de vídeo, seja um avatar ou uma foto do círculo de amigos, após o upload da imagem, o reconhecimento do recurso leva apenas cerca de 30 segundos e, em seguida, a IA começa a construir o modelo e realiza a conversão em tempo real após a conclusão da modelagem.

Você ainda pode ter cuidado com vídeos individuais, mas e uma "equipe profissional" um-para-muitos?

Recentemente, a sucursal de uma empresa multinacional em Hong Kong foi fraudada em 25 milhões de dólares devido à IA. A vítima era um funcionário financeiro. Recebeu um email do “CFO” da sede britânica e foi convidado a participar numa videoconferência envolvendo “transações secretas”. "colegas" familiares ”.

Os colegas participantes da reunião não estavam realmente presentes, o golpista baixou o vídeo público, falsificou o rosto e a voz da pessoa real por meio do Deepfake e depois aplicou-o na videoconferência. Para evitar a exposição do segredo, o “CFO” deu a ordem unilateralmente. Os “colegas” não se comunicaram com a vítima e o vídeo foi rapidamente desligado. O golpista continuou a entrar em contato com a vítima por e-mail e outros métodos.

▲ A polícia demonstrou como usar o Deepfake para falsificar uma videoconferência com várias pessoas.

Embora existam resultados de investigações sobre o assunto, alguns internautas suspeitam que se trate apenas de uma pessoa interna. As medidas de gestão e controlo de riscos das empresas multinacionais são desconhecidas, mas o que é certo é que a mudança de rosto da IA também pode ser alargada a muitos lugares, desde as primeiras mudanças de cabeça em filmes pornográficos até celebridades falsas trazendo bens em salas de transmissão ao vivo.

Felizmente, a IA ainda não é perfeita e o método de identificação ainda é simples e viável.

Se for um vídeo de mudança de rosto por meio de IA, a imagem original da câmera consome muito poder de computação ao converter várias camadas, e o som e a imagem são frequentemente atrasados. Além disso, você pode orientar a outra pessoa a realizar algumas ações, como abrir a boca, balançar a cabeça significativamente, mover os dedos para frente e para trás na frente do rosto, etc. Se a IA mudar de rosto, o "rosto" pode ser deformado e falho.

Além de quebrar bugs técnicos, há outro truque que sempre foi experimentado e testado, que é fazer algumas perguntas sobre privacidade que você conhece, eu sei, e ele não sabe, ou você pode inventar mentiras e deliberadamente use truques para ver como a outra parte responde.

É claro que a falta de tecnologia só pode resolver dificuldades temporárias. Poderíamos muito bem desprezá-la estrategicamente e prestar atenção a ela taticamente. Não podemos pensar que não seremos enganados. Pode ser que o jogo de última geração ainda não tenha aparecido .

Os golpes de IA não são novos, mas surgiu uma nova exclusão digital

2023 é conhecido como o primeiro ano da IA generativa. No entanto, a promoção da tecnologia está atrasada. Talvez o que a maioria das pessoas comuns possa perceber melhor é como a tecnologia que não parece nova, mas que se tornou mais popular nos últimos anos, afetou a vida diária.

Todos entendem que a tecnologia é uma faca de dois gumes. O Elevenlabs permite que pessoas com barreiras linguísticas falem, o HeyGen permite que o Swift sincronize os lábios em chinês sem tradução e a Miaoya Camera permite que as pessoas obtenham certificados refinados sem sair de casa. Acontece que existe não há certo ou errado entre o lado positivo e o lado negro da tecnologia, eles apenas existem objetivamente.

No entanto, para muitas pessoas de meia-idade e idosas, os smartphones e a Internet são incompreensíveis para eles, e agora a IA está novamente a causar problemas.

Na era da IA, texto, som, imagens e vídeos podem ser falsos ou até mesmo aparecer em combinação. As identidades forjadas dos golpistas são mais específicas e a fraude é mais direcionada e genuína, tornando as pessoas de meia-idade e idosos mais provavelmente será enganado.

Usar magia para combater magia e usar tecnologia para atacar e defender a tecnologia é um jogo de gato e rato que as pessoas de meia-idade e idosos podem não ser capazes de digerir rapidamente. Podemos começar pela natureza da fraude para reduzir a possibilidade de pessoas de meia-idade -pessoas idosas e idosas sendo enganadas.

Não importa como a tecnologia se desenvolva, muitos esquemas de fraude permanecem os mesmos: roubar privacidade, usar o medo, a ganância e o valor emocional para inventar histórias, fingir ser conhecidos ou empacotar-se para ganhar confiança, tendo o dinheiro como objetivo final.

Depois que o AI Fashion Pope saiu da indústria, um X (anteriormente Twitter) V com quase 13 milhões de fãs lamentou: “Achei que a jaqueta do Papa fosse real e não pensei muito sobre isso. o futuro da tecnologia."

Para pessoas de meia-idade e idosos, é mais difícil adaptar-se às regras de que ver não é necessariamente verdade e que as imagens não são necessariamente verdadeiras. Podemos mostrar-lhes alguns métodos simples, tradicionais, mas ainda eficazes.

Um tipo é ter cuidado e não confiar facilmente no conteúdo da Internet, não atender chamadas de assédio, não clicar em links desconhecidos e tentar não expor demais informações biométricas pessoais, como rostos, vozes, impressões digitais, etc. a Internet.

Especialmente quando você recebe ligações ou mensagens de texto suspeitas, não acredite cegamente em “palavras unilaterais”. Não importa quem seja a outra parte, ela tem múltiplas perspectivas quando se trata de dinheiro. Use vários métodos para verificar a identidade da outra parte. identidade. Se a outra parte disser que algo aconteceu com sua família, ligue novamente. Ligue para confirmar se isso é verdade.

O outro tipo é proativo e preparado. Pessoas de meia-idade e idosos têm seus próprios meios de comunicação preferidos. Seus familiares podem encaminhar conteúdo antifraude das contas oficiais do WeChat dos departamentos governamentais e de outras fontes para eles. Se as condições permitirem, você também pode mostrar às pessoas de meia-idade e idosos como usar ferramentas de IA, como o ChatGPT.

Claro, para os idosos que não entendem de smartphones, tente resolver o problema na fonte. É melhor não vincular os cartões bancários ao WeChat ou Alipay e economizar apenas uma pequena quantia de troco.

A fraude de IA bem-sucedida é apenas o resultado final, mas a prevenção da fraude de IA pode começar a qualquer momento.

A tecnologia deve servir a todos, liderar o caminho, iluminar o farol do mundo digital para aqueles que vierem depois de nós e explorar os recifes subaquáticos desconhecidos. Só então poderemos avançar em conjunto para um futuro onde a tecnologia não seja temida, mas usada racionalmente.

# Bem-vindo a seguir a conta pública oficial do WeChat de aifaner: aifaner (WeChat ID: ifanr).Mais conteúdo interessante será fornecido a você o mais rápido possível.