O vencedor do Prêmio Turing, de 65 anos, não precisa mais se reportar a um jovem de 28 anos que abandonou a faculdade; como Zuckerberg o afastou?

Aquele velho teimoso que esteve na vanguarda da tendência dos LLMs e que tinha uma visão diferente da realidade pode estar de saída da Meta.

É comum magnatas do Vale do Silício deixarem a empresa para abrir seus próprios negócios, mas Yann LeCun, que está prestes a partir, é diferente. Ele é uma figura de peso, capaz de receber visitas pessoais de Zuckerberg. É um dos três gigantes do aprendizado profundo, vencedor do Prêmio Turing e fundador da Meta AI Research.

Mais importante ainda, ele vem fazendo algo particularmente bizarro todos esses anos: ficando parado na entrada da rota de mestrado em direito mais movimentada do mundo, segurando uma placa e dizendo: "Essas pessoas pegaram o caminho errado".

O Financial Times acaba de noticiar que ele está deixando o emprego para abrir sua própria startup e já começou a contatar investidores. Observe que isso é apenas especulação; afirmar categoricamente que LeCun saiu para abrir seu próprio negócio é claramente impreciso.

No entanto, até o momento da publicação desta notícia, Yann LeCun não se pronunciou diante da avalanche de relatos, e esse silêncio por si só diz muito.

Das três visitas à cabana de palha de Zhuge Liang até a separação, o que exatamente aconteceu nesses doze anos?

Zuckerberg fez a aposta certa em 2013?

A história de Lecun e Meta começa em 2013.

Esse período coincidiu com o desenvolvimento explosivo do aprendizado profundo. Em 2012, Geoffrey Hinton e seus alunos Alex Krizhevsky e Ilya Sutskever, com a AlexNet, alcançaram uma notável taxa de erro top-5 de aproximadamente 15,3% na ILSVRC-2012, um avanço que fez com que toda a comunidade acadêmica e industrial percebesse o potencial das redes neurais.

Em seguida, veio a guerra por talentos entre as gigantes da tecnologia: o Google gastou uma fortuna para adquirir a startup de Hinton, a DNNresearch, e acabou contratando o próprio Hinton; a Microsoft Research também estava expandindo freneticamente sua equipe de IA.

Zuckerberg não conseguia mais ficar parado.

Naquela época, o Facebook (agora Meta) estava em transição da internet para computadores para a internet móvel, e a tecnologia era necessária em todos os lugares, desde algoritmos de notificação de notícias e reconhecimento de fotos até moderação de conteúdo.

O problema é que as capacidades de IA do Facebook simplesmente não estão no mesmo nível que as do Google ou da Microsoft. Zuckerberg precisa de alguém que consiga conduzir a empresa, idealmente um nome de peso no meio acadêmico com influência suficiente para atrair os melhores talentos.

Ele mirou em Yann LeCun.

Na época, LeCun era professor na Universidade de Nova York, onde trabalhava há mais de uma década. Ele certamente não era um novato; já em 1989, havia desenvolvido Redes Neurais Convolucionais (CNNs) nos Laboratórios Bell para reconhecer dígitos manuscritos, que mais tarde se tornaram a base da visão computacional.

Mas o aprendizado profundo não foi bem recebido naquela época, e LeCun ficou à margem por muito tempo, assistindo impotente à marginalização de sua pesquisa. Foi somente em 2012, quando Hinton venceu a competição ImageNet usando aprendizado profundo, que ele provou que a abordagem de redes neurais era viável.

LeCun finalmente conseguiu soltar o ar que estava prendendo.

Posteriormente, Zuckerberg o visitou pessoalmente. O conteúdo exato da conversa permanece desconhecido para quem está de fora, mas os termos que ele ofereceu foram bastante tentadores:

Primeiro, fornecer financiamento, enfatizando a liberdade de recursos; segundo, conceder liberdade de concessão, permitindo que LeCun mantenha sua cátedra na NYU e continue lecionando e conduzindo pesquisas; terceiro, conceder autoridade, permitindo que ele participe da criação do Instituto de Pesquisa em IA do Facebook, com controle total sobre o recrutamento e as linhas de pesquisa.

Essa foi uma oportunidade dos sonhos para um acadêmico que se sentia sufocado há muitos anos.

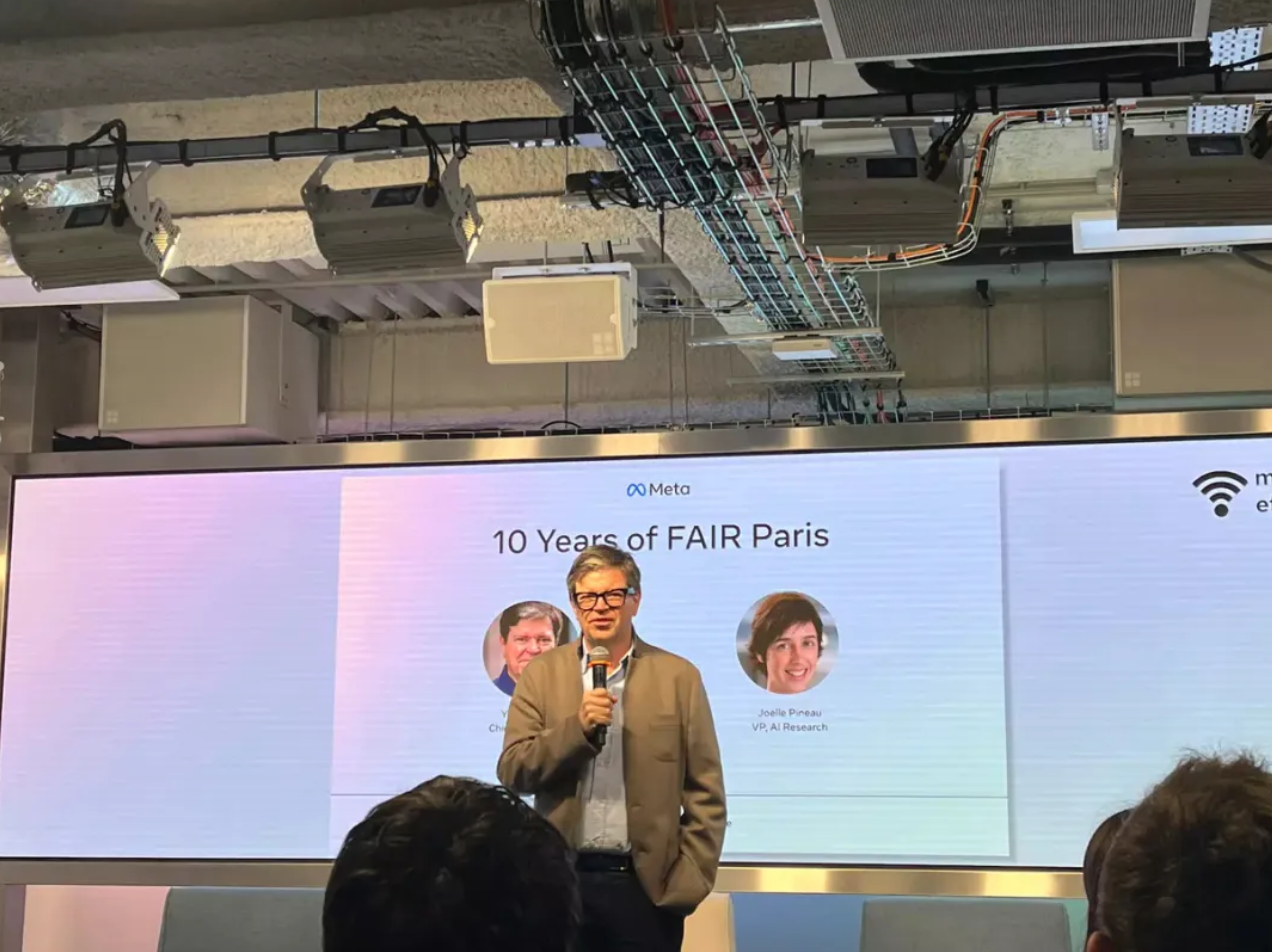

No final de 2013, LeCun ingressou oficialmente no Facebook como chefe do recém-criado laboratório de Pesquisa em IA do Facebook (FAIR).

Ele fundou os laboratórios FAIR em Nova York, Menlo Park e Londres, sendo seu escritório em Nova York sua residência permanente.

A equipe era inicialmente pequena, mas todos os membros foram recrutados das melhores universidades e instituições de pesquisa — a influência de LeCun era evidente naquela época, já que qualquer pessoa que trabalhe com aprendizado profundo conhece o título de "pai das redes neurais convolucionais".

Zuckerberg forneceu os recursos e LeCun entregou os resultados.

Desde que ingressou no Facebook, o trabalho de LeCun pode ser dividido em três linhas: primeiro, integrar o aprendizado profundo aos produtos do Facebook; segundo, promover pesquisas de ponta na academia; e terceiro, cultivar a próxima geração de talentos em IA.

Em sua linha de produtos, o sistema de reconhecimento facial DeepFace alcançou uma taxa de precisão de 97,35% em 2014, e o algoritmo push otimizado por aprendizado profundo também melhorou as taxas de cliques em anúncios.

Enquanto isso, LeCun continuou a deixar sua marca no meio acadêmico: publicando artigos, proferindo palestras em importantes conferências e ministrando workshops para estudantes. Foi somente ao compartilhar o Prêmio Turing com Hinton e Bengio que ele finalmente alcançou o reconhecimento merecido.

Além disso, no laboratório FAIR fundado por LeCun, Soumith Chintala liderou o desenvolvimento do framework PyTorch e o tornou de código aberto em 2017, sendo este um dos poucos recursos icônicos do Meta até hoje.

O grafo de computação dinâmico do PyTorch e a interface nativa em Python facilitam a depuração, o que levou a uma rápida mudança no apoio da comunidade acadêmica. Essa mudança efetivamente integrou pesquisadores de IA do mundo todo ao ecossistema do Facebook.

No entanto, talvez fosse o destino, Soumith também anunciou sua saída da Meta há alguns dias, dizendo que "não queria trabalhar com PyTorch pelo resto da vida".

Mais importante ainda, fomenta o desenvolvimento de talentos. O princípio FAIR tem uma regra: os pesquisadores têm liberdade para publicar artigos, colaborar com a comunidade acadêmica e orientar estudantes externos. Essa combinação de recursos de ponta e liberdade acadêmica atrai naturalmente um grupo de pesquisadores de alto nível.

Por volta de 2020, o FAIR havia se tornado uma das principais instituições de pesquisa em IA do mundo, figurando ao lado do DeepMind do Google no primeiro escalão. A aposta de Zuckerberg já havia rendido retornos consideráveis nos primeiros sete ou oito anos.

Gatos são mais inteligentes que o ChatGPT? Este vencedor do Prêmio Turing está falando sério.

Nos primórdios do domínio global do ChatGPT, Yann LeCun e Mark Zuckerberg também desfrutaram de um período de boa relação.

Desde 2023, a Meta tem disponibilizado o código aberto da sua série de modelos LLaMA, causando grande repercussão na indústria.

A OpenAI e o Google adotam uma abordagem fechada, lucrando com APIs; a Meta, por outro lado, disponibiliza os pesos do modelo diretamente, permitindo que qualquer pessoa os utilize. O cálculo por trás dessa estratégia é bastante claro: em vez de deixar um concorrente dominar o mercado, é melhor conquistar o ecossistema de desenvolvedores com código aberto, tornando o LLaMA o Android do mundo da IA.

Pelo menos à primeira vista, LeCun, que ocupa o cargo de Cientista-Chefe de IA na Meta, é o defensor mais firme dessa abordagem.

O projeto de código aberto LLaMA permitiu que a Meta ganhasse espaço em grandes competições de modelos e também possibilitou que os ideais de IA de LeCun fossem realizados até certo ponto — embora essa realização tenha sido alcançada pela via técnica do LLM, com a qual ele não concordava totalmente.

Exatamente, LeCun sempre achou que o LLM é um beco sem saída. Esse é o cerne do problema.

LeCun criticou publicamente a abordagem LLM em mais de uma ocasião. Em sua visão, o LLM apenas prevê a próxima palavra com base em correlação estatística e não possui qualquer compreensão do mundo. Se você lhe fizer uma pergunta de senso comum, ele pode inventar uma mentira perfeitamente plausível — isso se chama "alucinação", que é simplesmente fingir saber o que não sabe.

Quem conhece LeCun sabe que seus exemplos favoritos são gatos e robôs:

"Temos modelos de linguagem que conseguem fazer provas e conversar, mas onde estão os robôs para tarefas domésticas? Nem sequer vimos robôs tão ágeis quanto gatos."

"Seu gato definitivamente tem um modelo mais complexo do que qualquer sistema de IA. Os animais possuem um sistema de memória persistente que os atuais sistemas de aprendizado de máquina não têm; um sistema capaz de planejar sequências complexas de ações que são impossíveis nos sistemas de aprendizado de máquina de hoje."

Ele fez as contas: uma criança de quatro anos adquire 10 elevado à potência de 15 bytes de informação através da visão ao longo de vários anos, muito mais do que a quantidade de informação que uma Máquina de Aprendizagem Limitada (LLM) consegue obter lendo inúmeros textos da internet. No entanto, a criança já domina a intuição física básica e a linguagem; apesar da vasta quantidade de dados consumida pela LLM, sua inteligência permanece muito limitada.

"Simplesmente alimentar alguém com textos não levará a um nível de inteligência semelhante ao humano. Esse caminho nunca funcionará", disse ele.

Diante da tendência mais forte do momento, essas opiniões divergentes são claramente impopulares. Alguns o criticam por arrogância, enquanto outros dizem que ele é inflexível. Mesmo dentro da Meta, há quem sugira que foi a resistência de LeCun à abordagem LLM que fez com que a empresa ficasse temporariamente para trás na competição de modelos de grande porte.

Mas LeCun não se importou.

Ele tem seu próprio roteiro: Modelo Mundial, Arquitetura Conjunta de Predição Incorporada (JEPA) e assim por diante. Esses conceitos soam muito acadêmicos, mas as ideias centrais são, na verdade, bastante intuitivas.

Deixe a IA aprender observando o mundo, em vez de memorizando textos. Assim como no desenvolvimento de um bebê, ela deve primeiro compreender conceitos físicos básicos, como gravidade e causalidade, e depois construir gradualmente a cognição abstrata.

A arquitetura de IA idealizada por ele é modular: um módulo de percepção, um módulo de modelo do mundo, um módulo de memória e um módulo de ação, cada um com sua própria função. Diferentemente do LLM, que concentra todo o conhecimento e raciocínio em uma rede gigante, fazendo-o parecer um "nerd" que sabe tudo, mas na verdade não sabe nada.

Especificamente, um modelo do mundo consiste em permitir que a IA aprenda internamente um modelo preditivo do mundo externo. Assim como um bebê desenvolve o senso comum sobre a gravidade e a permanência dos objetos à medida que cresce, a IA deve formar uma compreensão das leis da física e das relações causais observando o mundo.

Com um modelo do mundo, a IA pode simular o futuro mentalmente, adquirindo assim a capacidade de planejar ações.

JEPA é a arquitetura específica para concretizar esse modelo mundial.

Utiliza uma abordagem de aprendizado autossupervisionado, fornecendo à IA duas entradas relacionadas (como dois frames adjacentes em um vídeo), e o modelo codifica essas duas entradas em um espaço de representação abstrato. Em seguida, treina um preditor para prever a representação alvo com base na representação contextual.

Essa abordagem evita gerar todos os detalhes diretamente, concentrando-se, em vez disso, em fatores abstratos essenciais — o que está mais alinhado com os métodos de aprendizagem humana. LeCun previu que, se o trabalho da equipe progredir sem problemas, um paradigma melhor surgirá dentro de três a cinco anos, tornando obsoleta a abordagem atual baseada em LLM.

A questão é: a Meta pode se dar ao luxo de esperar de três a cinco anos?

Uma reestruturação repentina pôs fim à era de ouro das feiras.

Quando LeCun fundou a FAIR, sua promessa foi "realizar pesquisas fundamentais de longo prazo em IA", e Zuckerberg concordou.

Mas quanto tempo exatamente é esse "longo prazo"? Que benefício direto a "pesquisa básica" pode trazer para a empresa? Essas questões não são problemas nos estágios iniciais, porque o aprendizado profundo em si é uma tendência em alta, e tudo o que a FAIR fizer deverá se transformar em uma vantagem competitiva.

No entanto, com o surgimento da IA generativa, a competição se intensificou e a situação começou a mudar. Em particular, o fracasso do Llama 4 representou um duro golpe para Zuckerberg. O que Zuckerberg queria era tecnologia que pudesse ser usada agora, não ideias que talvez fossem úteis daqui a cinco anos.

Assim, ocorreu uma reestruturação inesperada.

Este ano, a Meta deu um grande passo ao estabelecer o "Laboratório de Superinteligência", reunindo a FAIR, a equipe de modelos básicos e várias equipes de IA aplicadas em um só lugar. Superficialmente, trata-se de integrar recursos, mas, na realidade, é uma reestruturação completa de poder.

A lógica central dessa reestruturação é clara: fazer com que a pesquisa sirva diretamente aos produtos e que os cientistas cedam espaço a objetivos comerciais.

A equipe FAIR, que antes conduzia pesquisas "relativamente sem interferências", agora precisa acompanhar o ritmo do produto, com linhas de pesquisa voltadas para o desenvolvimento de assistentes pessoais de IA. Além disso, a Meta implementou um processo de revisão interna mais rigoroso para as publicações de pesquisa da FAIR.

Antes de publicarem artigos ou código aberto, os pesquisadores precisam passar por revisões internas adicionais e aprovações da gerência, pois a Meta teme que seus resultados, conquistados com muito esforço, sejam explorados por concorrentes.

LeCun resistiu fortemente a essas mudanças.

Segundo diversos relatos, ele se opôs veementemente ao novo sistema de revisão por pares internamente, defendendo a liberdade de pesquisa. O jornal The Information, citando fontes familiarizadas com o assunto, noticiou que LeCun ficou "tão irritado que considerou renunciar" em setembro deste ano em protesto.

Mas talvez o que ele tenha achado ainda mais difícil de aceitar foi a perda da liderança.

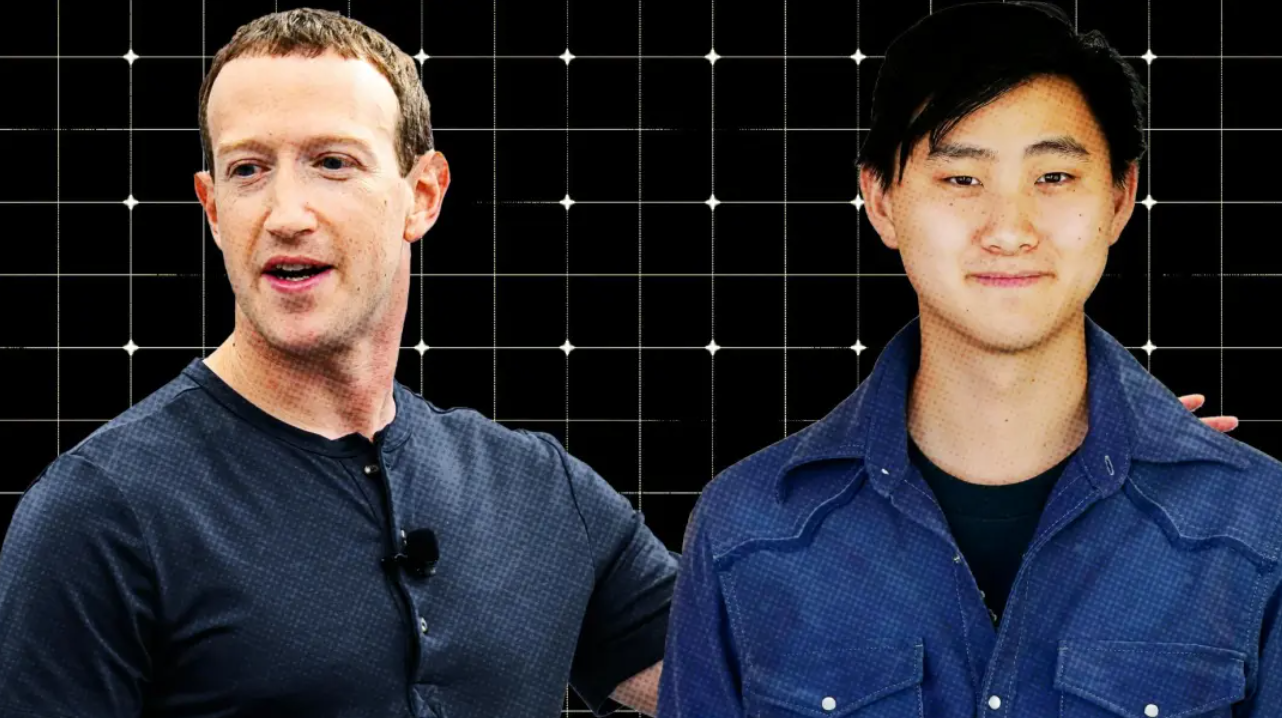

Durante a reestruturação, Zuckerberg fez uma contratação ousada: trouxe Alexandr Wang de fora e o nomeou Diretor de IA da Meta, reportando-se diretamente ao CEO.

Quem é Alexandr Wang? Um jovem de 28 anos que abandonou o MIT e fundou a Scale AI, uma empresa especializada em rotulagem de dados, fornecendo dados de treinamento para modelos de IA de grandes empresas de tecnologia.

O que Zuckerberg valorizava era justamente o pensamento estratégico de produto e a perspicácia comercial de Wang. Na corrida pela IA generativa, a Meta não precisa de idealistas em torres de marfim, mas sim de pragmáticos que consigam transformar rapidamente a tecnologia em produtos.

O choque desta nomeação reside no facto de LeCun, vencedor do Prémio Turing, um dos três gigantes da aprendizagem profunda e cientista-chefe de IA na Meta durante doze anos, ter tido a sua voz significativamente enfraquecida sob a nova arquitetura, tendo mesmo de se reportar a Wang.

Em julho deste ano, Zuckerberg também nomeou o jovem e promissor Zhao Shengjia como cientista-chefe de IA do Laboratório de Superinteligência, responsável por definir a direção da pesquisa do novo laboratório.

Curiosamente, LeCun divulgou um comunicado na época afirmando que seu papel e missão permaneciam inalterados e que ele estava ansioso para trabalhar com a nova equipe. Seus instintos de sobrevivência certamente estavam à flor da pele. No entanto, suas divergências em relação à direção da pesquisa e à reestruturação da liderança eram claramente um segredo aberto.

O que pode ter sido a gota d'água foram as recentes demissões. Relatos indicam que a Meta demitiu sua equipe de IA, afetando o departamento de pesquisa FAIR e as equipes de IA relacionadas a produtos, chegando a atingir a figura proeminente chinesa Tian Yuandong.

O sinal das demissões é claro: a Meta não está mais disposta a pagar por pesquisa básica que "não apresente retorno a curto prazo". Linhas de pesquisa que não podem ser diretamente traduzidas em funcionalidades de produto, nem podem impulsionar imediatamente o crescimento de usuários ou a receita publicitária, tornaram-se alvos de eliminação.

A era de ouro das feiras chegou ao fim.

Considerando todos esses fatores, não é de todo inesperado que o Financial Times tenha revelado que ele estava se preparando para abrir um negócio.

Nos últimos anos, tornou-se comum no Vale do Silício que acadêmicos renomados sigam carreira solo. Hinton tem proferido palestras e defendido a regulamentação da IA desde sua aposentadoria, e Bengio possui seu próprio laboratório e projetos de startups. Se LeCun realmente decidir abrir seu próprio negócio, isso pode ser algo positivo. No fim das contas, não há certo ou errado nessa questão.

LeCun pôde dar continuidade ao trabalho de sua vida fora da Meta.

Ele levou consigo a visão que a Meta havia "arquivado", o que o libertou para desenvolver seu próprio modelo de mundo, prová-lo correto à sua maneira e não precisar mais discutir com gerentes de produto ou prestar contas a seu colega júnior de 28 anos.

Se der certo, então será "Eu já te disse há muito tempo que o LLM é um beco sem saída"; se falhar, no máximo as pessoas vão rir de você, dizendo: "Olha só esse velho teimoso".

Para a Meta, Zuckerberg precisa contar uma história aos acionistas e incorporar a IA generativa mais prática em todos os aspectos de seus produtos, que é de fato o que um CEO deve fazer.

Contudo, embora a ausência de LeCun não seja um grande golpe, pode significar menos vozes dissidentes. Talvez um dia, quando as pessoas perceberem que o movimento LLM realmente chegou ao seu limite, relembrar o que aquele velho teimoso segurando seu cartaz de oposição disse seja bastante interessante.

#Siga a conta oficial do iFanr no WeChat: iFanr (ID do WeChat: ifanr), onde você encontrará conteúdo ainda mais interessante o mais breve possível.