O primeiro jogo multijogador de IA do mundo está aqui! Seu computador antigo também pode jogar Em anexo está o endereço de download

Jogar jogos de IA não é novidade; Jogos de programação de IA também não são novidade.

Mas usar IA para construir um mundo de jogo que suporte interação em tempo real entre duas pessoas, perspectivas consistentes e sincronização lógica? Isso aconteceu pela primeira vez hoje.

A equipe israelense Enigma Labs anunciou hoje o lançamento do primeiro jogo multijogador gerado por IA do mundo – Multiverse na plataforma X. O nome parece ter sido produzido pela Marvel, e a jogabilidade é de fato ficção científica.

Derivações e travamentos são todos sincronizados, as operações respondem umas às outras e os detalhes podem corresponder à taxa de quadros.

Tudo no jogo não é mais controlado por scripts predefinidos ou motores físicos, mas é gerado em tempo real por um modelo de IA, garantindo que ambos os jogadores vejam o mesmo mundo logicamente unificado.

Além disso, o Multiverse é totalmente de código aberto: código, modelos, dados e documentos estão disponíveis no GitHub e no Hugging Face. Você pode até executá-lo diretamente no seu computador.

O CEO da Hugging Face, Clément Delangue, também fez uma ligação online na plataforma X:

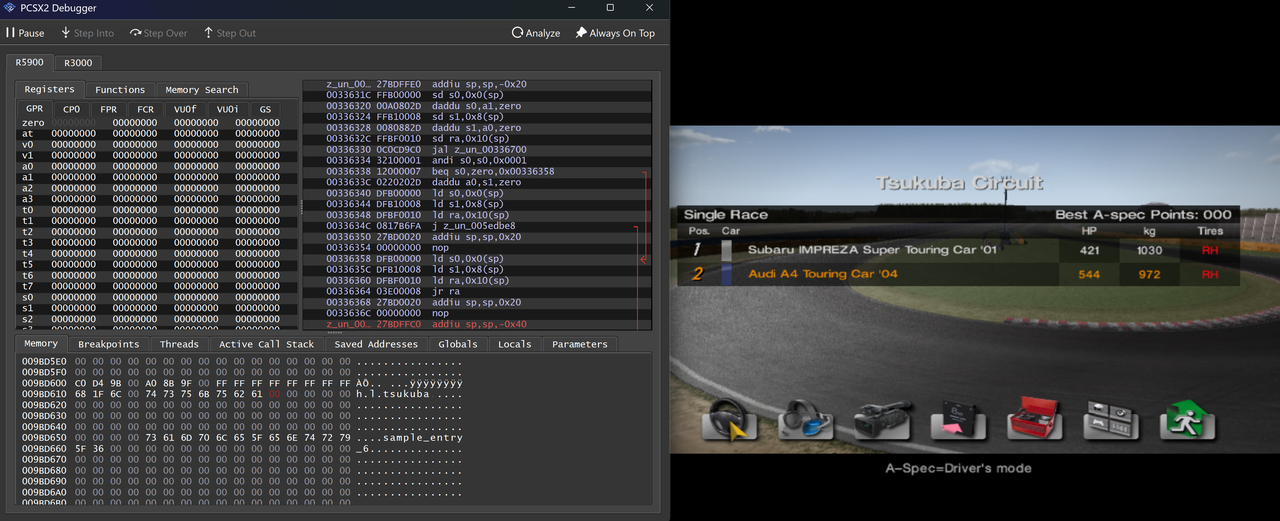

Este é o conjunto de dados mais legal que vi no Hugging Face hoje: rótulos de ação para corridas 1v1 no Gran Turismo 4, usados para treinar um modelo de mundo multijogador

Os veículos mudam constantemente de posição na pista, ultrapassando, derrapando, acelerando e depois retornando em um determinado trecho.

Então, do que se trata esse modelo chamado Multiverso? A equipe técnica oficial compartilhou mais detalhes da construção em um blog técnico.

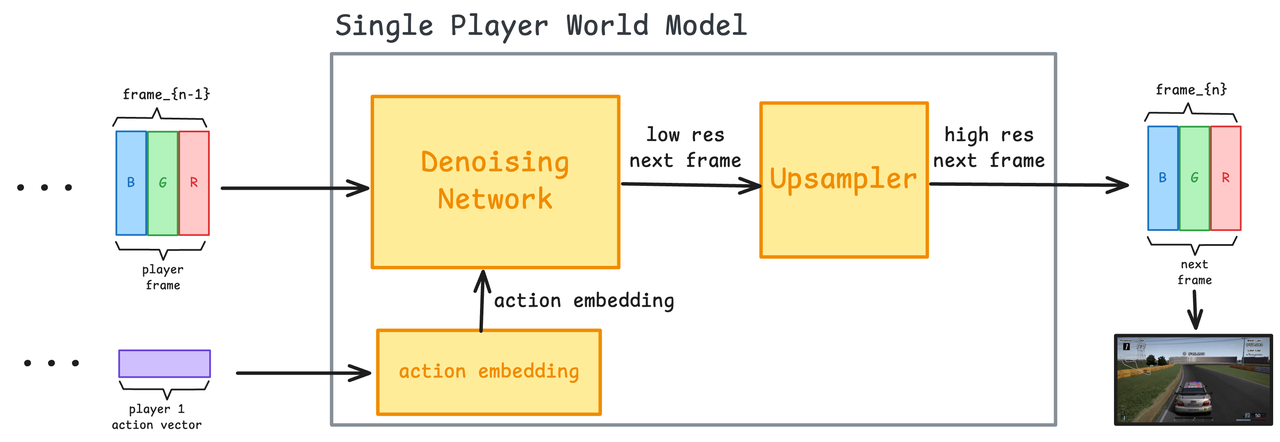

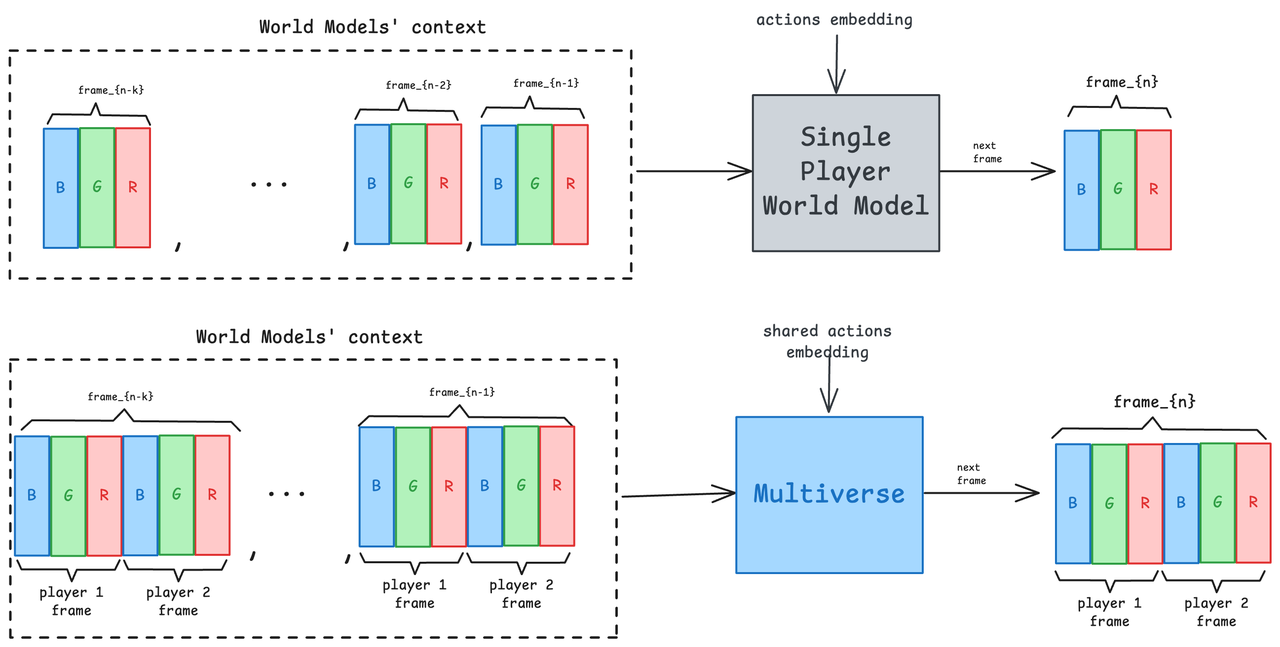

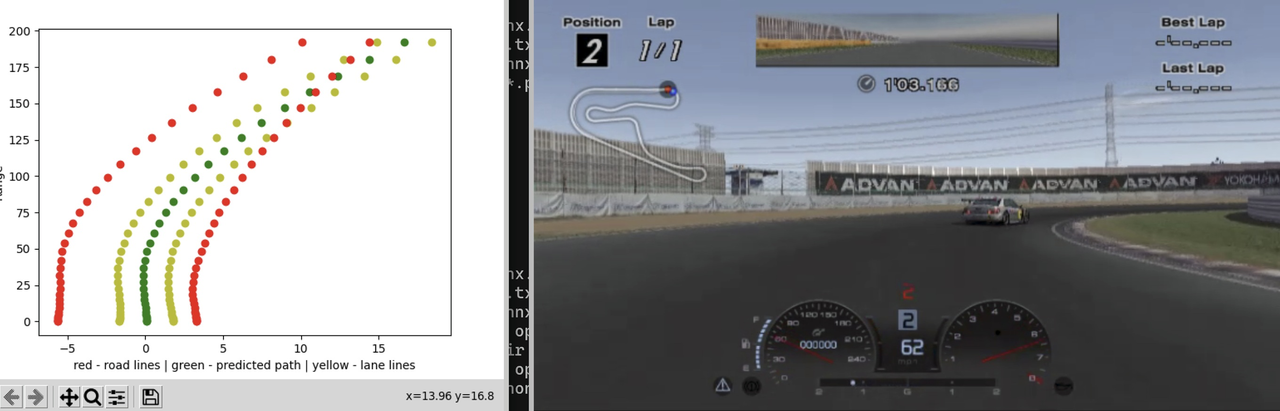

Antes disso, temos que apresentar o modelo tradicional do mundo da IA: você o opera e ele prevê como a imagem precisa ser gerada. O modelo analisa suas operações, analisa os quadros anteriores e, em seguida, gera o próximo quadro. O princípio não é difícil de entender:

- Incorporador de ação: converta as operações do jogador (como a tecla que você pressionou) em vetores de incorporação

- Rede de eliminação de ruído: Use um modelo de difusão para prever o próximo quadro combinando operações e quadros anteriores.

- Upsampler (opcional): melhora a resolução e detalhes das imagens geradas

Mas uma vez introduzido um segundo jogador, o problema torna-se complicado.

O bug mais típico é que o carro do seu lado acaba de bater no guardrail, mas o lado do oponente ainda está em alta velocidade; você joga para fora da pista, mas o oponente nem vê onde você está. Toda a experiência de jogo é como dois frames presos e fora de sincronia.

Multiverse é o primeiro modelo mundial de IA que pode sincronizar as perspectivas de dois jogadores. Não importa o que aconteça com qualquer jogador, a outra pessoa pode ver em sua própria tela em tempo real, sem demora ou conflito lógico.

Isso também é algo que foi difícil de conseguir em simulações de IA no passado: consistência multivisualização.

Para resolver este problema e construir um modelo de mundo multijogador verdadeiramente colaborativo, a equipe do Multiverse surgiu com uma solução muito inteligente. Eles mantiveram os componentes principais e, ao mesmo tempo, destruíram e reconstruíram completamente a ideia original de “previsão individual”:

- Incorporador de ações: recebe as ações de dois jogadores e gera um vetor de incorporação que integra as operações de ambas as partes;

- Rede Denoising: Rede de difusão, que gera imagens de dois jogadores ao mesmo tempo para garantir que sejam consistentes como um todo;

- Upsampler: Semelhante ao modo single player, mas processa e aprimora a filmagem para ambos os jogadores simultaneamente.

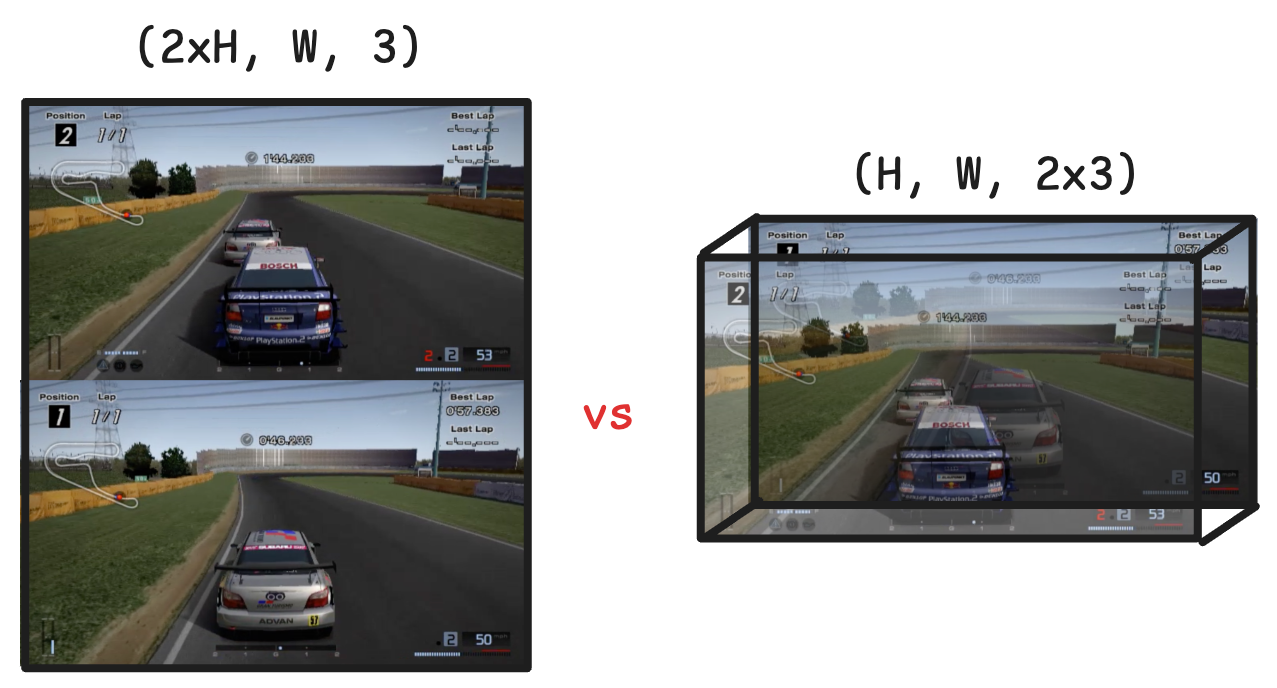

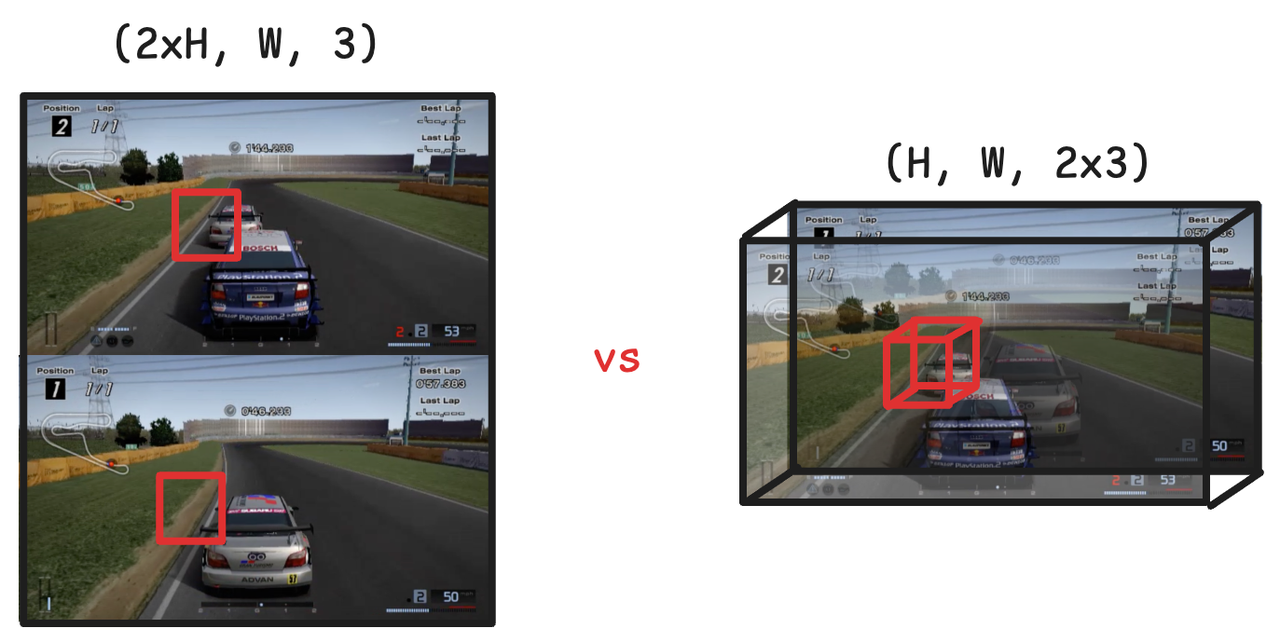

Originalmente, ao lidar com uma imagem de duas pessoas, a primeira reação de muitas pessoas era dividir a tela: separar as duas imagens e gerá-las separadamente.

Esta ideia é simples e grosseira, mas é difícil de sincronizar, consome recursos e tem efeitos fracos. No entanto, eles pensaram em "unir" as perspectivas dos dois jogadores em uma imagem, fundindo suas contribuições em um vetor de ação unificado e tratando o todo como uma "cena unificada".

O método específico é o empilhamento do eixo do canal: tratar as duas imagens como uma imagem com o dobro dos canais de cores.

Essa coisa parece pequena, mas na verdade é muito inteligente tecnicamente. Como o modelo de difusão usa a arquitetura U-Net, o núcleo é a convolução e a desconvolução, e a rede neural convolucional tem uma forte consciência estrutural da dimensão do canal.

Em outras palavras, não se trata de colar dois mundos, mas de permitir que o modelo saiba pela “camada inferior do neurônio” que as duas imagens estão relacionadas e devem ser geradas colaborativamente. A imagem final não precisa ser alinhada manualmente, ela é sincronizada naturalmente.

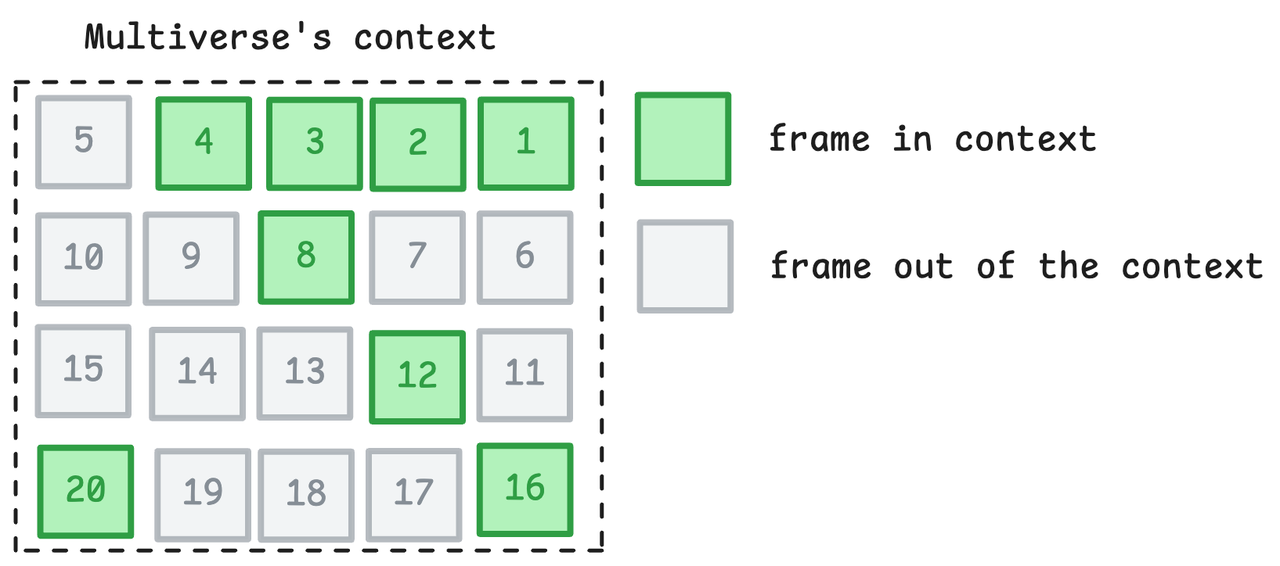

Mas para que o modelo preveja com precisão o próximo quadro, uma coisa deve ser entendida: a velocidade e a posição relativa do veículo são dinâmicas e informações suficientes devem estar disponíveis para uma previsão precisa. Eles descobriram que 8 quadros (a 30 fps) são suficientes para aprender recursos cinemáticos como aceleração, frenagem e direção.

Mas o problema é: a velocidade relativa, como a ultrapassagem, é muito mais lenta do que a velocidade absoluta (cerca de 100 km/h vs 5 km/h). Se o número do quadro estiver muito próximo, o modelo não poderá perceber a mudança.

Então eles criaram uma solução de compromisso – amostragem esparsa:

- Fornece os últimos 4 frames consecutivos (garantindo resposta imediata);

- Fornece 4 quadros adicionais de imagens históricas "amostradas a cada 4 quadros";

- O quadro mais antigo está a 20 quadros do quadro atual, que é cerca de 0,666 segundos atrás.

Para permitir verdadeiramente que o modelo compreenda a “condução cooperativa”, não pode basear-se apenas nestes dados de entrada, mas também requer formação intensiva em comportamentos interactivos.

As tarefas tradicionais para um jogador (como caminhar, atirar) exigem previsão apenas por um curto período de tempo, como 0,25 segundos. No entanto, sob a interação de várias pessoas, uma mudança tão pequena no tempo é mínima e não reflete de forma alguma o “senso de trabalho em equipe”.

A solução do Multiverse é simplesmente deixar o modelo prever uma sequência comportamental de até 15 segundos para capturar a lógica de interação multi-rodada de longo prazo.

O método de treinamento não consiste apenas em 15 segundos por vez, mas usa uma estratégia de “aprendizado curricular”: começando com 0,25 segundos de previsão e estendendo-o gradualmente até 15 segundos. Dessa forma, o modelo primeiro aprende recursos de baixo nível, como estrutura do carro e geometria da pista, e depois domina lentamente conceitos de alto nível, como estratégias de jogadores e dinâmica de jogo.

Após o treinamento, o desempenho do modelo em termos de persistência de objetos e consistência entre quadros foi significativamente melhorado. Em suma, o carro não desaparecerá repentinamente, nem a lógica entrará em colapso.

Esse excelente desempenho de treinamento é atribuído ao conjunto de dados cuidadosamente selecionados por trás dele. É isso mesmo, é a obra-prima do jogo de simulação de corrida do PS2 de 2004: Gran Turismo 4.

Claro, para evitar responsabilidades, a equipe do Multiverse não se esqueceu de brincar que são fãs obstinados da Sony.

A cena de teste foi uma corrida 1 contra 1 no circuito de Tsukuba, mas o problema é que GT4 não suporta nativamente "replay de perspectiva 1v1". Então eles fizeram a engenharia reversa e transformaram o jogo em um modo 1v1 real.

então:

- Grave cada jogo duas vezes, uma para ver a si mesmo e outra para ver seu oponente;

- Em seguida, através do processamento de sincronização, ele é mesclado em um vídeo completo, mostrando a batalha em tempo real entre os dois lados.

E os dados principais? Afinal, o jogo em si não fornece logs de operação.

A resposta é que eles usam as informações exibidas pelo HUD do jogo (acelerador, freio, barras indicadoras do volante), usam a visão computacional para extrair as barras de aceleração, freio e direção exibidas na tela do jogo quadro a quadro e, em seguida, derivam as instruções de controle.

Em outras palavras, a operação pode ser restaurada apenas com base nas informações da tela, sem a necessidade de arquivos de log adicionais.

Claro, este processo é ineficiente e é impossível gravar manualmente cada jogo duas vezes.

Eles descobriram que o GT4 possui um recurso oculto chamado modo B-Spec, que permite que a IA dirija sozinha. Então escrevi um script para enviar instruções aleatórias para a IA, permitindo que ela corresse e travasse sozinha, gerando assim conjuntos de dados em lotes.

A propósito, eles também tentaram usar o modelo de direção autônoma do OpenPilot para controlar os personagens do jogo. Embora o efeito tenha sido bom, em termos de eficiência e estabilidade, o B-Spec é mais adequado para treinamentos em larga escala.

Aqui está o ponto chave: falar sobre efeitos sem falar sobre custos é naturalmente um hooliganismo.

Esse modelo de IA que pode executar mundos com múltiplas visualizações, sincronizar imagens e estabilizar resultados, incluindo modelo, treinamento, dados e inferência, custa apenas US$ 1.500, o que é quase o mesmo que comprar uma placa gráfica de última geração.

O funcionário do Multiverse, Jonathan Jacobi, postou no X:

Construímos o Multiverse com apenas US$ 1.500. A chave não é o poder computacional, mas a inovação tecnológica.

Mais importante ainda, Jacobi acredita que o modelo de mundo multijogador não é apenas uma nova forma de a IA jogar, mas também o próximo passo na tecnologia de simulação. Ele desbloqueia um mundo totalmente novo: um ambiente dinâmico co-evoluído e moldado por jogadores, agentes e robôs.

No futuro, o modelo mundial pode ser como uma versão virtual da sociedade real: você e a IA coexistem nele, formando um “universo dinâmico” altamente realista que também possui uma lógica de interação complexa próxima da sociedade real.

Então, isso parece um pouco animado para você?

Em anexo está o endereço de referência:

GitHub: https://github.com/EnigmaLabsAI/multiverse

Conjunto de dados Hugging Face: https://huggingface.co/datasets/Enigma-AI/multiplayer-racing-low-res

Modelo Abraçando Face: https://huggingface.co/Enigma-AI/multiverse

Blog oficial: https://enigma-labs.io/blog

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (WeChat ID: ifanr). Conteúdo mais interessante será fornecido a você o mais rápido possível.