Use IA para copiar sua personalidade em duas horas

Esta é uma era em que a IA pode ser usada para copiar “tudo”: desde a sua voz, aparência e estilo de expressão, até alguns dos seus pensamentos ou decisões. Agora, a IA pode até replicar sua “personalidade” e fazê-lo com bastante precisão.

Recentemente, um novo artigo publicado por pesquisadores da Universidade de Stanford e do Google DeepMind mostra que eles usaram IA para criar uma réplica virtual “ com atitudes e comportamentos individuais ”.

Os pesquisadores o chamam de “agente de computação universal”. O que foi usado para treinar esses “agentes” foi apenas uma entrevista de duas horas .

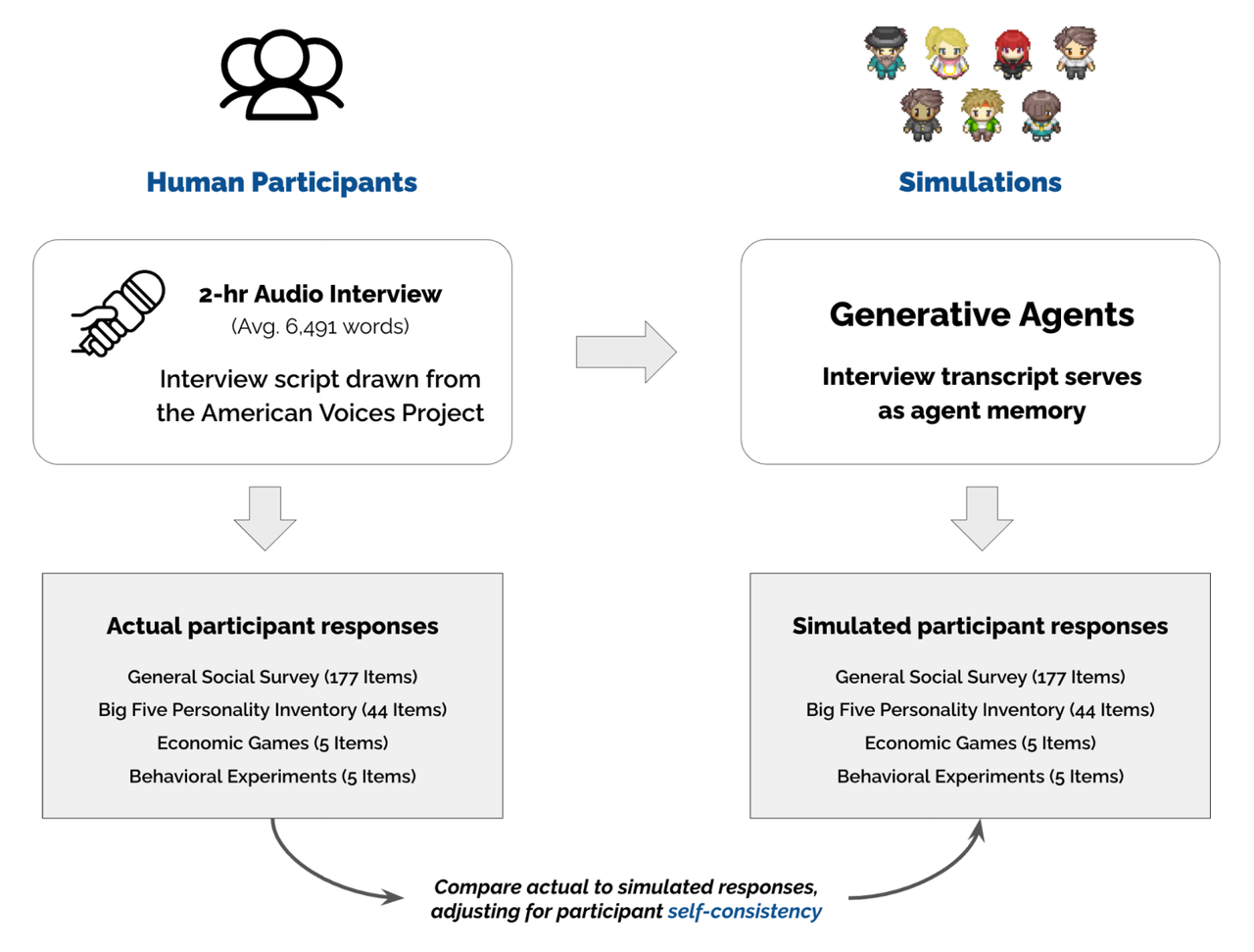

▲ Fonte da imagem: arXiv

A pesquisa foi liderada por Joon Sung Park, estudante de doutorado na Universidade de Stanford. Os investigadores trabalharam com uma empresa de recrutamento e utilizaram amostragem estratificada para recrutar 1.052 participantes, cada um dos quais completou uma entrevista áudio de duas horas em inglês.

Os pesquisadores escolheram um protocolo de entrevista desenvolvido por sociólogos que incluía histórias de vida pessoal e perspectivas sobre questões sociais contemporâneas. Para quantificar ainda mais a quantidade de conteúdo das entrevistas e controlar as variáveis experimentais, os pesquisadores limitaram o número de palavras nas respostas de cada sujeito a aproximadamente 6.491 palavras.

Vale ressaltar que o entrevistador da entrevista também é interpretado pela IA. Dentro do quadro geral e dos limites de tempo da conversa, estes “entrevistadores de inteligência artificial” irão gerar dinamicamente perguntas de acompanhamento com base nas respostas de cada participante.

Essas respostas são então usadas para treinar o modelo generativo de IA de cada indivíduo, um “agente simulado”.

Para verificar a capacidade destes “agentes” imitarem personalidades humanas, tanto os participantes como os agentes de IA foram convidados a completar uma série de testes, incluindo um teste de personalidade, um Inquérito Social Geral, cinco experiências de ciências sociais, cinco jogos bem conhecidos de economia comportamental. e muito mais.

Entre eles cinco experimentos de ciências sociais são um critério comum usado para avaliar se os agentes generativos podem simular as respostas comportamentais de participantes humanos publicados no Proceedings of the National Academy of Sciences cinco jogos de economia comportamental bem conhecidos incluem Dictator Game Prisoner's Dilemma; etc.

Duas semanas depois, os participantes precisam “recontar” as respostas do teste acima e usar o conteúdo da recontagem para comparar e analisar as respostas geradas pelo “agente”. Os resultados mostraram que o agente de IA foi capaz de simular as respostas dos participantes com 85% de precisão, ao mesmo tempo que teve um bom desempenho na previsão de traços de personalidade e resultados em cinco experimentos de ciências sociais .

▲Fonte da imagem: Associação Juvenil de Hong Kong

Embora a “personalidade” de uma pessoa pareça impossível de quantificar, este estudo mostra que a inteligência artificial é de facto boa a “ ver o grande a partir do pequeno ” – pode inferir e clonar com precisão a “personalidade” de uma pessoa através de uma quantidade relativamente pequena de informação.

Os prós e os contras desta “agência” são bastante óbvios. O benefício é que proporciona aos estudiosos das ciências sociais mais liberdade em suas pesquisas.

Ao criar réplicas digitais que se comportam como indivíduos reais, os cientistas podem usar diretamente “agentes” para conduzir experimentos ou pesquisas sem ter que recrutar um grande número de voluntários a cada vez. Além disso, esses “agentes” também podem ser usados para conduzir alguns experimentos “controversos” sobre ética moral.

John Horton, professor associado de tecnologia da informação na Sloan School of Management do MIT, disse em uma entrevista que a pesquisa “usa humanos reais para gerar personas e depois usa essas personas de maneira programática/simulada., e isso é algo que humanos reais não pode fazer."

▲Fonte: TechRadar

A desvantagem é que este tipo de “agente” será inevitavelmente utilizado por algumas pessoas com segundas intenções para “falsificação de identidade” e, em última análise, para “fraude”.

O que é ainda mais preocupante é que o “agente” adquiriu pensamentos e “consciência” humanos, em certo sentido, e pode até expressar opiniões em seu nome. Dr. Park Juncheng prevê que um dia haverá um grupo de pequenas versões de “você” correndo por aí e realmente tomando as decisões que você tomaria.

Na verdade, “agente de IA” não é um termo na vanguarda da tecnologia. Antes disso, existia um conceito semelhante de “gêmeo digital”. Porém, o “agente” precisa apenas de uma quantidade tão pequena de informações para reproduzir com precisão a “personalidade” de uma pessoa. É isso que requer atenção e vigilância.

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (WeChat ID: ifanr). Mais conteúdo interessante será fornecido a você o mais rápido possível.