Superando Sora em todos os aspectos, qual é a força do mais recente modelo de vídeo de IA da Meta?

Nos últimos dois dias, o campo dos modelos de geração de vídeo explodiu novamente devido ao lançamento do Meta Movie Gen.

Os pontos mais lamentados dentro e fora da indústria nada mais são do que dois pontos. Primeiro, o efeito de geração é natural e realista, podendo também gerar simultaneamente sons que combinam com a imagem. lançamento do Sora naquele momento; em segundo lugar, o novo modelo do Meta AI automaticamente É altamente definível, e tanto a proporção da tela de vídeo quanto os elementos e detalhes do vídeo podem ser ajustados de acordo com as necessidades do usuário.

Então, quais são os detalhes do Meta Movie Gen, que pode liderar uma nova revolução na geração de vídeo? Como são alcançados esses efeitos impressionantes no site oficial e nos vídeos de demonstração? Andrew Brown, chefe de modelo de vídeo da Meta AI, explicou especificamente a tecnologia teórica do Meta Movie Gen:

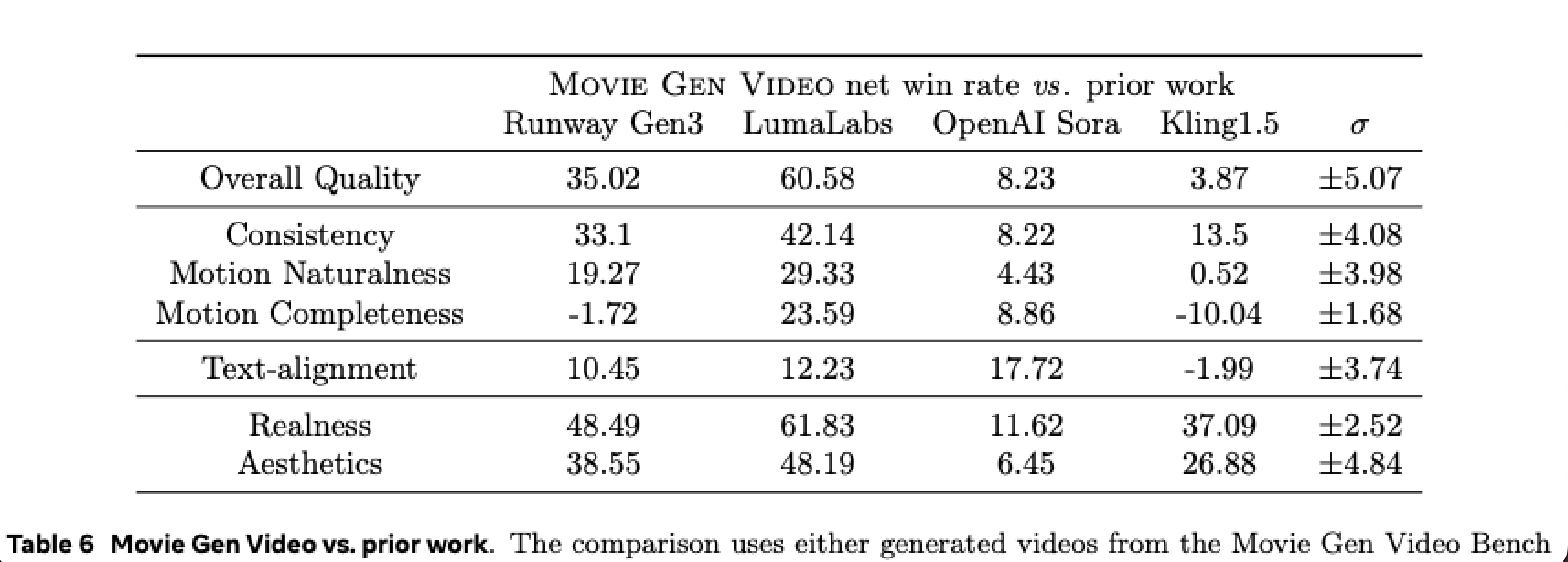

- Movie Gen é significativamente melhor que Sora em termos de qualidade e consistência geral. A autenticidade e a beleza testam o realismo fotográfico, e o Movie Gen vence em todos os aspectos.

- Meta Movie Gen é um conjunto de modelos que podem gerar texto para vídeo, geração de texto para imagem, personalização, edição e geração de vídeo para áudio.

- É importante estender os dados, a computação e os parâmetros do modelo, combinar isso com a correspondência de fluxo e passar para uma arquitetura LLM comum simples (Llama), alcançando assim a qualidade de geração de vídeo SOTA.

- Nós (Meta AI) somos os primeiros a usar o arco Llama para geração de mídia.

- Movie Gen é um conversor paramétrico de 30B que gera vídeo 1080p com diferentes proporções e áudio sincronizado, com duração máxima de 16 segundos (16fps).

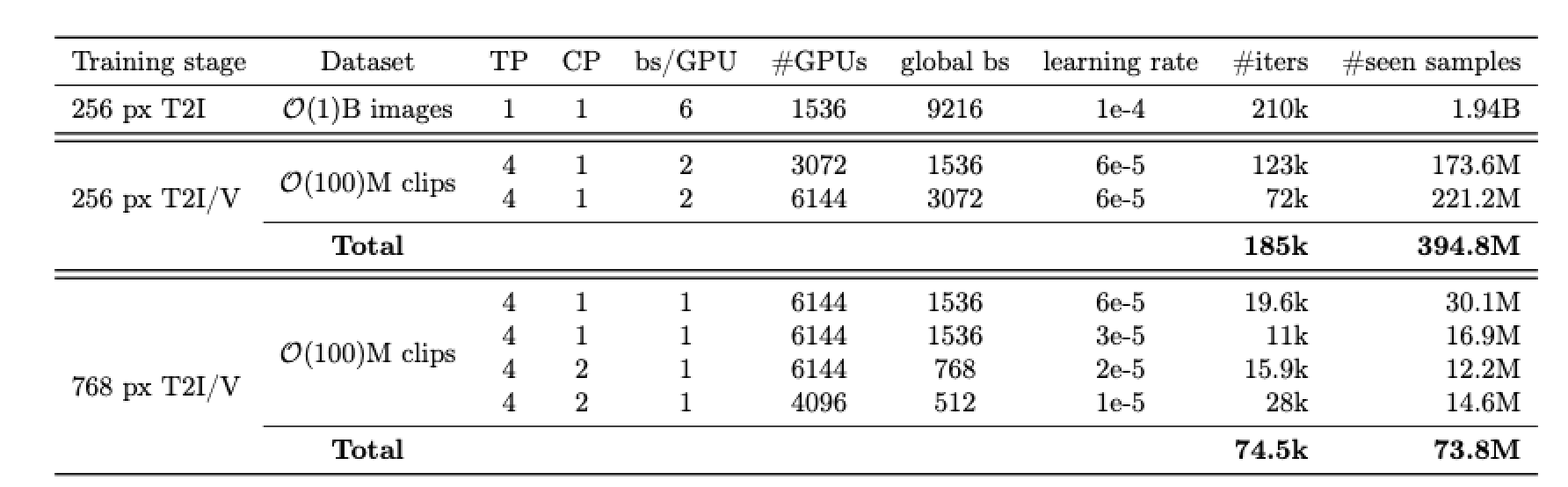

- Nós (Meta) fornecemos uma solução de treinamento em vários estágios para o modelo T2V. Treinamento conjunto T2I + T2V, resultando em convergência muito mais lenta e pior qualidade.

- A avaliação de texto para vídeo é difícil. As métricas automatizadas são muito pobres e não se correlacionam bem com as avaliações humanas.

“Superindividual” gerado por vídeo

No dia do lançamento do Meta Movie Gen, a APPSO relatou e interpretou imediatamente este último modelo de geração de vídeo. De modo geral, o Movie Gen tem quatro funções: geração de vídeo, geração de vídeo personalizada, edição precisa e geração de áudio.

Vejamos primeiro a geração de vídeo mais básica do Movie Gen Video. A capacidade multimodal torna o novo modelo capaz de uma variedade de métodos de entrada diferentes. Os usuários podem não apenas gerar vídeos correspondentes por meio de texto simples e algumas palavras de prompt, mas também diretamente. processe o necessário Coloque as imagens no modelo e transforme as imagens estáticas em vídeos dinâmicos de acordo com os requisitos do texto.

▲ Texto de solicitação: Uma menina está correndo na praia, segurando uma pipa na mão; ela está vestindo shorts jeans e uma camiseta amarela;

Você pode até pedir ao Movie Gen para ajudar a regenerar ou otimizar um vídeo. Não importa o método de entrada escolhido, o vídeo de demonstração atual do Movie Gen no site oficial é muito eficaz. Os personagens têm expressões naturais e os detalhes da imagem estão no lugar. Ele também pode gerar resultados correspondentes de acordo com as palavras solicitadas ou os requisitos do texto. com mais precisão.

Andrew Brown apresentou que no processo de geração de vídeo, é muito importante expandir dados, cálculos e parâmetros de modelo, combiná-los com correspondência de fluxo e recorrer a uma arquitetura LLM simples e comumente usada (Llama), alcançando assim qualidade de geração de vídeo SOTA .

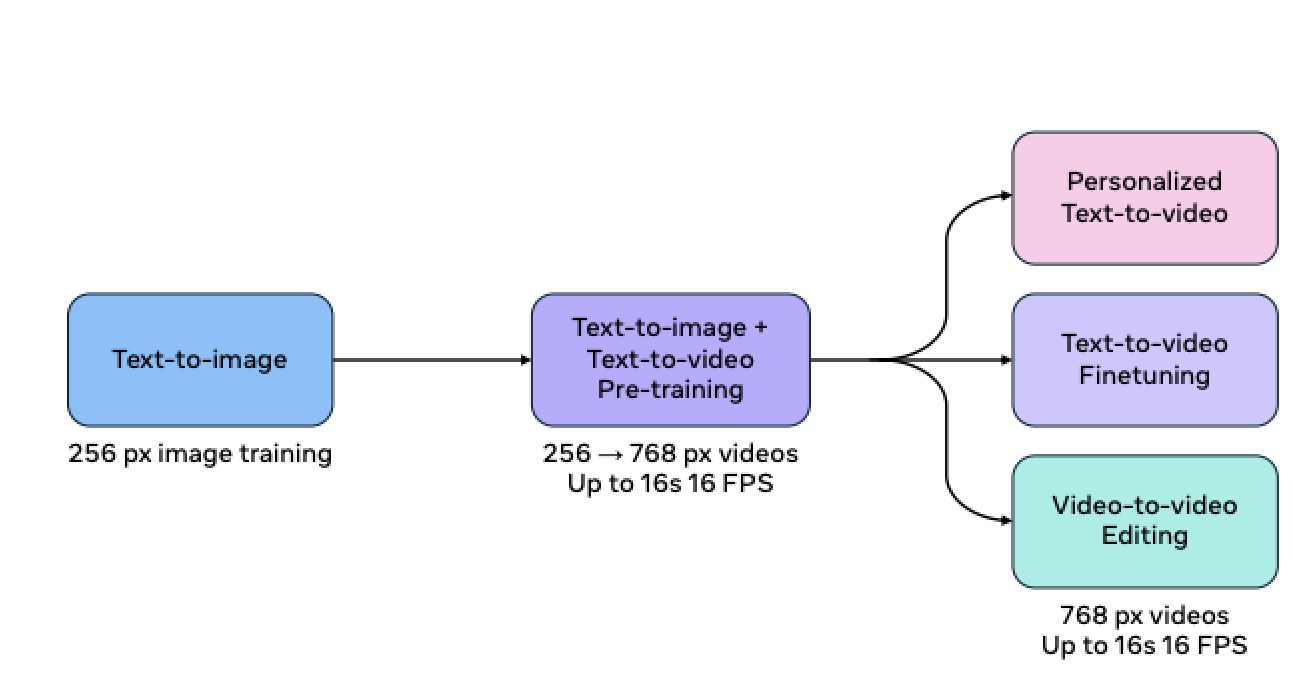

Além disso, os modelos T2V, personalização e edição do novo modelo vêm todos do mesmo esquema de treinamento. Durante o pré-treinamento, o Meta treina primeiro o T2I e depois o T2V. Use este modelo como inicialização, depois conduza o pós-treinamento de T2V e treine a capacidade de personalizar a edição de T2V e V2V.

Além disso, o treinamento do modelo também é realizado de acordo com o nível de resolução, primeiro com treinamento de baixa resolução (256px) e depois com treinamento de alta resolução (768px). A Meta AI tenta treinar conjuntamente T2I + T2V, mas isso resulta em uma convergência muito mais lenta e pior qualidade do que antes.

A razão pela qual o Movie Gen Video pode obter resultados de geração realistas é essencialmente devido às excelentes capacidades do modelo de conversor de parâmetros de até 30B. Este modelo pode gerar vídeos de até 16 segundos a uma velocidade de 16 quadros por segundo e pode gerar até. 16 segundos de vídeo 45 segundos de áudio de alta qualidade e alta fidelidade.

Funcionários da Meta também revelaram no jornal:

Esses modelos podem raciocinar sobre o movimento do objeto, as interações sujeito-objeto e o movimento da câmera, e podem aprender movimentos razoáveis para uma variedade de conceitos.

Esta frase tem um total de três significados. O primeiro é que o próprio modelo pode quase restaurar o movimento físico do mundo real, bem como várias leis físicas de “senso comum”. Para os usuários, o que parece “natural e realista” é o. tecnologia modelo. O lugar de maior sucesso.

O Movie Gen Video pode compreender com precisão os padrões de movimento do mundo físico, e a Meta AI tem feito grandes esforços. A equipe conduziu um extenso pré-treinamento do novo modelo em centenas de milhões de vídeos e bilhões de imagens. Através de constante repetição, aprendizado, resumo, raciocínio e aplicação, o Movie Gen Video alcançou excelente desempenho no site oficial.

Então, o modelo também pode imitar e aprender ativamente os movimentos de câmera, cenas, montagens, etc. de filmes profissionais. Em outras palavras, os vídeos gerados pelo Movie Gen Video também possuem profissionalismo e talento artístico semelhantes aos da filmagem.

No entanto, Andrew Brown mencionou que a avaliação de texto para vídeo é difícil. Porque as métricas automatizadas são muito pobres e não se correlacionam bem com as avaliações humanas. Em outras palavras, nos primeiros dias do desenvolvimento de modelos de geração de vídeo, os resultados da geração eram muito diferentes do mundo físico real nas impressões e observações das pessoas. No final, Meta ainda determinou a autenticidade deste julgamento, confiando inteiramente em humanos. avaliação.

Nós nos esforçamos muito para dividir a avaliação de vídeo em vários eixos ortogonais de qualidade e alinhamento.

Resultados O Movie Gen vence ou está no mesmo nível em termos de qualidade e consistência quando comparado aos modelos no conjunto de avaliação de 1000 pistas.

Por fim, o modelo pode raciocinar e criar o próximo conteúdo com base nisso. É como um diretor profissional, dirigindo cada movimento da imagem, é também como um artista de onomatopeia experiente, com base no conteúdo do vídeo ou nas instruções de texto. que corresponde à imagem em tempo real.

▲ O efeito sonoro no momento em que os fogos de artifício explodem

A capacidade de gerar áudio de forma síncrona depende do Movie Gen Audio. Este é um modelo de conversor de parâmetros 13B que aceita entrada de vídeo, bem como prompts de texto opcionais para geração controlável de áudio de alta fidelidade sincronizado com vídeo.

Assim como o Movie Gen Video, o Movie Gen Audio também realiza exercícios “massivos” que alimentam milhões de horas de referências de áudio no treinamento do modelo. Depois de muitas comparações e resumos, o modelo atual dominou a correspondência entre som e imagem, podendo até entender os diferentes sentimentos que diferentes BGM trarão ao público.

Portanto, quando se trata de palavras-chave sobre humor e ambiente, o Movie Gen Audio sempre pode encontrar músicas que combinem perfeitamente com a imagem.

Ao mesmo tempo, ele pode gerar sons ambientes, faixas de apoio instrumentais e sons foley, proporcionando resultados de última geração em termos de qualidade de áudio, alinhamento de vídeo para áudio e alinhamento de texto para áudio.

Isso os torna os modelos mais avançados do gênero.

Embora não ousemos fazer uma conclusão tão confiante como a oficial, não importa a duração do vídeo oficial, a qualidade da imagem ou o ajuste da música de fundo, em comparação com os modelos da geração de vídeo anterior, o Movie Gen Video tem um progresso muito óbvio.

Além disso, em comparação com o antigo ídolo Sora, Movie Gen tem uma clara liderança em termos de qualidade geral e consistência, Andrew Brown disse descaradamente que neste jogo com Sora:

Movie Gen vence em todos os aspectos.

O "especialista versátil" em edição de vídeo

Com a colaboração do Movie Gen Video e do Movie Gen Audio, o novo modelo de geração de vídeo do Meta AI tem novos recursos. No entanto, os avanços mencionados acima são apenas a base técnica. Com a capacidade de gerar áudio e vídeo, o Meta também continuou a se expandir. o novo modelo permite suportar a geração de vídeos personalizados.

Personalização, como o nome sugere, consiste em combinar as necessidades do usuário e gerar conteúdo de vídeo específico de acordo com os requisitos.

Embora os modelos de vídeo anteriores também possam gerar resultados personalizados, os resultados são sempre insatisfatórios ou os detalhes não podem ser alterados e precisam ser reiniciados, ou outros elementos da imagem não podem ser mantidos quando os detalhes são continuamente alterados. pela geração de novos vídeos.

A demonstração do Movie Gen Video no site oficial demonstra muito bem suas vantagens nesse aspecto. O novo modelo pode não apenas gerar vídeos personalizados de acordo com os requisitos de palavras rápidas/imagens de referência, mas também continuar a otimizar e ajustar detalhes com base no vídeo e garantir que outros conteúdos gerados não sejam perturbados, o que é uma "modificação fina".

Ao contrário das ferramentas de geração tradicionais que exigem habilidades especializadas ou falta de precisão, o Movie Gen preserva o conteúdo original e visa apenas pixels relevantes.

Nosso modelo alcança resultados de última geração na criação de vídeos personalizados que preservam a identidade e as ações humanas.

Esta função é muito útil para muitos estúdios de mídia própria ou pessoas com necessidades de edição de vídeo. Ela pode fazer modificações globais ou detalhadas nos objetos alterados. Pode ser tão grande quanto regenerar a imagem inteira com base no texto, ou tão pequeno quanto apenas mudar a cor do cabelo do personagem, estilo dos óculos, etc. Por exemplo, modelos podem ser usados para eliminar a desordem irrelevante em segundo plano.

Ou você pode dar um novo plano de fundo ao vídeo original, seja no estilo ou na cor, você pode alterá-lo a qualquer momento e também transformar o dia em noite em segundos.

Além disso, o Movie Gen Video também pode fazer ajustes sutis em muitos detalhes. Ao mesmo tempo que garante que a composição do vídeo e a imagem geral permaneçam inalteradas, ele também pode alterar a cor das roupas do personagem, o estilo de uso dos óculos, as roupas principais do corpo e a cor do pelo do animal de estimação. , etc.

Por exemplo, remover a desordem irrelevante dos vídeos, alterar o estilo de fundo da imagem, adicionar detalhes ao vídeo, alterar a cor das roupas do sujeito, etc., são todos os seus pontos fortes.

Mas isso é apenas uma fantasia, porque o Movie Gen Video atualmente suporta apenas vídeos longos de alta definição em 1080P, 16 segundos, 16 quadros por segundo ou até 45 segundos de áudio de alta qualidade e alta fidelidade. Este tipo de resolução de imagem e duração de vídeo parece não ser suficiente para um indivíduo ou empresa com necessidades criativas.

No entanto, este avanço tecnológico permitiu que a IA tivesse a capacidade de editar arquivos de vídeo com ajustes infinitos, personalização e ajuste preciso. Além disso, o Movie Gen Audio abriu a porta para a dublagem de vídeo, embora o Movie Gen Video não esteja disponível até o próximo ano. . Não foi oficialmente recebido pelo público, mas a julgar pelos atuais resultados das demonstrações oficiais, é realmente possível injetar um novo impulso nas indústrias de vídeo, cinema, televisão e IA, e até mesmo provocar uma nova revolução.

As ferramentas mais recentes e de ponta, incluindo o Movie Gen Video, estão tentando quebrar esse estereótipo de IA no campo da geração de vídeo, embora com suas capacidades atuais, esse dia ainda esteja muito distante.

Para modelos de geração de vídeo, é difícil afetar diretamente ou mesmo tocar a vida cotidiana das pessoas comuns no início. Pode não ser até que um determinado filme criado por IA seja criado que ele atraia a atenção do público em termos de frescor. Os atuais filmes, séries de TV e animações produzidas com IA apresentam algumas deficiências, como imagens irrealistas e movimentos inconsistentes.

A Meta AI também declarou em seu site oficial que, à medida que a tecnologia do modelo melhora e se desenvolve, eles trabalharão em estreita colaboração com cineastas e criadores para integrar seus comentários. Atualmente, seja Runway, Sora ou o mais recente Meta AI, todos estão se desenvolvendo rapidamente. Pelo menos em comparação com os resultados da geração de um ano atrás, podemos ver um progresso visível.

O impacto da tecnologia de IA na vida das pessoas pode não ser aparente imediatamente Quando todos ainda estão discutindo "para que serve a IA", seu maior significado para a maioria das pessoas é que ela possui mais uma ferramenta útil, um brinquedo divertido.

Seja um cineasta que busca fazer sucesso em Hollywood ou um criador que gosta de fazer vídeos para o público, acreditamos que todos deveriam ter acesso a ferramentas que ajudem a aprimorar sua criatividade.

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (ID do WeChat: ifanr). Mais conteúdo interessante será fornecido a você o mais rápido possível.