Alegando que a avaliação chinesa supera o GPT-4, a Baichuan Intelligent lança o Baichuan 3, um grande modelo com mais de 100 bilhões de parâmetros

Empresas iniciantes de grande porte "baseadas em Tsinghua" estão recrutando novamente.

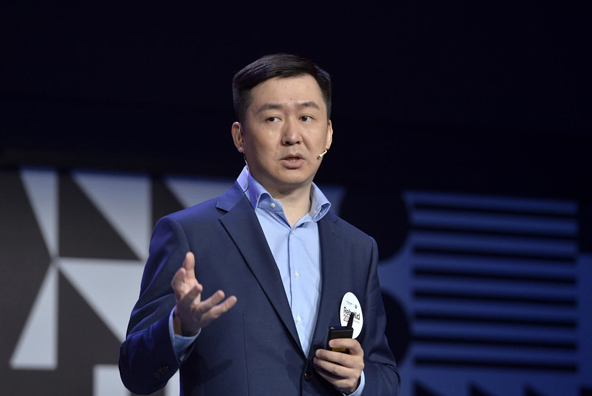

Em 29 de janeiro, a Baichuan Intelligence, fundada pelo fundador da Sogou, Wang Xiaochuan (bacharelado na Universidade de Tsinghua), lançou oficialmente o Baichuan 3, um grande modelo de linguagem com mais de 100 bilhões de parâmetros. Este modelo não só tem um bom desempenho em vários testes oficiais, mas também supera o GPT-4 nos indicadores chineses.

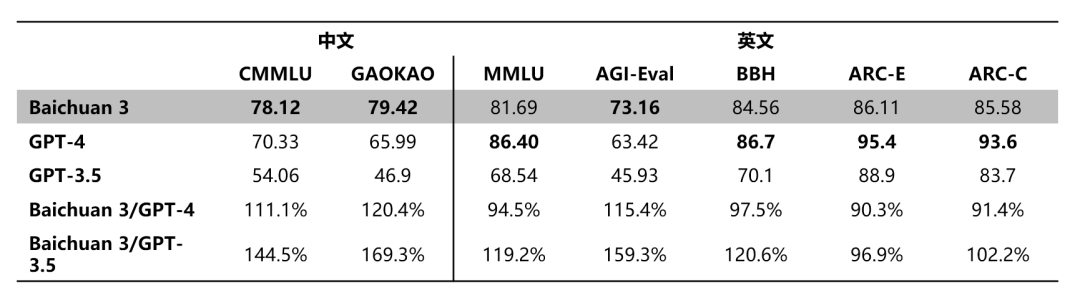

Os resultados dos testes mostram que o Baichuan 3 atinge um nível próximo a 90% do GPT-4 em vários benchmarks ingleses, como o MMLU. Em muitos testes de benchmark chineses, como CMMLU e GAOKAO, o Baichuan 3 está muito à frente, ultrapassando o GPT-3.5 por uma grande margem e também superando o GPT-4 em todos os aspectos.

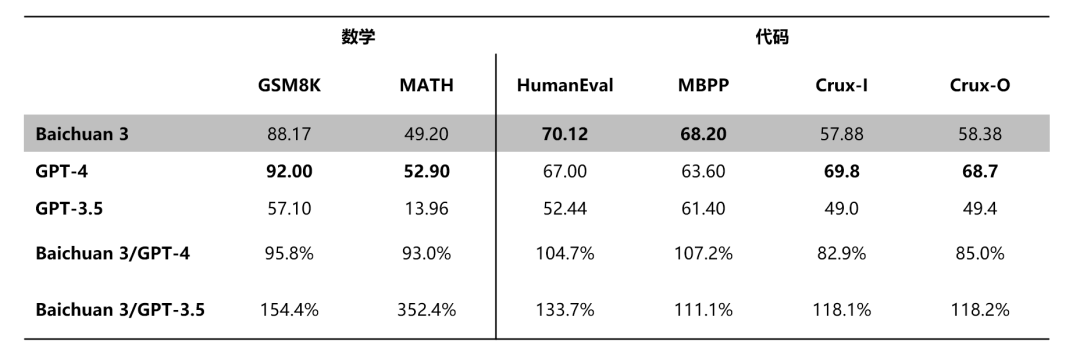

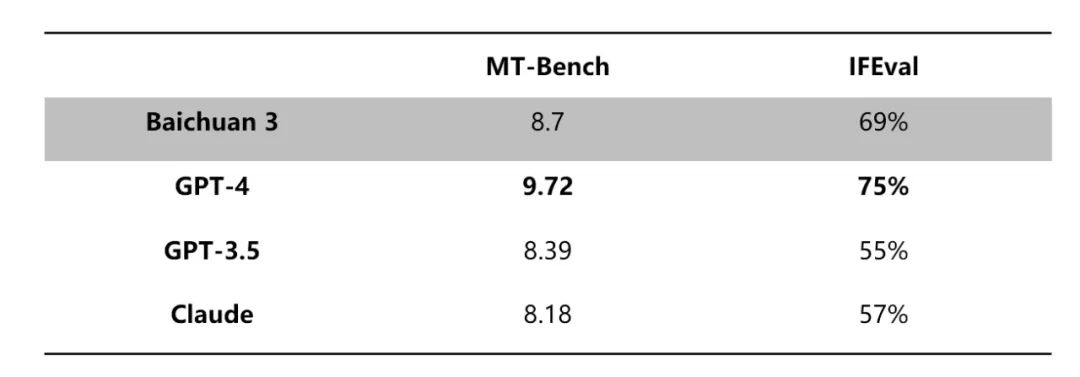

Nos testes de matemática e lista de códigos, bem como na avaliação de listas alinhadas como MT-Bench e IFEval, o Baichuan 3 superou grandes modelos como GPT-3.5 e Claude, e também está na vanguarda da indústria, apenas ligeiramente inferior ao GPT-4.

AI+medicina é uma área de aplicação chave de grandes modelos. Os problemas médicos são complexos e mutáveis, o conhecimento é atualizado rapidamente e os requisitos de precisão são elevados, exigindo modelos que demonstrem plenamente capacidades poderosas de compreensão e tomada de decisão em texto, imagens, sons, etc.

Portanto, a Inteligência Baichuan a considera a “jóia da coroa” dos grandes modelos.

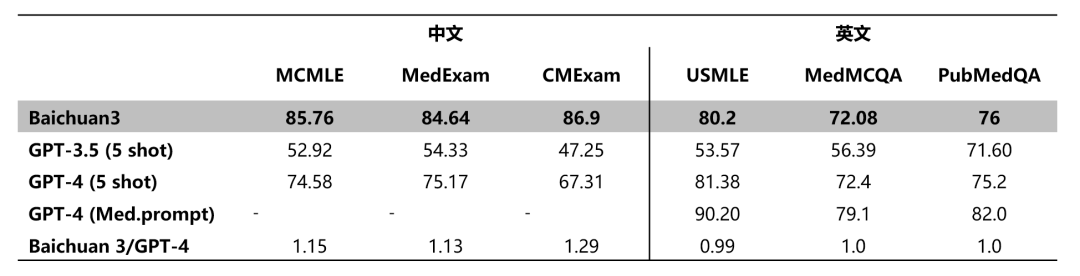

Baichuan 3 passou por extenso treinamento e otimização na área médica, e os resultados após o treinamento também são muito significativos.Seu desempenho em tarefas médicas chinesas, como MCMLE, MedExam e CMExam, excede o do GPT-4, e seu desempenho em tarefas médicas inglesas tarefas como USMLE e MedMCQA também estão próximas do nível GPT-4, ganhando o título de modelo chinês com as capacidades médicas mais fortes de uma só vez.

De acordo com divulgações oficiais, para fortalecer a formação nesta área, Baichuan 3 construiu um conjunto de dados médicos de mais de 100 mil milhões de Tokens durante a fase de pré-formação do modelo, cobrindo todos os aspectos do conhecimento médico, da teoria à prática, para garantir profissionalismo e profissionalismo. na área médica Profundidade de conhecimento.

No estágio de inferência, o Baichuan Intelligence otimiza os prompts de conhecimento médico, descrevendo tarefas com precisão e selecionando amostras adequadamente, tornando a saída do modelo mais precisa e com etapas de inferência lógicas.

A compreensão semântica e a geração de texto são as capacidades subjacentes mais básicas de grandes modelos e podem ser consideradas os pilares centrais dos modelos de inteligência artificial. Wang Xiaochuan certa vez apontou que a linguagem é a fronteira do mundo cognitivo humano. Do ponto de vista da implementação técnica, perceber e compreender a linguagem é mais difícil do que imagens e vídeos.

Na sua opinião, Newton usou as três leis do movimento para abstrair as leis do universo em expressões matemáticas, o que foi um grande salto para a cognição humana. O mesmo vale para os modelos maiores de hoje. Dominar as leis por trás da linguagem significa dominar o próprio conhecimento, bem como o pensamento, a comunicação e a cultura humanos.

Um modelo de linguagem é como uma bomba atômica: pode acender uma bomba de hidrogênio. Haverá uma melhor modelização no futuro, que é o que precisamos de fazer no futuro.

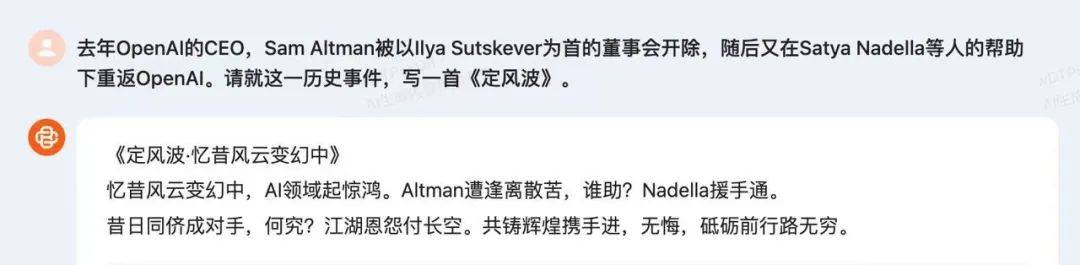

A poderosa capacidade de processamento da língua chinesa do Baichuan 3 é um dos seus maiores destaques. Mesmo diante de gêneros difíceis, como letras de músicas com formatos complexos, estruturas compactas e rimas ricas, Baichuan 3 pode produzir obras com conteúdo elegante, contrapontos bem alinhados e rimas harmoniosas.

As autoridades afirmaram que o Baichuan 3 combina "RLHF&RLAIF" e métodos iterativos de aprendizagem por reforço para melhorar significativamente a capacidade de grandes modelos de linguagem na criação de poesia. Em comparação com outros modelos de topo da indústria, a sua usabilidade de criação aumentou mais de 5 vezes e as suas realizações literárias ultrapassam completamente o GPT-4.

▲ Link da experiência: https://www.baichuan-ai.com/

Por exemplo, na demonstração oficial, Baichuan 3 foi solicitado a gerar uma música sensacional sobre o "Drama Gongdou" da OpenAI, cuja performance de uma mistura de chinês e inglês é bastante interessante.

"Defendendo a Tempestade · Relembrando o Passado e a Tempestade em Mudança"

Olhando para o passado, em meio às mudanças, o campo da IA está crescendo. Altman está sofrendo com a separação, quem pode ajudar? Nadella ajuda.

O que há de errado em ex-colegas se tornarem rivais? As queixas e queixas do mundo estão no céu. Vamos criar brilho juntos e seguir em frente de mãos dadas, sem arrependimentos, e o caminho a seguir será interminável.

Vale ressaltar que a Baichuan Intelligence se diferencia de outras grandes empresas modelo em seu conceito de código aberto. Isso pode ser visto no discurso de Wang Xiaochuan na conferência de imprensa de Baichuan 2.

Llama 2 Os dias do modelo de código aberto acabaram. Agora podemos obter um modelo de código aberto mais amigável e mais capaz do que o Llama, que pode ajudar a apoiar o desenvolvimento de todo o ecossistema da China.

Embora o Llama 2 seja anunciado como código aberto, na verdade ele está disponível apenas no ambiente inglês. Por outro lado, a série Baichuan 2 está totalmente aberta aos usuários chineses e oferece serviços gratuitos em um ambiente bilíngue chinês-inglês.

A Baichuan Intelligent abriu sucessivamente quatro modelos de implantação de baixo custo, incluindo Baichuan-7B, Baichuan-13B, Baichuan2-7B e Baichuan2-13B, suportando modelos grandes em chinês e inglês.

Além disso, quando questionado pela mídia sobre como fazer com que os modelos de código aberto e comercial de código fechado andem de mãos dadas e iterem rapidamente, Chen Weipeng, cofundador da Baichuan Intelligent Technology, revelou que isso se deve à sua rica experiência em tecnologia de pesquisa que podem ser rapidamente migrados e aplicados a grandes modelos.

Do ponto de vista técnico, a pesquisa e os grandes modelos compartilham muitos fundamentos técnicos comuns. Por exemplo, no principal elo de processamento de dados do treinamento do modelo, a equipe conduziu a triagem e otimização de dados com base em sua experiência no campo de pesquisa, conseguindo filtragem repetida e melhorando a qualidade, fornecendo assim suporte de dados de alta qualidade para o modelo.

Em setembro do ano passado, ao falar sobre a lacuna entre os grandes modelos domésticos e o ChatGPT, Wang Xiaochuan fez o seguinte julgamento:

O GPT-4 está em constante aprimoramento e recentemente fez muito barulho com o lançamento de recursos de voz e imagem. Do ponto de vista temporal, pensamos que pode levar dois ou três anos para nos aproximarmos do nível atual do GPT-4.

É claro que na competição acirrada entre grandes modelos, não basta apenas permanecer na fase de exploração tecnológica, o próximo passo da Baichuan Intelligence é acelerar a transformação da tecnologia em cenários de aplicação.

Wang Xiaochuan mencionou "superaplicações" mais de uma vez em público e até previu que haverá várias superaplicações na China este ano. E esta pode se tornar a próxima batalha dos modelos grandes.

# Bem-vindo a seguir a conta pública oficial do WeChat de Aifaner: Aifaner (WeChat ID: ifanr).Mais conteúdo interessante será fornecido a você o mais rápido possível.