Microsoft explica como milhares de GPUs Nvidia criaram o ChatGPT

O ChatGPT ganhou fama viral nos últimos seis meses, mas não surgiu do nada. De acordo com uma postagem de blog publicada pela Microsoft na segunda-feira, a OpenAI, a empresa por trás do ChatGPT, procurou a Microsoft para construir uma infraestrutura de IA em milhares de GPUs Nvidia há mais de cinco anos.

A parceria da OpenAI e da Microsoft ganhou destaque recentemente, especialmente depois que a Microsoft fez um investimento de US$ 10 bilhões no grupo de pesquisa que está por trás de ferramentas como ChatGPT e DALL-E 2 . No entanto, a parceria começou há muito tempo, segundo a Microsoft. Desde então, a Bloomberg relata que a Microsoft gastou “várias centenas de milhões de dólares” no desenvolvimento da infraestrutura para dar suporte ao ChatGPT e projetos como o Bing Chat .

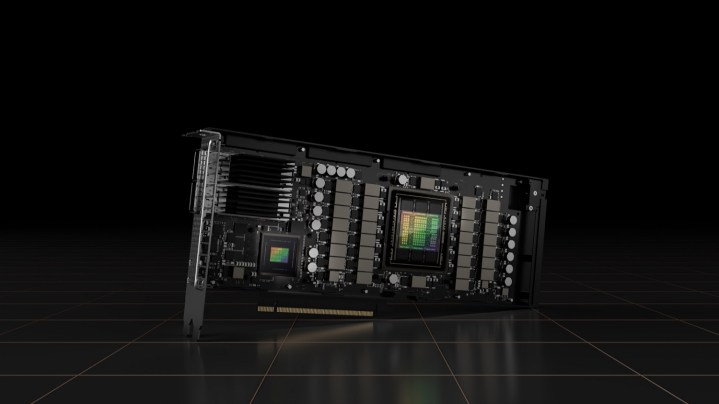

Grande parte desse dinheiro foi para a Nvidia, que agora está na vanguarda do hardware de computação necessário para treinar modelos de IA. Em vez de GPUs de jogos como você encontraria em uma lista das melhores placas gráficas , a Microsoft foi atrás das GPUs de nível empresarial da Nvidia, como o A100 e o H100.

Porém, não é tão simples quanto juntar placas gráficas e treinar um modelo de linguagem. Como Nidhi Chappell, chefe de produto da Microsoft para o Azure, explica: “Isso não é algo que você simplesmente compre um monte de GPUs, conecte-as e elas começarão a trabalhar juntas. Há muita otimização no nível do sistema para obter o melhor desempenho, e isso vem com muita experiência ao longo de muitas gerações.”

Com a infraestrutura instalada, a Microsoft agora está abrindo seu hardware para outros. A empresa anunciou na segunda-feira em um post de blog separado que ofereceria sistemas Nvidia H100 “sob demanda em tamanhos que variam de oito a milhares de GPUs Nvidia H100”, fornecidos pela rede Azure da Microsoft.

A popularidade do ChatGPT disparou a Nvidia , que investiu em IA por meio de hardware e software por vários anos. A AMD, principal concorrente da Nvidia em placas gráficas para jogos, tem tentado avançar no espaço com aceleradores como o Instinct MI300.

De acordo com Greg Brockman, presidente e cofundador da OpenAI, o treinamento do ChatGPT não teria sido possível sem a potência fornecida pela Microsoft: “O co-projeto de supercomputadores com o Azure foi crucial para dimensionar nossas exigentes necessidades de treinamento em IA, tornando nossa pesquisa e o trabalho de alinhamento em sistemas como o ChatGPT é possível.”

Espera-se que a Nvidia revele mais sobre futuros produtos de IA durante a GPU Technology Conference (GTC). com a apresentação principal começa em 21 de março. A Microsoft está expandindo seu roteiro de IA no final desta semana, com uma apresentação focada no futuro da IA no local de trabalho agendada para 16 de março.