Rostos gerados por IA estão dominando a internet

O Times fez o perfil de uma ucraniana de 18 anos chamada “Luba Dovzhenko” em março para ilustrar a vida sitiada. Ela, afirmava o artigo, estudou jornalismo, falava “inglês ruim” e começou a carregar uma arma após a invasão russa.

A questão, no entanto, era que Dovhenko não existe na vida real, e a história foi retirada logo após ser publicada.

Luba Dovhenko era uma persona online falsa projetada para capitalizar o crescente interesse nas histórias de guerra Ucrânia-Rússia no Twitter e ganhar muitos seguidores. A conta não apenas nunca twittou antes de março, mas também tinha um nome de usuário diferente, e as atualizações que estava twittando, o que possivelmente chamou a atenção do The Times, foram extraídas de outros perfis genuínos. A evidência mais contundente de sua fraude, no entanto, estava bem ali em seu rosto.

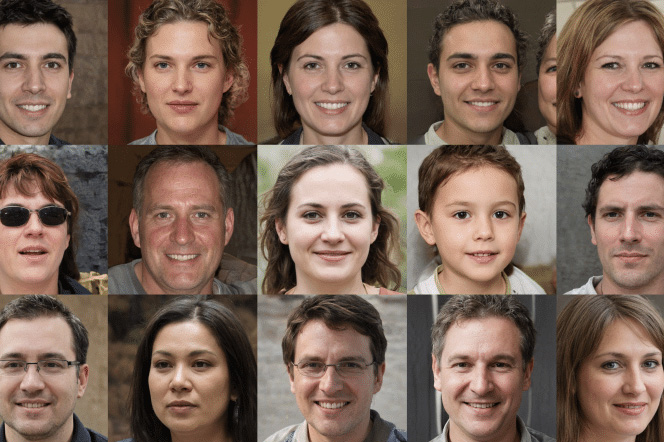

Na foto de perfil de Dovhenko, alguns de seus fios de cabelo estavam soltos do resto da cabeça, alguns cílios estavam faltando e, o mais importante, seus olhos estavam surpreendentemente centrados. Todos eram sinais reveladores de um rosto artificial tossido por um algoritmo de IA.

O posicionamento do recurso facial não é a única anomalia na foto de perfil de @lubadovzhenko1 ; não o cabelo solto na parte inferior direita da imagem e os cílios parcialmente ausentes (entre outras coisas). pic.twitter.com/UPuvAQh4LZ

— Conspirador Norteño (@conspirator0) 31 de março de 2022

O rosto de Dovhenko foi fabricado pela tecnologia por trás dos deepfakes , uma técnica cada vez mais popular que permite que qualquer pessoa sobreponha um rosto ao de outra pessoa em um vídeo e é empregada para tudo, desde pornografia de vingança até manipulação de discursos de líderes mundiais. E ao alimentar esses algoritmos com milhões de fotos de pessoas reais, eles podem ser reaproveitados para criar rostos realistas como o de Dovhenko do nada. É um problema crescente que está dificultando ainda mais a luta contra a desinformação.

Um exército de rostos falsos gerados por IA

Nos últimos anos, à medida que as redes sociais reprimem trolls anônimos e sem rosto, a IA armou atores e bots maliciosos com uma arma inestimável: a capacidade de parecer assustadoramente autêntico. Ao contrário de antes, quando os trolls simplesmente arrancavam rostos reais da internet e qualquer um podia desmascará-los ao fazer uma imagem reversa de sua foto de perfil, é praticamente impossível alguém fazer o mesmo com fotos geradas por IA porque são novas e únicas. E mesmo após uma inspeção mais detalhada, a maioria das pessoas não consegue perceber a diferença.

A Dra. Sophie Nightingale, professora de psicologia da Universidade Lancaster do Reino Unido, descobriu que as pessoas têm apenas 50% de chance de identificar um rosto sintetizado por IA, e muitos até os consideram mais confiáveis do que os reais. Os meios para qualquer pessoa acessar “conteúdo sintético sem conhecimento especializado de Photoshop ou CGI”, disse ela ao Digital Trends, “cria uma ameaça significativamente maior para usos nefastos do que as tecnologias anteriores”.

O que torna esses rostos tão elusivos e altamente realistas, diz Yassine Mekdad, pesquisador de segurança cibernética da Universidade da Flórida, cujo modelo para detectar imagens geradas por IA tem uma precisão de 95,2%, é que sua programação (conhecida como Generative Adversarial Network) usa duas redes neurais opostas que trabalham uma contra a outra para melhorar uma imagem. Um (G, gerador) é encarregado de gerar as imagens falsas e enganar o outro, enquanto o segundo (D, discriminador) aprende a diferenciar os resultados do primeiro de rostos reais. Esse “jogo de soma zero” entre os dois permite que o gerador produza “imagens indistinguíveis”.

E os rostos gerados por IA realmente dominaram a Internet em um ritmo vertiginoso. Além de contas como a de Dovhenko, que usa personas sintetizadas para conquistar seguidores, essa tecnologia ultimamente tem impulsionado campanhas muito mais alarmantes.

Quando o Google demitiu um pesquisador de ética em IA, Timnit Gebru, em 2020 por publicar um artigo que destacava o viés nos algoritmos da empresa, uma rede de bots com rostos gerados por IA , que alegavam ter trabalhado na divisão de pesquisa de IA do Google, surgiu em todo o mundo. redes sociais e emboscaram qualquer um que falasse a favor de Gebru. Atividades semelhantes de países como a China foram detectadas promovendo narrativas governamentais.

Em uma revisão superficial do Twitter, não demorei muito para encontrar vários anti-vaxxers , pró-russos e mais – todos se escondendo atrás de um rosto gerado por computador para empurrar suas agendas e atacar qualquer um que estivesse em seu caminho. Embora o Twitter e o Facebook desativem regularmente esses botnets, eles não têm uma estrutura para lidar com trolls individuais com um rosto sintético, embora a política de identidades enganosas e enganosas do primeiro “proíba a personificação de indivíduos, grupos ou organizações para enganar, confundir ou enganar os outros, nem usar uma identidade falsa de uma maneira que perturbe a experiência dos outros”. É por isso que quando denunciei os perfis que encontrei, fui informado de que eles não violavam nenhuma política.

A Sensity, uma empresa de soluções de fraude baseada em IA, estima que cerca de 0,2% a 0,7% das pessoas em redes sociais populares usam fotos geradas por computador. Isso não parece muito por si só, mas para o Facebook (2,9 bilhões de usuários), Instagram (1,4 bilhão de usuários) e Twitter (300 milhões de usuários), isso significa milhões de bots e atores que potencialmente poderiam fazer parte de campanhas de desinformação .

A porcentagem de correspondência de uma extensão do Chrome do detector de rosto gerado por IA pela V7 Labs corroborou os números da Sensity. Seu CEO, Alberto Rizzoli, afirma que, em média, 1% das fotos que as pessoas enviam são sinalizadas como falsas.

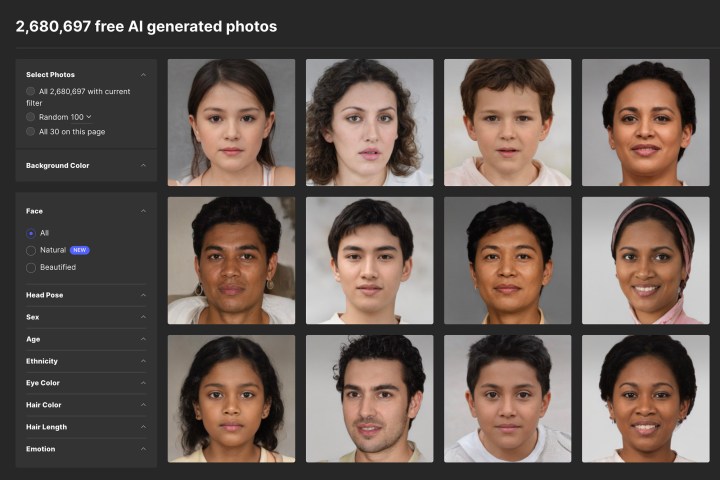

O mercado de rosto falso

Parte do motivo pelo qual as fotos geradas por IA proliferaram tão rapidamente é como é fácil obtê-las. Em plataformas como o Generated Photos , qualquer pessoa pode adquirir centenas de milhares de rostos falsos de alta resolução por alguns dólares e, para pessoas que precisam de alguns para fins pontuais, como campanhas de difamação pessoal, podem baixá-los de sites como thispersondoesnotexist .com , que gera automaticamente um novo rosto sintético toda vez que você o recarrega.

Esses sites tornaram a vida especialmente desafiadora para pessoas como Benjamin Strick, diretor de investigações do Centro de Resiliência da Informação do Reino Unido, cuja equipe passa horas todos os dias rastreando e analisando conteúdo enganoso online.

“Se você colocar [tecnologias autogeradoras] em um pacote de perfis falsos, trabalhando em uma startup falsa (através thisstartupdoesnotexist.com)”, disse Strick ao Digital Trends, “há uma receita para engenharia social e uma base para práticas que podem ser configuradas em questão de minutos.”

Ivan Braun, fundador da Generated Photos, argumenta que nem tudo é ruim. Ele afirma que as fotos GAN têm muitos casos de uso positivos – como anonimizar rostos no Street View do Google Maps e simular mundos virtuais em jogos – e é isso que a plataforma promove. Se alguém está no negócio de enganar as pessoas, Braun diz que espera que as defesas antifraude de sua plataforma sejam capazes de detectar as atividades prejudiciais e que, eventualmente, as redes sociais consigam filtrar as fotos geradas das autênticas.

Mas regular a tecnologia generativa baseada em IA também é complicado, pois também alimenta inúmeros serviços valiosos, incluindo o filtro mais recente nos recursos de iluminação inteligente do Snapchat e Zoom. O CEO da Sensity, Giorgio Patrini, concorda que banir serviços como o Generated Photos é impraticável para conter o aumento de rostos gerados por IA. Em vez disso, há uma necessidade urgente de abordagens mais proativas das plataformas.

Até que isso aconteça, a adoção de mídia sintética continuará a corroer a confiança em instituições públicas como governos e jornalismo, diz Tyler Williams, diretor de investigações da Graphika, uma empresa de análise de redes sociais que descobriu algumas das mais extensas campanhas envolvendo pessoas falsas. . E um elemento crucial na luta contra o uso indevido de tais tecnologias, acrescenta Williams, é “um currículo de alfabetização midiática desde tenra idade e treinamento de verificação de fontes”.

Como identificar um rosto gerado por IA?

Para sua sorte, existem algumas maneiras infalíveis de saber se um rosto foi criado artificialmente. A coisa a lembrar aqui é que esses rostos são evocados simplesmente misturando toneladas de fotos. Portanto, embora o rosto real pareça real, você encontrará muitas pistas nas bordas: as formas das orelhas ou os brincos podem não corresponder, os fios de cabelo podem estar voando por todos os lugares e o acabamento dos óculos pode ser estranho – a lista continua. O mais comum é que, quando você passa por alguns rostos falsos, todos os olhos deles estarão exatamente na mesma posição: no centro da tela. E você pode testar com o hack do “ bilhete de trem dobrado ”, como demonstrado aqui por Strick.

Nightingale acredita que a ameaça mais significativa que as fotos geradas por IA representam está alimentando o “dividendo do mentiroso” – a mera existência delas permite que qualquer mídia seja descartada como falsa. “Se não podemos raciocinar sobre fatos básicos do mundo ao nosso redor”, ela argumenta, “então isso coloca nossas sociedades e democracias em risco substancial”.